1、RDB存储的弊端

1)、存储数据量较大,效率较低

- 基于快照思想,每次读写都是全部数据,当数据量巨大时,效率非常低

2)、大数据量下的IO性能较低

3)、基于fork创建子进程,内存产生额外消耗

4)、宕机带来的数据丢失风险

解决思路

1)、不写全数据,仅记录部分数据

2)、降低区分数据是否改变的难度,改记录数据为记录操作过程

3)、对所有操作均进行记录,排除丢失数据的风险

2、AOF概念

1)、AOF(append only file)持久化:以独立日志的方式记录每次写命令,重启时再重新执行AOF文件中命令 达到恢复数据的目的。与RDB相比可以简单描述为改记录数据为记录数据产生的过程

2)、AOF的主要作用是解决了数据持久化的实时性,目前已经是Redis持久化的主流方式

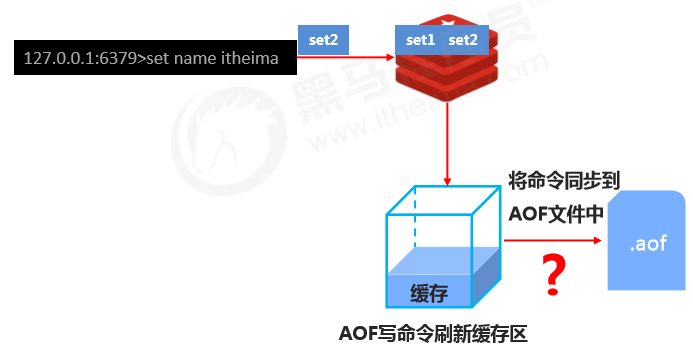

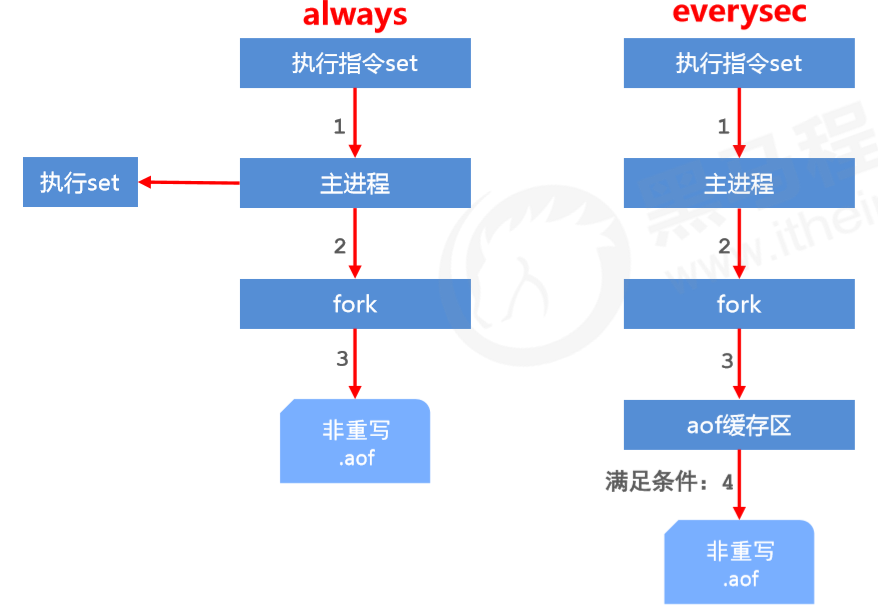

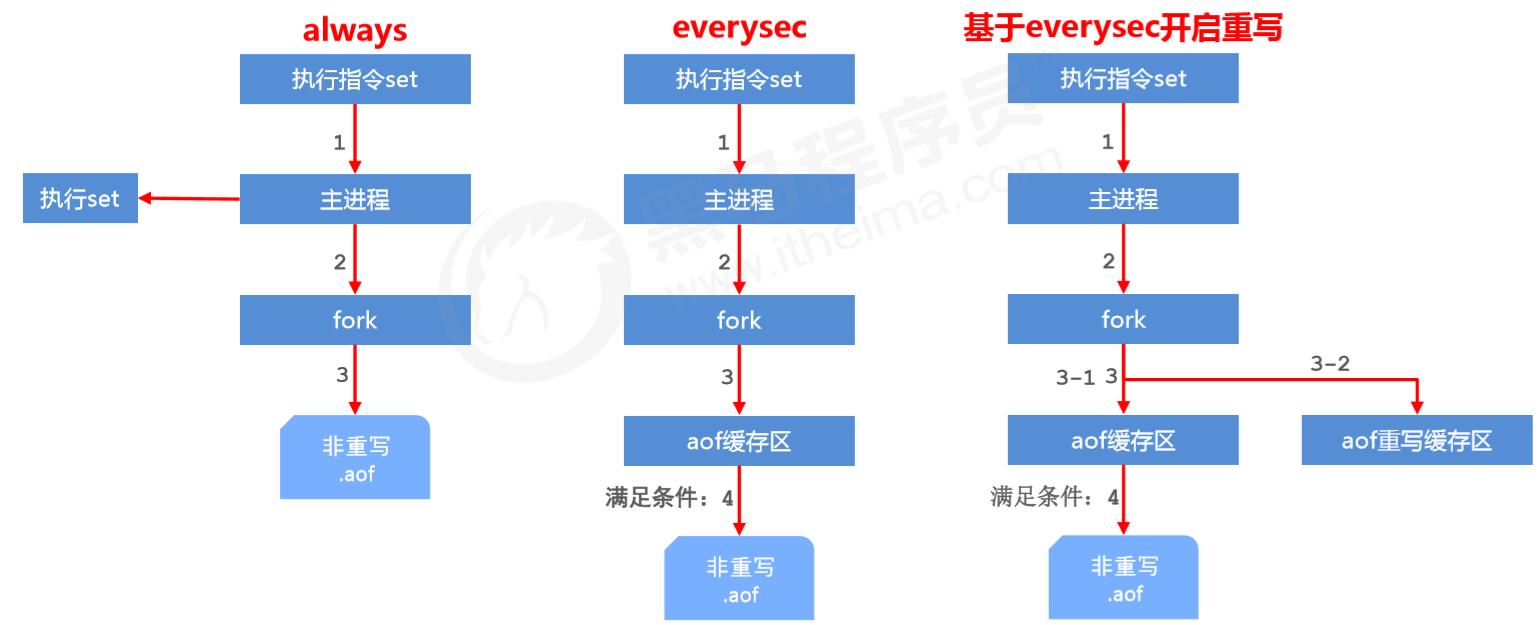

AOF写数据过程

3、AOF写数据三种策略(appendfsync)

1)、always(每次)

- 每次写入操作均同步到AOF文件中,数据零误差,性能较低

2)、everysec(每秒)

- 每秒将缓冲区中的指令同步到AOF文件中,数据准确性较高,性能较高

- 在系统突然宕机的情况下丢失1秒内的数据

3)、no(系统控制)

- 由操作系统控制每次同步到AOF文件的周期,整体过程不可控

4、AOF功能开启

1)、配置

appendonly yes|no

2)、作用

- 是否开启AOF持久化功能,默认为不开启状态

3)、配置

appendfsync always|everysec|no

4)、作用

- AOF写数据策略

5、AOF相关配置

1)、配置

appendfilename filename

2)、作用

- AOF持久化文件名,默认文件名未appendonly.aof,建议配置为appendonly-端口号.aof

3)、配置

dir

4)、作用

- AOF持久化文件保存路径,与RDB持久化文件保持一致即可

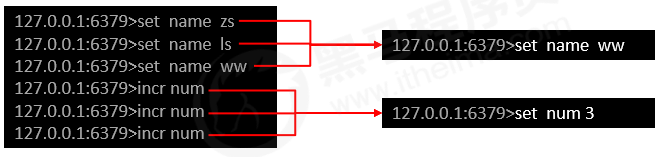

6、AOF写数据遇到的问题

如果连续执行如下指令该如何处理 ?

AOF重写

随着命令不断写入AOF,文件会越来越大,为了解决这个问题,Redis引入了AOF重写机制压缩文件体积。AOF文件重 写是将Redis进程内的数据转化为写命令同步到新AOF文件的过程。简单说就是将对同一个数据的若干个条命令执行结 果转化成最终结果数据对应的指令进行记录。

AOF重写作用

1)、降低磁盘占用量,提高磁盘利用率

2)、提高持久化效率,降低持久化写时间,提高IO性能

3)、降低数据恢复用时,提高数据恢复效率

AOF重写规则

1)、进程内已超时的数据不再写入文件

2)、忽略无效指令,重写时使用进程内数据直接生成,这样新的AOF文件只保留最终数据的写入命令

- 如del key1、 hdel key2、srem key3、set key4 111、set key4 222等

3)、对同一数据的多条写命令合并为一条命令

- 如lpush list1 a、lpush list1 b、 lpush list1 c 可以转化为:lpush list1 a b c。

- 为防止数据量过大造成客户端缓冲区溢出,对list、set、hash、zset等类型,每条指令最多写入64个元素

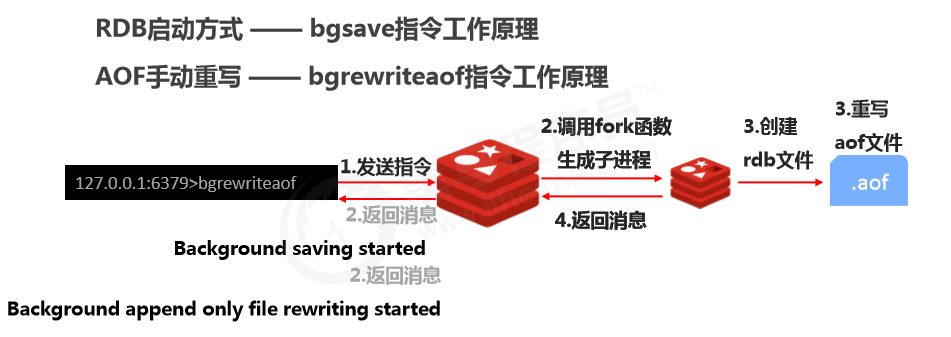

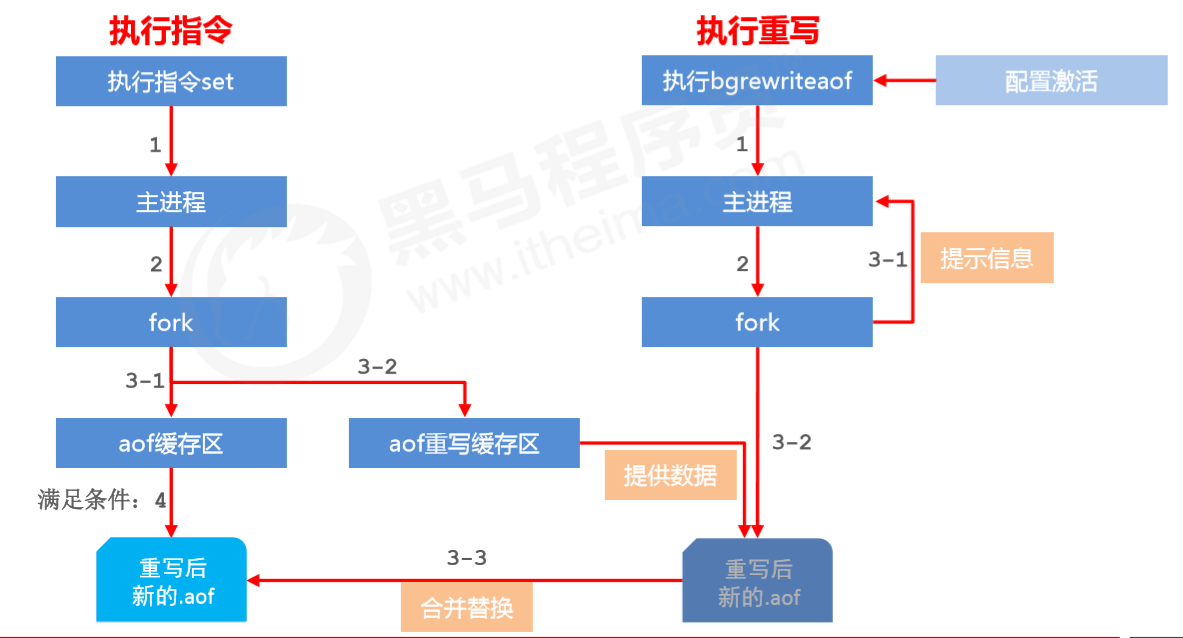

AOF重写方式

1)、手动重写

bgrewriteaof

2)、自动重写

auto-aof-rewrite-min-size size

auto-aof-rewrite-percentage percentage

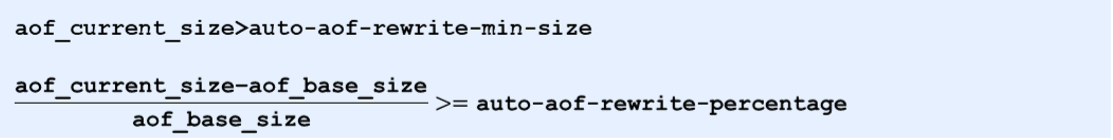

AOF自动重写方式

1)、自动重写触发条件设置

auto-aof-rewrite-min-size size

auto-aof-rewrite-percentage percent

2)、自动重写触发比对参数( 运行指令info Persistence获取具体信息 )

aof_current_size

aof_base_size

3)、自动重写触发条件

AOF工作流程

AOF重写流程

AOF重写流程

7、AOF缓冲区同步文件策略,由参数appendfsync控制

系统调用write和fsync说明:

1)、write操作会触发延迟写(delayed write)机制,Linux在内核提供页缓冲区用 来提高硬盘IO性能。write操作在写入系统缓冲区后直接返回。同步硬盘操作依 赖于系统调度机制,列如:缓冲区页空间写满或达到特定时间周期。同步文件之 前,如果此时系统故障宕机,缓冲区内数据将丢失。

2)、fsync针对单个文件操作(比如AOF文件),做强制硬盘同步,fsync将阻塞知道 写入硬盘完成后返回,保证了数据持久化。

3)、除了write、fsync、Linx还提供了sync、fdatasync操作,具体API说明参见: