今天学习回归算法的过程中,对于常见到的名词:极大似然、最小二乘以及梯度下降做一个总结

机器学习的基本框架大都是模型、目标和算法!

如何让模型尽可能好的拟合或者分类数据呢?那么就需要有目标函数,所以要定下模型的cost function,其中的获取损失函数的方法。

对于线性回归,可以采用他的似然函数、或根据最小二乘,写出他的损失函数。

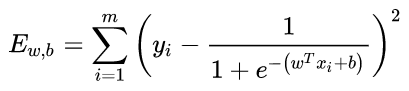

对于逻辑回归,采用似然函数求他的损失函数。

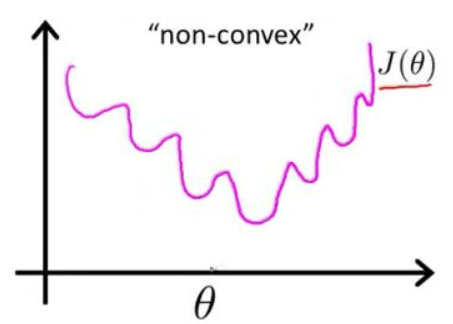

而采用何种优化算法,则可以使用最小二乘法、梯度下降法等。

问题1:最小二乘和最小均方误差的区别?

最小二乘:预测值和真实值差的平方和

均方误差:预测值和真实值差的期望![]() ,是一种加权最小二乘,权值为概率!

,是一种加权最小二乘,权值为概率!

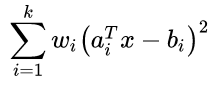

加权最小二乘:根据实际问题考虑每个求和项的重要程度,即加权值w,

均方误差估计是针对概率模型,二乘估计是针对确定性模型

问题2:为什么逻辑回归不用最小二乘?

主要是逻辑回归采用最小二乘获得损失函数的话,比较复杂,容易陷入局部最优

作者:禅在心中

出处:http://www.cnblogs.com/pinking/

本文版权归作者和博客园共有,欢迎批评指正及转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文连接,否则保留追究法律责任的权利。

浙公网安备 33010602011771号

浙公网安备 33010602011771号