一.问题

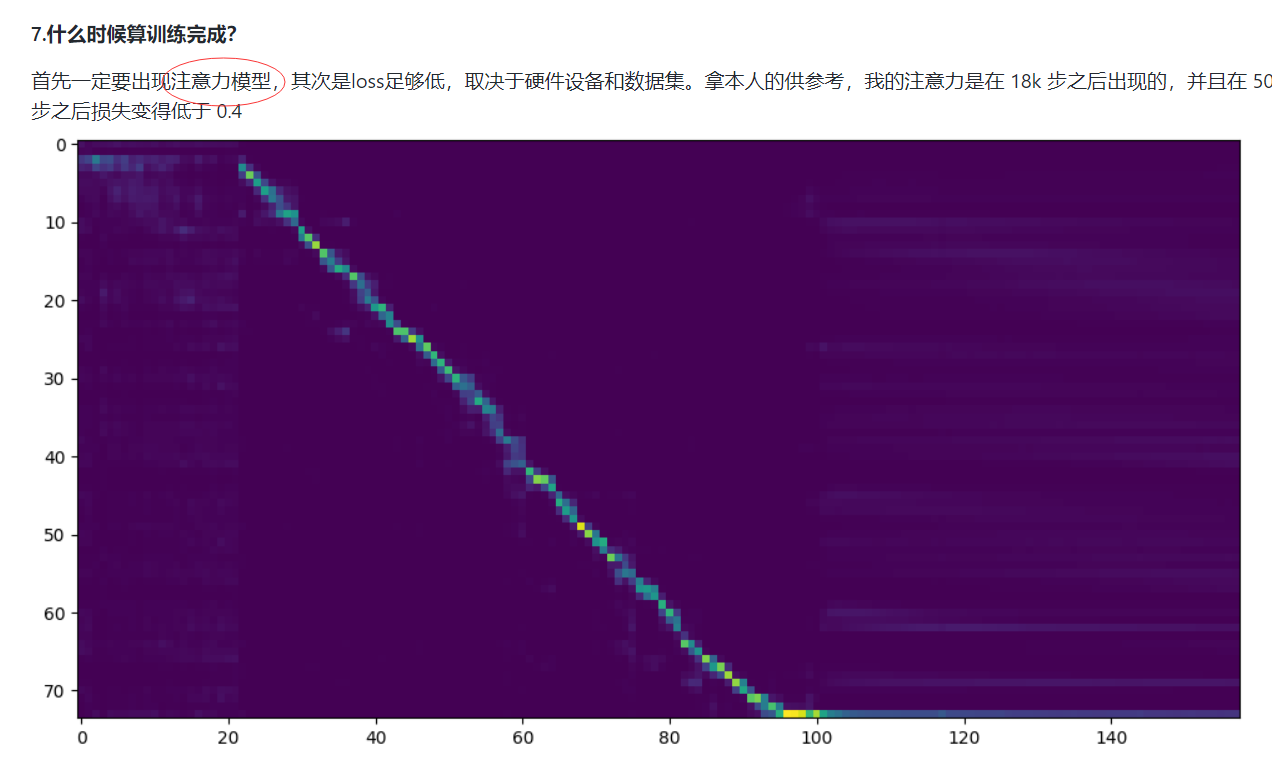

对于训练教程中“一定要出现注意力模型”“出现一条明显斜线”产生疑惑,特地查阅了相关资料解答了此疑惑

二.参考链接

1.CSDN资料地址:深度学习中的注意力机制

2.知乎资料地址:kaldi学习 alignment的概念

3.推荐“跟李沐学AI”B站视频:65 注意力分数【动手学深度学习v2】

三.小结

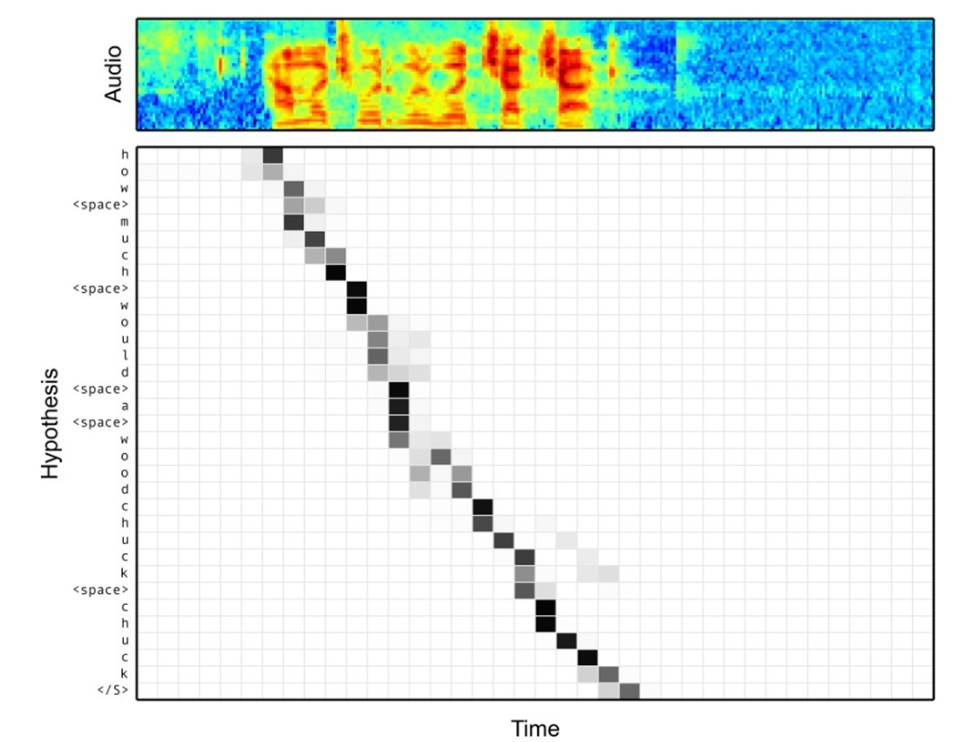

1.alignment(对齐)含义:输出与输入逐一对应、对齐(输出是输入的标签序列)。

2.输出对于输入形成了注意力分配概率分布。某个输出对某个输入分配到的注意力概率越大,颜色越深,说明该source-target pair已对齐。

3.

横坐标为Decoder timesteps,纵坐标为Encoder states(Encoder timesteps? 此处存疑)

4. 多头注意力就是对同样的Q, K, V求多次注意力,得到多个不同的output,再把这些不同的output连接起来得到最终的output。

5.一般地,在文本中与目标词距离较近的上下文词汇比距离较远的词汇更重要 。 因此 ,Duyu Tang 将位置信息 (location at tention)编码到注意力模型中

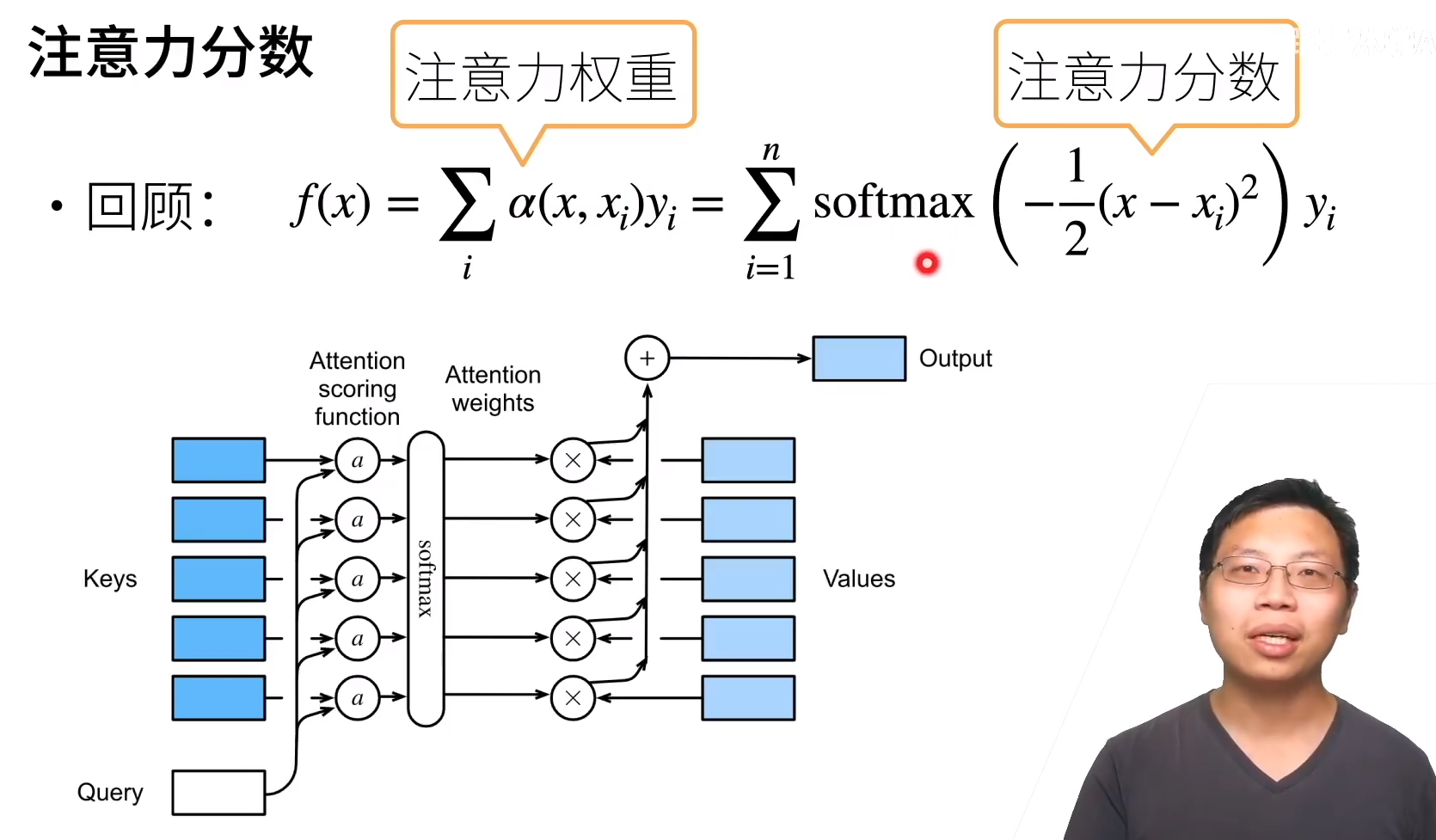

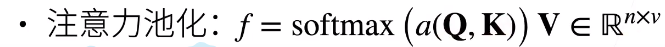

6.注意力机制过程图:

其实就是一个注意力池化过程:

浙公网安备 33010602011771号

浙公网安备 33010602011771号