爬虫学习-04

一、xpath的使用

html中选择标签,可以使用的通用方式

- css选择

- xpath选择

1.1介绍

XPath 即为XML路径语言(XML Path Language),它是一种用来确定XML文档中某部分位置的语言

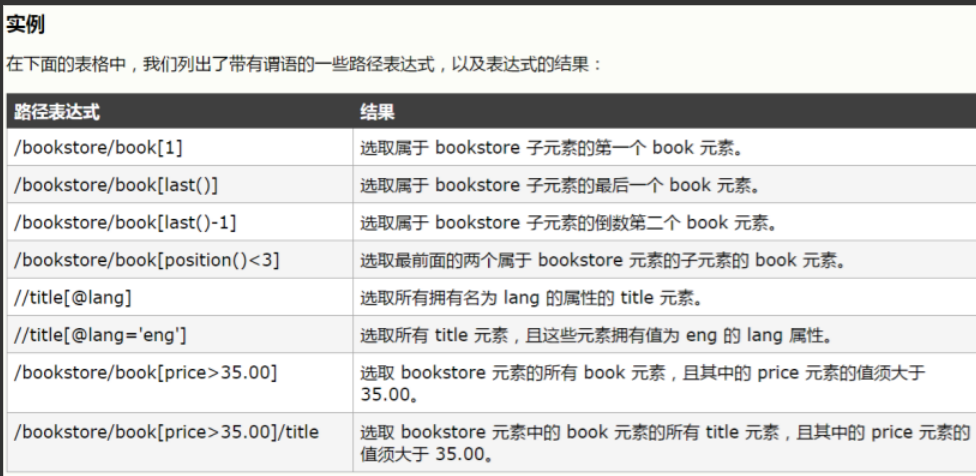

1.2语法的简单介绍

| 表达式 | 描述 |

|---|---|

| nodename(写个什么标签就拿什么标签) | 选取此节点的所有子节点(写个div标签就拿div标签,p标签就拿p标签) |

| / | 从当前节点选取直接子节点(html是个文档结构所以从根开始往下拿) |

| // | 从当前节点选取子孙节点 |

| . | 选取当前节点 |

| . . | 选取当前节点的父节点 |

| @ | 选取属性 |

拓展:

1.3小案例实践

两个记住掌握的

- 获取文本 text()

- 获取属性 @属性

doc='''

<html>

<head>

<base href='http://example.com/' />

<title>Example website</title>

</head>

<body>

<div id='images'>

<a href='image1.html' id='id_a'>Name: My image 1 <br/><img src='image1_thumb.jpg' /></a>

<a href='image2.html'>Name: My image 2 <br /><img src='image2_thumb.jpg' /></a>

<a href='image3.html'>Name: My image 3 <br /><img src='image3_thumb.jpg' /></a>

<a href='image4.html'>Name: My image 4 <br /><img src='image4_thumb.jpg' /></a>

<a href='image5.html' class='li li-item' name='items'>Name: My image 5 <br /><img src='image5_thumb.jpg' /></a>

<a href='image6.html' name='items'><span><h5>test</h5></span>Name: My image 6 <br /><img src='image6_thumb.jpg' /></a>

</div>

</body>

</html>

'''

from lxml import etree

html=etree.HTML(doc)

# html=etree.parse('search.html',etree.HTMLParser())

# 1 所有节点

# a=html.xpath('//*')

# 2 指定节点(结果为列表)

# a=html.xpath('//head')

# 3 子节点,子孙节点

# a=html.xpath('//div/a')

# a=html.xpath('//body/a') #无数据

# a=html.xpath('//body//a')

# 4 父节点

# a=html.xpath('//body//a[@href="image1.html"]/..')

# a=html.xpath('//body//a[1]/..')

# 也可以这样

# a=html.xpath('//body//a[1]/parent::*')

# a=html.xpath('//body//a[1]/parent::div')

# 5 属性匹配

# a=html.xpath('//body//a[@href="image1.html"]')

# 6 文本获取 text() ********

# a=html.xpath('//body//a[@href="image1.html"]/text()')

# 7 属性获取 ******

# a=html.xpath('//body//a/@href')

# a=html.xpath('//body//a/@id')

# # 注意从1 开始取(不是从0)

# a=html.xpath('//body//a[1]/@id')

# 8 属性多值匹配

# a 标签有多个class类,直接匹配就不可以了,需要用contains

# a=html.xpath('//body//a[@class="li"]')

# a=html.xpath('//body//a[@name="items"]')

# a=html.xpath('//body//a[contains(@class,"li")]')

# a=html.xpath('//body//a[contains(@class,"li")]/text()')

# 9 多属性匹配

# a=html.xpath('//body//a[contains(@class,"li") or @name="items"]')

# a=html.xpath('//body//a[contains(@class,"li") and @name="items"]/text()')

# 10 按序选择

# a=html.xpath('//a[2]/text()')

# a=html.xpath('//a[3]/@href')

# 取最后一个

# a=html.xpath('//a[last()]/@href')

# 位置小于3的

# a=html.xpath('//a[position()<3]/@href')

# 倒数第二个

# a=html.xpath('//a[last()-2]/@href')

# 11 节点轴选择

# ancestor:祖先节点

# 使用了* 获取所有祖先节点

# a=html.xpath('//a/ancestor::*')

# # 获取祖先节点中的div

# a=html.xpath('//a/ancestor::div')

# attribute:属性值

# a=html.xpath('//a[1]/attribute::*')

# a=html.xpath('//a[1]/attribute::href')

# child:直接子节点

# a=html.xpath('//a[1]/child::*')

# descendant:所有子孙节点

# a=html.xpath('//a[6]/descendant::*')

# following:当前节点之后所有节点

# a=html.xpath('//a[1]/following::*')

# a=html.xpath('//a[1]/following::*[1]/@href')

# following-sibling:当前节点之后同级节点

# a=html.xpath('//a[1]/following-sibling::*')

# a=html.xpath('//a[1]/following-sibling::a')

# a=html.xpath('//a[1]/following-sibling::*[2]')

a=html.xpath('//a[1]/following-sibling::*[2]/@href')

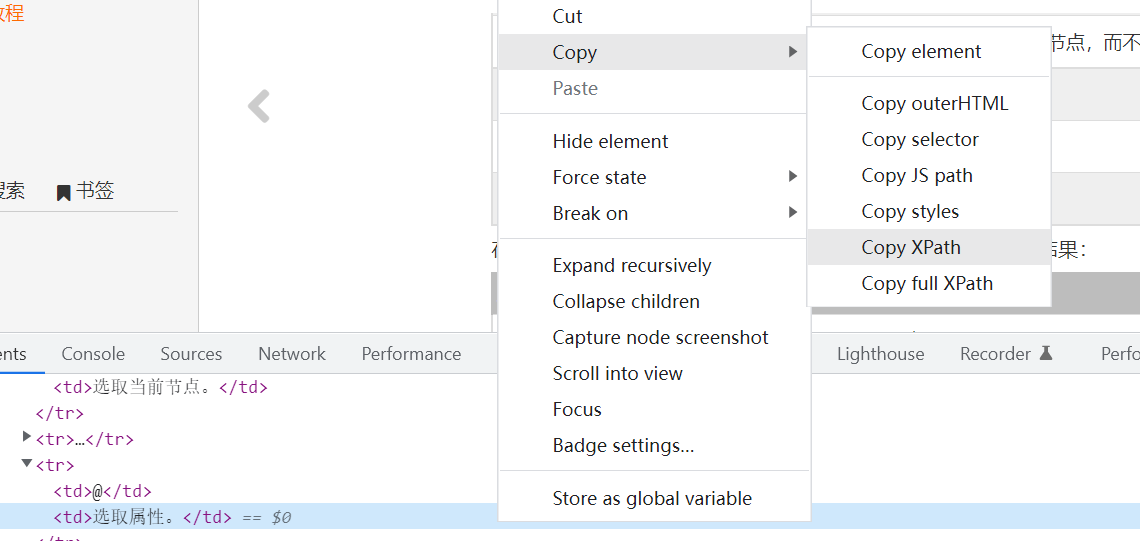

print(a)1.4终极大招

复制

- 像你要扒的地址发送一个

get请求,转成文本 - 用

xpath去选择 - 页面右键点检查——>控制台——>右键——>

Copy Xpath 粘贴到代码里

import requests

res=requests.get('https://www.w3cschool.cn/xpath/xpath-syntax.html')

print(res.text)

from lxml import etree

html=etree.HTML(res.text)

res=html.xpath('//*[@id="pro-mian"]/div[1]/div[3]/div[1]/table[3]/tbody/tr[2]/td[2]/text()')

print(res)二、selenium动作链

网站中有些按住鼠标,滑动的效果

- 滑动验证码

两种形式

测试拖动的网页:https://www.runoob.com/try/try.php?filename=jqueryui-api-droppable

形式一:说白了一次性滑过去

- 基于同一个动作链串行执行

actions是一个类,drag_and_drop是拖动与松开,从sourse拖动到target松开

actions=ActionChains(bro) #拿到动作链对象

actions.drag_and_drop(sourse,target) #把动作放到动作链中,准备串行执行

actions.perform()形式二:一点一点挪过去

- 不同的动作链,每次移动的位移都不同

click_and_hold鼠标点住的效果,perform点住不动- 然后终点位置的X轴减去起始位置的X轴

move_by_offset一次性挪几个位置

ActionChains(bro).click_and_hold(sourse).perform()

distance=target.location['x']-sourse.location['x']

track=0

while track < distance:

ActionChains(bro).move_by_offset(xoffset=2,yoffset=0).perform()

track+=2整体代码

- 中间执行可能出现的问题:你的谷歌浏览器驱动不是最新的,去国内镜像站下载为最新的即可

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver import ActionChains

import time

bro = webdriver.Chrome(executable_path='./chromedriver.exe')

bro.get('http://www.runoob.com/try/try.php?filename=jqueryui-api-droppable')

bro.implicitly_wait(10)

try:

bro.switch_to.frame('iframeResult') ##切换到iframeResult

sourse = bro.find_element(by=By.ID, value='draggable')

target = bro.find_element(by=By.ID, value='droppable')

# 方式一:基于同一个动作链串行执行

# actions=ActionChains(bro) #拿到动作链对象

# actions.drag_and_drop(sourse,target) #把动作放到动作链中,准备串行执行

# actions.perform()

# 方式二:不同的动作链,每次移动的位移都不同

ActionChains(bro).click_and_hold(sourse).perform()

distance=target.location['x']-sourse.location['x']

print('目标距离源的x轴距离:',distance)

track=0

while track < distance:

ActionChains(bro).move_by_offset(xoffset=2,yoffset=0).perform()

track+=2

ActionChains(bro).release().perform()

time.sleep(10)

except Exception as e:

print(e)

finally:

bro.close()三、自动登录铁路12306

- 进入铁路12306网站检查获取账号、密码输入框,后端输入账号、密码。睡个3秒钟

- 找到登录按钮

- 粘贴滑块标签

- 鼠标点住、滑动

- 12306检测到了我们使用了selenium控制了浏览器,所以它的滑块出不来,用了个

options两行代码来去掉自动化控制的提示

代码演示

from selenium import webdriver

from selenium.webdriver.common.by import By

import time

from selenium.webdriver import ActionChains

from selenium.webdriver.chrome.options import Options

options = Options()

options.add_argument("--disable-blink-features=AutomationControlled") # 去掉自动化控制的提示

bro = webdriver.Chrome(executable_path='./chromedriver.exe', options=options)

bro.get('https://kyfw.12306.cn/otn/resources/login.html')

bro.maximize_window()

# 12306检测到了我们使用了selenium控制了浏览器,所以它的滑块出不来

bro.implicitly_wait(10)

try:

username = bro.find_element(by=By.ID, value='J-userName')

username.send_keys('') # 放账号

password = bro.find_element(by=By.ID, value='J-password')

password.send_keys('') # 放密码

time.sleep(3)

btn = bro.find_element(by=By.ID, value='J-login')

btn.click()

span = bro.find_element(by=By.ID, value='nc_1_n1z')

ActionChains(bro).click_and_hold(span).perform() # 鼠标点住

ActionChains(bro).move_by_offset(xoffset=300, yoffset=0).perform() # 滑动

time.sleep(10)

except Exception as e:

print(e)

finally:

bro.close()四、打码平台使用

咱们把验证码图片发给第三方,第三方帮咱们解决,我们只需要用钱就可以了

用了个网站:超级鹰 http://www.chaojiying.com/

- 注册

软件开发商

代码解析

- 老规矩请求、报错信息,获取用户名、密码、验证码

- 截取网站整张图片

bro.save_screenshot - 然后把验证码图片抠出来用

pillow专门做图片处理的 - 拿到图片的img标签,拿到图片的

location:位置和size:大小,打印位置打印大小。 - 拿到图片的起始点X轴和Y轴,拿到终止点的X轴和Y轴

- 打开、抠图、截出来的小图save保存起来

- 使用超级鹰破解(他给的那一坨代码)

代码演示

import time

from selenium import webdriver

from selenium.webdriver.common.by import By

from chaojiying import ChaojiyingClient

from PIL import Image

bro = webdriver.Chrome(executable_path='./chromedriver.exe')

bro.get('http://www.chaojiying.com/apiuser/login/')

bro.implicitly_wait(10)

bro.maximize_window()

try:

username = bro.find_element(by=By.XPATH, value='/html/body/div[3]/div/div[3]/div[1]/form/p[1]/input')

password = bro.find_element(by=By.XPATH, value='/html/body/div[3]/div/div[3]/div[1]/form/p[2]/input')

code = bro.find_element(by=By.XPATH, value='/html/body/div[3]/div/div[3]/div[1]/form/p[3]/input')

btn = bro.find_element(by=By.XPATH, value='/html/body/div[3]/div/div[3]/div[1]/form/p[4]/input')

username.send_keys('306334678')

password.send_keys('lqz123')

# 获取验证码:

#1 整个页面截图

bro.save_screenshot('main.png')

# 2 使用pillow,从整个页面中截取出验证码图片 code.png

img = bro.find_element(By.XPATH, '/html/body/div[3]/div/div[3]/div[1]/form/div/img')

location = img.location

size = img.size

print(location)

print(size)

# 使用pillow扣除大图中的验证码

img_tu = (int(location['x']), int(location['y']), int(location['x'] + size['width']), int(location['y'] + size['height']))

# # 抠出验证码

# #打开

img = Image.open('./main.png')

# 抠图

fram = img.crop(img_tu)

# 截出来的小图

fram.save('code.png')

# 3 使用超级鹰破解

chaojiying = ChaojiyingClient('306334678', 'lqz123', '937234') # 用户中心>>软件ID 生成一个替换 96001

im = open('code.png', 'rb').read() # 本地图片文件路径 来替换 a.jpg 有时WIN系统须要//

print(chaojiying.PostPic(im, 1902)) # 1902 验证码类型 官方网站>>价格体系 3.4+版 print 后要加()

res_code=chaojiying.PostPic(im, 1902)['pic_str']

code.send_keys(res_code)

time.sleep(5)

btn.click()

time.sleep(10)

except Exception as e:

print(e)

finally:

bro.close()五、使用selenium爬取JD商品信息

- 先

def spider使用当前下的驱动、扒JD的网址、隐式等待10秒 - 找到JD输入框启动摁下

ENTER回车,跳到get_goods(driver)函数 - 执行

get_goods(driver)函数,find_elements找到所有的li标签 - for循环在li标签里找商品名称、价格、链接、图片、评论取出文本内容

- 如果img没有值拿

data-lazy-img - 找到最下面click下一页,递归再调用

代码演示

from selenium import webdriver

from selenium.webdriver.common.by import By # 按照什么方式查找,By.ID,By.CSS_SELECTOR

import time

from selenium.webdriver.common.keys import Keys

def get_goods(driver):

try:

goods = driver.find_elements(by=By.CLASS_NAME, value='gl-item')

for good in goods:

name = good.find_element(by=By.CSS_SELECTOR, value='.p-name em').text

price = good.find_element(by=By.CSS_SELECTOR, value='.p-price i').text

commit = good.find_element(by=By.CSS_SELECTOR, value='.p-commit a').text

url = good.find_element(by=By.CSS_SELECTOR, value='.p-name a').get_attribute('href')

img = good.find_element(by=By.CSS_SELECTOR, value='.p-img img').get_attribute('src')

if not img:

img ='https://'+ good.find_element(by=By.CSS_SELECTOR, value='.p-img img').get_attribute('data-lazy-img')

print('''

商品名字:%s

商品价格:%s

商品链接:%s

商品图片:%s

商品评论:%s

''' % (name, price, url, img, commit))

button = driver.find_element(by=By.PARTIAL_LINK_TEXT, value='下一页')

button.click()

time.sleep(1)

get_goods(driver)

except Exception as e:

print(e)

def spider(url, keyword):

driver = webdriver.Chrome(executable_path='./chromedriver.exe')

driver.get(url)

driver.implicitly_wait(10) # 使用隐式等待

try:

input_tag = driver.find_element(by=By.ID, value='key')

input_tag.send_keys(keyword)

input_tag.send_keys(Keys.ENTER)

get_goods(driver)

finally:

driver.close()

if __name__ == '__main__':

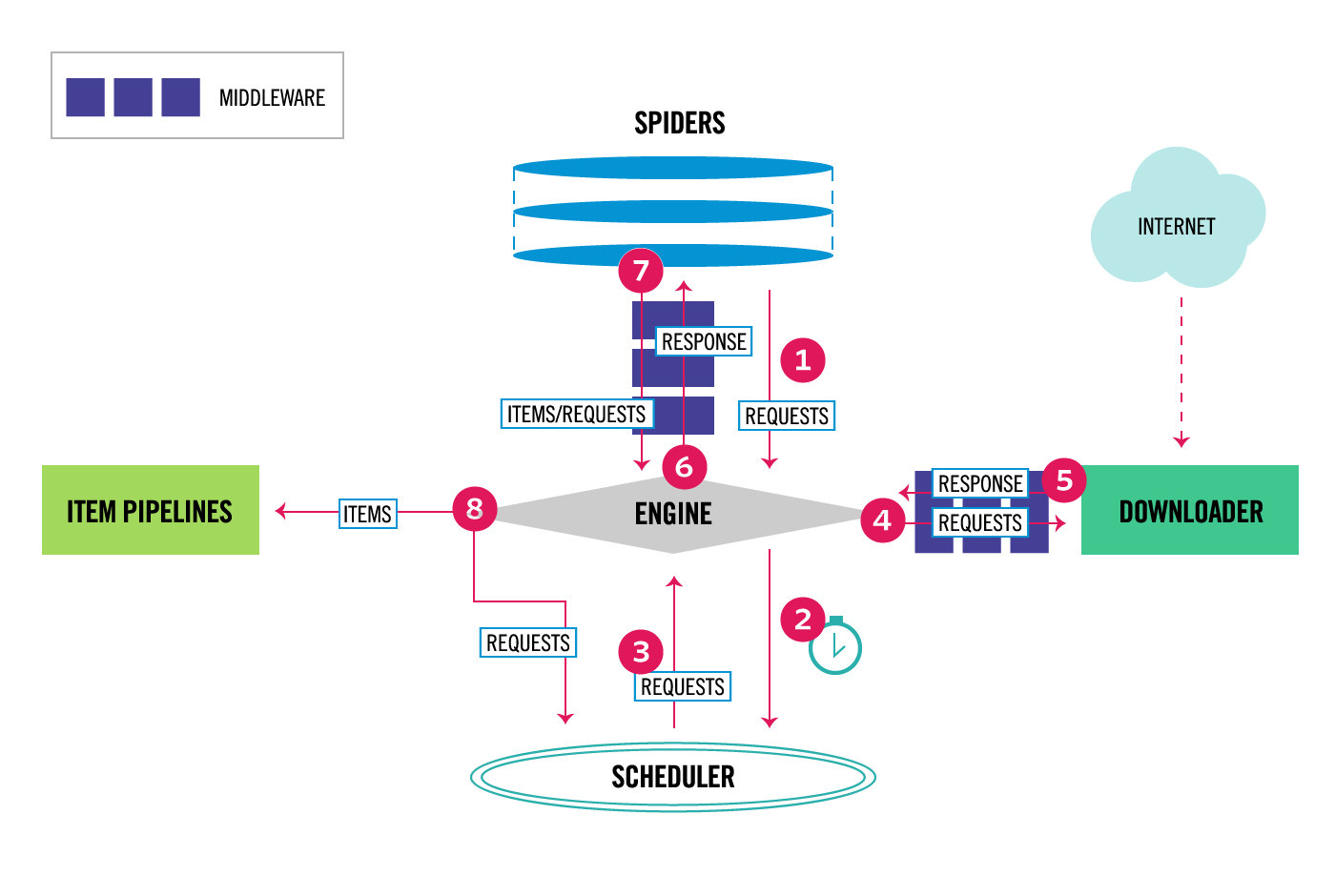

spider('https://www.jd.com/', keyword='库里球衣')六、scrapy介绍

前面学的都是模块,做专业的爬虫,可以使用框架 (django:web) scrapy:爬虫框架

- 做爬虫用的东西,都封装好了,只需要在固定的位置写固定的代码即可

scrapy 号称爬虫界的djagno

- django大而全:做web相关的它都用

- scrapy大而全:做爬虫的,它都用

介绍

Scrapy一个开源和协作的框架,其最初是为了页面抓取 (更确切来说, 网络抓取 )所设计的,使用它可以以快速、简单、可扩展的方式从网站中提取所需的数据。但目前Scrapy的用途十分广泛,可用于如数据挖掘、监测和自动化测试等领域,也可以应用在获取API所返回的数据或者通用的网络爬虫。

安装 scrapy

-mac,linux:

pip3 install scrapy

-win:看人品

-pip3 install scrapy人品不好(其实是有些补丁没有打)装不上的按下列操作

- 安装了wheel,以后就可以用

某某.whl的文件 - 装不上的原因是因为

twisted的问题

1、pip3 install wheel #安装后,便支持通过wheel文件安装软件 xx.whl

2、pip3 install lxml

3、pip3 install pyopenssl

4、下载并安装pywin32:https://sourceforge.net/projects/pywin32/files/pywin32/

5、下载twisted的wheel文件:http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

6、执行pip3 install 下载目录\Twisted-17.9.0-cp36-cp36m-win_amd64.whl

7、pip3 install scrapy释放出scrapy 可执行文件

- 以后使用这个创建爬虫项目——>

跟之前用django-admin创建django项目一样

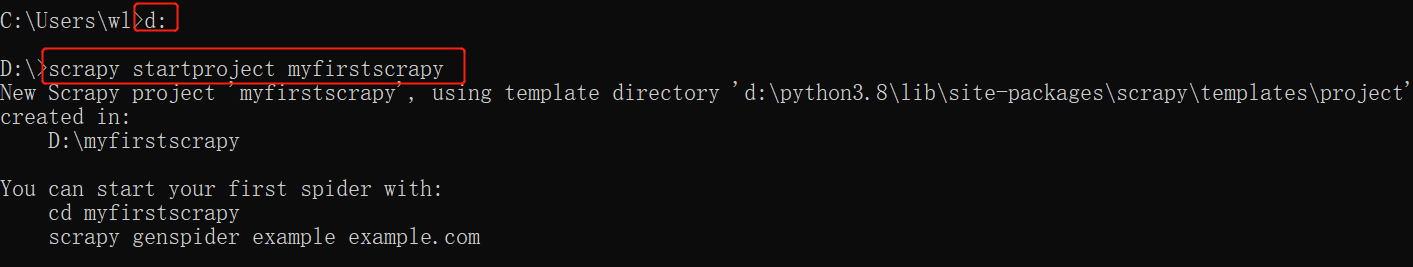

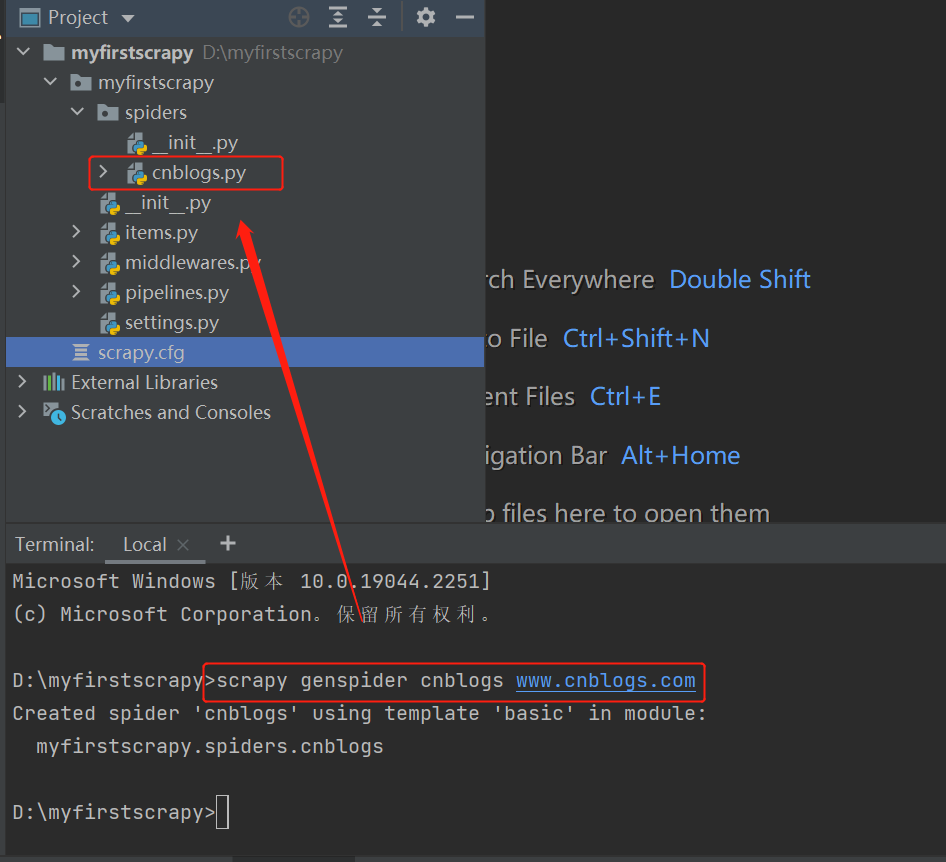

创建爬虫项目

- scrapy startproject myfirstscrapy (切到D盘创建了个爬虫项目 )

创建爬虫类似于[django创建app] 一个项目下可以有多个爬虫 爬虫就是个py文件

- scrapy genspider cnblogs www.cnblogs.com

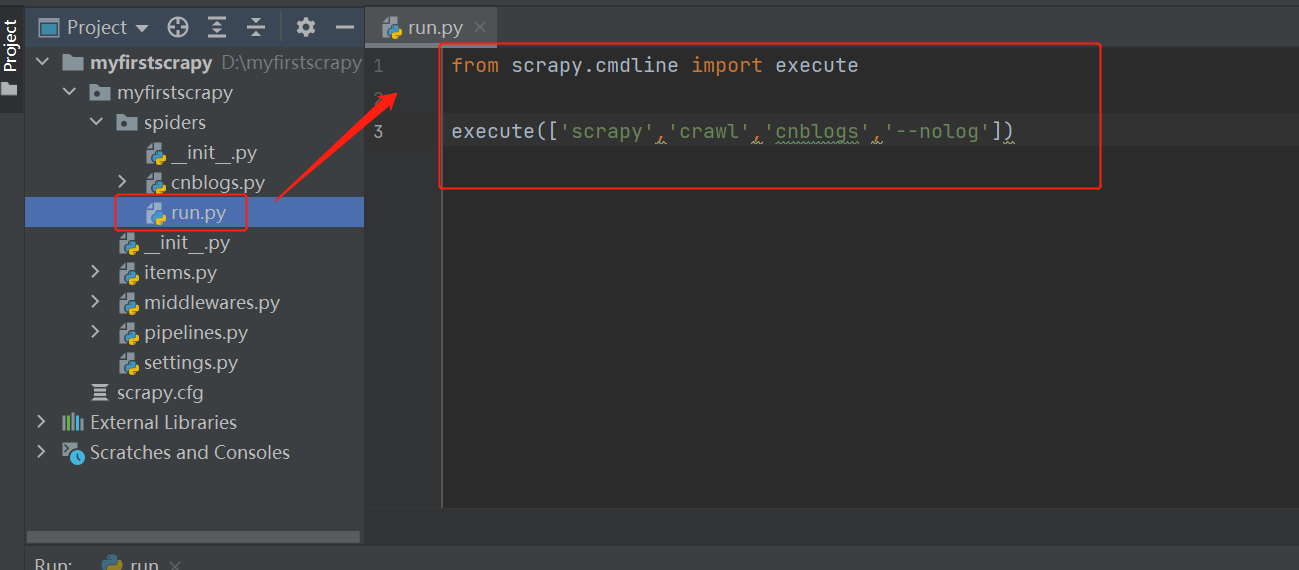

启动爬虫——不打印日志

- scrapy crawl cnblogs --nolog

pycharm中运行

- 新建run.py

- from scrapy.cmdline import execute

- execute(['scrapy', 'crawl', 'cnblogs','--nolog'])

浙公网安备 33010602011771号

浙公网安备 33010602011771号