LLM学习(5)——系统评估与优化

5.1 如何评估 LLM 应用

5.1.1 验证评估的一般思路

通过不断寻找Bad Case并进行针对性优化,将这些案例逐步加入验证集,形成一个具有一定样本数量的验证集。针对这种验证集,逐个进行评估变得不切实际,需要一种自动评估方法来对整体性能进行评估。验证迭代是构建以LLM为核心的应用程序的重要步骤,通过不断寻找Bad Case、调整Prompt或优化检索性能,推动应用程序达到目标性能和准确性。接下来,将介绍大模型开发评估的几种方法,并简要介绍从少数Bad Case针对性优化到整体自动评估的一般思路。

5.1.2大模型评估方法

人工评估的一般思路

准则一 量化评估

为保证很好地比较不同版本的系统性能,量化评估指标是非常必要的。我们应该对每一个验证案例的回答都给出打分,最后计算所有验证案例的平均分得到本版本系统的得分。量化的量纲可以是05,也可以是0100,可以根据个人风格和业务实际情况而定。

量化后的评估指标应当有一定的评估规范,例如在满足条件 A 的情况下可以打分为 y 分,以保证不同评估员之间评估的相对一致。

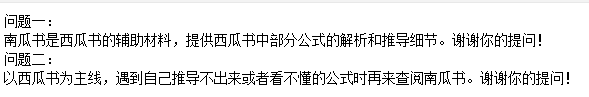

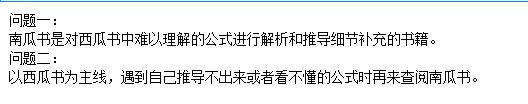

以下是对于问题

- 南瓜书和西瓜书有什么关系?

- 应该如何使用南瓜书?

两个模板的结果

以下是相应的代码[注:相对于前文这里我更改了嵌入的方式因为Gemini的嵌入实在太差了,还有pdf的导入方式,我用PyMuPDFLoader替代了PyPDFLoader因为PyPDFLoader输出会出现乱码]

from langchain.prompts import PromptTemplate

from langchain.chains import RetrievalQA

template_v1 = """使用以下上下文来回答最后的问题。如果你不知道答案,就说你不知道,不要试图编造答

案。最多使用三句话。尽量使答案简明扼要。总是在回答的最后说“谢谢你的提问!”。

{context}

问题: {question}

"""

QA_CHAIN_PROMPT = PromptTemplate(input_variables=["context","question"],

template=template_v1)

qa_chain = RetrievalQA.from_chain_type(llm,

retriever=vectordb.as_retriever(),

return_source_documents=True,

chain_type_kwargs={"prompt":QA_CHAIN_PROMPT})

print("问题一:")

question = "南瓜书和西瓜书有什么关系?"

result = qa_chain({"query": question})

print(result["result"])

print("问题二:")

question = "应该如何使用南瓜书?"

result = qa_chain({"query": question})

print(result["result"])

template_v2 = """使用以下上下文来回答最后的问题。如果你不知道答案,就说你不知道,不要试图编造答

案。你应该使答案尽可能详细具体,但不要偏题。如果答案比较长,请酌情进行分段,以提高答案的阅读体验。

{context}

问题: {question}

有用的回答:"""

QA_CHAIN_PROMPT = PromptTemplate(input_variables=["context","question"],

template=template_v2)

qa_chain = RetrievalQA.from_chain_type(llm,

retriever=vectordb.as_retriever(),

return_source_documents=True,

chain_type_kwargs={"prompt":QA_CHAIN_PROMPT})

print("问题一:")

question = "南瓜书和西瓜书有什么关系?"

result = qa_chain({"query": question})

print(result["result"])

print("问题二:")

question = "应该如何使用南瓜书?"

result = qa_chain({"query": question})

print(result["result"])

我们可以看出来,对于问题1模板A有稍微好一些的结果,对于问题二两者结果一致,所以这种评估方式其实并不推荐,首先难以确定哪个结果更好,其次需要两个问题的答案都更好非常困难。

多维评估

对于大模型的评估,可以从多个维度出发,包括知识查找正确性、回答一致性、回答幻觉比例、回答正确性、逻辑性、通顺性和智能性等方面进行评估。每个维度都可以设计相应的评估指标,并在0~1之间进行打分,以综合评估系统的性能表现。同时,评估指标应当结合业务实际,量化评估和多维评估相结合,全面评估系统的性能表现。

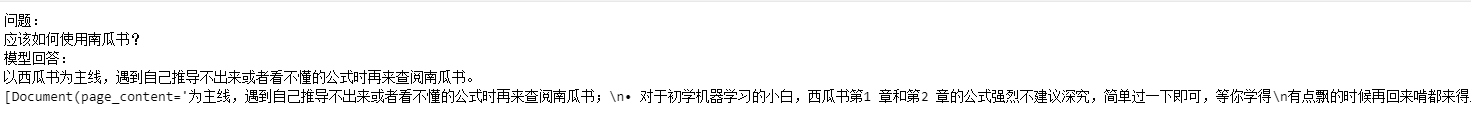

print("问题:")

question = "应该如何使用南瓜书?"

print(question)

print("模型回答:")

result = qa_chain({"query": question})

print(result["result"])

print(result["source_documents"])

对答案进行多维打分

简单自动评估

构造客观题

构造如下客观题

prompt_template = '''

请你做如下选择题:

题目:南瓜书的作者是谁?

选项:A 周志明 B 谢文睿 C 秦州 D 贾彬彬

你可以参考的知识片段:

~~

{}

~~

请仅返回选择的选项

如果你无法做出选择,请返回空

'''

我们规定如下打分策略:全选1分,漏选0.5分,错选不选不得分(错选也可以设为扣1分)这样我们就可以实现快速的评估

计算相似度

构造标准答案并计算回答与标准答案相似度

使用大模型进行评估

构造 Prompt Engineering 让大模型充当一个评估者的角色,从而替代人工评估的评估员;同时大模型可以给出类似于人工评估的结果,因此可以采取人工评估中的多维度量化评估的方式,实现快速全面的评估。

# 使用第二章讲过的 OpenAI 原生接口

from openai import OpenAI

client = OpenAI(

# This is the default and can be omitted

api_key=os.environ.get("OPENAI_API_KEY"),

)

def gen_gpt_messages(prompt):

'''

构造 GPT 模型请求参数 messages

请求参数:

prompt: 对应的用户提示词

'''

messages = [{"role": "user", "content": prompt}]

return messages

def get_completion(prompt, model="gpt-3.5-turbo", temperature = 0):

'''

获取 GPT 模型调用结果

请求参数:

prompt: 对应的提示词

model: 调用的模型,默认为 gpt-3.5-turbo,也可以按需选择 gpt-4 等其他模型

temperature: 模型输出的温度系数,控制输出的随机程度,取值范围是 0~2。温度系数越低,输出内容越一致。

'''

response = client.chat.completions.create(

model=model,

messages=gen_gpt_messages(prompt),

temperature=temperature,

)

if len(response.choices) > 0:

return response.choices[0].message.content

return "generate answer error"

question = "应该如何使用南瓜书?"

result = qa_chain({"query": question})

answer = result["result"]

knowledge = result["source_documents"]

response = get_completion(prompt.format(question, answer, knowledge))

response

BULE 打分

n-gram:指一个语句里面连续的n个单词组成的片段

精确度:指Candidate(生成模型的预测文本)语句里面的n-gram在所有Reference(标准文本)语句里面出现的概率

modified n-gram recision:\(Modified\ n-gram\ precision=\frac{Number of total generated n-grams}{Number of matching n-grams}\)

- Number of matching n-grams表示生成文本中与参考文本匹配的n-gram序列数量;

- Number of total generated n-grams表示生成文本中总的n-gram序列数量。

BP:

当待评价译文同任意一个参考译文长度相等或超过参考译文长度时,BP值为1,当待评价译文的长度较短时加一个权重

\(\left.BP=\left\{\begin{array}{ll}1&if&c>r\\e^{1-r/c}&if&c\leq r\end{array}\right.\right.\)

然后我们就可以计算分数

\(Bleu=BP\cdot\exp(\sum_{n=1}^Nw_n\log p_n)\)