吴恩达机器学习--单变量线性回归【学习笔记】

说明:本文是本人用于记录学习吴恩达机器学习的学习笔记,如有不对之处请多多包涵.

作者:爱做梦的90后

一、模型的描述:

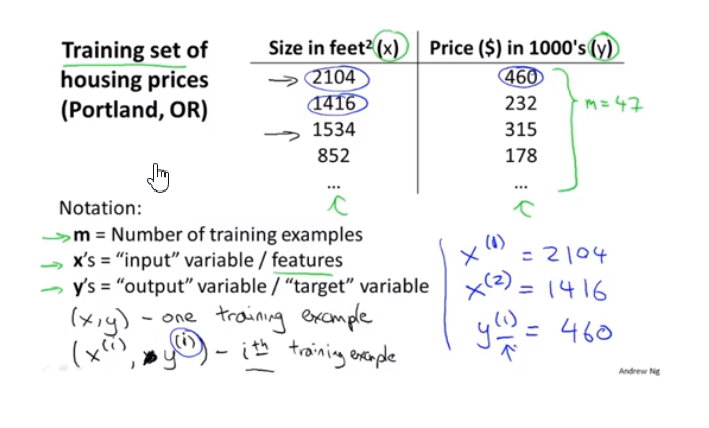

下面的这张图片是对于课程中一些符号的基本的定义:

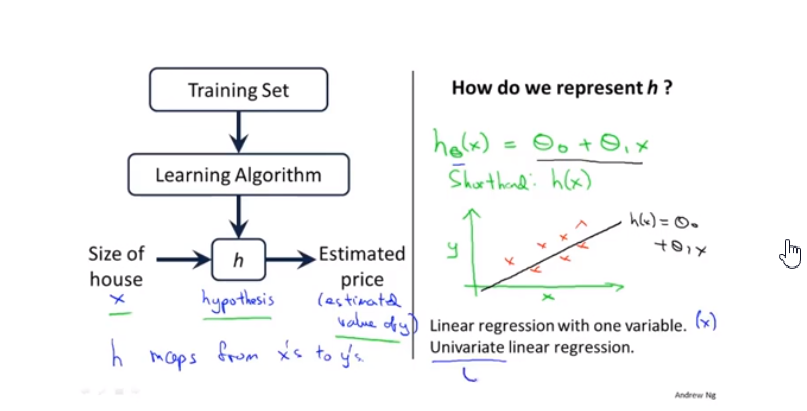

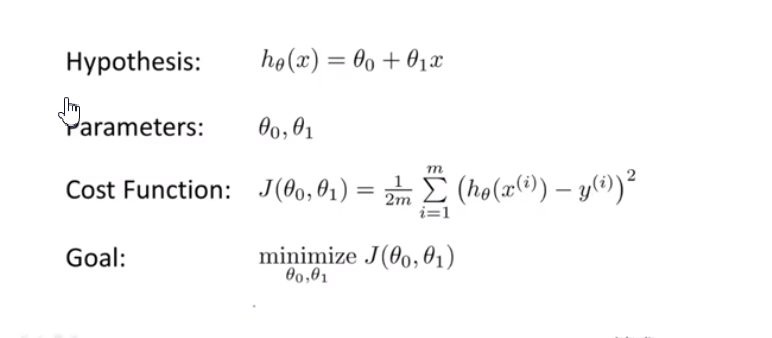

吴老师列举的最简单的单变量线性回归方程:

二、代价函数

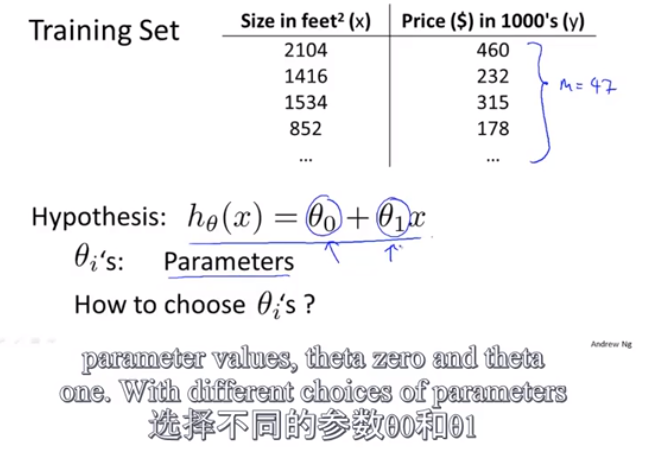

这节课的主要目标是如何选择这个模型的两个参数

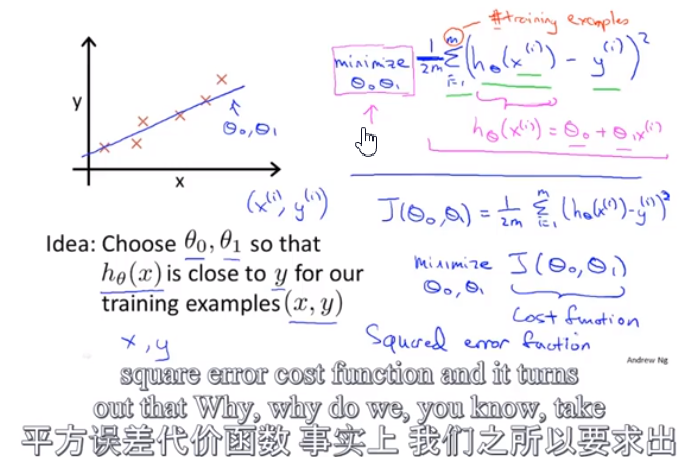

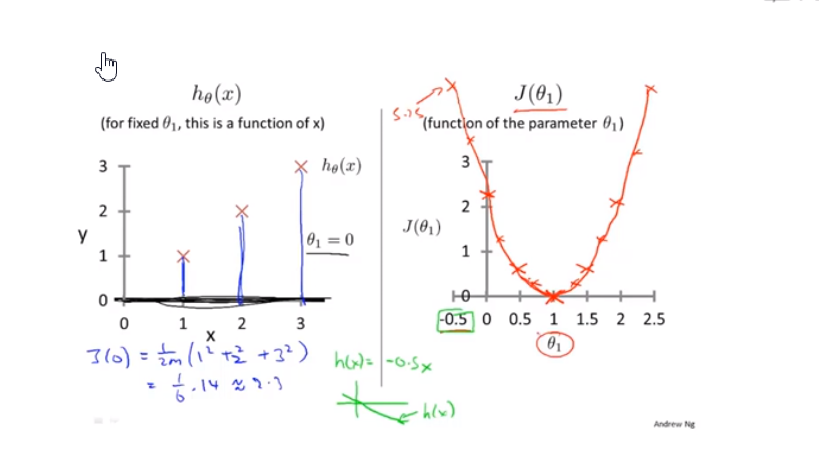

下图是吴老师的分析怎么将模型转化求解需要的两个参数:

h(x)的函数两个参数O0设置为0,将函数设置为过原点的直线,之后斜率取不同的值,代入公式,绘制出下图右边的代价函数的图形。(看了这一节的课程感觉回到了高中时代,当年的数学好像就是有这样的求解)

这次课程的主要目标是找到最优化的代价函数

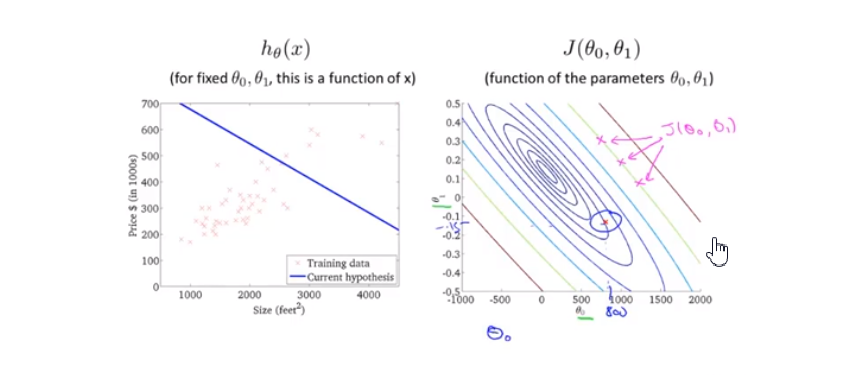

h(x)的两个参数取不同的数值,绘制j函数3D模式图如下:

使用等高线图绘制如下:

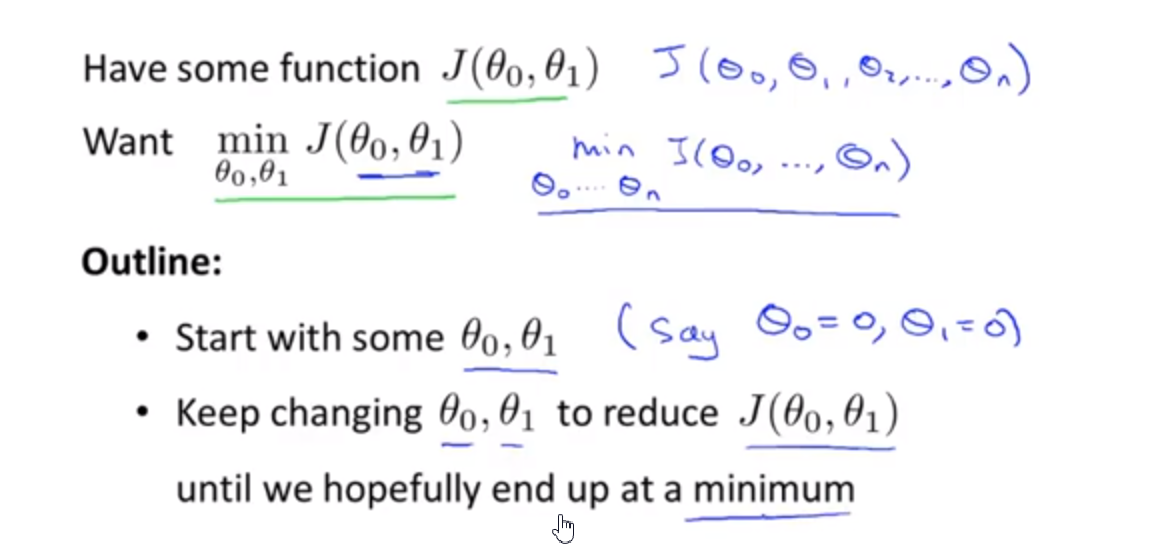

使用梯度下降算法来使我们要求解的j函数最小化,

梯度下降算法定义见下图:α是学习率控制,梯度下降的速度,值越大下降的速度越快,需要注意的一点是θ0,θ1这两个参数在更新的时候需要同时更新。

觉得不错,就给我点小支持吧,蟹蟹