逻辑回归(机器学习实战 第五章)

2023-05-05 23:54 张紫荣 阅读(61) 评论(0) 收藏 举报Logistic Regression: 用一条直线对样本数据点进行拟合(该线称为最佳拟合直线), 这个拟合过种就称作回归. 利用Logistic回归进行分类的主要思想是: 根据现有数据对分类边界线建立回归公式, 以此进行分类.

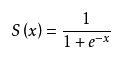

Sigmoid函数:

需要的函数应该是, 接受所有的输入然后预测出类别. 例如, 在两个分类的情况下, 函数输出0或1. 数字上, 通常使用Sigmoid函数:

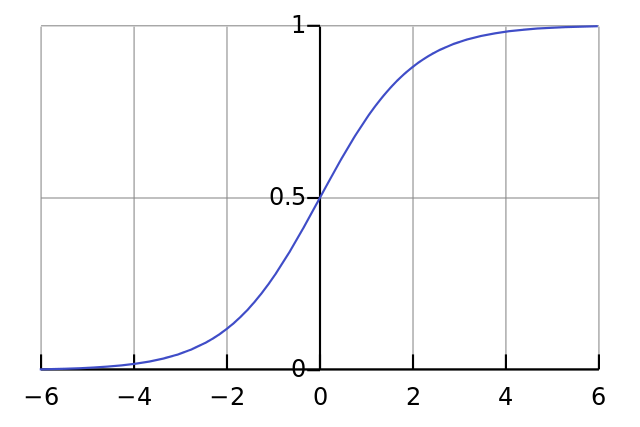

Sigmoid函数的图形如下:

为了实现Logistic回归分类器, 可以在每个特征上都乘以一个回归系数,然后把所有结果值相同,将这个总和代入Sigmoid函数, 进行得到一个0-1之间的数值, 任何大于0.5的数据被分入1类, 小于0.5的数据被归入0类.

最优化方法的最佳回归系统确定:

Sigmoid函数的输入记为z, 由下面公式得出:

z = w0x0 + w1x1 + w2x2 + ... + wnxn

如果使用向量的写法, 该公式可写成 z= WTx, 这两个数值向量对应元素相乘然后全部加起来即得到z值, 其中向量x是分类器的输入数据, 向量w也就是我们要找到的最佳参数, 从而使得分类器尽可能地精确.

- 梯度上升法: 要找到某函数的最大值, 最好的方法是沿着该函数的梯度方向探寻,从P0开始, 计算该点的梯度, 函数就根据梯率移动到下一点P1.在P1点, 梯度再次被重新计算,并沿新的梯度方向移动到P2, 如此循环迭代, 直到满足停止条件.

- 梯度下降算法: 梯度上升算法用来求函数的最大值, 而梯度下降算法用来求函数的最小值.

- 随机梯度上升: 一种改进方法是一次公用一个样本点来更新回归系数

Logistic 回归的本质是:假设数据服务Logistic分布, 使用极大似然估计做参数的估计.

"回归“一词源于最佳拟合, 表示要找到最佳拟合参数集.

有监督的统计学方法,主要用于分类.

- 输入可以是连续的,但输出是离散的,即只有有限的多个输出值

总结:

逻辑回归假设数据服从伯努利分布,在线性回归的基础上,套了一个二分类的Sigmoid函数,使用极大似然法来推导出损失函数,用梯度下降法优化损失函数的一个判别式的分类算法。

场景:

- 用于分类场景,尤其是二分类是可以使用逻辑回归

- 不要求自变量和因变量是线性关系

浙公网安备 33010602011771号

浙公网安备 33010602011771号