集群调度

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。听起来非常简单,但有很多要考虑的问题:

-

公平:如何保证每个节点都能被分配资源

-

资源高效利用:集群所有资源最大化被使用

-

效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

-

灵活:允许用户根据自己的需求控制调度的逻辑

Sheduler 是作为单独的程序运行的,启动之后会一直坚挺(持续连接) API Server,获取 PodSpec.NodeName 为空的 pod(如果这个字段不为空的话,不需要被Sheduler调度),对每个 pod 都会创建一个 binding,表明该 pod 应该放到哪个节点上

调度过程

调度分为几个部分:首先是过滤掉不满足条件的节点,这个过程称为 predicate( [ˈpredɪkeɪt]) ;然后对通过的节点按照优先级排序,这个是 priority ( [praɪˈɒrəti]);最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误

Predicate 有一系列的算法可以使用:

-

PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源 -

PodFitsHost:如果 pod 指定了 NodeName,检查节点名称是否和 NodeName 匹配 -

PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突 -

PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点 -

NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程: 按照优先级大小对节点排序

优先级由一系列键值对组成,键是该优先级项的名称,值是它的权重(该项的重要性)。这些优先级选项包括:

-

LeastRequestedPriority:通过计算 CPU 和 Memory 的使用率来决定权重,使用率越低权重越高。换句话

说,这个优先级指标倾向于资源使用比例更低的节点

-

BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个应该和上面的一起

使用,不应该单独使用

-

ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高

通过算法对所有的优先级项目和权重进行计算,得出最终的结果

自定义调度器

除了 kubernetes 自带的调度器,你也可以编写自己的调度器。通-过 spec:schedulername 参数指定调度器的名字,可以为 pod 选择某个调度器进行调度。比如下面的 pod 选择 my-scheduler 进行调度,而不是默认的default-scheduler:

apiVersion

节点亲和性

pod.spec.nodeAffinity([əˈfɪnəti])

-

preferredDuringSchedulingIgnoredDuringExecution:软策略

(如果有的话是最好的,没有也无所谓)

-

requiredDuringSchedulingIgnoredDuringExecution:硬策略

(必须要有)

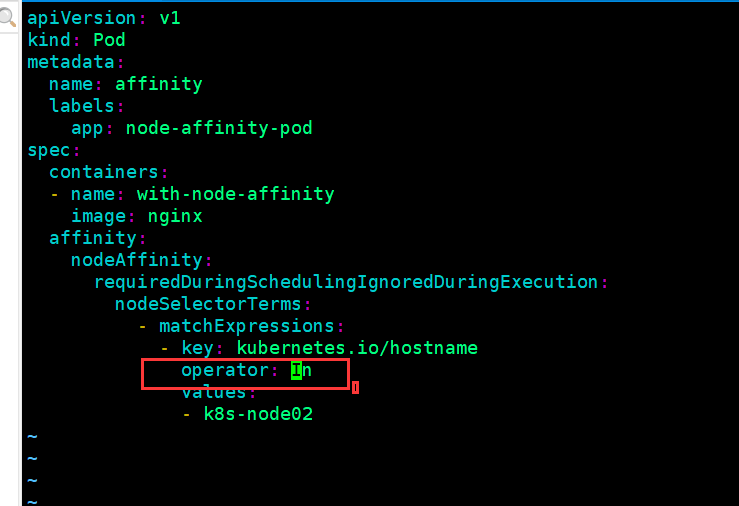

requiredDuringSchedulingIgnoredDuringExecution

apiVersion

[root@k8s-master01 ~]# kubectl get node --show-labels

NAME STATUS ROLES AGE VERSION LABELS

k8s-master01

Ready control-plane,master 15d v1.23.6

beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=k8s-master01,kubernetes.io/os=linux,node-role.kubernetes.io/control-plane=,node-role.kubernetes.io/master=,node.kubernetes.io/exclude-from-external-load-balancers=

k8s-node01

Ready <none> 15d v1.23.6

beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=k8s-node01,kubernetes.io/os=linux

k8s-node02

Ready <none> 15d v1.23.6

beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=k8s-node02,kubernetes.io/os=linux

[root@k8s-master01 ~]#

[root@k8s-master01 ~]# mkdir affinity

[root@k8s-master01 ~]# cd affinity/

[root@k8s-master01 affinity]# vim pod1.yaml

[root@k8s-master01 affinity]# kubectl create -f pod1.yaml

pod/affinity created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 1/1 Running 0 3s 10.244.1.78 k8s-node01 <none> <none>

[root@k8s-master01 affinity]#

(无论我们删除再启动,始终在node01上运行)

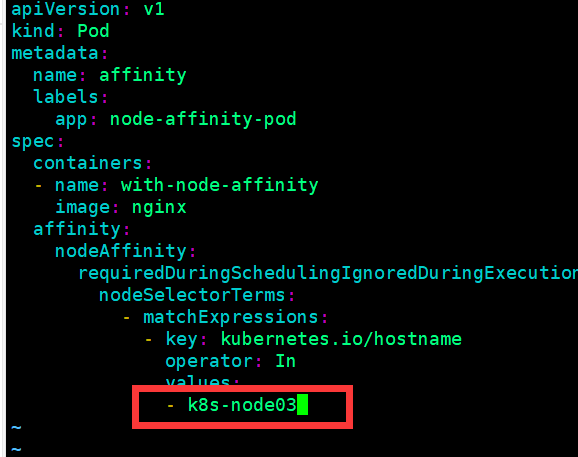

修改这个字段

[root@k8s-master01 affinity]# kubectl delete pod --all

pod "affinity" deleted

[root@k8s-master01 affinity]# vim pod1.yaml

[root@k8s-master01 affinity]# kubectl create -f pod1.yaml

pod/affinity created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 0/1 ContainerCreating 0 3s <none> k8s-node02 <none> <none>

[root@k8s-master01 affinity]#

再次修改字段

[root@k8s-master01 affinity]# kubectl create -f pod1.yaml

pod/affinity created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 0/1 Pending 0 4s <none> <none> <none> <none>

[root@k8s-master01 affinity]#

(这里就很好的说明了,因为我们没有node03,所以就一直是Pending状态!)

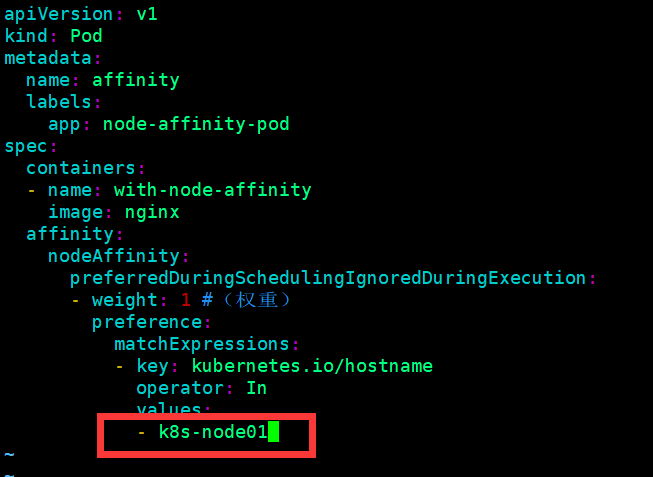

preferredDuringSchedulingIgnoredDuringExecution

apiVersion

[root@k8s-master01 affinity]# vim pod2.yaml

[root@k8s-master01 affinity]# kubectl create -f pod2.yaml

[root@k8s-master01 affinity]# kubectl delete pod --all

pod "affinity" deleted

[root@k8s-master01 affinity]# kubectl create -f pod2.yaml

pod/affinity created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 0/1 ContainerCreating 0 4s <none> k8s-node02 <none> <none>

[root@k8s-master01 affinity]#

(因为我们这里是软策略,有node03更好,没有也可以启动)

我们修改下字段:

[root@k8s-master01 affinity]# vim pod2.yaml

[root@k8s-master01 affinity]# kubectl delete pod --all

pod "affinity" deleted

[root@k8s-master01 affinity]# kubectl create -f pod2.yaml

pod/affinity created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

affinity 0/1 ContainerCreating 0 5s <none> k8s-node01 <none> <none>

[root@k8s-master01 affinity]#

(这回就在node01上面了!)

合体

(先满足硬策略后再满足软策略)

apiVersion

键值运算关系

-

In:label 的值在某个列表中

-

NotIn:label 的值不在某个列表中

-

Gt:label 的值大于某个值

-

Lt:label 的值小于某个值

-

Exists:某个 label 存在

-

DoesNotExist:某个 label 不存在

注:

如果nodeSelectorTerms 下面有多个选项的话,满足任何一个条件就可以了;如果matchExpressions 有多个选项的话,则必须同时满足这些条件才能正常调度

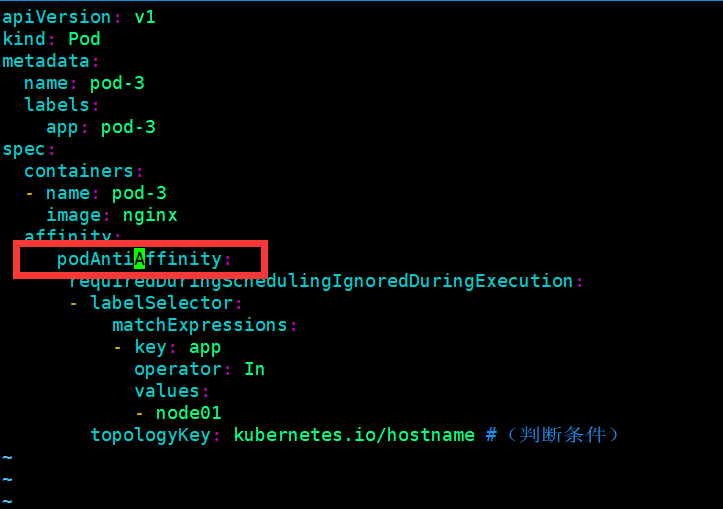

Pod 亲和性

pod.spec.affinity.podAffinity/podAntiAffinity

-

preferredDuringSchedulingIgnoredDuringExecution:软策略

-

requiredDuringSchedulingIgnoredDuringExecution:硬策略

apiVersion

[root@k8s-master01 affinity]# cat pod1.yaml

apiVersion: v1

kind: Pod

metadata:

name: node01

labels:

app: node01

spec:

containers:

- name: with-node-affinity

image: nginx

[root@k8s-master01 affinity]# kubectl create -f pod1.yaml

pod/node01 created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

node01 0/1 ContainerCreating 0 7s <none> k8s-node02 <none> <none>

[root@k8s-master01 affinity]# vim pod3.yaml

[root@k8s-master01 affinity]#

[root@k8s-master01 affinity]# vim pod3.yaml

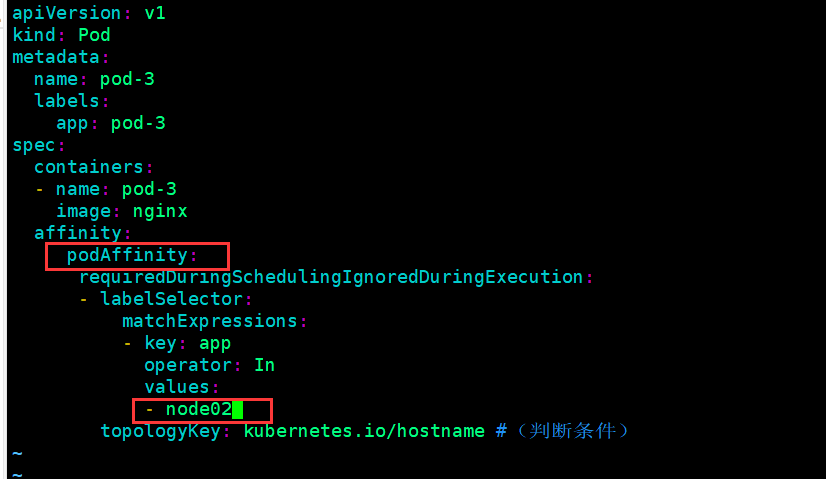

[root@k8s-master01 affinity]# cat pod3.yaml

apiVersion: v1

kind: Pod

metadata:

name: pod-3

labels:

app: pod-3

spec:

containers:

- name: pod-3

image: nginx

affinity:

podAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

- labelSelector:

matchExpressions:

- key: app

operator: In

values:

- node01

topologyKey: kubernetes.io/hostname

[root@k8s-master01 affinity]# kubectl create -f pod3.yaml

pod/pod-3 created

[root@k8s-master01 affinity]# kubectl get pod -o wide(看这里我们知道两个pod都处于同一个拓扑域中)

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

node01 1/1 Running 0 7m20s 10.244.2.78 k8s-node02 <none> <none>

pod-3 0/1 ContainerCreating 0 12s <none> k8s-node02 <none> <none>

[root@k8s-master01 affinity]#

注:拓扑域就是通过topologyKey字段来选择的,相同的字段在一个拓扑域中!

只修改这一处:

[root@k8s-master01 affinity]# vim pod3.yaml

[root@k8s-master01 affinity]# kubectl create -f pod3.yaml

pod/pod-3 created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

node01 1/1 Running 0 3m35s 10.244.2.80 k8s-node02 <none> <none>

pod-3 1/1 Running 0 8s 10.244.1.80 k8s-node01 <none> <none>

[root@k8s-master01 affinity]#

(我们看到不在一个node上面!)

这回我们修改这两处:

[root@k8s-master01 affinity]# vim pod3.yaml

[root@k8s-master01 affinity]# kubectl create -f pod3.yaml

pod/pod-3 created

[root@k8s-master01 affinity]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

node01 1/1 Running 0 12m app=node01

pod-3 0/1 Pending 0 14s app=pod-3

[root@k8s-master01 affinity]#

(这回我们可以看出处于Pending状态了,原因是硬策略,且标签是node02!我们没有这个标签哦)

[root@k8s-master01 affinity]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

node01 1/1 Running 0 12m app=node01

pod-3 0/1 Pending 0 14s app=pod-3

[root@k8s-master01 affinity]# kubectl label pod node01 app=node02

error: 'app' already has a value (node01), and --overwrite is false

[root@k8s-master01 affinity]# kubectl label pod node01 app=node02 --overwrite=true

pod/node01 labeled

[root@k8s-master01 affinity]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

node01 1/1 Running 0 13m app=node02

pod-3 1/1 Running 0 2m6s app=pod-3

[root@k8s-master01 affinity]# kubectl get pod --show-labels -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

node01 1/1 Running 0 15m 10.244.2.80 k8s-node02 <none> <none> app=node02

pod-3 1/1 Running 0 4m5s 10.244.2.81 k8s-node02 <none> <none> app=pod-3

[root@k8s-master01 affinity]#

(修改了标签后,pod立刻就running了!且处于同一个节点)

亲和性/反亲和性调度策略比较如下:

| 调度策略 | 匹配标签 | 操作符 | 拓扑域支持 | 调度目标 |

|---|---|---|---|---|

| nodeAffinity | 主机 | In, NotIn, Exists,DoesNotExist, Gt, Lt | 否 | 指定主机 |

| podAffinity | POD | In, NotIn, Exists,DoesNotExist | 是 | POD与指定POD同一拓扑域 |

| podAnitAffinity | POD | In, NotIn, Exists,DoesNotExist | 是 | POD与指定POD不在同一拓扑域 |

Taint 和 Toleration

节点亲和性,是 pod 的一种属性(偏好或硬性要求),它使 pod 被吸引到一类特定的节点。Taint 则相反,它使节点 能够 排斥 一类特定的 pod

Taint 和 toleration 相互配合,可以用来避免 pod 被分配到不合适的节点上。每个节点上都可以应用一个或多个taint ,这表示对于那些不能容忍这些 taint 的 pod,是不会被该节点接受的。如果将 toleration 应用于 pod上,则表示这些 pod 可以(但不要求)被调度到具有匹配 taint 的节点上

污点(Taint)

污点 ( Taint ) 的组成

使用 kubectl taint 命令可以给某个 Node 节点设置污点,Node 被设置上污点之后就和 Pod 之间存在了一种相斥的关系,可以让 Node 拒绝 Pod 的调度执行,甚至将 Node 已经存在的 Pod 驱逐出去

每个污点的组成如下:

key=value:effect

每个污点有一个 key 和 value 作为污点的标签,其中 value 可以为空,effect 描述污点的作用。当前 taint effect 支持如下三个选项:

-

NoSchedule :表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上

-

PreferNoSchedule :表示 k8s 将尽量避免将 Pod 调度到具有该污点的 Node 上

-

NoExecute :表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上,同时会将 Node 上已经存在的 Pod 驱

逐出去

污点的设置、查看和去除

# 设置污点

kubectl taint nodes node1 key1=value1:NoSchedule

# 节点说明中,查找 Taints 字段

kubectl describe pod pod-name

# 去除污点

kubectl taint nodes node1 key1:NoSchedule-

其实k8s已经默认设置了一些污点了

[root@k8s-master01 ~]# kubectl describe node k8s-master| grep Taint

Taints: node-role.kubernetes.io/master:NoSchedule

[root@k8s-master01 ~]#

[root@k8s-master01 affinity]# kubectl taint nodes k8s-node02 check=nginx:NoExecute

node/k8s-node02 tainted

[root@k8s-master01 affinity]# kubectl get pod -o wide

No resources found in default namespace.

[root@k8s-master01 affinity]#

[root@k8s-master01 affinity]# kubectl taint nodes k8s-node01 check=nginx:NoExecute (我们给node01也打上污点)

node/k8s-node01 tainted

[root@k8s-master01 affinity]# kubectl create -f pod1.yaml

pod/node01 created

[root@k8s-master01 affinity]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

node01 0/1 Pending 0 2s <none> <none> <none> <none>

[root@k8s-master01 affinity]#

(现在集群内三个机器都有污点,pod一直都是Pending状态!)

去除污点:

在原有设置污点的命令后面加上“-”

[root@k8s-master01 affinity]# kubectl taint nodes k8s-node01 check=nginx:NoExecute-

node/k8s-node01 untainted

[root@k8s-master01 affinity]# kubectl taint nodes k8s-node02 check=nginx:NoExecute-

node/k8s-node02 untainted

[root@k8s-master01 affinity]# kubectl taint nodes k8s-node02 check=nginx:NoExecute-

node/k8s-node02 untainted

[root@k8s-master01 affinity]# kubectl describe node k8s-node01|grep Taint

Taints: <none>

[root@k8s-master01 affinity]# kubectl describe node k8s-node02|grep Taint

Taints: <none>

[root@k8s-master01 affinity]#

容忍(Tolerations)

设置了污点的 Node 将根据 taint 的 effect:NoSchedule、PreferNoSchedule、NoExecute 和 Pod 之间产生互斥的关系,Pod 将在一定程度上不会被调度到 Node 上。 但我们可以在 Pod 上设置容忍 ( Toleration ) ,意思是设置了容忍的 Pod 将可以容忍污点的存在,可以被调度到存在污点的 Node 上,存在这样的可能性

pod.spec.tolerations

tolerations

-

其中 key, vaule, effect 要与 Node 上设置的 taint 保持一致

-

operator 的值为 Exists 将会忽略 value 值

-

tolerationSeconds 用于描述当 Pod 需要被驱逐时可以在 Pod 上继续保留运行的时间(比如设置的1000s,表明了1000s后被驱逐)

[root@k8s-master01 affinity]# vim pod3.yaml

[root@k8s-master01 affinity]# cat pod3.yaml

apiVersion: v1

kind: Pod

metadata:

name: pod-3

labels:

app: pod-3

spec:

containers:

- name: pod-3

image: nginx

tolerations:

- key: "check"

operator: "Equal"

value: "nginx"

effect: "NoExecute"

tolerationSeconds: 3600

[root@k8s-master01 affinity]# kubectl apply -f pod3.yaml

pod/pod-3 created

[root@k8s-master01 affinity]# kubectl get pod (虽然有node设置了污点,但是我们的pod也设置了容忍)

NAME READY STATUS RESTARTS AGE

node01 0/1 Pending 0 10m

pod-3 1/1 Running 0 17s

[root@k8s-master01 affinity]#

当不指定 key 值时,表示容忍所有的污点 key:

tolerations

当不指定 effect 值时,表示容忍所有的污点作用

tolerations

有多个 Master 存在时,防止资源浪费,可以如下设置

(如果将来出现了资源不够使用的问题,我们就可以这样设置master节点,运行对应的pod!)

kubectl taint nodes Node-Name node-role.kubernetes.io/master=:PreferNoSchedule

(键值是node-role.kubernetes.io/master,键名为空)

指定调度节点

一、Pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配

apiVersion

[root@k8s-master01 node]# vim pod1.yaml

[root@k8s-master01 node]# kubectl apply -f pod1.yaml

deployment.apps/myweb created

[root@k8s-master01 node]# kubectl get pod -o wide(我们可以看到,全部在node01上面)

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myweb-976848c8c-8hl9j 1/1 Running 0 84s 10.244.1.88 k8s-node01 <none> <none>

myweb-976848c8c-glwqk 1/1 Running 0 84s 10.244.1.89 k8s-node01 <none> <none>

myweb-976848c8c-hv25q 1/1 Running 0 84s 10.244.1.86 k8s-node01 <none> <none>

myweb-976848c8c-lhtjj 1/1 Running 0 84s 10.244.1.91 k8s-node01 <none> <none>

myweb-976848c8c-mtjdp 1/1 Running 0 84s 10.244.1.90 k8s-node01 <none> <none>

myweb-976848c8c-q7mcz 1/1 Running 0 84s 10.244.1.85 k8s-node01 <none> <none>

myweb-976848c8c-qmnrs 1/1 Running 0 84s 10.244.1.87 k8s-node01 <none> <none>

node01 1/1 Running 0 30m 10.244.1.84 k8s-node01 <none> <none>

pod-3 1/1 Running 0 20m 10.244.2.86 k8s-node02 <none> <none>

[root@k8s-master01 node]#

二、Pod.spec.nodeSelector:通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,而后调度 Pod 到目标节点,该匹配规则属于强制约束

apiVersion

[root@k8s-master01 node]# vim pod2.yaml

[root@k8s-master01 node]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myweb1-595fcc486f-6l9gh 0/1 Pending 0 27s <none> <none> <none> <none>

myweb1-595fcc486f-wwrww 0/1 Pending 0 27s <none> <none> <none> <none>

[root@k8s-master01 node]#

[root@k8s-master01 node]# kubectl label node k8s-node01 disk=ssd

node/k8s-node01 labeled

[

[root@k8s-master01 node]# kubectl get pod -o wide(现在pod运行在node01上面了)

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myweb1-595fcc486f-6l9gh 1/1 Running 0 3m16s 10.244.1.99 k8s-node01 <none> <none>

myweb1-595fcc486f-wwrww 1/1 Running 0 3m16s 10.244.1.100 k8s-node01 <none> <none>

[root@k8s-master01 node]#

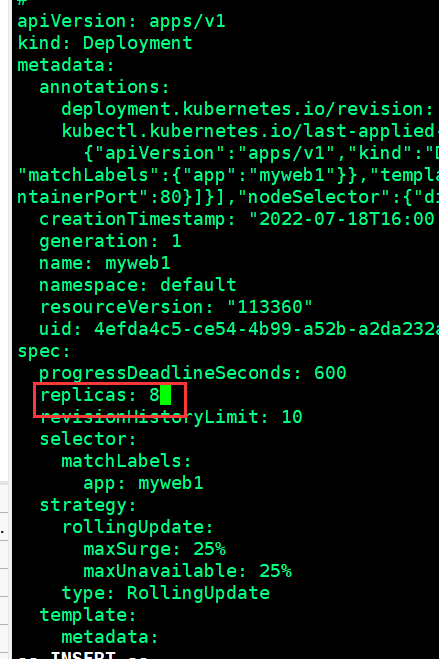

我们把副本数改到八个:

[root@k8s-master01 node]# kubectl label node k8s-node02 disk=ssd(给node02也打上标签)

node/k8s-node02 labeled

[root@k8s-master01 node]# kubectl get pod -o wide(我们发现,现在node01和node02都有pod在运行)

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

myweb1-595fcc486f-2tmjn 1/1 Running 0 111s 10.244.2.88 k8s-node02 <none> <none>

myweb1-595fcc486f-59gj4 0/1 ContainerCreating 0 2s <none> k8s-node01 <none> <none>

myweb1-595fcc486f-75rng 0/1 ContainerCreating 0 2s <none> k8s-node02 <none> <none>

myweb1-595fcc486f-dqwzf 0/1 ContainerCreating 0 2s <none> k8s-node01 <none> <none>

myweb1-595fcc486f-khfb5 0/1 ContainerCreating 0 2s <none> k8s-node02 <none> <none>

myweb1-595fcc486f-s2c9f 1/1 Running 0 2s 10.244.1.116 k8s-node01 <none> <none>

myweb1-595fcc486f-s5dqd 1/1 Running 0 111s 10.244.1.115 k8s-node01 <none> <none>

myweb1-595fcc486f-vhc2t 0/1 ContainerCreating 0 2s <none> k8s-node02 <none> <none>

[root@k8s-master01 node]#

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 单元测试从入门到精通

· 上周热点回顾(3.3-3.9)

· winform 绘制太阳,地球,月球 运作规律