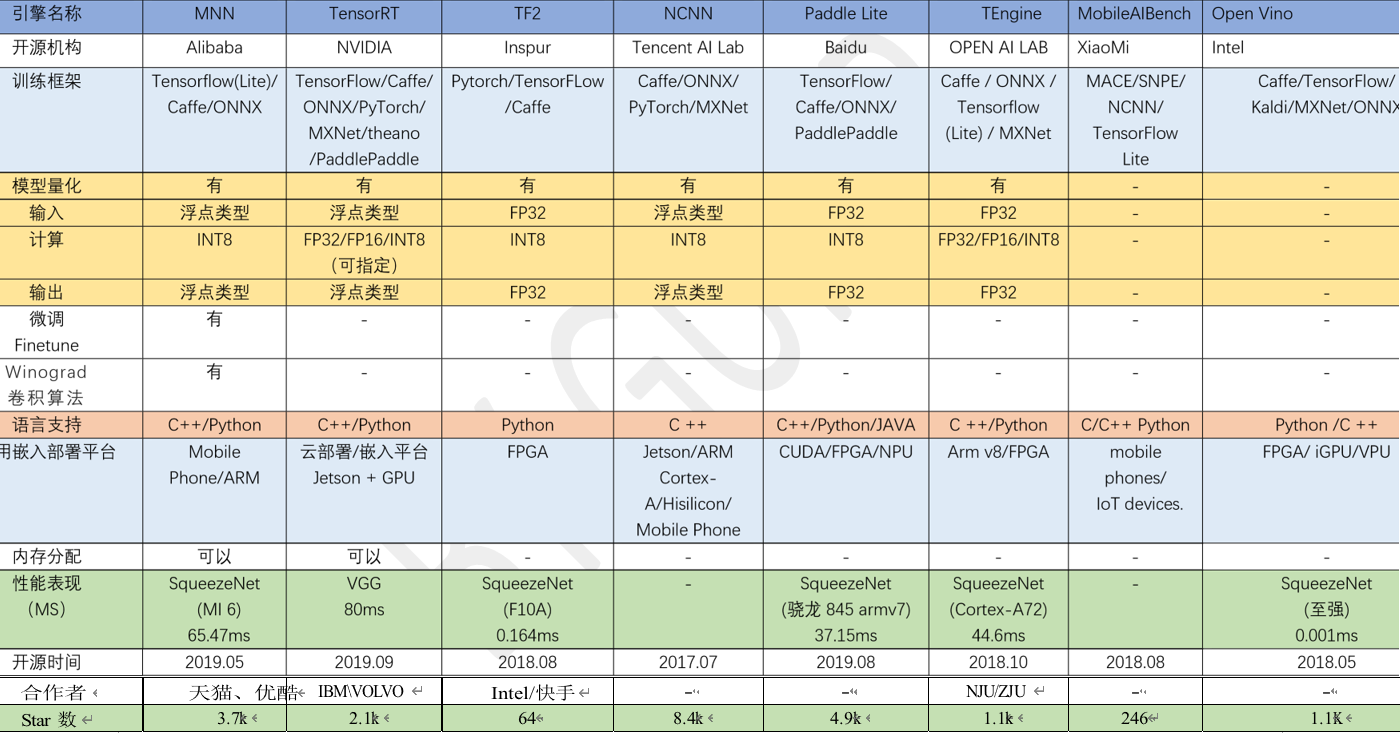

神经网络加速引擎对比调研

|

引擎名称 |

MNN |

TensorRT |

TF2 |

NCNN |

Paddle Lite |

TEngine |

MobileAIBench |

Open Vino |

|

开源机构 |

Alibaba |

NVIDIA |

Inspur |

Tencent AI Lab |

Baidu |

OPEN AI LAB |

XiaoMi |

Intel |

|

训练框架 |

Tensorflow(Lite)/ Caffe/ONNX |

TensorFlow/Caffe/ ONNX/PyTorch/ MXNet/theano /PaddlePaddle |

Pytorch/TensorFLow /Caffe |

Caffe/ONNX/ PyTorch/MXNet |

TensorFlow/ Caffe/ONNX/ PaddlePaddle |

Caffe / ONNX / Tensorflow (Lite) / MXNet |

MACE/SNPE/ NCNN/ TensorFlow Lite |

Caffe/TensorFlow/ Kaldi/MXNet/ONNX |

|

模型量化 |

有 |

有 |

有 |

有 |

有 |

有 |

- |

- |

|

输入 |

浮点类型 |

浮点类型 |

FP32 |

浮点类型 |

FP32 |

FP32 |

- |

- |

|

计算 |

INT8 |

FP32/FP16/INT8(可指定) |

INT8 |

INT8 |

INT8 |

FP32/FP16/INT8 |

- |

- |

|

输出 |

浮点类型 |

浮点类型 |

FP32 |

浮点类型 |

FP32 |

FP32 |

- |

- |

|

微调 Finetune |

有 |

- |

- |

- |

- |

- |

- |

- |

|

Winograd 卷积算法 |

有 |

- |

- |

- |

- |

- |

- |

- |

|

语言支持 |

C++/Python |

C++/Python |

Python |

C ++ |

C++/Python/JAVA |

C ++/Python |

C/C++ Python |

Python /C ++ |

|

常用嵌入部署平台 |

Mobile Phone/ARM |

云部署/嵌入平台 Jetson + GPU |

FPGA |

Jetson/ARM Cortex-A/Hisilicon/ Mobile Phone |

CUDA/FPGA/NPU |

Arm v8/FPGA |

mobile phones/ IoT devices. |

FPGA/ iGPU/VPU |

|

内存分配 |

可以 |

可以 |

- |

- |

- |

- |

- |

- |

|

性能表现 (MS) |

SqueezeNet (MI 6) 65.47ms |

VGG 80ms |

SqueezeNet (F10A) 0.164ms |

- |

SqueezeNet (骁龙845 armv7) 37.15ms |

SqueezeNet (Cortex-A72) 44.6ms |

- |

SqueezeNet (至强) 0.001ms |

|

开源时间 |

2019.05 |

2019.09 |

2018.08 |

2017.07 |

2019.08 |

2018.10 |

2018.08 |

2018.05 |

|

合作者 |

天猫、优酷 |

IBM\VOLVO |

Intel/快手 |

- |

- |

NJU/ZJU |

- |

- |

|

Star数 |

3.7k |

2.1k |

64 |

8.4k |

4.9k |

1.1k |

246 |

1.1K |

浙公网安备 33010602011771号

浙公网安备 33010602011771号