第十次作业:分类与监督学习,朴素贝叶斯分类算法

简述分类与聚类的联系与区别。

① 联系:分类和聚类都包含一个过程:对于想要分析的目标点,都会在数据集中寻找离它最近的点。

② 区别: 分类是根据已知的一些样本(包括属性与类标号)来得到分类模型(即得到样本属性与类标号之间的函数),然后通过此目标函数来对只包含属性的样本数据进行分类,常用的算法是KNN,是一种有监督学习。聚类是事先并不知道任何样本的类别标号,通过某种算法来把一组未知类别的样本划分成若干类别,需要实现的目标只是把相似的东西聚到一起,常用算法是K-Means算法,是一种无监督学。

简述什么是监督学习与无监督学习。

① 监督学习:从标记的训练数据来推断一个功能,从正确的例子中学习,每个实例都是由一个输入对象(通常为矢量)和一个期望的输出值(也称为监督信号)组成。

② 无监督学习:缺乏足够的先验知识,输入X,在数据(没有被标记)中发现一些规律。

2.朴素贝叶斯分类算法 实例

利用关于心脏病患者的临床历史数据集,建立朴素贝叶斯心脏病分类模型。

有六个分类变量(分类因子):性别,年龄、KILLP评分、饮酒、吸烟、住院天数

目标分类变量疾病:

–心梗

–不稳定性心绞痛

新的实例:–(性别=‘男’,年龄<70, KILLP=‘I',饮酒=‘是’,吸烟≈‘是”,住院天数<7)

最可能是哪个疾病?

上传手工演算过程。

|

|

性别 |

年龄 |

KILLP |

饮酒 |

吸烟 |

住院天数 |

疾病 |

|

1 |

男 |

>80 |

1 |

是 |

是 |

7-14 |

心梗 |

|

2 |

女 |

70-80 |

2 |

否 |

是 |

<7 |

心梗 |

|

3 |

女 |

70-81 |

1 |

否 |

否 |

<7 |

不稳定性心绞痛 |

|

4 |

女 |

<70 |

1 |

否 |

是 |

>14 |

心梗 |

|

5 |

男 |

70-80 |

2 |

是 |

是 |

7-14 |

心梗 |

|

6 |

女 |

>80 |

2 |

否 |

否 |

7-14 |

心梗 |

|

7 |

男 |

70-80 |

1 |

否 |

否 |

7-14 |

心梗 |

|

8 |

女 |

70-80 |

2 |

否 |

否 |

7-14 |

心梗 |

|

9 |

女 |

70-80 |

1 |

否 |

否 |

<7 |

心梗 |

|

10 |

男 |

<70 |

1 |

否 |

否 |

7-14 |

心梗 |

|

11 |

女 |

>80 |

3 |

否 |

是 |

<7 |

心梗 |

|

12 |

女 |

70-80 |

1 |

否 |

是 |

7-14 |

心梗 |

|

13 |

女 |

>80 |

3 |

否 |

是 |

7-14 |

不稳定性心绞痛 |

|

14 |

男 |

70-80 |

3 |

是 |

是 |

>14 |

不稳定性心绞痛 |

|

15 |

女 |

<70 |

3 |

否 |

否 |

<7 |

心梗 |

|

16 |

男 |

70-80 |

1 |

否 |

否 |

>14 |

心梗 |

|

17 |

男 |

<70 |

1 |

是 |

是 |

7-14 |

心梗 |

|

18 |

女 |

70-80 |

1 |

否 |

否 |

>14 |

心梗 |

|

19 |

男 |

70-80 |

2 |

否 |

否 |

7-14 |

心梗 |

|

20 |

女 |

<70 |

3 |

否 |

否 |

<7 |

不稳定性心绞痛 |

解答过程:

解:

设X为患心脏病

根据新实例:(性别=‘男’,年龄<70, KILLP=‘I',饮酒=‘是’,吸烟≈‘是’,住院天数<7)

可求:P(x)=2/5*1/4*1/2*1/5*9/20*3/10=0.00135

在资料中患者疾病为心梗的前提下:

患者(性别=‘男’)概率:p(x1|y1) = 7/16

患者(年龄<70)概率:p(x2|y1) = 4/16

患者(KILLP=‘I)概率:p(x3|y1) = 9/16

患者(饮酒=‘是’)概率:p(x4|y1) = 3/16

患者(吸烟≈‘是’)概率:p(x5|y1) = 7/16

患者(住院天数<7)概率:p(x6|y1) = 4/16

同理可得:

在资料中患者疾病为心绞病的前提下:

患者(性别=‘男’)概率:p(x1|y2) = 1/4

患者(年龄<70)概率:p(x2|y2) = 1/4

患者(KILLP=‘I)概率:p(x3|y2) = 1/4

患者(饮酒=‘是’)概率:p(x4|y2) = 1/4

患者(吸烟≈‘是’)概率:p(x5|y2) = 2/4

患者(住院天数<7)概率:p(x6|y2) = 2/4

在心脏病患者资料中疾病为心梗概率:4/5

在心脏病患者资料中疾病为心绞病概率:1/5

判定心脏病患者疾病为心梗概率:

p(y1|x) = p(x1|y1)p(x2|y1)p(x3|y1)…p(x6|y1)/p(x) ≈ 75%

判定心脏病患者疾病为心绞病概率:

p(y2|x) = p(x1|y2)p(x2|y2)p(x3|y2)…p(x6|y2)/p(x) ≈ 15%

其中:p(y1|x) > p(y2|x)

由此可知:新实例患者最可能患心梗心脏病。

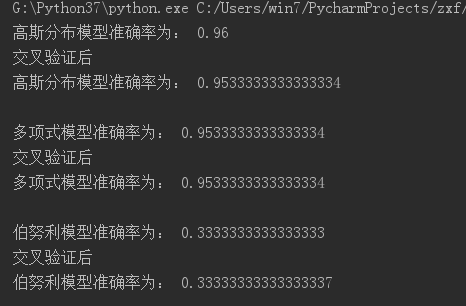

3.使用朴素贝叶斯模型对iris数据集进行花分类。

尝试使用3种不同类型的朴素贝叶斯:

- 高斯分布型

- 多项式型

- 伯努利型

并使用sklearn.model_selection.cross_val_score(),对各模型进行交叉验证。

源代码:

from sklearn.datasets import load_iris

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

from sklearn.naive_bayes import BernoulliNB

from sklearn.model_selection import cross_val_score

#导入鸢尾花数据集

iris = load_iris()

x = iris["data"]

y = iris["target"]

# 1、高斯分布

gnb = GaussianNB() # 构建模型

gnb_model = gnb.fit(x,y) # 构建模型

gnb_pre = gnb_model.predict(x) # 预测模型

print("高斯分布模型准确率为:", sum(gnb_pre == y) / len(x))

# 交叉验证

print("交叉验证后")

gnb_score = cross_val_score(gnb,x,y,cv=10)

print("高斯分布模型准确率为:",gnb_score.mean(),"\n")

# 2、多项式型

mnb = MultinomialNB() # 构建模型

mnb_model = mnb.fit(x,y) # 训练模型

mnb_pre = mnb_model.predict(x) # 预测模型

print("多项式模型准确率为:", sum(mnb_pre == y) / len(x))

# 交叉验证

print("交叉验证后")

mnb_score = cross_val_score(mnb,x,y,cv=10)

print("多项式模型准确率为:",mnb_score.mean(),"\n")

# 3、伯努利型

bnb = BernoulliNB() # 构建模型

bnb_model = bnb.fit(x,y) # 训练模型

bnb_pre = bnb.predict(x) # 预测模型

print("伯努利模型准确率为:", sum(bnb_pre == y) / len(x))

# 交叉验证

print("交叉验证后")

bnb_score = cross_val_score(bnb,x,y,cv=10)

print("伯努利模型准确率为:",bnb_score.mean(),"\n")

运行结果: