CenterNet和CenterNet2笔记

CenterNet和CenterNet2笔记

CenterNet是基于anchor-free的一阶段检测算法

CenterNet2是CenterNet作者基于两阶段的改进

CenterNet(Object as point笔记添加[2022年4月14号])#

以下笔记基于mmdetection代码库

centernet的paper

centernet的code

centernet2的paper

centernet2的code

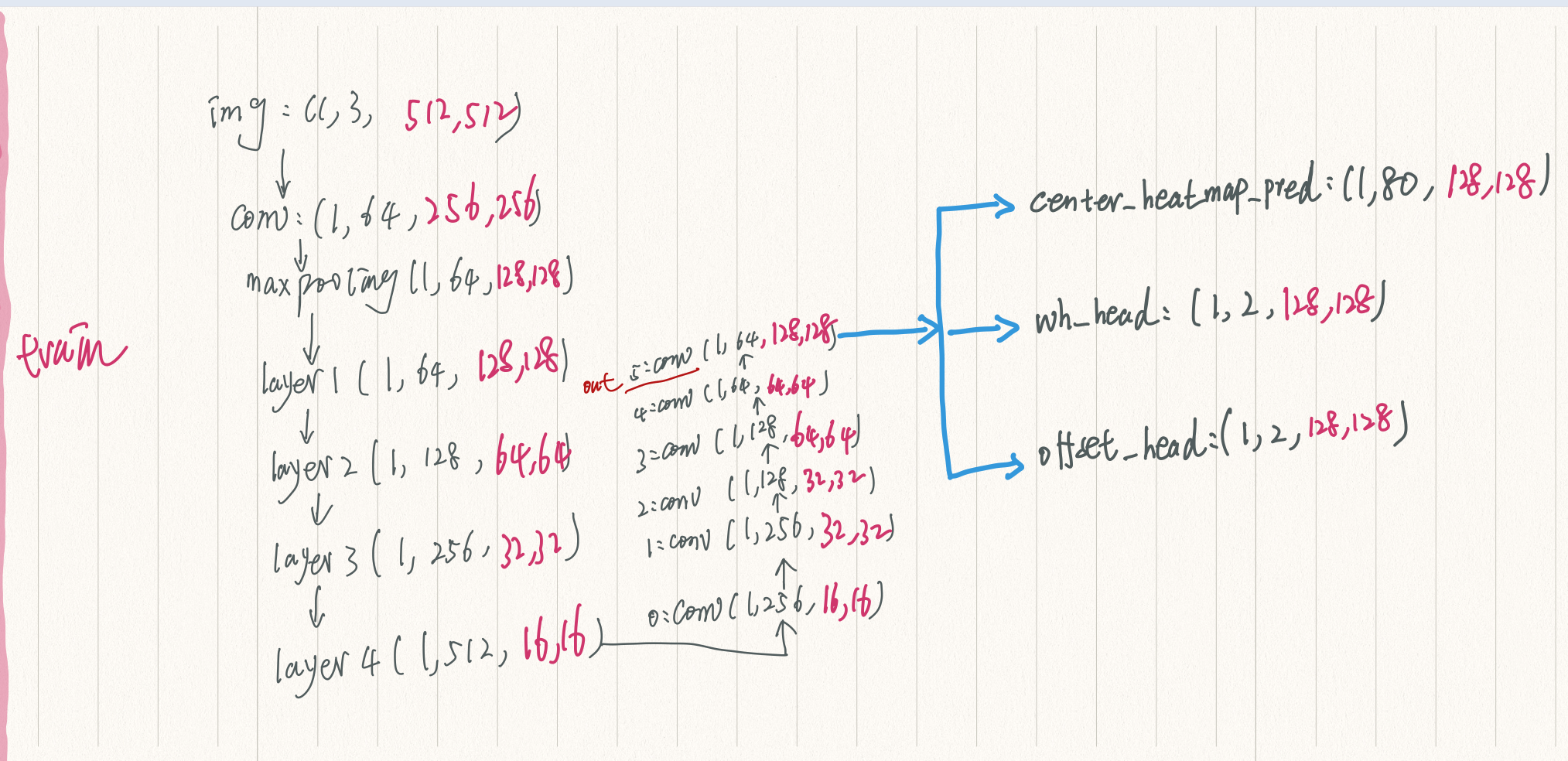

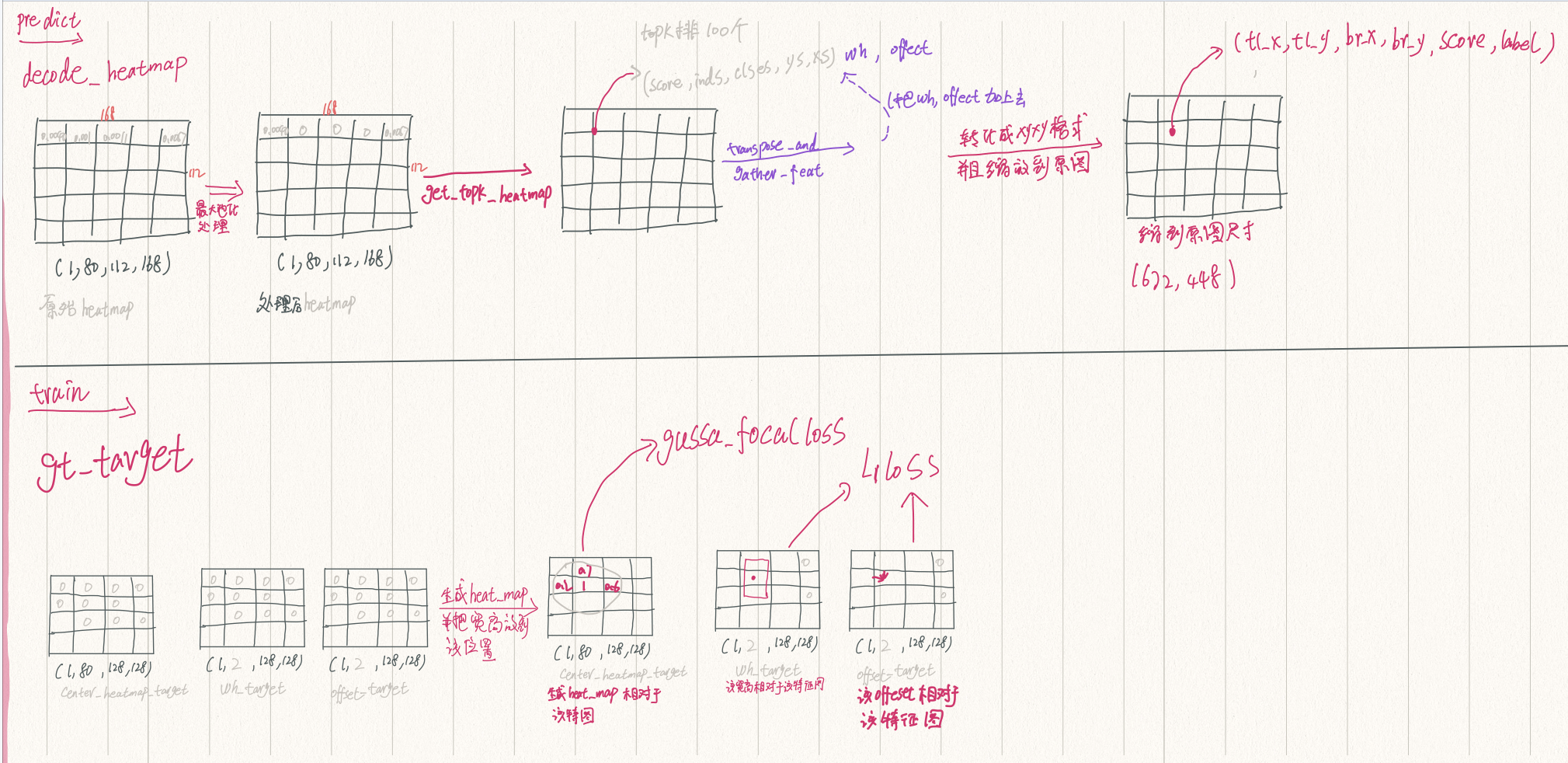

centernet的实现思路:

centernet的预测结果会将输入进来的图片划分成不同的区域,每个

区域都会有一个特征点,centernet网络的预测结果就会判断这个特征

点是否有对应的物体,以及物体的种类和置信度,同时还会对特征点进行调整获得物体的中心坐标,回归预测获得物体的宽高

centernet的缺点:#

centernet如果两个相同的类别的距离比较近那么他的中心点可能只有

一个不太好预测可能会参数误差

参考博客#

- 见于已经有许多优秀的博客进行了CenterNet解读,这里之后复习的时候看这些博客就够了

- 博客1:带代码解读

Pytorch搭建自己的Centernet目标检测平台 - 博客2:比较全面

扔掉anchor!真正的CenterNet——Objects as Points论文解读 - 博客3:关于热点图的解读

说点Cornernet/Centernet代码里面GT heatmap里面如何应用高斯散射核 - 博客4:两个centernet的比较

论文也撞衫,你更喜欢哪个无锚点CenterNet? - 博客4:用官方的代码训练自己的数据集

(绝对详细)CenterNet训练自己的数据(pytorch0.4.1)

CenterNet2

框架图#

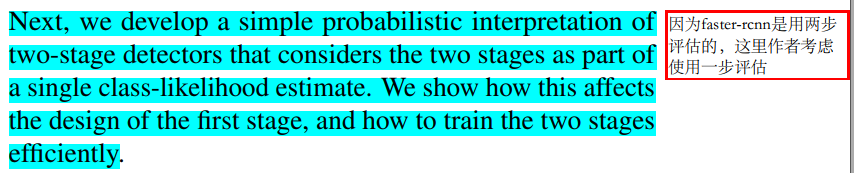

之前传统的双阶段目标检测(以faster-rcnn为例)中的第一个阶段是使

用SPN网络参数是前景框还是背景框。并没有表明该框是前景还是背景的

可能性-->因为之前的spn网络并没有给这些框打分的功能。但是常见的

一阶段的算法有这个功能。

所以作者的做法是使用常见的一阶段充当two-stage的第一个stage,这样就可以对是属于前景还是背景进行打分--->方便后面进行删选出更少的区域处理给第二stage处理

abstact中的说明#

作者与一阶段,传统两阶段,以及自己方法的比较#

作者这里使用的评估也是一步#

总览#

关于损失函数以及实验部分可以查看论文#

标签:

目标检测

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 基于Microsoft.Extensions.AI核心库实现RAG应用

· Linux系列:如何用heaptrack跟踪.NET程序的非托管内存泄露

· 开发者必知的日志记录最佳实践

· SQL Server 2025 AI相关能力初探

· Linux系列:如何用 C#调用 C方法造成内存泄露

· 终于写完轮子一部分:tcp代理 了,记录一下

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理