机器学习---吴恩达---Week10(机器学习概述与单变量线性回归方程分析)

Large scale machine learning(大规模机器学习)

Learning with large datasets(大型数据集学习)

“It’s not who has the best algorithm that wins. It’s who has the most data.”(高方差情况下)

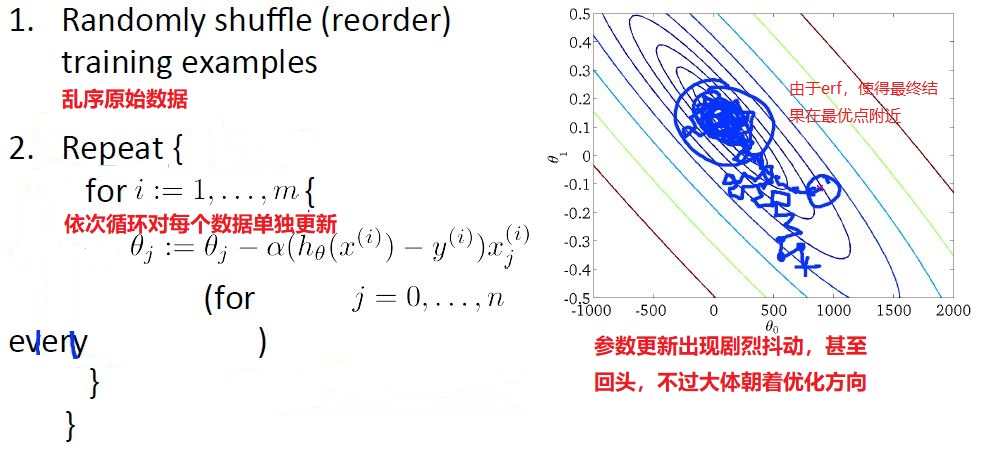

Stochastic gradient descent(随机梯度下降)

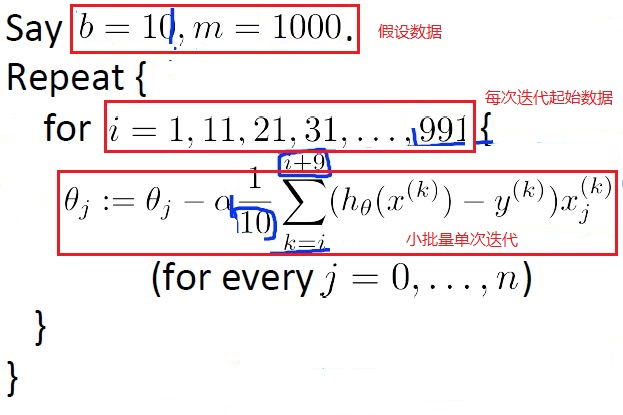

Mini-‐batch gradient descent(小梯度离散下降)

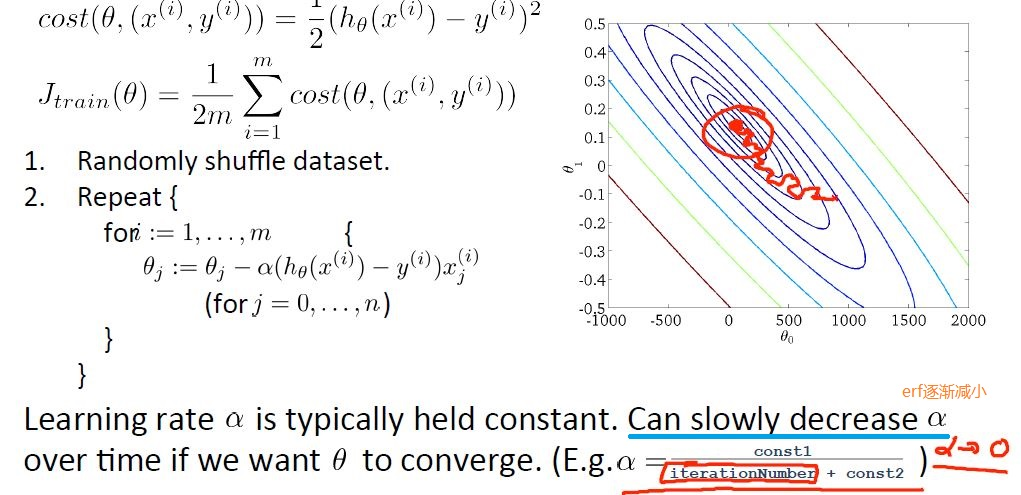

Stochastic gradient descent convergence(随机梯度下降收敛)

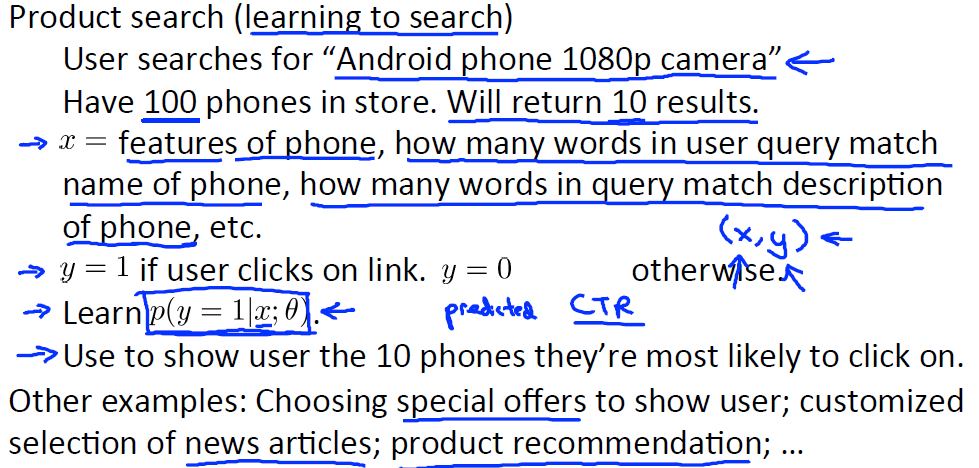

Online learning(在线学习)

由在线新获得的数据更新参数,不需要人为收集大量训练数据集,实时性更强。

举例:

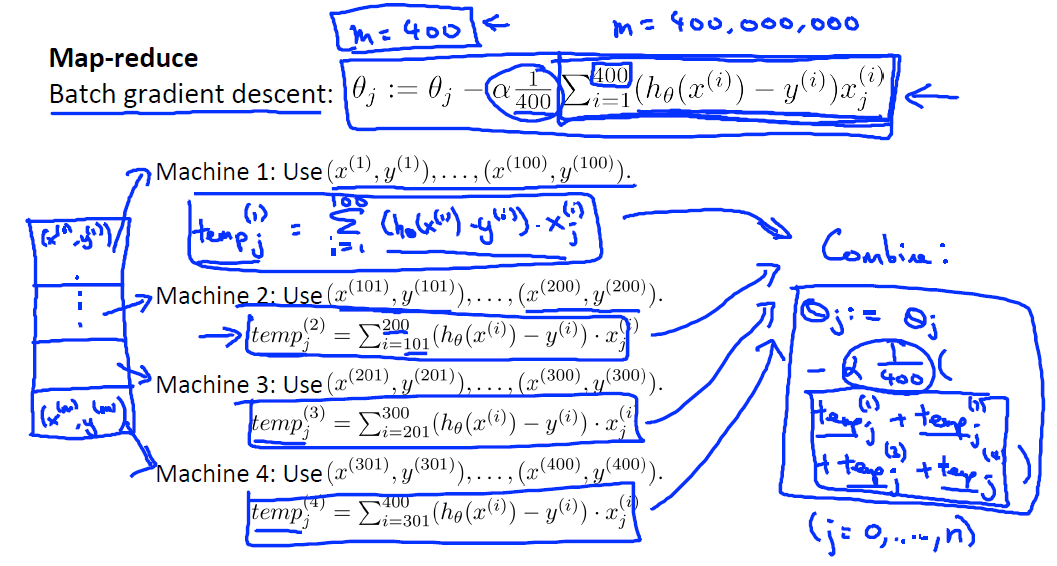

Map-‐reduce and data parallelism(映射化简和数据并行性)

使用前提:Many learning algorithms can be expressed as computing sums of functions over the training set.(许多学习算法可以表示为训练集上的函数的计算总和。)

举例:

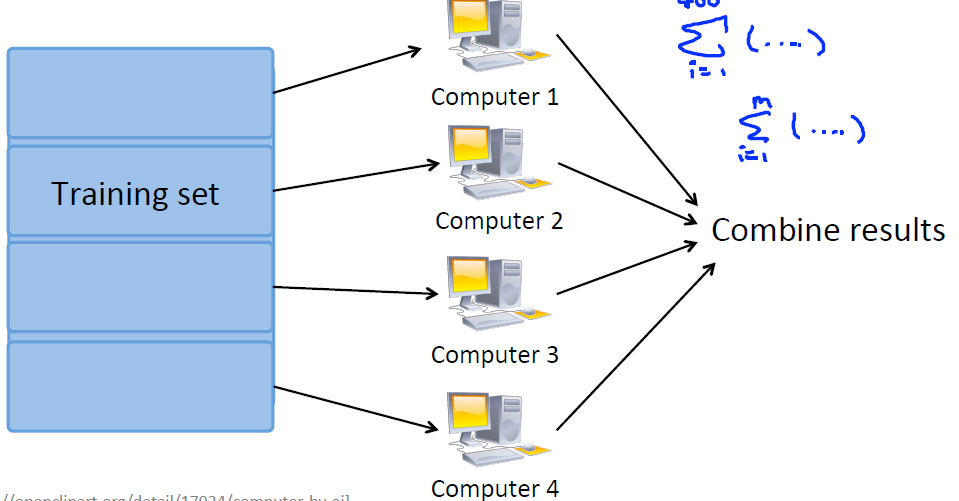

形式1:多台计算机通过网络结合

形式2:单台计算机的多个内核