第四次实践作业

一、使用Docker-compose实现Tomcat+Nginx负载均衡

要求:

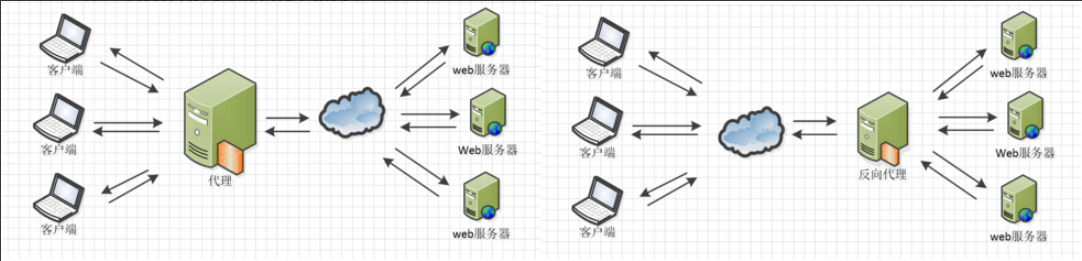

- 理解nginx反向代理原理;

- nginx代理tomcat集群,代理2个以上tomcat;

- 了解nginx的负载均衡策略,并至少实现nginx的2种负载均衡策略;

(1)nginx反向代理原理

客户端对代理是无感知的,客户端不需要任何配置就可以访问,客户端将请求发送到反向代理服务器,由反向代理服务器去选择目标服务器获取数据后,在返回给客户端,此时反向代理服务器和目标服务器对外就是一个服务器,暴露的是代理服务器地址,隐藏了真实服务器IP地址。

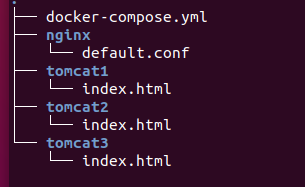

(2)nginx代理tomcat集群

新建一个树形结构

docker-compose.yml

version: "3"

services:

nginx:

image: nginx

container_name: "nginx-tomcat"

ports:

- 80:8085

volumes:

- ./nginx/default.conf:/etc/nginx/conf.d/default.conf # 挂载配置文件

depends_on:

- tomcat01

- tomcat02

- tomcat03

tomcat01:

image: tomcat

container_name: "tomcat01"

volumes:

- ./tomcat1:/usr/local/tomcat/webapps/ROOT # 挂载web目录

tomcat02:

image: tomcat

container_name: "tomcat02"

volumes:

- ./tomcat2:/usr/local/tomcat/webapps/ROOT

tomcat03:

image: tomcat

container_name: "tomcat03"

volumes:

- ./tomcat3:/usr/local/tomcat/webapps/ROOT

nginx配置default.conf

upstream tomcats {

server tomcat01:8080;

server tomcat02:8080;

server tomcat03:8080;

}

server {

listen 8085;

server_name localhost;

location / {

proxy_pass http://tomcats; # 请求转向tomcats

}

}

三个index.html

!tomcat1!

!tomcat2!

!tomcat3!

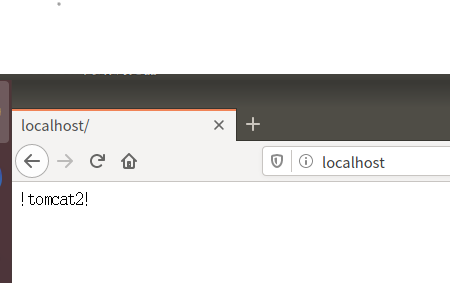

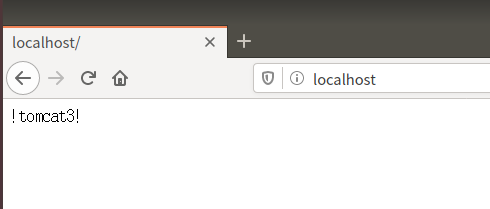

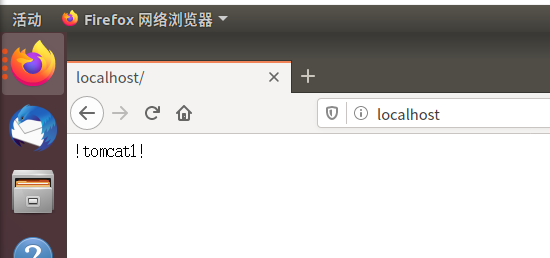

写好配置后docker-compose up -d即可访问localhost

(3)nginx的负载均衡策略

轮询算法

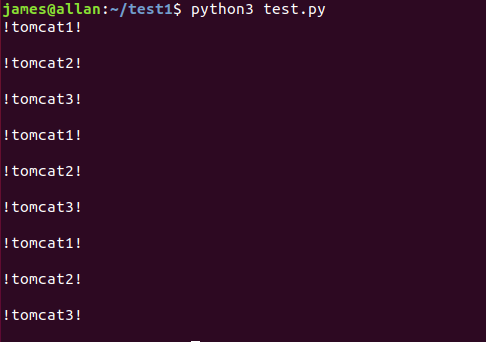

创建py文件进行测试

import requests

url = 'http://localhost'

for i in range(1,10):

response=requests.get(url)

print(response.text)

权重算法

更改default.conf文件

upstream tomcats {

server c_tc1:8080 weight=1; //weight后面的数字表示权重

server c_tc2:8080 weight=3;

server c_tc3:8080 weight=5;

}

server {

listen 2419;

server_name localhost;

location / {

proxy_pass http://tomcats; # 请求转向tomcats

}

重启容器

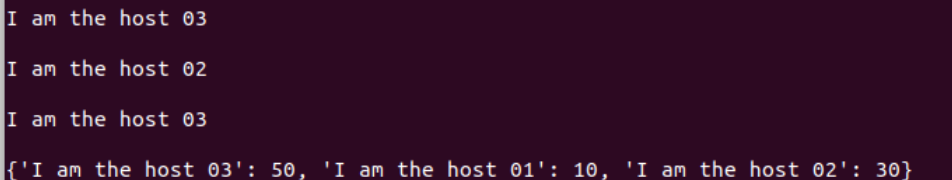

用py代码测试

import requests

url = 'http://localhost'

count={'I am the host 03':0,'I am the host 01':0,'I am the host 02':0}

for i in range(0,90):

response=requests.get(url)

if 'I am the host 03' in response.text:

count['I am the host 03'] += 1

if 'I am the host 02' in response.text:

count['I am the host 02'] += 1

if 'I am the host 01' in response.text:

count['I am the host 01'] += 1

print(response.text)

print(count)

可以明显看出tomcat3权重最大,被访问最多,其次是2,最后是1

二、使用Docker-compose部署javaweb运行环境

要求:

- 分别构建tomcat、数据库等镜像服务;

- 成功部署Javaweb程序,包含简单的数据库操作;

- 为上述环境添加nginx反向代理服务,实现负载均衡。

(1)项目结构

此处采用了[老师给的项目](https://blog.csdn.net/weixin_41043145/article/details/92834784)

├── docker-compose.yml

├── default.conf

├── docker-entrypoint.sh

├── grogshop.sql

├── Dockerfile

└── webapps

├── docs

├── examples

├── host-manager

├── manager

├── ROOT

├── ssmgrogshop_war

└── ssmgrogshop_war.war

docker-compose.yml

version: "3" #版本

services: #服务节点

tomcat00: #tomcat 服务

image: tomcat #镜像

hostname: hostname #容器的主机名

container_name: tomcat00 #容器名

ports: #端口

- "5050:8080"

volumes: #数据卷

- "./webapps:/usr/local/tomcat/webapps"

- ./wait-for-it.sh:/wait-for-it.sh

networks: #网络设置静态IP

webnet:

ipv4_address: 15.22.0.15

tomcat01: #tomcat 服务

image: tomcat #镜像

hostname: hostname #容器的主机名

container_name: tomcat01 #容器名

ports: #端口

- "5055:8080"

volumes: #数据卷

- "./webapps:/usr/local/tomcat/webapps"

- ./wait-for-it.sh:/wait-for-it.sh

networks: #网络设置静态IP

webnet:

ipv4_address: 15.22.0.16

mymysql: #mymysql服务

build: . #通过MySQL的Dockerfile文件构建MySQL

image: mymysql:test

container_name: mymysql

ports:

- "3309:3306"

#红色的外部访问端口不修改的情况下,要把Linux的MySQL服务停掉

#service mysql stop

#反之,将3306换成其它的

command: [

'--character-set-server=utf8mb4',

'--collation-server=utf8mb4_unicode_ci'

]

environment:

MYSQL_ROOT_PASSWORD: "123456"

networks:

webnet:

ipv4_address: 15.22.0.6

nginx:

image: nginx

container_name: "nginx-tomcat"

ports:

- 8080:8080

volumes:

- ./default.conf:/etc/nginx/conf.d/default.conf # 挂载配置文件

tty: true

stdin_open: true

depends_on:

- tomcat00

- tomcat01

networks:

webnet:

ipv4_address: 15.22.0.7

networks: #网络设置

webnet:

driver: bridge #网桥模式

ipam:

config:

-

subnet: 15.22.0.0/24 #子网

docker-entrypoint.sh

#!/bin/bash

mysql -uroot -p123456 << EOF # << EOF 必须要有

source /usr/local/grogshop.sql;

Dockerfile

# 这个是构建MySQL的dockerfile

FROM registry.saas.hand-china.com/tools/mysql:5.7.17

# mysql的工作位置

ENV WORK_PATH /usr/local/

# 定义会被容器自动执行的目录

ENV AUTO_RUN_DIR /docker-entrypoint-initdb.d

#复制gropshop.sql到/usr/local

COPY grogshop.sql /usr/local/

#把要执行的shell文件放到/docker-entrypoint-initdb.d/目录下,容器会自动执行这个shell

COPY docker-entrypoint.sh $AUTO_RUN_DIR/

#给执行文件增加可执行权限

RUN chmod a+x $AUTO_RUN_DIR/docker-entrypoint.sh

# 设置容器启动时执行的命令

#CMD ["sh", "/docker-entrypoint-initdb.d/import.sh"]

default.conf

upstream tomcat123 {

server tomcat00:8080;

server tomcat01:8080;

}

server {

listen 8080;

server_name localhost;

location / {

proxy_pass http://tomcat123;

}

}

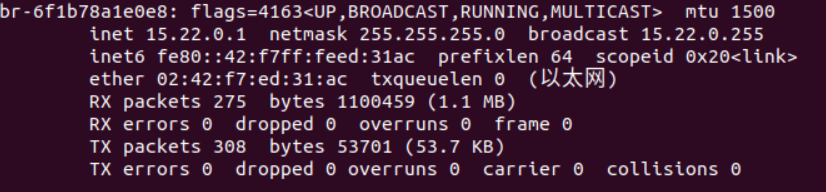

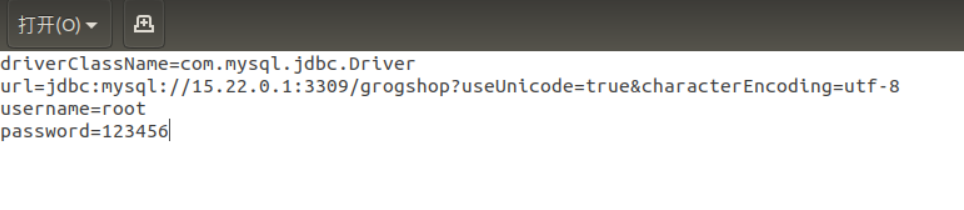

(2)修改连接数据库的IP(同时端口号也要改成对应的)

用ipconfig查看本机地址

修改对应ip和端口号

(3)启动容器

docker-compose up -d --build

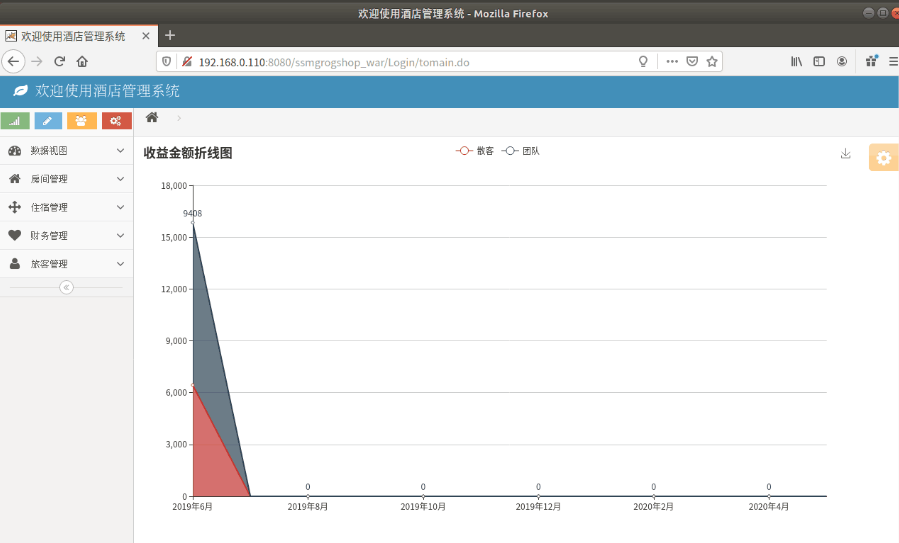

(4)前端输入

http://127.0.0.1:5050/ssmgrogshop_war

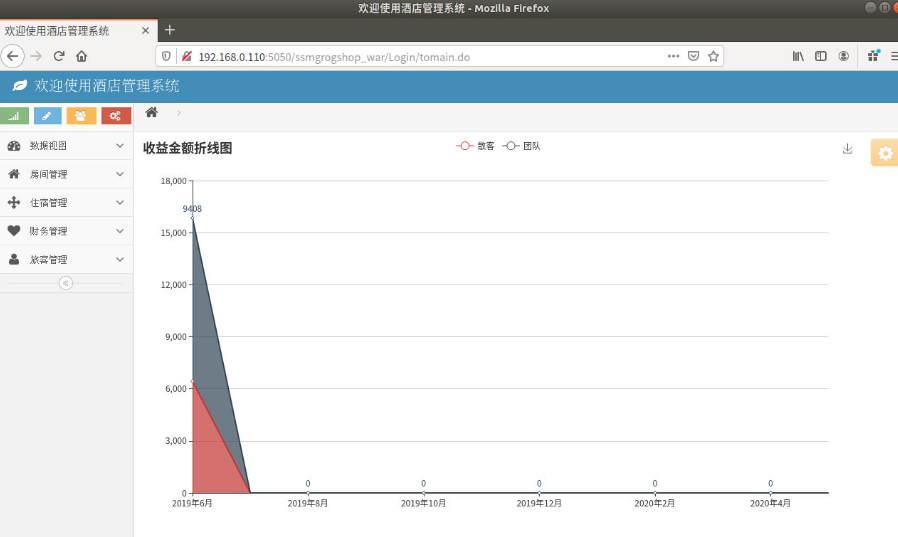

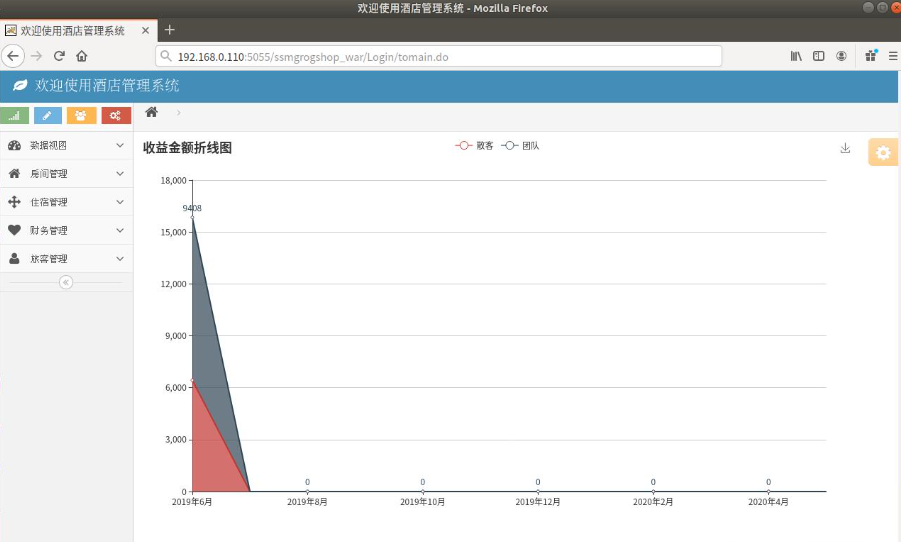

(5)测试tomcat服务器负载均衡

http://主机ip地址:5050/ssmgrogshop_war

http://主机ip地址:5055/ssmgrogshop_war

(6)数据库操作

增加房间

三、使用Docker搭建大数据集群环境

(1)搭建hadoop环境

树形结构

├── Dockerfile

├── build

│ └── hadoop-3.1.3.tar.gz

└── sources.list

Dockerfile

#Base images 基础镜像

FROM ubuntu:18.04

#MAINTAINER 维护者信息

MAINTAINER y00

COPY ./sources.list /etc/apt/sources.list

sourse.list

# 默认注释了源码镜像以提高 apt update 速度,如有需要可自行取消注释

deb http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal main restricted universe multiverse

# deb-src http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal main restricted universe multiverse

deb http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-updates main restricted universe multiverse

# deb-src http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-updates main restricted universe multiverse

deb http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-backports main restricted universe multiverse

# deb-src http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-backports main restricted universe multiverse

deb http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-security main restricted universe multiverse

# deb-src http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-security main restricted universe multiverse

# 预发布软件源,不建议启用

# deb http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-proposed main restricted universe multiverse

# deb-src http://mirrors.tuna.tsinghua.edu.cn/ubuntu/ focal-proposed main restricted universe multiverse

运行容器

docker build -t ubuntu:18.04 .

docker run -it --name ubuntu ubuntu:18.04

(2)容器初始化

各种安装

apt-get update

apt-get install vim # 用于修改配置文件

apt-get install ssh # 分布式hadoop通过ssh连接

/etc/init.d/ssh start # 开启sshd服务器

vim ~/.bashrc # 在文件末尾添加/etc/init.d/ssh start,实现ssd开机自启

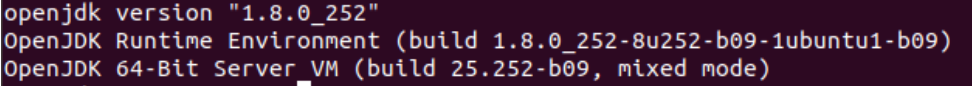

安装jdk

apt-get install openjdk-8-jdk

安装hadoop

docker cp ./build/hadoop-3.1.3.tar.gz 容器ID:/root/hadoop-3.1.3.tar.gz

cd /root

tar -zxvf hadoop-3.1.3.tar.gz -C /usr/local

配置环境

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64/

export PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/usr/local/hadoop-3.1.3

export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib

export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin:$JAVA_HOME/bin

使环境生效

source ~/.bashrc # 使.bashrc生效

验证安装成功

java -version

hadoop version

(3)配置hadoop集群

进入配置目录

cd /usr/local/hadoop-3.1.3/etc/hadoop

hadoop-env.sh

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64/ # 在任意位置添加

core-site.xml

<?xml version="1.0" encoding="UTF-8" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop-3.1.3/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

</configuration>

hdfs-site.xml

<?xml version="1.0" encoding="UTF-8" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop-3.1.3/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop-3.1.3/tmp/dfs/data</value>

</property>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

</configuration>

mapred-site.xml

<?xml version="1.0" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.1.3</value>

</property>

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.1.3</value>

</property>

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.1.3</value>

</property>

</configuration>

yarn-site.xml

<?xml version="1.0" ?>

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>Master</value>

</property>

<!--虚拟内存和物理内存比,不加这个模块程序可能跑不起来-->

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.5</value>

</property>

</configuration>

进入脚本目录

cd /usr/local/hadoop-3.1.3/sbin

对于start-dfs.sh和stop-dfs.sh文件,添加下列参数

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

对于start-yarn.sh和stop-yarn.sh,添加下列参数

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=root

(4)构建镜像

docker commit 容器ID ubuntu/hadoop

(5)利用构建好的镜像运行主机

开启三个终端分别运行

第一个终端

docker run -it -h master --name master ubuntu/hadoop

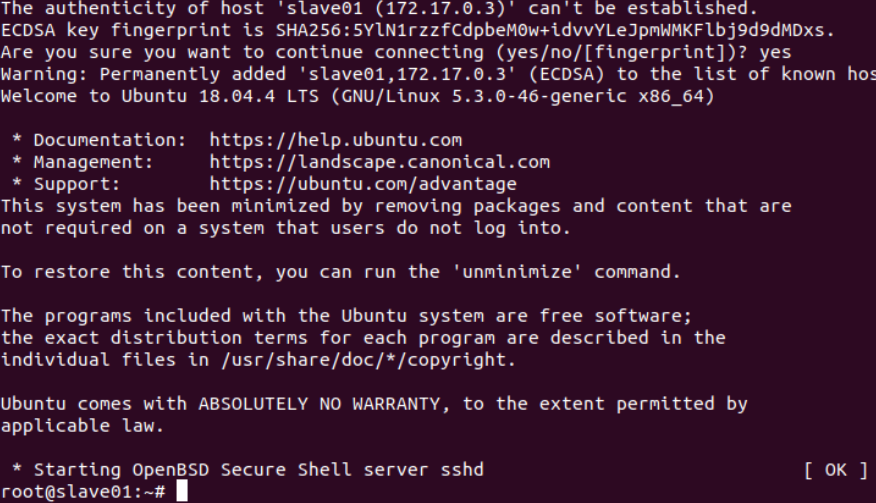

第二个终端

docker run -it -h slave01 --name slave01 ubuntu/hadoop

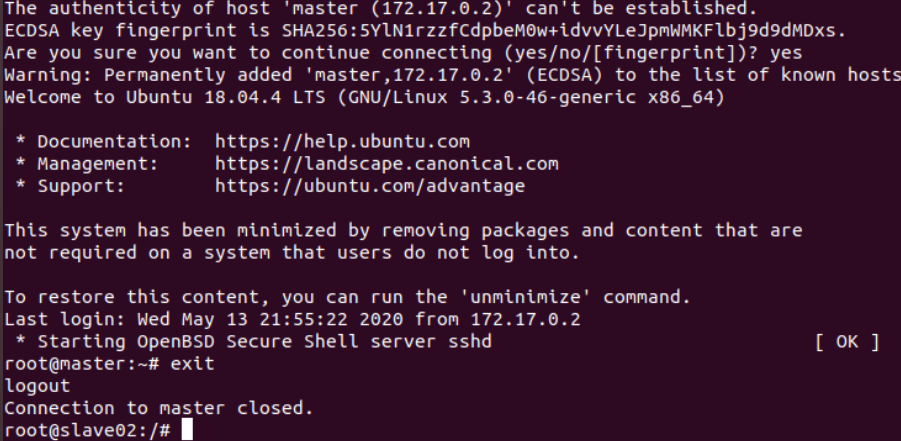

第三个终端

docker run -it -h slave02 --name slave02 ubuntu/hadoop

分别修改/etc/hosts

(根据自己实际情况来改)

172.17.0.2 master

172.17.0.3 slave01

172.17.0.4 slave02

测试ssh

开启服务

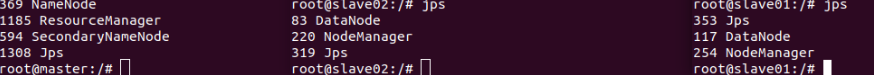

master上运行:

start-dfs.sh

start-yarn.sh

jps查看服务是否开启成功

运行hadoop示例程序

第一次使用先格式化文件系统

hdfs namenode -format # 格式化文件系统

grep测试

hdfs dfs -mkdir -p /user/root/input #新建input文件夹

hdfs dfs -put /usr/local/hadoop-3.1.3/etc/hadoop/*s-site.xml input #将部分文件放入input文件夹

hadoop jar /usr/local/hadoop-3.1.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar grep input output 'dfs[a-z.]+' #运行示例程序grep

hdfs dfs -cat output/* #查看运行结果

###hdfs dfs -rm root #删除上一次运行的输入和输出

hdfs dfs -mkdir -p /user/root/input #新建input文件夹

vim txt1.txt #在当前目录下新建txt1.txt

vim txt2.txt #在当前目录下新建txt2.txt

hdfs dfs -put ./*.txt input #将新建的文本文件放入input文件夹

hadoop jar /usr/local/hadoop-3.1.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount input output #运行示例程序wordcount

hdfs dfs -cat output/* #查看运行结果

心得体会

就是前几次作业下载了太多东西,就开始给虚拟机扩容,结果刚做完第一个实验,虚拟就开不起来,就越弄越糊涂,后来重装了一个,花了一点时间。

还有一个是踩了很多坑在第三个实验上,就是在做那个大数据集成的时候运行脚本后四个服务如果有没跑起来的,可以通过查看hadoop3.2.1/logs下对应服务的日志来定位错误。一般看最下面一个的Caused By就行。

应该多看日志。