论文阅读:Unifying Large Language Model and Knowledge Graph:A RoadMap

1 Introduction

大模型和知识图谱结合的综述。

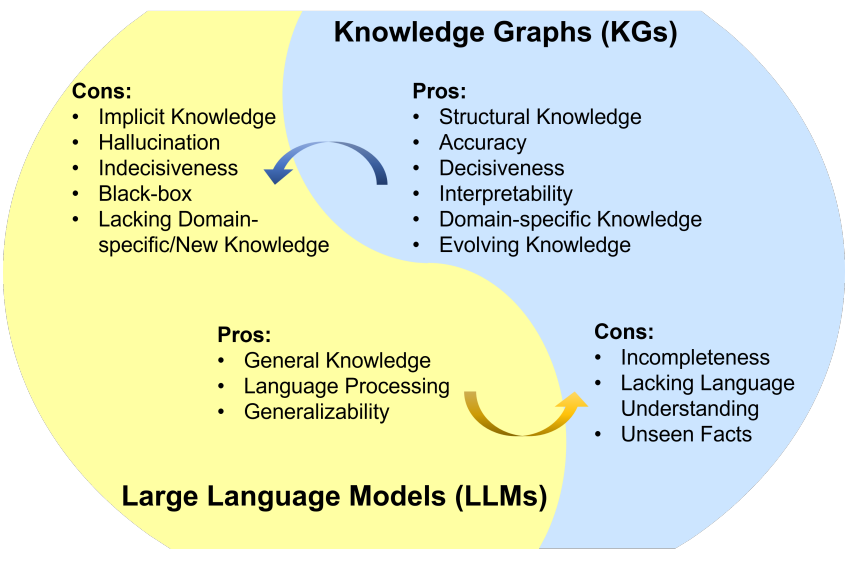

简单介绍一下大模型和知识图谱的优缺点:

如上所示。

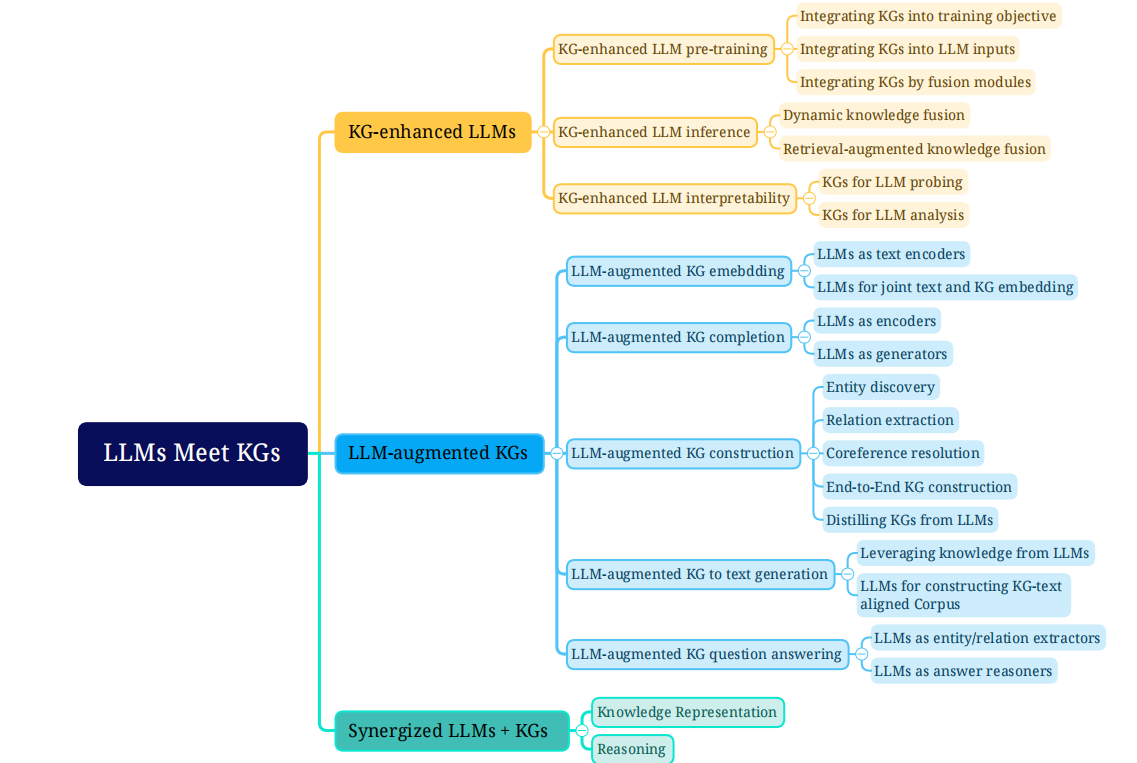

本文主要划分为三个模块,分别为:

- KG-enhanced LLMs

- LLM-augmented KGs

- Synergized LLM + KG

2 Background

主要介绍了LLM和KG

2.1 Large Language Model(LLMs)

主要依靠transformer和注意力机制

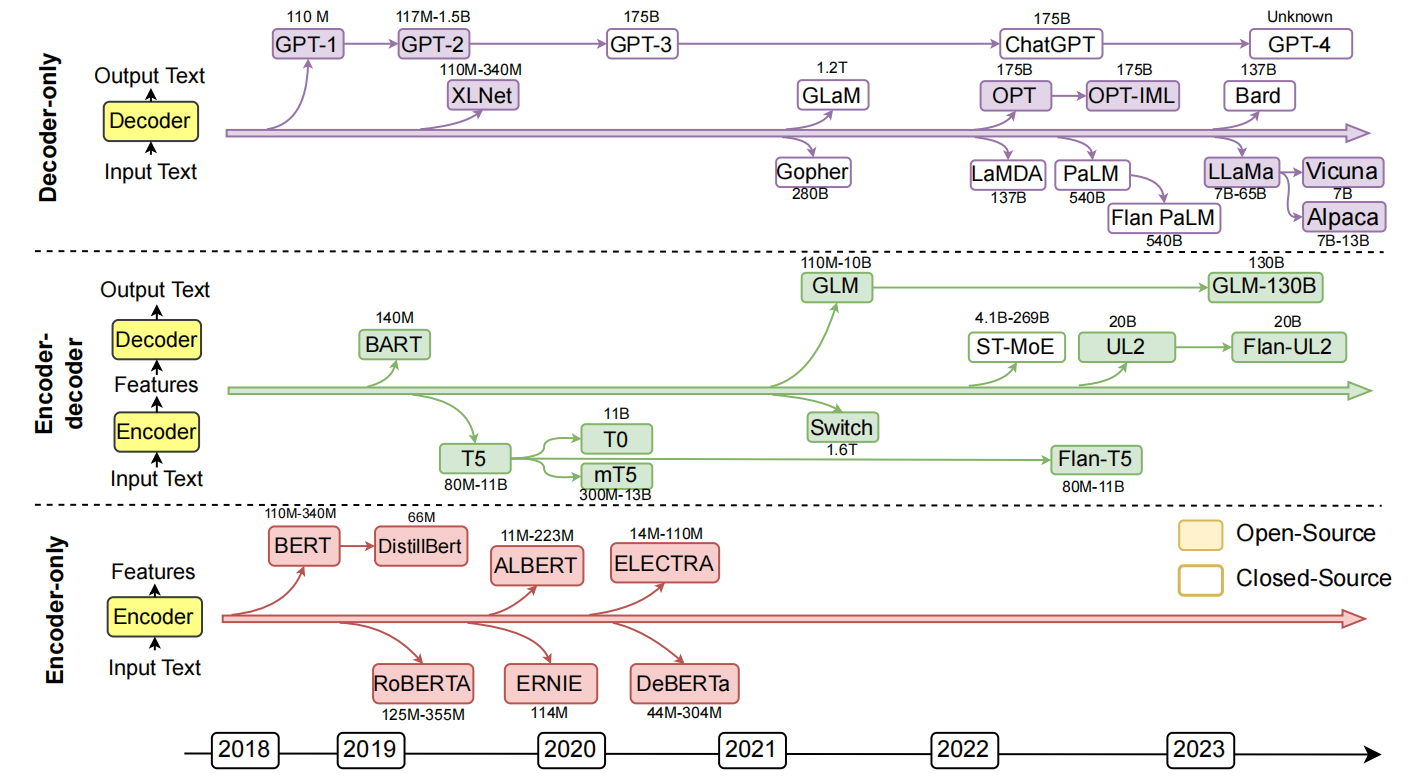

分类如上所示。

LLM根据结构分类如下:

2.1.1 Encoder-only LLMs

主要根据输入句子来预测mask words。

主要应用在文本分类,实体识别领域。

2.1.2 Encoder-decoder LLMs

将输入文本编码至隐藏层,再生成目标文本。

主要应用在总结、翻译和问答系统

2.1.3 Decoder-only LLMs

仅生成目标文本,最先进的模型一般都是这类

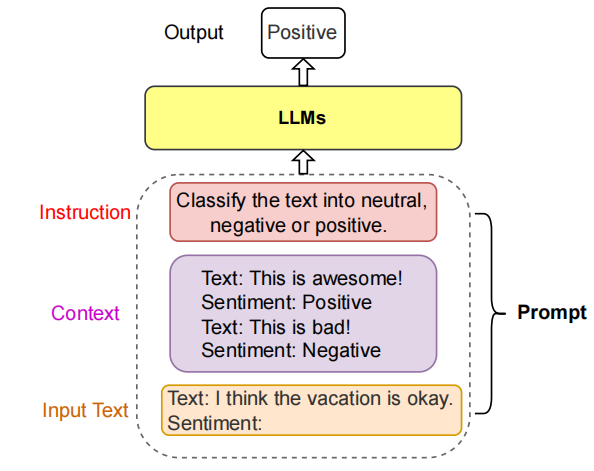

2.2 Prompt Engineering

创造和重定义prompts来最大化LLMs的性能

一些比较先进的工作:

Chain-of-thought(CoT)使得大模型实现复杂推理。

Autmatic prompt engineer(APE)自动生成prompt提升LLMs的性能

2.3 Knowledge Graphs(KGs)

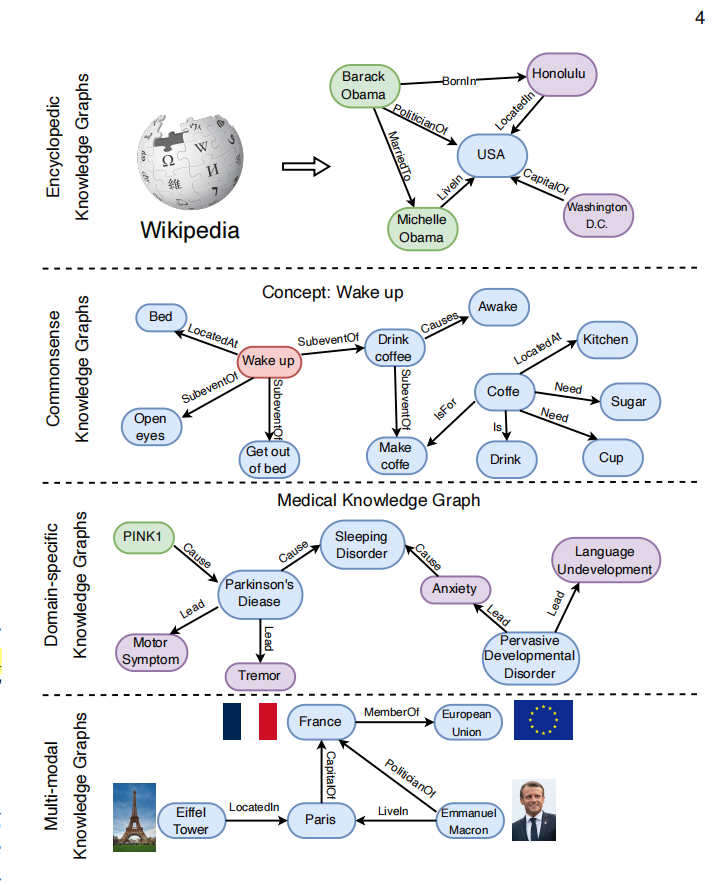

根据存储信息的不同主要划分为4类:

分别为百科全书式、常识性、特定领域、多模态的知识图谱。

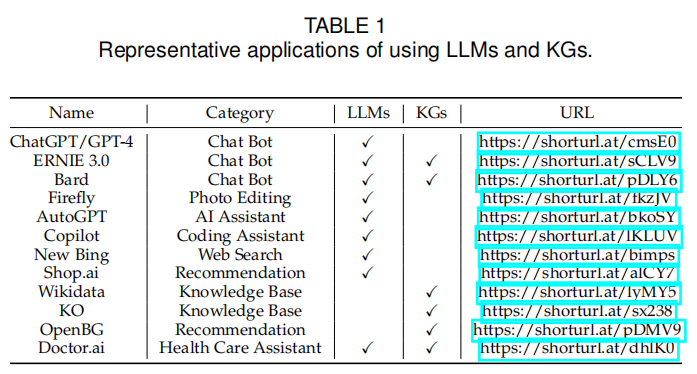

一些常用的应用如上所示。

3 Roadmap & Categorization

主要分为如上几个方面。

接下来详细讲述KG如何和LLM结合

4 KG-enhanced LLMs

4.1 KG-enhanced LLM Pre-training

KGs进行大模型预训练主要分为如下三个方面:

本文来自博客园,作者:zjz2333,转载请注明原文链接:https://www.cnblogs.com/zjz2333/p/17780118.html