特征值和特征向量

将学习到什么

特征值和特征向量的定义,多角度理解其意义,以及相关重要性质。

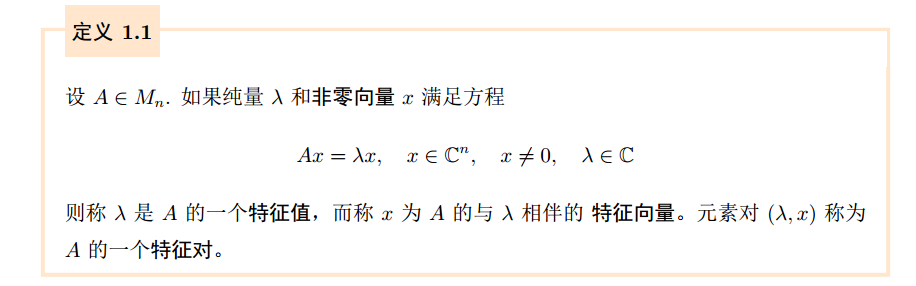

从定义出发

第一步扔出定义

需要注意的是特征向量必须非零,而特征值可以为零。对于对角矩阵 \(D = \mathrm{diag}(d_1,d_2,\cdots,d_n)\),显然标准基 \(e_i,\, i=1,2,\cdots,n\) 就是 \(D\) 的特征向量,而 \(e_i\) 对应和特征值就是 \(d_i\).

从线性方程组的角度

定义的式子可以改写为齐次线性方程组:\(\lambda x-Ax=(\lambda I -A)x=0\),如果该方程组有非平凡解,那么 \(\lambda\) 就是 \(A\) 的一个特征值,且 \(\lambda I-A\) 就是奇异的。相反,如果 \(\lambda \in \mathbb{C}\) 且 \(\lambda I-A\) 是奇异的,那么就存在非零向量 \(x\),使得 $(\lambda I -A)x =0 $,即 \((\lambda,x)\) 是一个特征对。

如果 \((\lambda,x)\) 是一个特征对,给定非零纯量 \(c\), \((\lambda,cx)\) 也是一个特征对,通常情况下,我们取 \(c= 1 / \lVert x \rVert _2\),即标准化特征向量为单位向量:\(\xi=cx\),值得一提的是,标准化情况下特征向量也并不唯一,\((\lambda,\mathrm{e}^{\mathrm{i}\theta}\xi),\,\forall \theta \in \mathbb{R}\) 都是 \(A\) 的特征值-特征向量对。

从代数的角度

特征向量恰好是这样的非零向量:用 \(A\) 来表示与纯量 \(\lambda\) 相乘有相同的结果。

从代数基本定理出发

实系数或者复系数 \(k\) 次多项式

\begin{align}

p(t)=a_k t^k +a_{k-1}t^{k-1}+\cdots+a_1 t+a_0, \quad a_k \neq 0

\label{ppp}

\end{align}

此表达式可以拓展到给定的方阵上,即

\begin{align}

p(A)=a_k A^k +a_{k-1}A^{k-1}+\cdots+a_1 A+a_0, \quad a_k \neq 0

\end{align}

通用约定 \(A^0=I\), \(k\) 次多项式 \ref{ppp} 中,如果 \(a_k=1\),那就被说成是首一的,由于 \(a_k \neq 0\),故而 \(a_k^{-1}p(t)\) 总是首一的。

由代数基本定理知,次数为 \(k \geqslant 1\) 的任何首一多项式 \ref{ppp} 可以表示成恰好 \(k\) 个复的或者实的线性因子的乘积

\begin{align}

p(t)=(t-\alpha_1)\cdots(t-\alpha_k)

\end{align}

\(p(t)\) 的这个表达式除了因子的排列顺序外是唯一的,由此可知一个次数 \(k \geqslant 1\) 的多项式至多有 \(k\) 个不同的零点,因为有因子可能会重复。因子 \((t-a_j)\) 重复的次数就是 \(\alpha_j\) 作为 \(p(t)\) 零点的重数。

类似,下面给出 \(p(A)\) 的分解式

\begin{align}

p(A)=(A-\alpha_1 I)\cdots(A-\alpha_k I)

\end{align}

于是 \(p(A)\) 的特征值与 \(A\) 的特征值以一种简单的方式联系在一起。

证明: 我们有

\begin{align*}

p(A)x=a_kAkx+a_{k-1}Ax+\cdots+a_1Ax+a_0 x, \quad a_k \neq 0

\end{align*}

重复应用特征值-特征向量方程又有 \(A^jx=A^{j-1}Ax=A^{j-1}\lambda x=\lambda A^{j-1}x=\cdots=\lambda^j x\). 从而

\[

p(A)x=a_k \lambda^kx+\cdots+a_0 x=(a_k\lambda^k+\cdots+a_0)x=p(\lambda)x

\]

反过来,如果 \(\mu\) 是 \(p(A)\) 的一个特征值,那么 \(p(A)-\mu I\) 是奇异的。由于 \(p(t)\) 的次数 \(k\geqslant 1\),故而多项式 \(q(t)=p(t)-\mu\) 的次数 \(k \geqslant 1\),我们就可以将它分解成 \(q(t)=(t-\beta_1)\cdots(t-\beta_k)\) (对某些复数或者实数 \(\beta_1,\cdots,\beta_k\)). 由于 \(p(A)-\mu I=q(A)=(A-\beta_1 I)\cdots (A-\beta_k I)\) 是奇异的,故而它的某个因子 \(A-\beta_j I\) 是奇异的,这就意味着 \(\beta_j\) 是 \(A\) 的特征值。但是 \(0=q(\beta_j)=p(\beta_j)-\mu\),所以有 \(\mu=p(\beta_j)\).

这个性质非常重要,比如,如果 \(\sigma(A)=\{-1,1\}\),那么我们立马可以断定 \(\sigma(A^2)=\{1\}\). 但是对于特征向量不一样,考虑矩阵 \(A=\begin{bmatrix} 0&1 \\ 0&0\end{bmatrix}\),显然 \((0, e_1)\) 是 \(A\) 和 \(A^2\) 的特征对,\(e_2\) 是 \(A^2\) 的特征向量却不是 \(A\) 的特征向量,这也就是定理逆命题部分只提到了 \(p(A)\) 特征值的原因。

几个重要性质

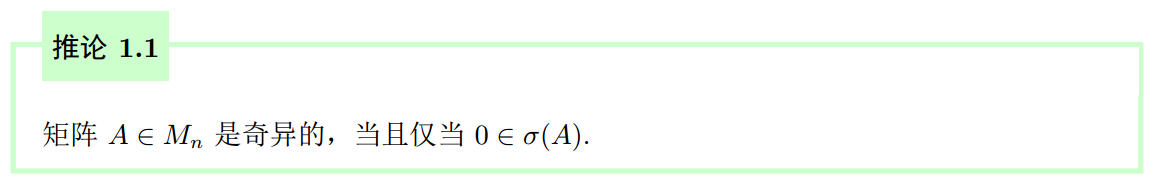

**证明:** 矩阵 $A$ 是奇异的,当且仅当对某个 $x\neq 0$ 有 $Ax=0$. 而这当且仅当对某个 $x \neq 0$ 有 $Ax = 0x$,也就是当且仅当 $\lambda =0 $ 是 $A$ 的特征值时才发生。

**证明:** 矩阵 $A$ 是奇异的,当且仅当对某个 $x\neq 0$ 有 $Ax=0$. 而这当且仅当对某个 $x \neq 0$ 有 $Ax = 0x$,也就是当且仅当 $\lambda =0 $ 是 $A$ 的特征值时才发生。

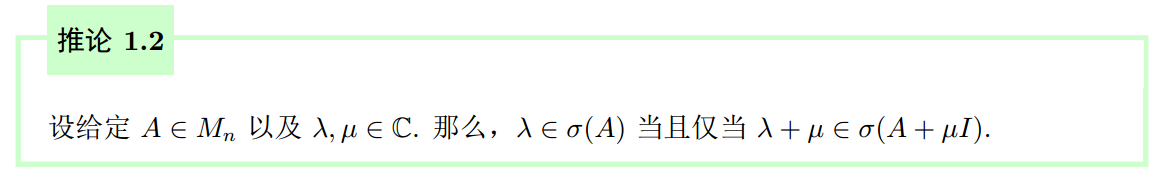

**证明:** 如果 $\lambda \in \sigma(A)$,则存在一个非零向量 $x$,使得 $Ax=\lambda x$,从而 $(A+\mu I)x=Ax+\mu x=\lambda x+ \mu x=(\lambda+\mu)x$. 于是 $\lambda + \mu \in \sigma(A+\mu I)$. 反过来,如果 $\lambda + \mu \in \sigma(A+\mu I)$,则存在非零向量 $y$,使得 $Ay+\mu y=(A+\mu I)y=(\lambda+\mu)y=\lambda y+\mu y$. 于是 $Ay=\lambda y$, 从而 $\lambda \in \sigma(A)$.

**证明:** 如果 $\lambda \in \sigma(A)$,则存在一个非零向量 $x$,使得 $Ax=\lambda x$,从而 $(A+\mu I)x=Ax+\mu x=\lambda x+ \mu x=(\lambda+\mu)x$. 于是 $\lambda + \mu \in \sigma(A+\mu I)$. 反过来,如果 $\lambda + \mu \in \sigma(A+\mu I)$,则存在非零向量 $y$,使得 $Ay+\mu y=(A+\mu I)y=(\lambda+\mu)y=\lambda y+\mu y$. 于是 $Ay=\lambda y$, 从而 $\lambda \in \sigma(A)$.

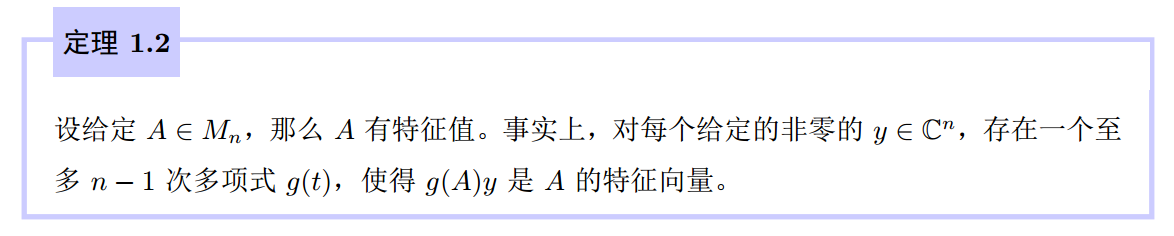

**证明:** 设 $m$ 是使得向量 $y,Ay,A^2 y,\cdots,A^k y$ **线性相关的最小整数** $k$. 那么有 $m \geqslant 1$(由于 $y \neq 0$),且有 $m \leqslant n$(由于 $\mathbb{C}^n$ 中任意 $n+1$ 个向量都是线性相关的)。设 $a_0,a_1,\cdots,a_m$ 是不完全为零的纯量,它们使得

\begin{align}

a_mA^my+a_{m-1}A^{m-1}y+\cdots+a_1Ay+a_0y=0

\label{aaa}

\end{align}

如果 $a_m=0$,那么式 \ref{aaa} 蕴含向量 $y,Ay,A^2 y,\cdots,A^k y$ 线性相关,这与 $m$ 的最小性矛盾,于是 $a_m \neq 0$,我们可以考虑多项式 $p(t)=t^m+(a_{m-1}/a_m)t^{m-1}+\cdots+(a_1/a_m)t+(a_0/a_m)$. 恒等式 \ref{aaa} 确保 $p(A)y=0$,所以 $(0,y)$ 是 $p(A)$ 的一个特征对,定理 $1.1$ 就确保 $p(t)$ 的 $m$ 个零点中有一个是 $A$ 的特征值。

假设 $\lambda$ 是 $p(t)$ 的一个零点,它是 $A$ 的一个特征值,分解 $p(t)=(t-\lambda)g(t)$,其中 $g(t)$ 是一个 $m-1$ 次多项式。如果 $g(A)y=0$,则 $m$ 的最小性再次出现矛盾,所以 $g(A)y \neq 0$。但是 $0=p(A)y=(A-\lambda I)(g(A)y)$,所以非零向量 $g(A)y$ 是 $A$ 的一个与特征值 $\lambda$ 相伴的特征向量。

上述定理表明了**每个复矩阵都有非空的谱**,对给定的 $A\in M_n$ 可以求得一个次数最多为 $n$ 的多项式,它**至少有一个零点**是 $A$ 的特征值。

**证明:** 设 $m$ 是使得向量 $y,Ay,A^2 y,\cdots,A^k y$ **线性相关的最小整数** $k$. 那么有 $m \geqslant 1$(由于 $y \neq 0$),且有 $m \leqslant n$(由于 $\mathbb{C}^n$ 中任意 $n+1$ 个向量都是线性相关的)。设 $a_0,a_1,\cdots,a_m$ 是不完全为零的纯量,它们使得

\begin{align}

a_mA^my+a_{m-1}A^{m-1}y+\cdots+a_1Ay+a_0y=0

\label{aaa}

\end{align}

如果 $a_m=0$,那么式 \ref{aaa} 蕴含向量 $y,Ay,A^2 y,\cdots,A^k y$ 线性相关,这与 $m$ 的最小性矛盾,于是 $a_m \neq 0$,我们可以考虑多项式 $p(t)=t^m+(a_{m-1}/a_m)t^{m-1}+\cdots+(a_1/a_m)t+(a_0/a_m)$. 恒等式 \ref{aaa} 确保 $p(A)y=0$,所以 $(0,y)$ 是 $p(A)$ 的一个特征对,定理 $1.1$ 就确保 $p(t)$ 的 $m$ 个零点中有一个是 $A$ 的特征值。

假设 $\lambda$ 是 $p(t)$ 的一个零点,它是 $A$ 的一个特征值,分解 $p(t)=(t-\lambda)g(t)$,其中 $g(t)$ 是一个 $m-1$ 次多项式。如果 $g(A)y=0$,则 $m$ 的最小性再次出现矛盾,所以 $g(A)y \neq 0$。但是 $0=p(A)y=(A-\lambda I)(g(A)y)$,所以非零向量 $g(A)y$ 是 $A$ 的一个与特征值 $\lambda$ 相伴的特征向量。

上述定理表明了**每个复矩阵都有非空的谱**,对给定的 $A\in M_n$ 可以求得一个次数最多为 $n$ 的多项式,它**至少有一个零点**是 $A$ 的特征值。

读完应该知道什么

- 特征向量必须非零,而特征值无此要求

- 如果 \((\lambda, x)\) 是 \(A \in M_n\) 的一个特征对,那么 \((p(\lambda) , x)\) 就是 \(p(A)\) 的一个特征对. 反过来,如果 \(k \geqslant 1\) 且 \(\mu\) 是 \(p(A)\) 的一个特征值,那么就存在 \(A\) 的某个特征值 \(\lambda\) 使得 \(\mu = p(\lambda)\). 此时对特征向量不成立

- 矩阵 \(A \in M_n\) 是奇异的,当且仅当 \(0 \in \sigma(A)\)

- 设给定 \(A \in M_n\) 以及 \(\lambda, \mu \in \mathbb{C}\). 那么,\(\lambda \in \sigma(A)\) 当且仅当 \(\lambda + \mu \in \sigma(A+\mu I)\)

- 每个复矩阵都有非空的谱

- 给定的 \(A\in M_n\) 可以求得一个次数最多为 \(n\) 的多项式,它至少有一个零点是 \(A\) 的特征值

写在最后的话

在这里用 Markdown 编辑时

- 空出一行用

- 空出一格用

,要空出两格就用两遍 - 分割线用

---,并且前后行用回车键隔开

浙公网安备 33010602011771号

浙公网安备 33010602011771号