论文笔记——SQUEEZENET ALEXNET-LEVEL ACCURACY WITH 50X FEWER PARAMETERS AND <0.5MB MODEL SIZE

论文地址:https://arxiv.org/abs/1602.07360

模型地址:https://github.com/DeepScale/SqueezeNet

1. 论文思想

提出一种新的卷积组合方式替代原来的3*3的卷积。类似于bottleneck layer减少参数数目。但是不太像MobileNet是提出了一种新的卷积计算方式来减少参数,加速计算。

2. 网络结构设计策略

- 用3*3的替代1*1的filter。 (NiN, GoogLeNet)

- 减少3*3的输入channel数目。 (bottleneck layer)

- 延迟下采样(so that convolution layers have large activation maps. (He & Sun)

3. 组合方式

-

squeeze中的1*1的卷积为了减少输入到3*3中的channel数目

-

expand中的1*1和3*3的卷积,也算是一种效果的综合吧。(不能全是3*3的,不然论文就没有什么创新了。不能全是1*1的卷积,估计会影响效果。)

4. 网络结构

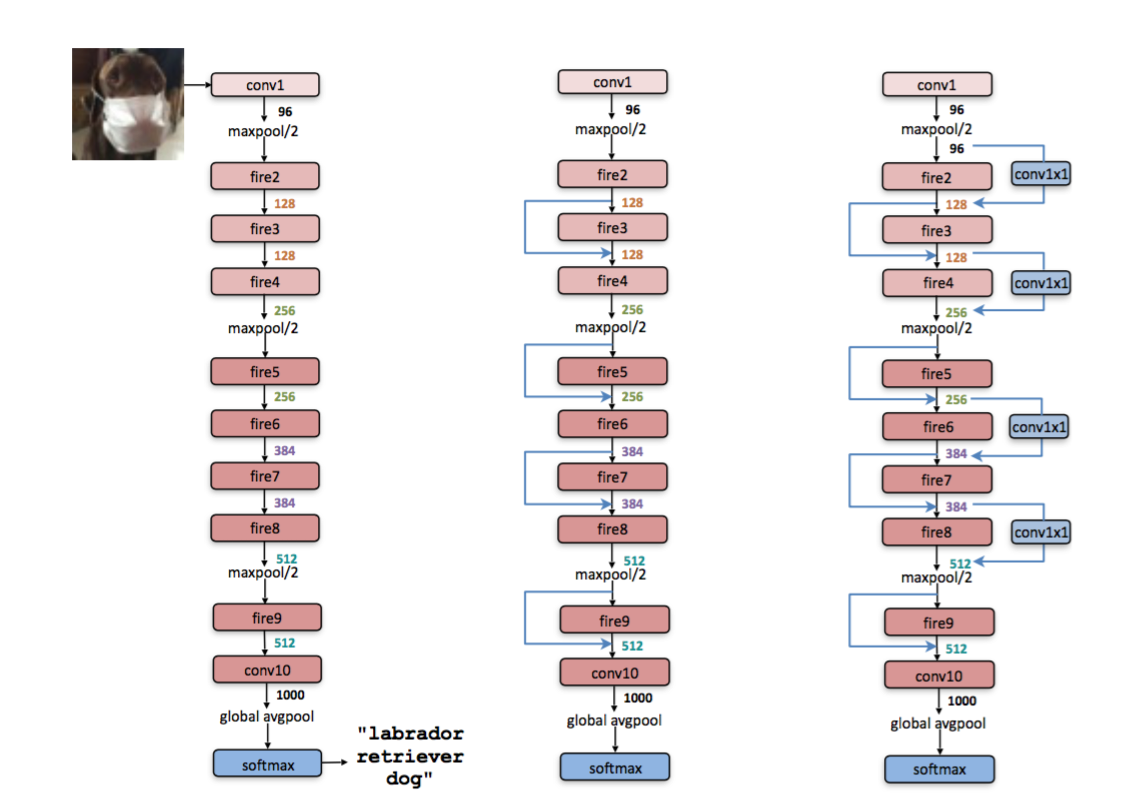

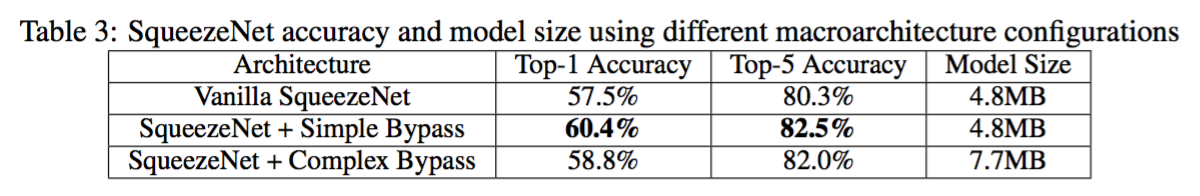

- SqueezeNet

- SqueezeNet with simple bypass(类似于ResNet,因为要做加操作,要求两个输入的channel num一样,所以只能在某些层加bypass)

- SqueezeNet with complex bypass(添加1*1的卷积,打破上面那个限制)

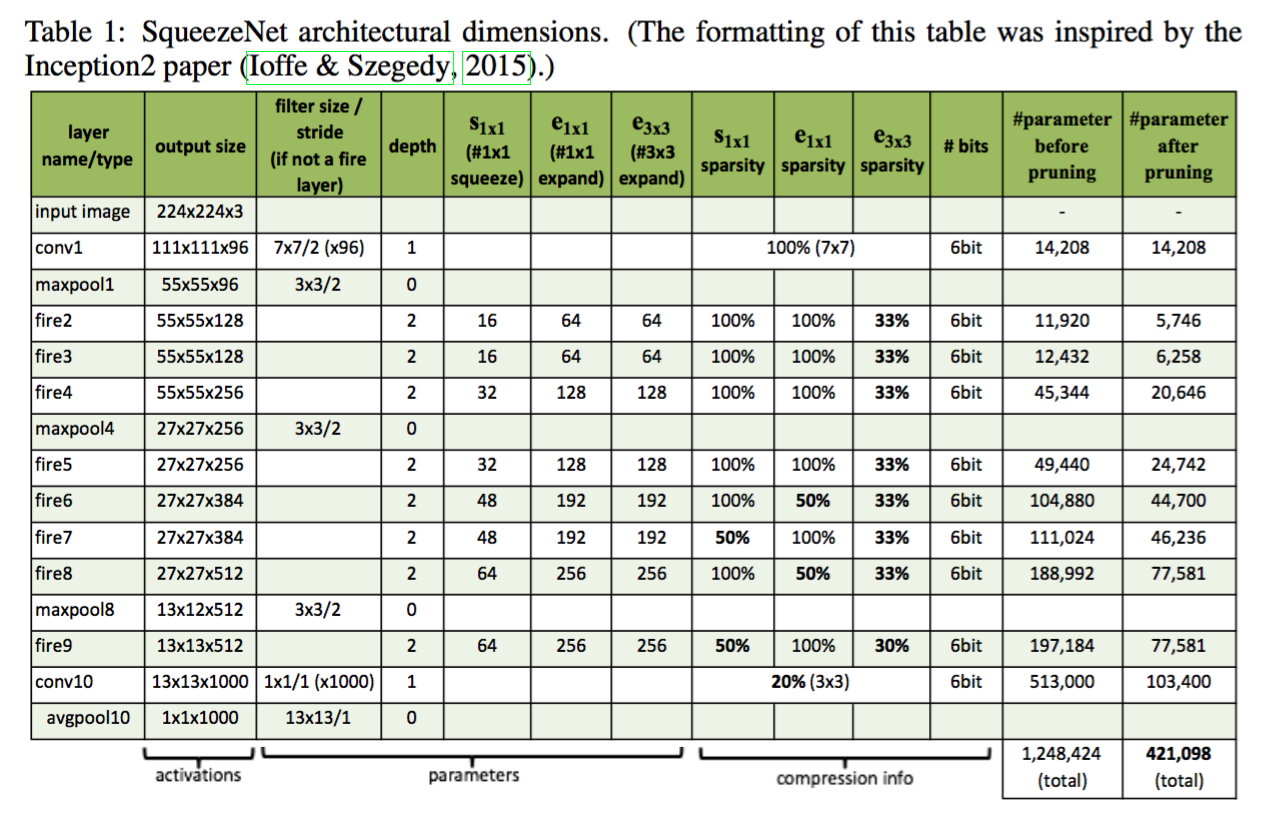

- compression info 应用的是Deep compression里面的稀疏性和量化的方法。

5. 组合方式探索

-

探索了几个超参数不同组合方式对网络大小以及准确率的影响。

-

结果

6. 总结

- 在AlexNet上实现了50x的缩减,模型大小小于0.5MB。

- 探索较深网络的时候,可以尝试这种方法。

- 又是一篇在1*1的卷积上做工作的文章。(MobileNet, ShuffleNet)