Flink 本地单机/Standalone集群/YARN模式集群搭建(Linux系统)

准备工作

本文简述 Flink在 Linux中安装步骤,和示例程序的运行。需要安装 JDK1.8 及以上版本。

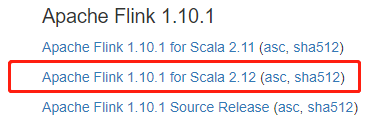

下载地址:下载Flink 的二进制包 https://flink.apache.org/downloads.html

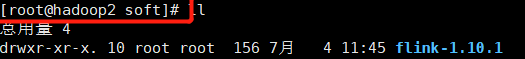

解压 flink-1.10.1-bin-scala_2.12.tgz ,我这里解压到 soft 目录

[root@hadoop1 softpackage]# tar -zxvf flink-1.10.1-bin-scala_2.12.tgz -C ../soft/

单节点安装

解压后进入Flink的 bin 目录执行如下脚本即可

1 [root@hadoop1 bin]# ./start-cluster.sh 2 Starting cluster. 3 Starting standalonesession daemon on host hadoop1. 4 Starting taskexecutor daemon on host hadoop1.

进入 Flink 页面看看,如果没有修改配置中的端口,默认是8081

集群安装

集群安装分为以下几步:(注意:hadoopx 都是我配置了 /etc/hosts 域名的)bin

【1】将hadoop1 中解压的 Flink 分发到其他机器上,同时我也配置了免密登录SSH(也可以手动复制low)。xsync链接

[root@hadoop1 soft]# xsync flink-1.10.1

执行完后,我们就可以在 hadoop2和 hadoop3中看到 flink

jobmanager.rpc.address = master主机名

【3】修改 master 的conf/slaves 提供集群中所有节点的列表,这些列表将用作工作节点。我的是 hadoop2和 hadoop3。类似于 HDFS配置,编辑文件 conf / slaves并输入每个辅助节点的IP /主机名。每个工作节点稍后都将运行 TaskManager。

hadoop2

hadoop3

以上示例说明了具有三个节点(主机名hadoop1作为master,hadoop2 和 hadoop3 作为 worker)的设置,并显示了配置文件的内容。Flink目录必须在同一路径下的每个工作线程上都可用。您可以使用共享的 NFS(网络文件系统)目录,也可以将整个Flink目录复制到每个工作节点。特别是:

- 每个JobManager的可用内存量(

jobmanager.heap.size), - 每个TaskManager的可用内存量(

taskmanager.memory.process.size并查看内存设置指南), - 每台计算机可用的CPU数(

taskmanager.numberOfTaskSlots), - 集群中的CPU总数(

parallelism.default) - 临时目录(

io.tmp.dirs)

【4】在 master上启动集群(第一行)以及执行结果。下面的脚本在本地节点上启动JobManager,并通过SSH连接到slaves文件中列出的所有辅助节点,以在每个节点上启动 TaskManager。现在,您的 Flink系统已启动并正在运行。现在,在本地节点上运行的 JobManager将在配置的 RPC端口上接受作业。要停止Flink,还有一个 stop-cluster.sh脚本。

1 [root@hadoop1 flink-1.10.1]# bin/start-cluster.sh 2 Starting cluster. 3 Starting standalonesession daemon on host hadoop1. 4 Starting taskexecutor daemon on host hadoop2. 5 Starting taskexecutor daemon on host hadoop3.

【5】Flink 界面展示 :进入8081端口,例如:http://hadoop1:8081/ 或者通过 jps命令查看服务也可行。

Standalone集群架构展示:client客户端提交任务给JobManager,JobManager负责 Flink集群计算资源管理,并分发任务给TaskManager执行,TaskManager定期向JobManager汇报状态。

运行 flink示例程序

批处理示例:提交 Flink的批处理 examples程序:也可以在页面中进行提交,但是作为一名NB的程序员就使用命令

1 [root@hadoop1 flink-1.10.1]# bin/flink run examples/batch/WordCount.jar

执行上面的命令后,就会显示如下信息,这是 Flink提供的examples下的批处理例子程序,统计单词个数。

1 [root@hadoop1 flink-1.10.1]# bin/flink run examples/batch/WordCount.jar 2 Executing WordCount example with default input data set. 3 Use --input to specify file input. 4 Printing result to stdout. Use --output to specify output path. 5 Job has been submitted with JobID 99f4c579947a66884ec269ddf5f5b0ed 6 Program execution finished 7 Job with JobID 99f4c579947a66884ec269ddf5f5b0ed has finished. 8 Job Runtime: 795 ms 9 Accumulator Results: 10 - b70332353f355cf0464b0eba21f61075 (java.util.ArrayList) [170 elements] 11 12 13 (a,5) 14 (action,1) 15 (after,1) 16 (against,1) 17 (all,2) 18 (and,12) 19 (arms,1) 20 (arrows,1) 21 (awry,1) 22 (ay,1) 23 (bare,1) 24 (be,4) 25 (bear,3) 26 (bodkin,1) 27 (bourn,1) 28 (but,1) 29 (by,2) 30 (calamity,1) 31 (cast,1) 32 (coil,1) 33 (come,1) 34 (conscience,1) 35 (consummation,1) 36 (contumely,1) 37 (country,1) 38 (cowards,1) 39 (currents,1) 40 ......

得到结果,这里统计的是默认的数据集,可以通过--input --output指定输入输出。我们可以在页面中查看运行的情况:

流处理示例:启动nc服务器:

[root@hadoop1 flink-1.10.1]# nc -lk 9000

提交 Flink的批处理 examples程序:

[root@hadoop1 flink-1.10.1]# bin/flink run examples/streaming/SocketWindowWordCount.jar --hostname hadoop1 --port 9000

这是 Flink提供的 examples下的流处理例子程序,接收 socket数据传入,统计单词个数。在nc端随意写入单词

1 [root@hadoop1 flink-1.10.1]# nc -lk 9000 2 g 3 s

进入slave 节点(hadoop2,hadoop3),进入Flink 安装目录输入如下命令,查看实时数据变化

1 [root@hadoop2 flink-1.10.1]# tail -f log/flink-*-taskexecutor-*.out 2 s : 1 3 : 2 4 w : 1 5 d : 1 6 g : 1 7 d : 1

停止Flink

[root@hadoop1 flink-1.10.1]# bin/stop-cluster.sh

在 Flink的 web中查看运行的 job

将 JobManager / TaskManager 实例添加到集群(扩展)

您可以使用bin/jobmanager.sh 和 bin/taskmanager.sh 脚本将 JobManager和 TaskManager实例添加到正在运行的集群中。添加JobManager(确保在要启动/停止相应实例的主机上调用这些脚本)

[root@hadoop1 flink-1.10.1]# bin/jobmanager.sh ((start|start-foreground) [host] [webui-port])|stop|stop-all

添加任务管理器

[root@hadoop1 flink-1.10.1]# bin/taskmanager.sh start|start-foreground|stop|stop-all

YARN模式

在企业中,经常需要将 Flink集群部署到YARN,因为可以使用 YARN来管理所有计算资源。而且 Spark程序也可以部署到 YARN上。CliFrontend是所有 job的入口类,通过解析传递的参数(jar包,mainClass等),读取 flink的环境,配置信息等,封装成PackagedProgram,最终通过 ClusterClient提交给Flink集群。Flink运行在 YARN上,提供了两种方式:

第一种使用 yarn-session模式来快速提交作业到 YARN集群。如下,在Yarn 中初始化一个 flink集群,开辟指定的资源,以后提交任务都向这里提交,这个flink集群会常驻在 Yarn集群中,除非手动停止。共享Dispatcher与ResourceManager,共享资源。有大量的小作业,适合使用这种方式;

1 <property> 2 <name>yarn.nodemanager.vmem-check-enabled</name> 3 <value>false</value> 4 </property>

【2】 添加环境变量

1 //查看是否配置HADOOP_CONF_DIR,我这里没有配置输出为空 2 [root@hadoop1 hadoop-2.7.2]# echo $HADOOP_CONF_DIR 3 4 //在系统变量中添加 HADOOP_CONF_DIR 5 [root@hadoop1 hadoop-2.7.2]# vim /etc/profile 6 //添加如下内容,wq保存退出 7 export HADOOP_CONF_DIR=$HADOOP_HOME/conf/ 8 //刷新 /etc/profile 9 [root@hadoop1 hadoop-2.7.2]# source /etc/profile 10 11 //重新查看是否配置HADOOP_CONF_DIR 12 [root@hadoop1 hadoop-2.7.2]# echo $HADOOP_CONF_DIR 13 /opt/module/hadoop-2.7.2/conf/

【3】启动HDFS、YARN集群。通过 jps 查看启动状况。关闭flink的其他集群。

1 [root@hadoop1 hadoop-2.7.2]# sbin/start-all.sh 2 [root@hadoop2 hadoop-2.7.2]# jps 3 10642 NodeManager 4 11093 Jps 5 10838 ResourceManager 6 10535 DataNode 7 10168 TaskManagerRunner

【4】将官方指定Pre-bundled Hadoop 2.7.5包放到 flink的lib目录下。使用 yarn-session模式提交作业

使用 Flink中的 yarn-session(yarn客户端),会启动两个必要服务 JobManager 和 TaskManagers;

客户端通过 yarn-session提交作业;

yarn-session会一直启动,不停地接收客户端提交的作用。

-n 表示申请2个容器

-s 表示每个容器启动多少个slot

-tm 表示每个TaskManager申请800M内存

-nm yarn 的 appName,

-d detached表示以后台程序方式运行

如下表示启动一个 yarn session 集群,每个JM为1G,TM的内存是1G。

[root@hadoop1 flink-1.10.1]# bin/yarn-session.sh -n 2 -jm 1024m -tm 1024m -d

客户端默认是 attach模式,不会退出 。可以 ctrl+c 退出,然后再通过如下命令连上来。或者启动的时候用 -d 则为 detached模式

./bin/yarn-session.sh -id application_1594027553009_0001(这个id来自下面hadoop集群)

JobManager Web Interface: http://hadoop1:34431

然后我们可以通过 jps 来看下当前的进程,其中YarnSessionClusterEntrypoint就是我们Yarn Session的分布式集群。

1 [root@hadoop1 flink-1.10.1]# jps 2 69923 NodeManager 3 81267 Jps 4 69394 NameNode 5 69531 DataNode 6 80571 FlinkYarnSessionCli 7 80765 YarnSessionClusterEntrypoint

/tmp 下生成了一个文件

将Flink应用部署到Flink On Yarn 之 session 方式中。

[root@hadoop1 flink-1.10.1]# bin/flink run -d examples/streaming/WordCount.jar

查看运行结果:

Flink On Yarn 之 session部署方式集群停止:关闭Yarn 就会关闭Flink集群。。。

第二种模式:使用Per-JOBYarn分离模式(与当前客户端无关,当客户端提交完任务就结束,不用等到Flink应用执行完毕)提交作业:每次提交都会创建一个新的flink集群,任务之间相互独立,互不影响,方便管理。任务执行完成之后创建的集群也会消失。 直接提交任务给YARN,独享 Dispatcher与ResourceManager。按需要申请资源。适合执行时间较长的大作业。

1 [root@hadoop1 flink-1.10.1]# bin/flink run -m yarn-cluster -d ./examples/streaming/WordCount.jar 2 2020-07-13 03:21:50,479 WARN org.apache.flink.yarn.cli.FlinkYarnSessionCli - The configuration directory ('/usr/local/soft/flink-1.10.1/conf') already contains a LOG4J config file.If you want to use logback, then please delete or rename the log configuration file. 3 2020-07-13 03:21:50,479 WARN org.apache.flink.yarn.cli.FlinkYarnSessionCli - The configuration directory ('/usr/local/soft/flink-1.10.1/conf') already contains a LOG4J config file.If you want to use logback, then please delete or rename the log configuration file. 4 Executing WordCount example with default input data set. 5 Use --input to specify file input. 6 Printing result to stdout. Use --output to specify output path. 7 2020-07-13 03:21:50,707 INFO org.apache.hadoop.yarn.client.RMProxy - Connecting to ResourceManager at hadoop2/192.168.52.129:8032 8 2020-07-13 03:21:50,791 INFO org.apache.flink.yarn.YarnClusterDescriptor - No path for the flink jar passed. Using the location of class org.apache.flink.yarn.YarnClusterDescriptor to locate the jar 9 2020-07-13 03:21:50,928 WARN org.apache.flink.yarn.YarnClusterDescriptor - Neither the HADOOP_CONF_DIR nor the YARN_CONF_DIR environment variable is set. The Flink YARN Client needs one of these to be set to properly load the Hadoop configuration for accessing YARN. 10 2020-07-13 03:21:51,001 INFO org.apache.flink.yarn.YarnClusterDescriptor - Cluster specification: ClusterSpecification{masterMemoryMB=1024, taskManagerMemoryMB=1728, slotsPerTaskManager=1} 11 2020-07-13 03:21:53,906 INFO org.apache.flink.yarn.YarnClusterDescriptor

-yn:yarncontainer 表示 TaskManager 的个数;

-yqu:yarnqueue 指定yarn 的队列;

-ys:yarnslots 每一个 TaskManager对应的 slot个数;

上传成功之后,我们可以在Hadoop的图形化界面:http://hadoop2:8088/cluster/apps 中看到当前任务的信息;