作业12 13-垃圾邮件分类2

1.读取

2.数据预处理

3.数据划分—训练集和测试集数据划分

from sklearn.model_selection import train_test_split

x_train,x_test, y_train, y_test = train_test_split(data, target, test_size=0.2, random_state=0, stratify=y_train

#3、数据划分 def split_dataset(data, label): x_train, x_test, y_train, y_test = train_test_split(data, label, test_size=0.2, random_state=0, stratify=label) return x_train, x_test, y_train, y_test

4.文本特征提取

sklearn.feature_extraction.text.CountVectorizer

sklearn.feature_extraction.text.TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf2 = TfidfVectorizer()

观察邮件与向量的关系

向量还原为邮件

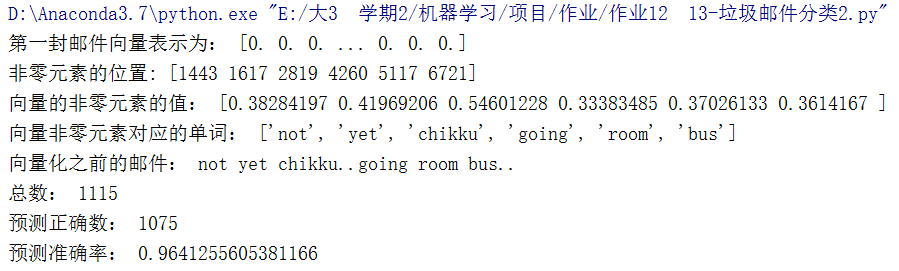

#4文本特征提取: # 把原始文本转化为tf-idf的特征矩阵 def tfidf_dataset(x_train, x_test): tfidf = TfidfVectorizer() X_train = tfidf.fit_transform(x_train) # X_train用fit_transform生成词汇表 X_test = tfidf.transform(x_test) # X_test要与X_train词汇表相同,因此在X_train进行fit_transform基础上进行transform操作 return X_train, X_test, tfidf # 把向量还原邮件 def re_mail(x_train, X_train, model): s = X_train.toarray()[0] print("第一封邮件向量表示为:", s) # 该函数输入一个矩阵,返回扁平化后矩阵中非零元素的位置(index) a = np.flatnonzero(X_train.toarray()[0]) # 非零元素的位置(index) print("非零元素的位置:", a) print("向量的非零元素的值:", s[a]) b = model.vocabulary_ # 词汇表 key_list = [] for key, value in b.items(): if value in a: key_list.append(key) # key非0元素对应的单词 print("向量非零元素对应的单词:", key_list) print("向量化之前的邮件:", x_train[0])

4.模型选择

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

说明为什么选择这个模型?

答:因为不是正态分布数据特征,所以选择MultinomialNB,模型需要根据数据集中特征的特点来进行选取,垃圾邮件分类重点在于文档中单词出现的频率以及文档的重要性,不符合正态分布的特征。

#4、模型选择 def mnb_model(x_train, x_test, y_train, y_test): mnb = MultinomialNB() mnb.fit(x_train, y_train) y_mnb = mnb.predict(x_test) print("总数:", len(y_test)) print("预测正确数:", (y_mnb == y_test).sum()) print("预测准确率:",(y_mnb == y_test).sum()/len(y_test)) return y_mnb

5.模型评价:混淆矩阵,分类报告

from sklearn.metrics import confusion_matrix

confusion_matrix = confusion_matrix(y_test, y_predict)

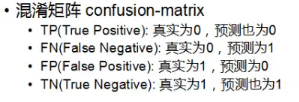

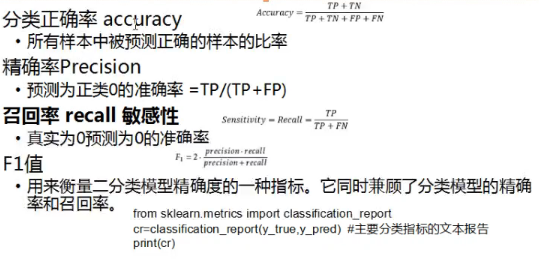

说明混淆矩阵的含义

from sklearn.metrics import classification_report

说明准确率、精确率、召回率、F值分别代表的意义

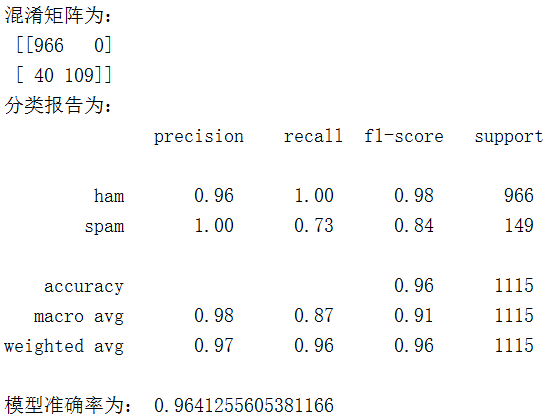

#5、模型评价 def class_report(y_mnb, y_test): cm = confusion_matrix(y_test, y_mnb) print("混淆矩阵为:\n", cm) cr = classification_report(y_test, y_mnb) print("分类报告为:\n", cr) print("模型准确率为:", (cm[0][0] + cm[1][1]) / np.sum(cm))

运行结果如图:

6.比较与总结

如果用CountVectorizer进行文本特征生成,与TfidfVectorizer相比,效果如何?

CountVectorizer:只考虑词汇在文本中出现的频率,属于词袋模型特征。

TfidfVectorizer: 除了考量某词汇在文本出现的频率,还关注包含这个词汇的所有文本的数量。能够削减高频没有意义的词汇出现带来的影响, 挖掘更有意义的特征。属于Tfidf特征。

相比之下,训练文本的数量越少,CountVectorizer这种特征量化方式更有优势