相信很多读者都听说过甚至读过克莱因的《高观点下的初等数学》这套书,顾名思义,这是在学到了更深入、更完备的数学知识后,从更高的视角重新审视过往学过的初等数学,以得到更全面的认知,甚至达到温故而知新的效果。类似的书籍还有很多,比如《重温微积分》、《复分析:可视化方法》等。

回到扩散模型,目前我们已经通过三篇文章从不同视角去解读了DDPM,那么它是否也存在一个更高的理解视角,让我们能从中得到新的收获呢?当然有,《Denoising Diffusion Implicit Models》介绍的DDIM模型就是经典的案例,本文一起来欣赏它。

思路分析 #

在《生成扩散模型漫谈(三):DDPM = 贝叶斯 + 去噪》中,我们提到过该文章所介绍的推导跟DDIM紧密相关。具体来说,文章的推导路线可以简单归纳如下:

这个过程是一步步递进的。然而,我们发现最终结果有着两个特点:

1、损失函数只依赖于;

2、采样过程只依赖于。

也就是说,尽管整个过程是以为出发点一步步往前推的,但是从结果上来看,压根儿就没的事。那么,我们大胆地“异想天开”一下:

高观点1: 既然结果跟无关,可不可以干脆“过河拆桥”,将从整个推导过程中去掉?

DDIM正是这个“异想天开”的产物!

待定系数 #

可能有读者会想,根据上一篇文章所用的贝叶斯定理

没有给定怎么能得到?这其实是思维过于定式了,理论上在没有给定的情况下,的解空间更大,某种意义上来说是更加容易推导,此时它只需要满足边际分布条件:

我们用待定系数法来求解这个方程。在上一篇文章中,所解出的是一个正态分布,所以这一次我们可以更一般地设

其中都是待定系数,而为了不重新训练模型,我们不改变和,于是我们可以列出

其中,并且由正态分布的叠加性我们知道。对比的两个采样形式,我们发现要想成立,只需要满足两个方程

可以看到有三个未知数,但只有两个方程,这就是为什么说没有给定时解空间反而更大了。将视为可变参数,可以解出

或者写成

方便起见,我们约定。特别地,这个结果并不需要限定,不过为了简化参数设置,同时也为了跟以往的结果对齐,这里还是约定。

一如既往 #

现在我们在只给定、的情况下,通过待定系数法求解了的一簇解,它带有一个自由参数。用《生成扩散模型漫谈(一):DDPM = 拆楼 + 建楼》中的“拆楼-建楼”类比来说,就是我们知道楼会被拆成什么样【、】,但是不知道每一步怎么拆【】,然后希望能够从中学会每一步怎么建【】。当然,如果我们想看看每一步怎么拆的话,也可以反过来用贝叶斯公式

接下来的事情,就跟上一篇文章一模一样了:我们最终想要而不是,所以我们希望用

来估计,由于没有改动,所以训练所用的目标函数依然是(除去权重系数),也就是说训练过程没有改变,我们可以用回DDPM训练好的模型。而用替换掉式中的后,得到

这就求出了生成过程所需要的,其中。它的特点是训练过程没有变化(也就是说最终保存下来的模型没有变化),但生成过程却有一个可变动的参数,就是这个参数给DDPM带来了新鲜的结果。

几个例子 #

原则上来说,我们对没有过多的约束,但是不同的采样过程会呈现出不同的特点,我们举几个例子进行分析。

第一个简单例子就是取,其中,相应地有

这就是上一篇文章所推导的DDPM。特别是,DDIM论文中还对做了对比实验,其中。

第二个例子就是取,这也是前两篇文章所指出的的两个选择之一,在此选择下式未能做进一步的化简,但DDIM的实验结果显示此选择在DDPM的标准参数设置下表现还是很好的。

最特殊的一个例子是取,此时从到是一个确定性变换

这也是DDIM论文中特别关心的一个例子,准确来说,原论文的DDIM就是特指的情形,其中“I”的含义就是“Implicit”,意思这是一个隐式的概率模型,因为跟其他选择所不同的是,此时从给定的出发,得到的生成结果是不带随机性的。后面我们将会看到,这在理论上和实用上都带来了一些好处。

加速生成 #

值得指出的是,在这篇文章中我们没有以为出发点,所以前面的所有结果实际上全都是以相关记号给出的,而则是通过和派生出来的记号。从损失函数可以看出,给定了各个,训练过程也就确定了。

从这个过程中,DDIM进一步留意到了如下事实:

高观点2: DDPM的训练结果实质上包含了它的任意子序列参数的训练结果。

具体来说,设是的任意子序列,那么我们以为参数训练一个扩散步数为步的DDPM,其目标函数实际上是原来以的步DDPM的目标函数的一个子集!所以在模型拟合能力足够好的情况下,它其实包含了任意子序列参数的训练结果。

那么反过来想,如果有一个训练好的步DDPM模型,我们也可以将它当成是以为参数训练出来的步模型,而既然是步的模型,生成过程也就只需要步了,根据式有:

这就是加速采样的生成过程了,从原来的步扩散生成变成了步。要注意不能直接将式的换成,因为我们说过是派生记号而已,它实际上等于,因此要换成才对。同理,也不是直接取,而是在将其定义全部转化为符号后,将替换为、替换为,比如式对应的为

可能读者又想问,我们为什么干脆不直接训练一个步的扩散模型,而是要先训练步然后去做子序列采样?笔者认为可能有两方面的考虑:一方面从步生成来说,训练更多步数的模型也许能增强泛化能力;另一方面,通过子序列进行加速只是其中一种加速手段,训练更充分的步允许我们尝试更多的其他加速手段,但并不会显著增加训练成本。

实验结果 #

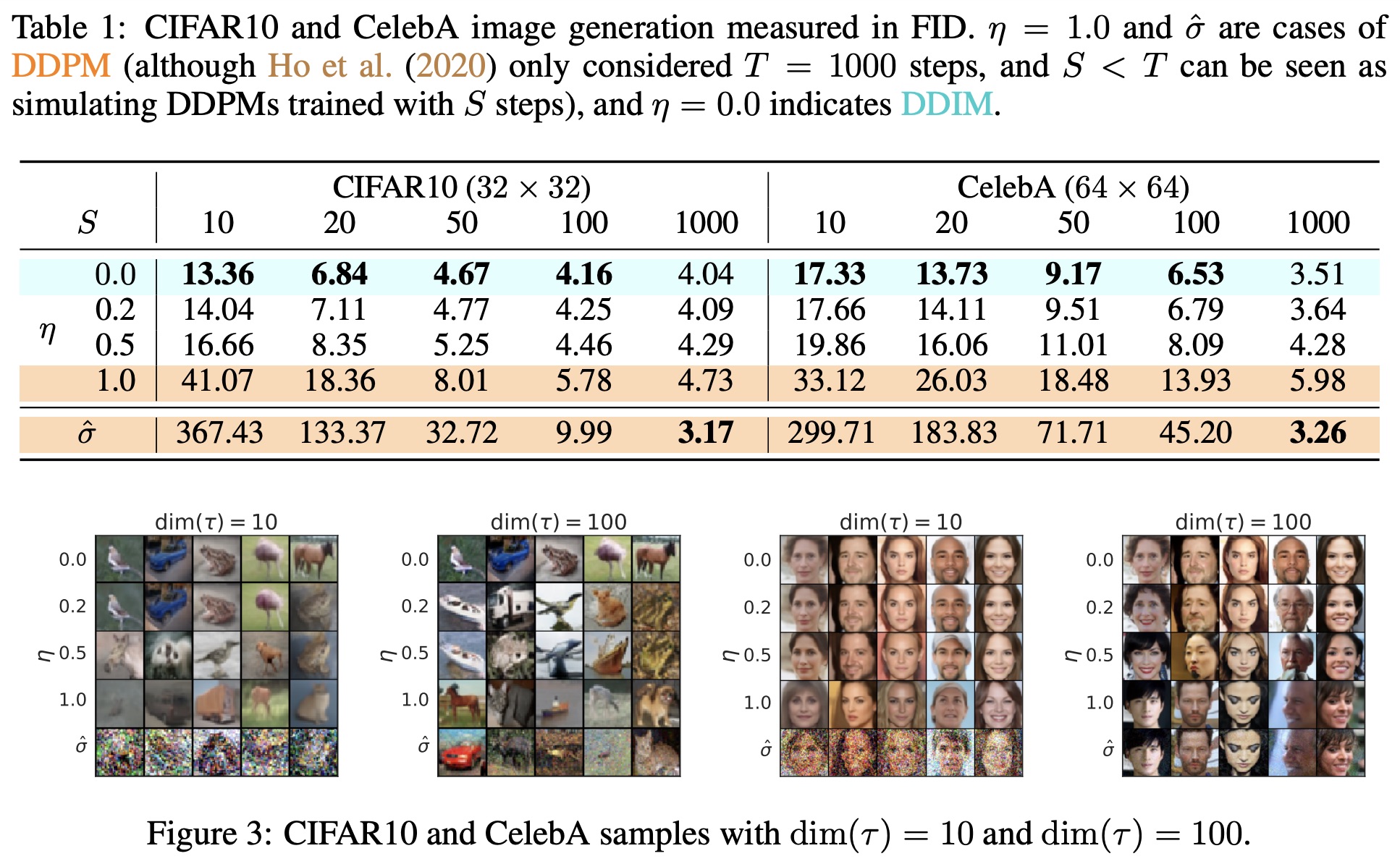

原论文对不同的噪声强度和扩散步数做了组合对比,大致上的结果是“噪声越小,加速后的生成效果越好”,如下图

DDIM的实验结果,显示噪声越小,加速后的生成效果越好

笔者的参考实现如下:

个人的实验结论是:

1、可能跟直觉相反,生成过程中的越小,最终生成图像的噪声和多样性反而相对来说越大;

2、扩散步数越少,生成的图片更加平滑,多样性也会有所降低;

3、结合1、2两点得知,在扩散步数减少时,可以适当缩小,以保持生成图片质量大致不变,这跟DDIM原论文的实验结论是一致的;

4、在较小时,相比可训练的Embedding层,用固定的Sinusoidal编码来表示所生成图片的噪声要更小;

5、在较小时,原论文的U-Net架构(Github中的ddpm2.py)要比笔者自行构思的U-Net架构(Github中的ddpm.py)所生成图片的噪声要更小;

6、但个人感觉,总体来说不带噪声的生成过程的生成效果不如带噪声的生成过程,不带噪声时生成效果受模型架构影响较大。

此外,对于时的DDIM,它就是将任意正态噪声向量变换为图片的一个确定性变换,这已经跟GAN几乎一致了,所以跟GAN类似,我们可以对噪声向量进行插值,然后观察对应的生成效果。但要注意的是,DDPM或DDIM对噪声分布都比较敏感,所以我们不能用线性插值而要用球面插值,因为由正态分布的叠加性,如果,一般就不服从,要改为

插值效果演示(笔者自己训练的模型):

微分方程 #

最后,我们来重点分析一下的情形。此时可以等价地改写成:

当足够大,或者说与足够小时,我们可以将上式视为某个常微分方程的差分形式。特别地,引入虚拟的时间参数,我们得到

不失一般性,假设,其中对应、对应。注意DDIM原论文直接用作为虚拟时间参数,这原则上是不大适合的,因为它的范围是,无界的区间不利于数值求解。

那么现在我们要做的事情就是在给定的情况下,去求解出。而DDPM或者DDIM的迭代过程,对应于该常微分方程的欧拉方法。众所周知欧拉法的效率相对来说是最慢的,如果要想加速求解,可以用Heun方法、R-K方法等。也就是说,将生成过程等同于求解常微分方程后,可以借助常微分方程的数值解法,为生成过程的加速提供更丰富多样的手段。

以DDPM的默认参数、为例,我们重复《生成扩散模型漫谈(一):DDPM = 拆楼 + 建楼》所做的估计

事实上,由于每个都很接近于1,所以上述估计其实也是一个很好的近似。而我们说了本文的出发点是,所以应该以为起点,根据上述近似,我们可以直接简单地取

如果取为参数,那么正好,此时,代入到式化简得

也可以取为参数,此时也有,以及,代入到式化简得

文章小结 #

本文接着上一篇DDPM的推导思路来介绍了DDIM,它重新审视了DDPM的出发点,去掉了推导过程中的,从而获得了一簇更广泛的解和加速生成过程的思路,最后这簇新解还允许我们将生成过程跟常微分方程的求解联系起来,从而借助常微分方程的方法进一步对生成过程进行研究。

转载到请包括本文地址:https://spaces.ac.cn/archives/9181

更详细的转载事宜请参考:《科学空间FAQ》

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 阿里最新开源QwQ-32B,效果媲美deepseek-r1满血版,部署成本又又又降低了!

· 开源Multi-agent AI智能体框架aevatar.ai,欢迎大家贡献代码

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧