(一)变分推断与变分自编码器

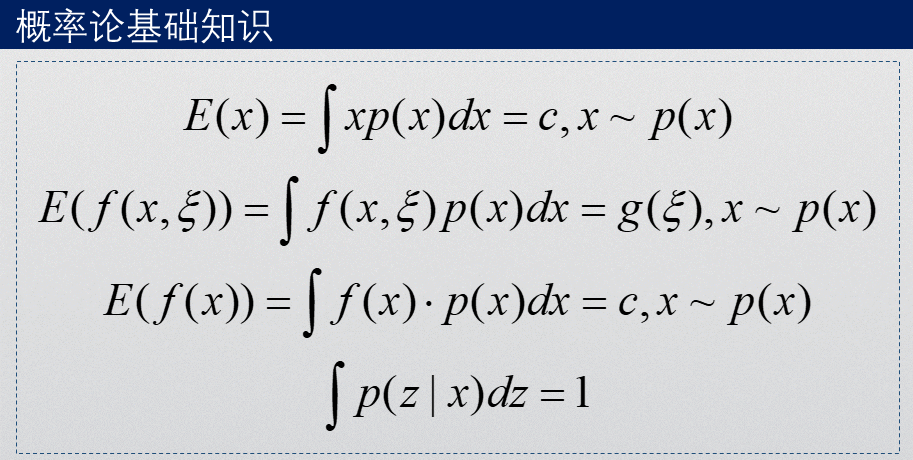

本文主要介绍变分自编码器(Variational Auto-Encoder, VAE)及其推导过程,但变分自编码器涉及一些概率统计的基础知识,因此为了更好地理解变分自编码器,首先介绍变分推断(Variational Inference)与期望最大化(Expectation-Maximization, EM)算法,进而介绍变分自编码器,并给出另一种理解方法(参考文献[3])。

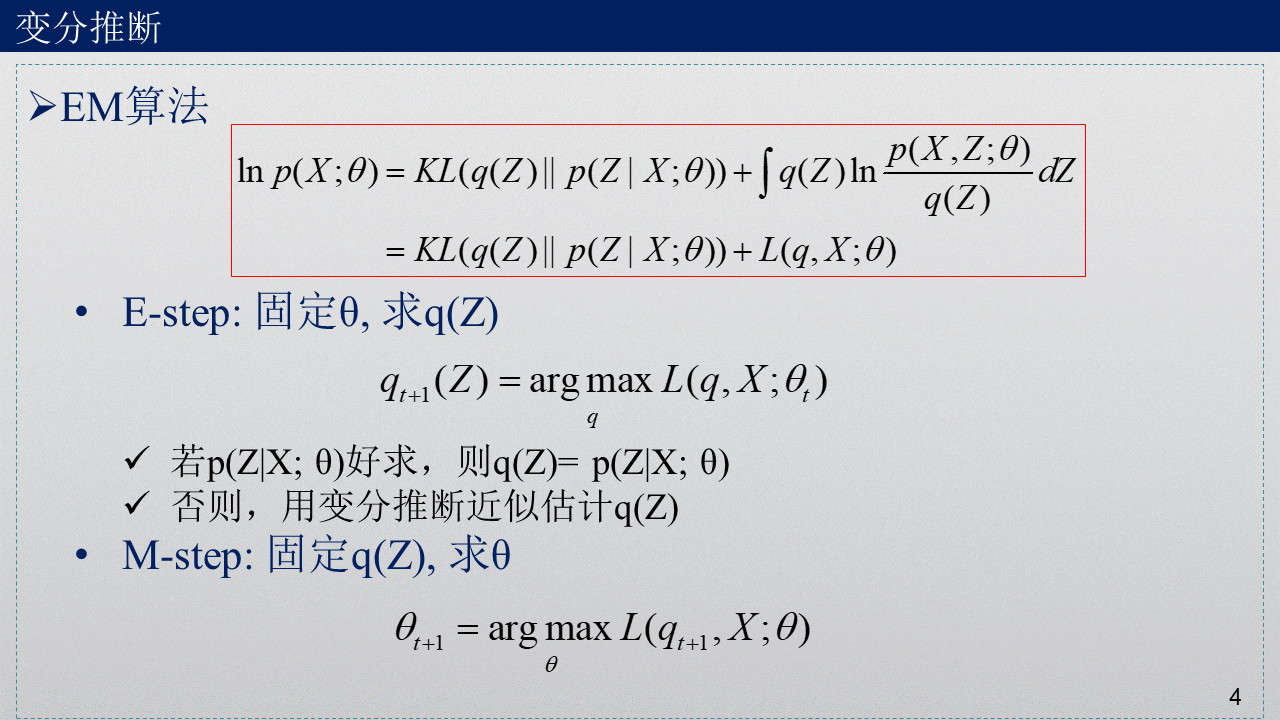

1. 变分推断

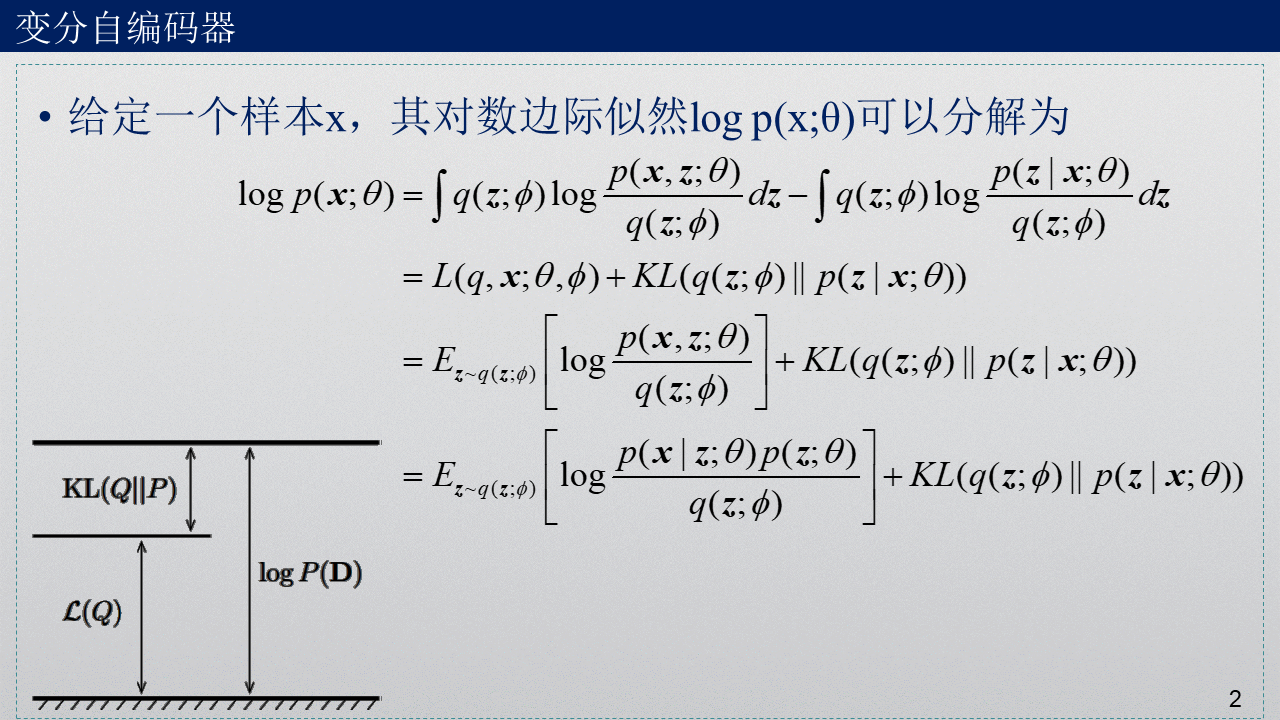

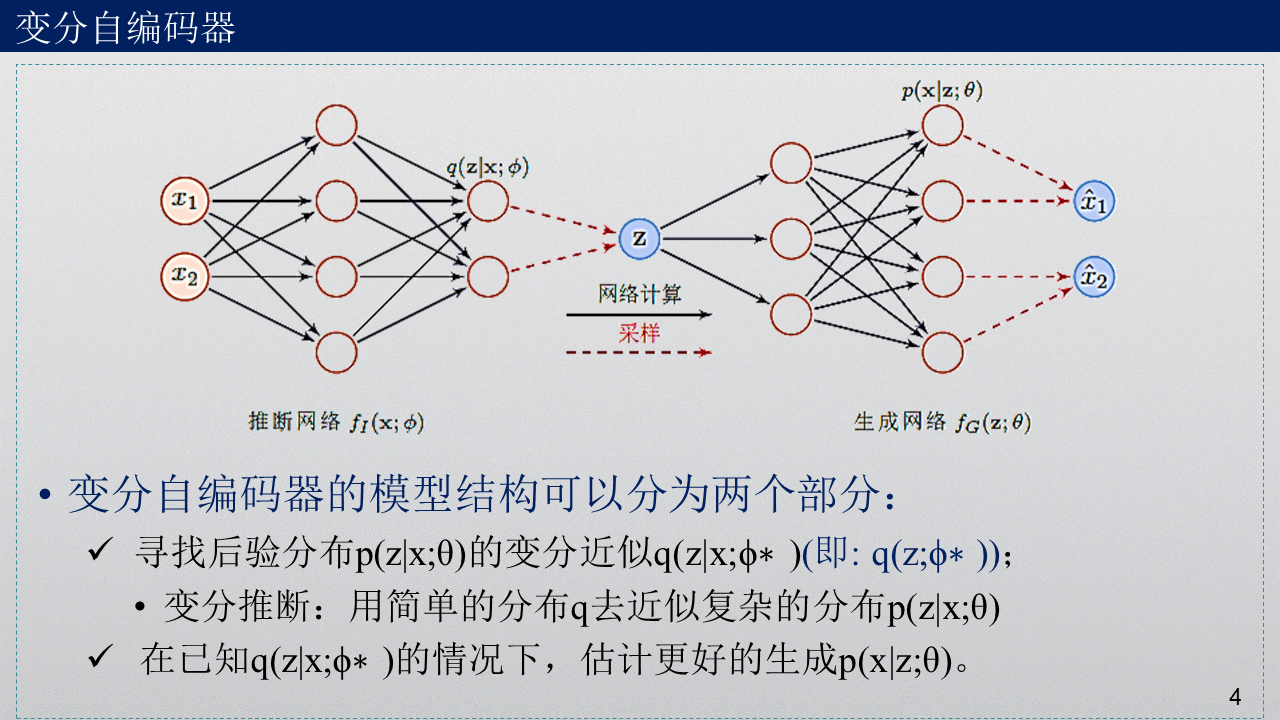

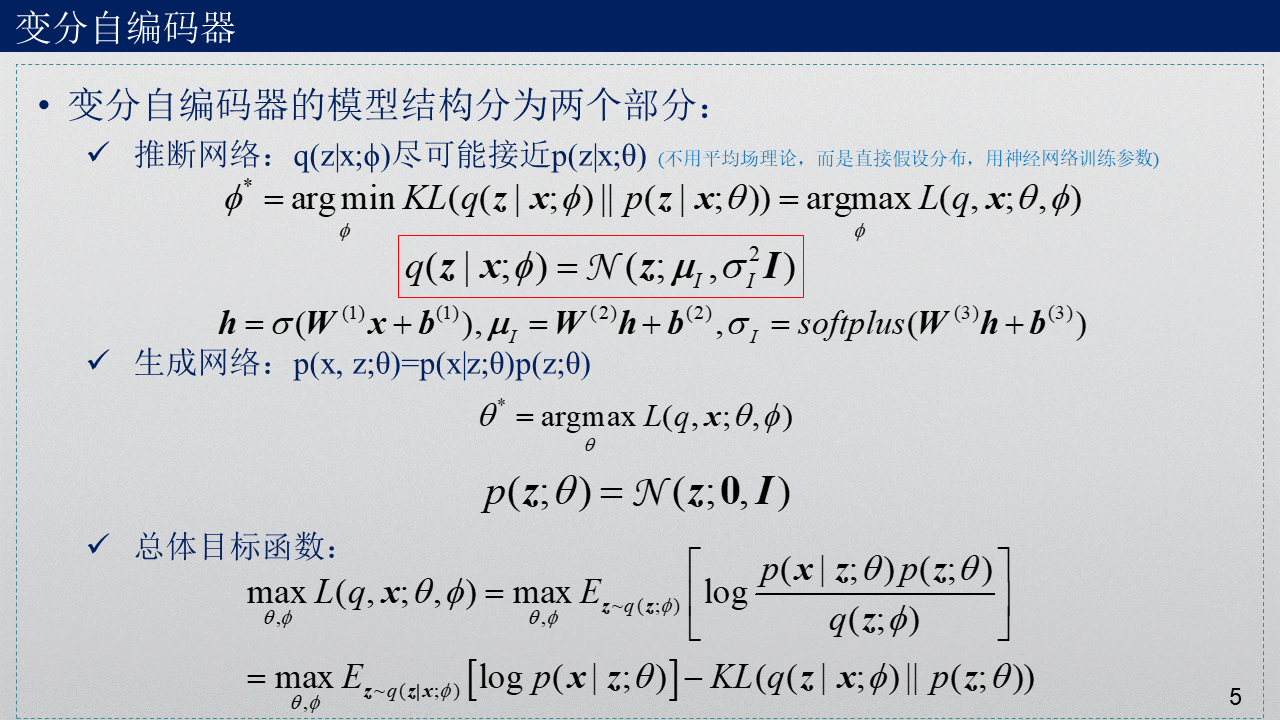

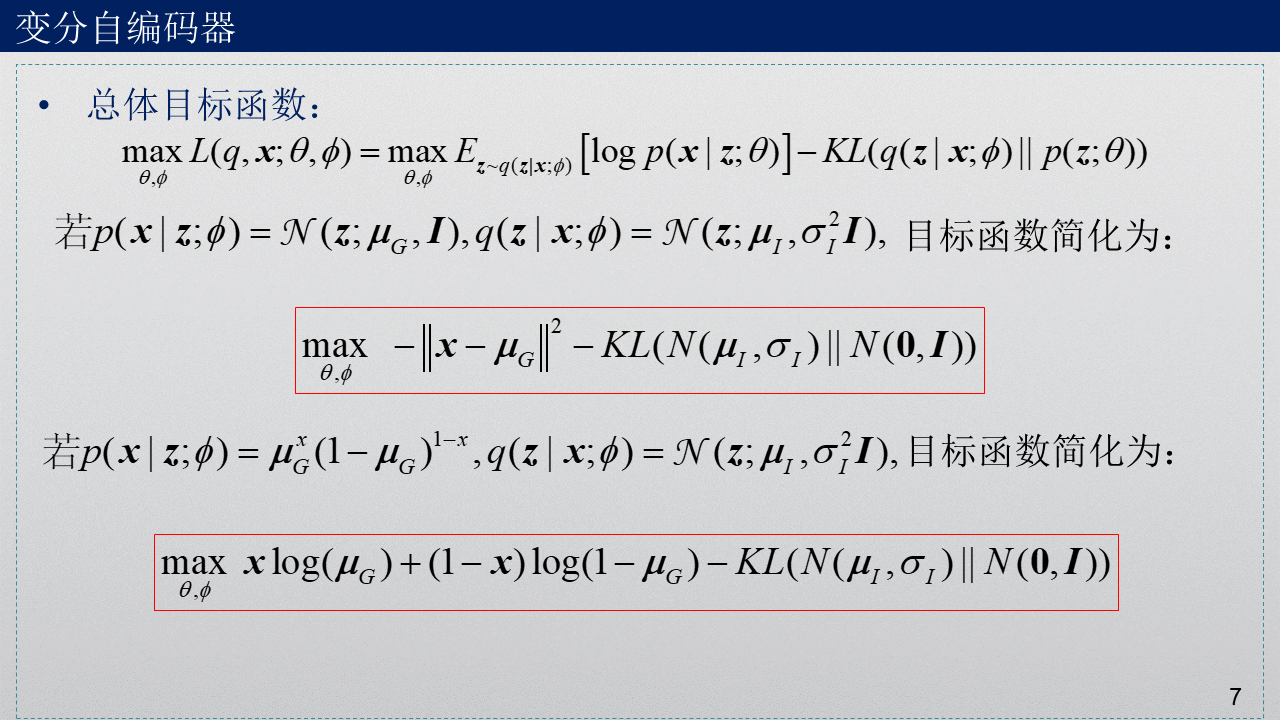

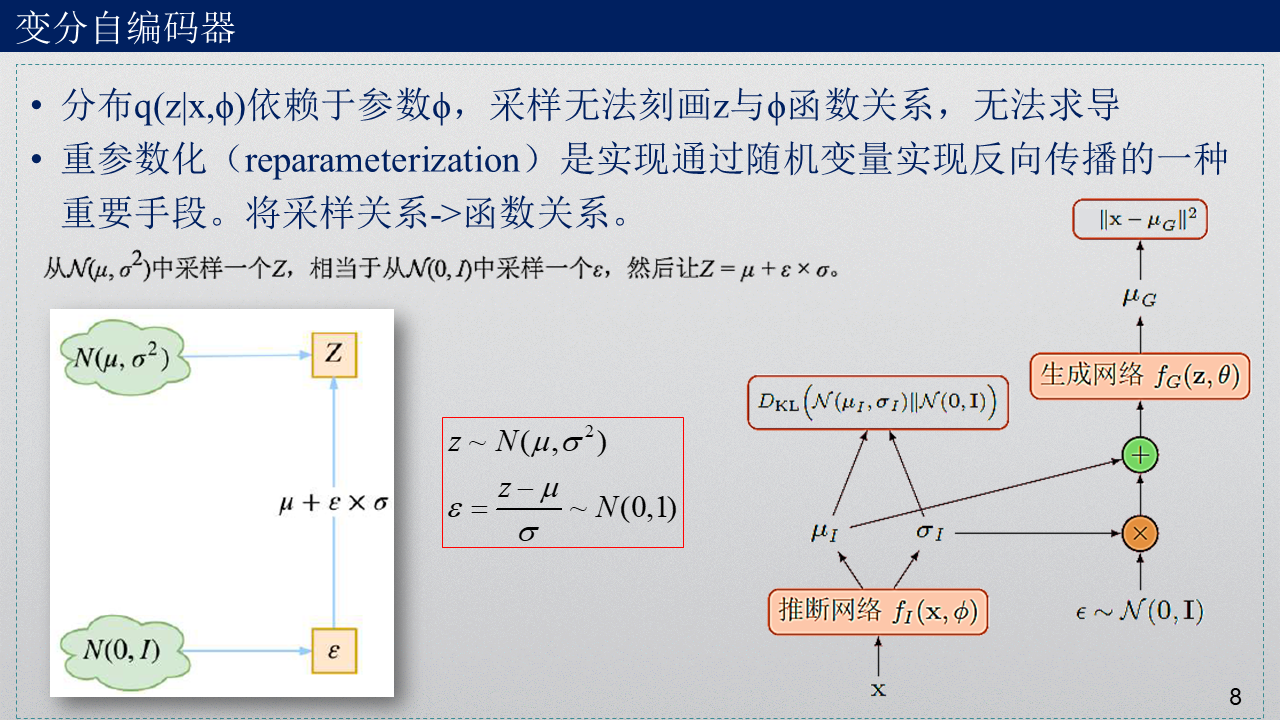

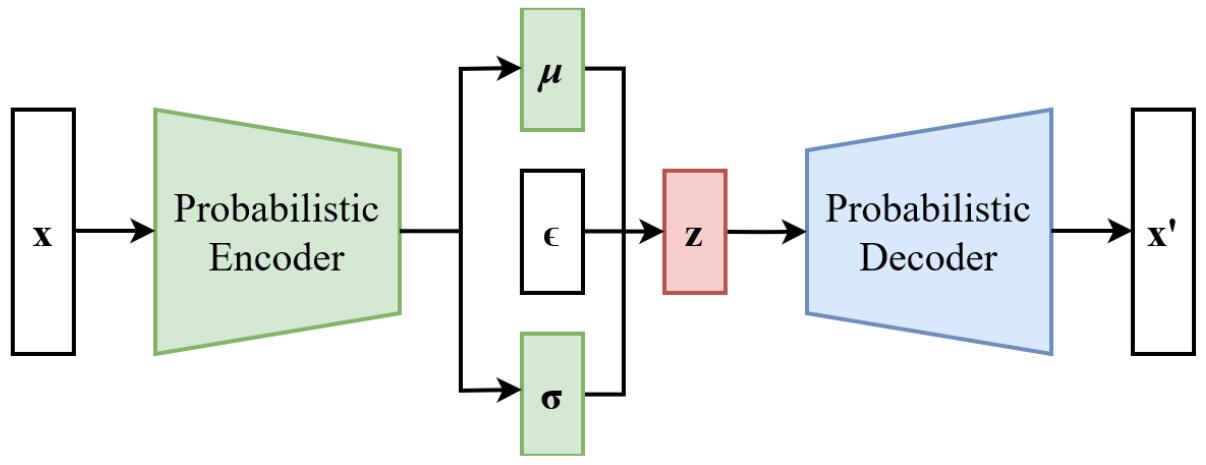

2. 变分自编码器

一般情况下,只采一个样即可,即K=1。详见参考文献[3]。

代码里z是这样的来的:z∼μ+εe0.5ln(σ2)=μ+εσ𝑧∼𝜇+𝜀𝑒0.5ln(𝜎2)=𝜇+𝜀𝜎

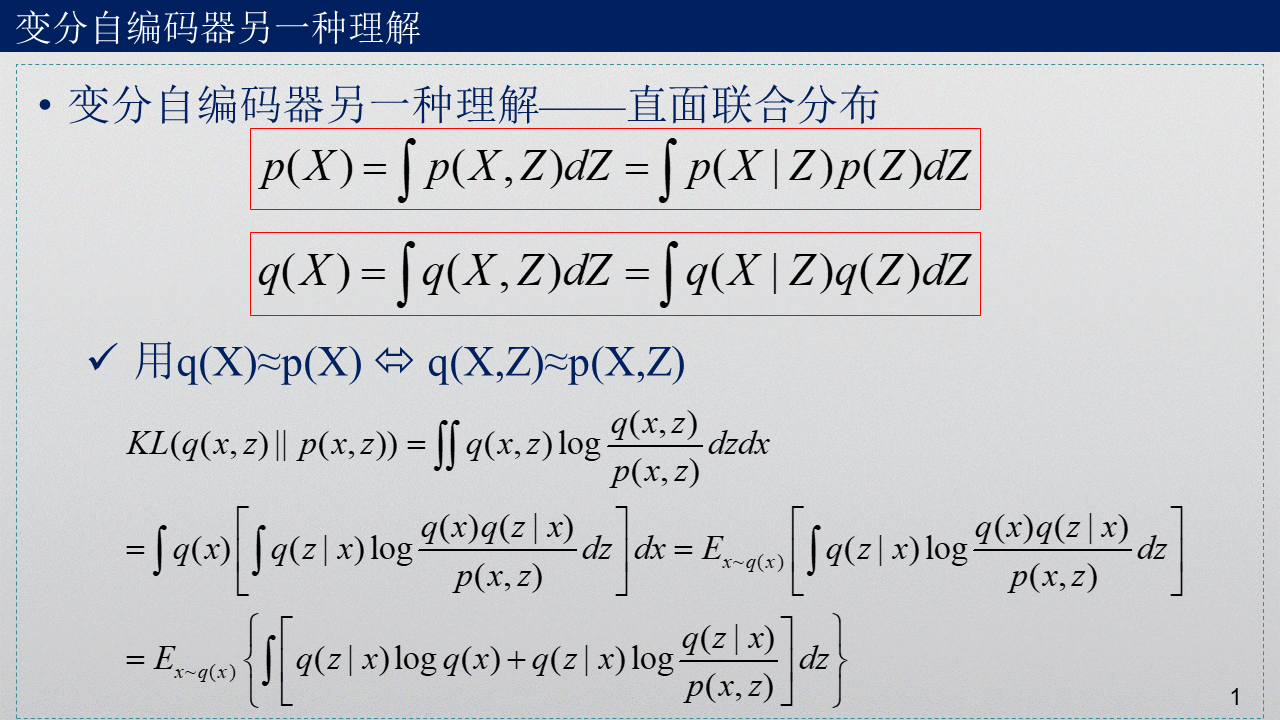

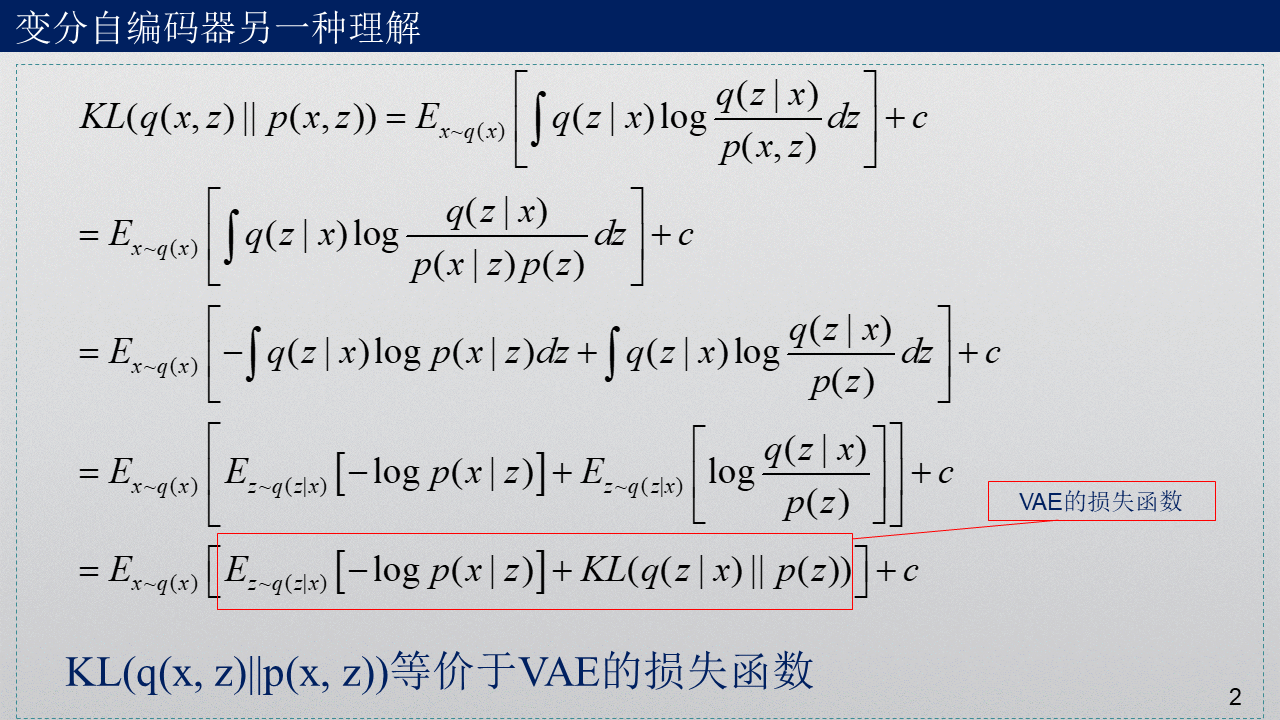

3. 变分自编码器另一种理解——直面联合分布

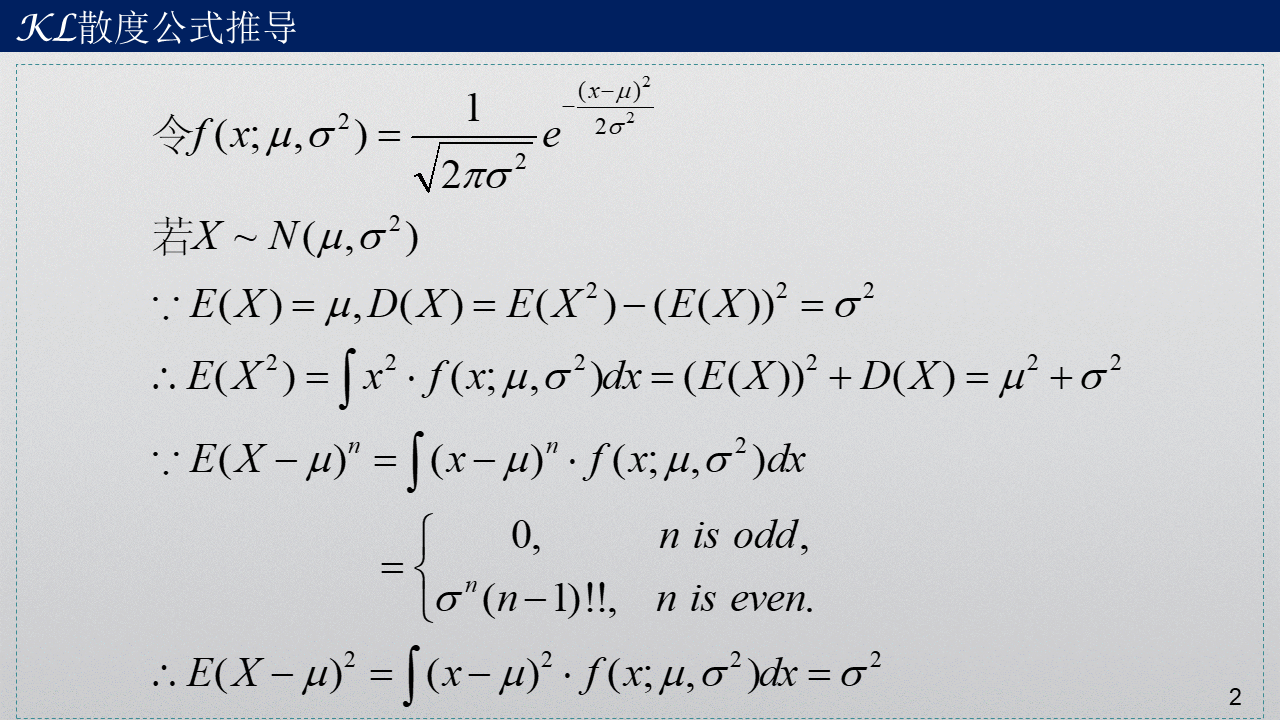

4. KL散度公式推导

5. 参考文献

[1] 变分贝叶斯 - 凯鲁嘎吉 - 博客园

[2] 邱锡鹏, 神经网络与深度学习[M]. 2019.

[3] 标签 vae 下的文章 - 科学空间|Scientific Spaces

[4] Kingma D P , Welling M . Auto-Encoding Variational Bayes[J]. 2013.

[5] 变分推断详细请参考:华俊豪博客-变分推理、变分贝叶斯算法理解与推导

[6] Tutorial - What is a variational autoencoder? – Jaan Altosaar https://jaan.io/what-is-variational-autoencoder-vae-tutorial/

[7] CS 285, Variational Inference and Generative Models, http://rail.eecs.berkeley.edu/deeprlcourse-fa20/static/slides/lec-18.pdf

[8] Ankush Ganguly, Samuel W. F. Earp, An Introduction to Variational Inference, 2021. https://arxiv.org/pdf/2108.13083.pdf

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 阿里最新开源QwQ-32B,效果媲美deepseek-r1满血版,部署成本又又又降低了!

· 开源Multi-agent AI智能体框架aevatar.ai,欢迎大家贡献代码

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧