10分钟本地运行llama3及初体验

Meta最新推出的开源大模型llama-3,被誉为目前最强的开源大模型,能力接近于GPT 4.5. 因此在本地搭建一下抢鲜体验

系统环境

CPU: AMD Ryzen 5 3600X 6-Core Processor 4.10 GHz

RAM: 32G

GPU: Navida 2060S 8G

DISK: SSD 100 G Free

基于上述自身条件,装llama-3 8b版本比较实际。

整个安装使用Ollama,5分钟安装完成正常运行

用Ollama运行llama-3

点击这里下载 Ollama Windows Preview版本。我下载msi包,完成下载后直接安装

完成安装后直接打开命令行提示符或者Power Shell。运行

# 由于ollma运行模型时只支持localhost和127.0.0.1访问,所以还要设置一下局域网内可访问,即设置环境变量OLLAMA_HOST为0.0.0.0

setx OLLAMA_HOST "0.0.0.0"

ollama run llama3:8b

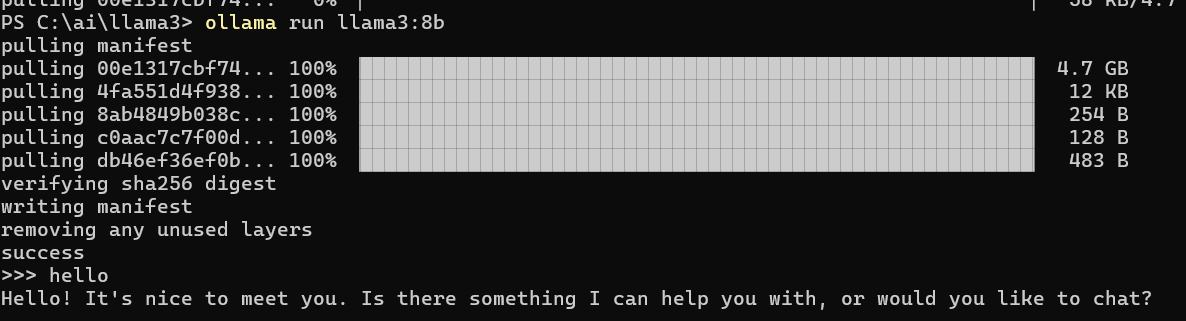

等待ollama下载llama3完成并运行,成功运行后显示结果如下:

这样就可以在命令行中进行问答。

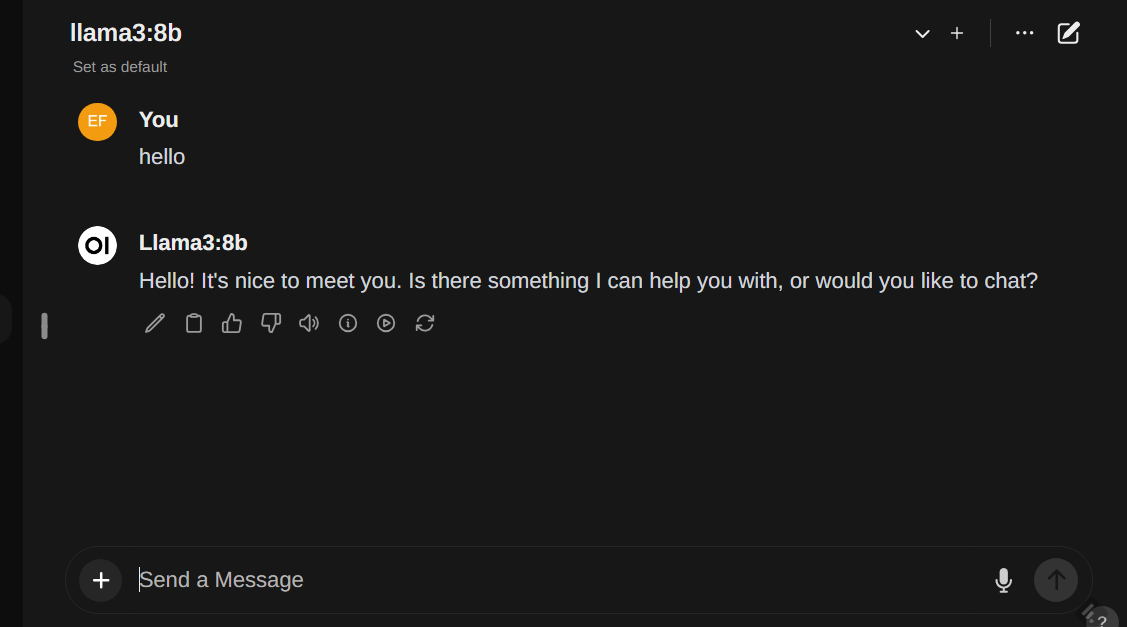

增加Web UI

如果需要一个像ChatGPT网页版那样的UI界面,还需要多做一步,就是安装Open WebUI, 直接到他们的github代码库上去看安装指导,用Docker安装非常简单,我本地用的WSL2,所以用WSL2跑Open WebUI. 运行以下命令就行

docker pull ghcr.io/open-webui/open-webui:main

docker run -d -p 3000:8080 -e OLLAMA_BASE_URL=https://宿主机IP:11434 -v open-webui:/app/backend/data -e HF_ENDPOINT=https://hf-mirror.com --name open-webui --restart always ghcr.io/open-webui/open-webui:main

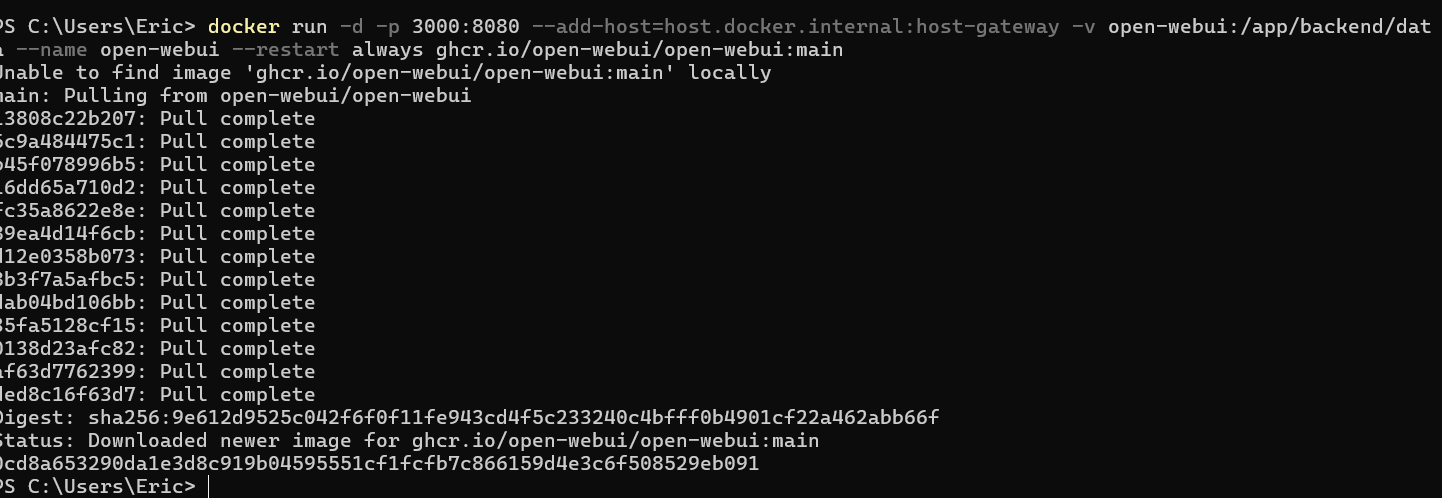

安装结果如下:

然后,浏览器里输入 http://localhost:3000/ 就可以看到运行起来的网页版了。

结语

这样,llama-3就在短时间之内在本地搭建起来了,不过体验下来,8b还是差了点意思,首先中文支持确实不大友好,再就是也经常扯淡答非所问。所以玩玩可以,真正干活还是要用大参数版本的。