PyTorch——关于data.Dataloader中参数num_workers

我在复盘 动手学深度学习 代码的时候 发现了一个有趣的现象

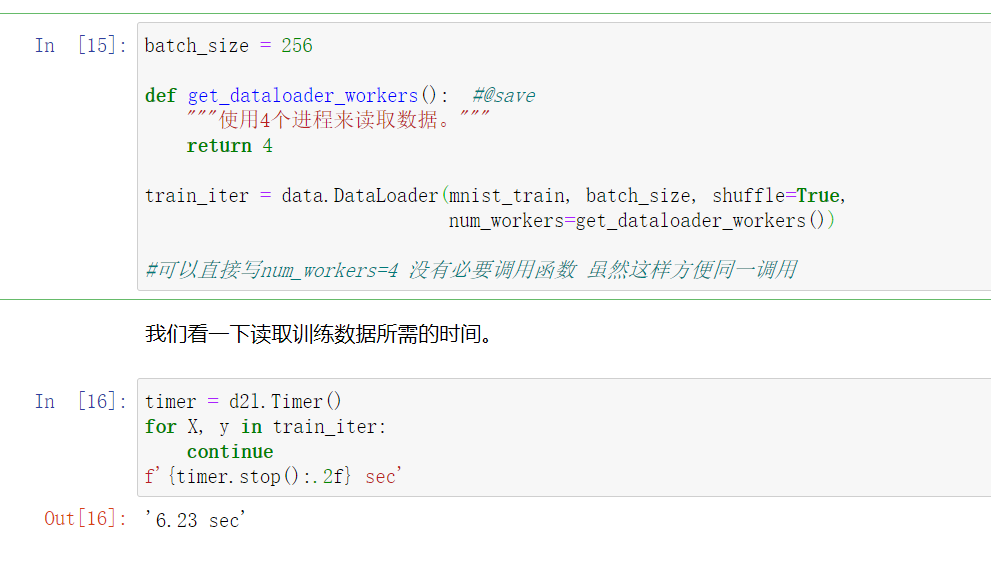

我在运载关于data.Dataloader使用关于num_workers的参数进行多进程 避免GPU拿不到数据而产生空闲时间

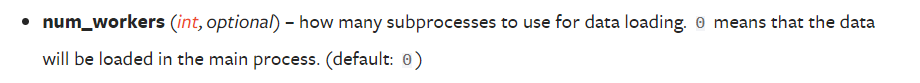

官方文档对于这个参数的解释是这样的:

我在jupyter运行的时候是很正常的

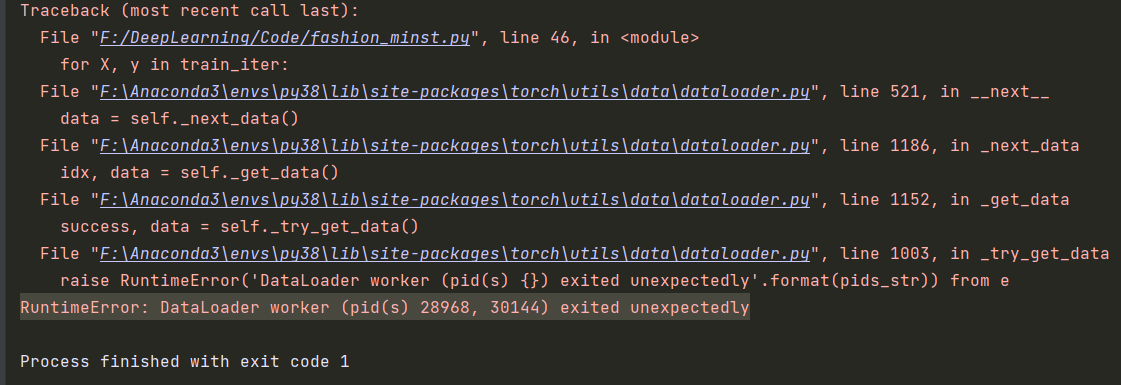

但是当我想用pycharm来写的时候去发生了异常

同样的代码 却发生了RuntimeError: DataLoader worker (pid(s) 28968, 30144) exited unexpectedly的错误 ,错误直指Dataloader

按理说应该不应该才对啊 ,同样的编译器,同样的代码,在不同方式下结果应该是一致的才对

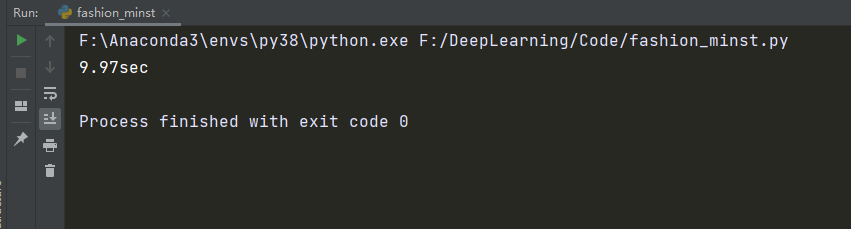

但是我把相关代码写到 main函数内的时候,却惊奇的发现可以了

我一直都没有查清楚原因,但是貌似是和pycharm的程序调用、多进程创建有关系

希望这个使用方式可以给一些人带来一些方便

若有大佬给予解答 将不胜感激

有时会发现学习是一件很快乐的事情 比一直跑步容易多了 不是嘛

浙公网安备 33010602011771号

浙公网安备 33010602011771号