实验三 朴素贝叶斯算法及应用

| 博客班级 | AHPU-机器学习-计算机18级 |

| ---- | ---- | ---- |

| 实验要求 | https://edu.cnblogs.com/campus/ahgc/machinelearning/homework/12085

|学号|3180701232|

一.实验目的

1.理解朴素贝叶斯算法原理,掌握朴素贝叶斯算法框架;

2.掌握常见的高斯模型,多项式模型和伯努利模型;

3.能根据不同的数据类型,选择不同的概率模型实现朴素贝叶斯算法;

4.针对特定应用场景及数据,能应用朴素贝叶斯解决实际问题。

二.实验内容

1.实现高斯朴素贝叶斯算法。

2.熟悉sklearn库中的朴素贝叶斯算法;

3.针对iris数据集,应用sklearn的朴素贝叶斯算法进行类别预测。

4.针对iris数据集,利用自编朴素贝叶斯算法进行类别预测。

三.实验报告要求

1.对照实验内容,撰写实验过程、算法及测试结果;

2.代码规范化:命名规则、注释;

3.分析核心算法的复杂度;

4.查阅文献,讨论K近邻的优缺点;

5.举例说明K近邻的应用场景。

四.实验结果

源代码

朴素贝叶斯.

#导入包

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

%matplotlib inline

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from collections import Counter

import math

2.

# data

def create_data():

iris = load_iris()

df = pd.DataFrame(iris.data, columns=iris.feature_names)

df['label'] = iris.target

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label']

data = np.array(df.iloc[:100, :])

print(data)

return data[:,:-1], data[:,-1]

3.

X, y = create_data()

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3)

4.

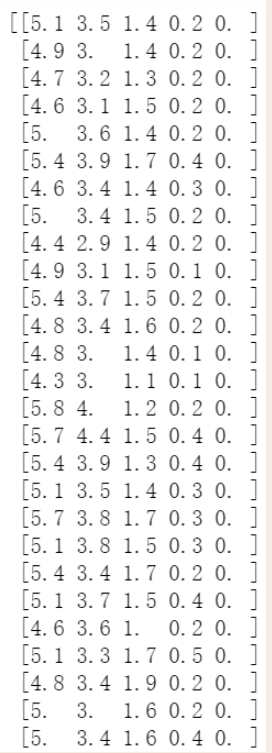

部分截图

5.

#测试

X_test[0], y_test[0]

6.

结果:

(array([5.6, 3. , 4.5, 1.5]), 1.0)

高斯贝叶斯

7.

#GaussianNB 高斯朴素贝叶斯,特征的可能性被假设为高斯

class NaiveBayes:

def __init__(self):

self.model = None

# 数学期望

@staticmethod

def mean(X):

return sum(X) / float(len(X))

# 标准差(方差)

def stdev(self, X):

avg = self.mean(X)

return math.sqrt(sum([pow(x - avg, 2) for x in X]) / float(len(X)))

# 概率密度函数

def gaussian_probability(self, x, mean, stdev):

exponent = math.exp(-(math.pow(x - mean, 2) /(2 * math.pow(stdev, 2))))

return (1 / (math.sqrt(2 * math.pi) * stdev)) * exponent

# 处理X_train

def summarize(self, train_data):

summaries = [(self.mean(i), self.stdev(i)) for i in zip(*train_data)]

return summaries

# 分类别求出数学期望和标准差

def fit(self, X, y):

labels = list(set(y))

data = {label: [] for label in labels}

for f, label in zip(X, y):

data[label].append(f)

self.model = {label: self.summarize(value)for label, value in data.items()}

return 'gaussianNB train done!'

# 计算概率

def calculate_probabilities(self, input_data):

# summaries:{0.0: [(5.0, 0.37),(3.42, 0.40)], 1.0: [(5.8, 0.449),(2.7, 0.27)]}

# input_data:[1.1, 2.2]

probabilities = {}

for label, value in self.model.items():

probabilities[label] = 1

for i in range(len(value)):

mean, stdev = value[i]

probabilities[label] *= self.gaussian_probability(input_data[i], mean, stdev)

return probabilities

# 类别

def predict(self, X_test):

# {0.0: 2.9680340789325763e-27, 1.0: 3.5749783019849535e-26}

label = sorted(self.calculate_probabilities(X_test).items(),key=lambda x: x[-1])[-1][0]

return label

def score(self, X_test, y_test):

right = 0

for X, y in zip(X_test, y_test):

label = self.predict(X)

if label == y:

right += 1

return right / float(len(X_test))

8.

model = NaiveBayes()#生成一个算法对象

model.fit(X_train, y_train)#将训练数据代入算法中

9.

结果:'gaussianNB train done!'

10.

print(model.predict([4.4, 3.2, 1.3, 0.2]))

结果:0.0

scikit-learn实例

11.

#生成scikit-learn结果与上面手写函数的结果对比

from sklearn.naive_bayes import GaussianNB #导入模型

clf = GaussianNB()

clf.fit(X_train, y_train)#训练数据

12.

结果:GaussianNB(priors=None, var_smoothing=1e-09)

13.

clf.score(X_test, y_test)

14.

结果:1.0

15.

clf.predict([[4.4, 3.2, 1.3, 0.2]])

16.

结果:array([0.])

五.实验小结

通过本次实验我理解了朴素贝叶斯算法原理,掌握了朴素贝叶斯算法框架,掌握了常见的高斯模型,多项式模型和伯努利模型,能根据不同的数据类型,选择不同的概率模型实现朴素贝叶斯算法,针对特定应用场景及数据,能应用朴素贝叶斯解决实际问题。