pytorch损失函数----交叉熵损失函数torch.nn.CrossEntropyLoss()

引言#

主要记一下CrossEntropyLoss()函数内部运行原理,主要说一下内部参数redcution="mean"时的操作,reduction="sum"就是将对应加起来,关于函数的定义什么官网了解。#

原理#

CrossEntropyLoss()函数主要是三部分:Softmax->Log->NNLLoss,NNLLoss操作主要是对预测结果求并取平均值,然后取负,详细看下面例子#

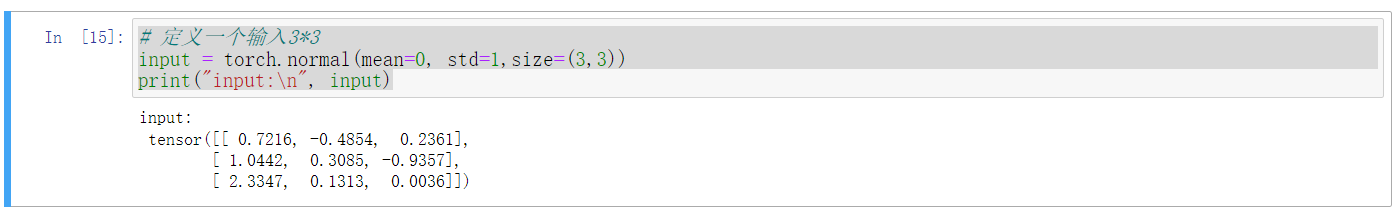

input就是我们实际计算出的y_hat,这里只是简单举个例子#

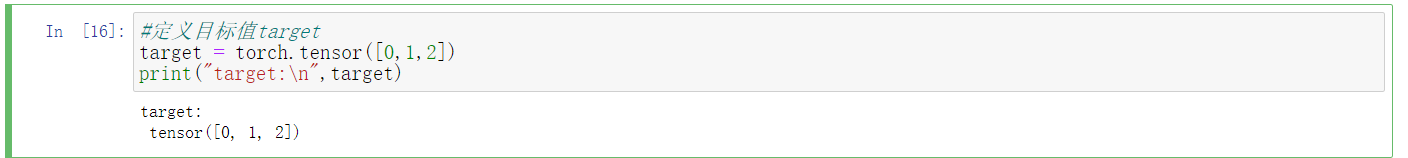

target就是我们的真实值y,这里也是简单举个例子#

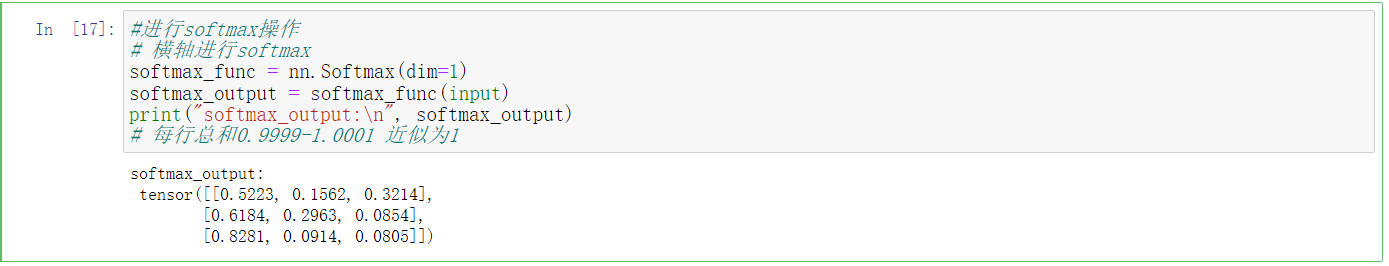

对input进行softmax操作#

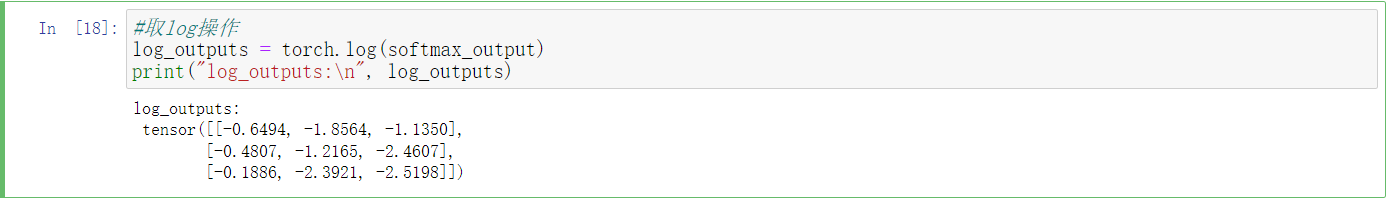

对softmax输出的值进行log操作#

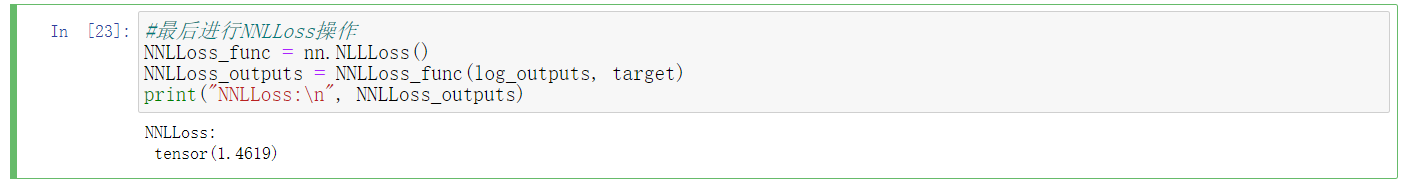

对log输出执行NNLLoss操作#

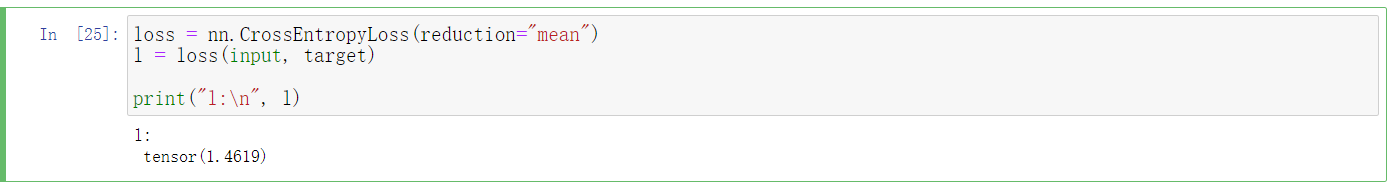

调用CrossEntropyLoss()函数#

最后输出的损失值都一样,NNLLoss操作:-((-0.6494) + (-1.2165) +(-2.5198))/ 3。#

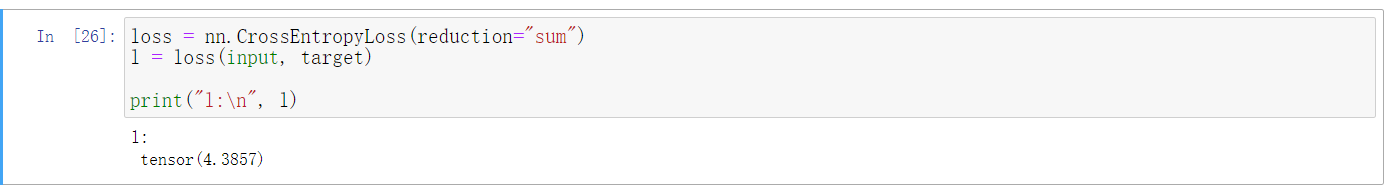

当reduction="sum"时#

CrossEntropyLoss()函数内部运行原理

CrossEntropyLoss()函数内部运行原理

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 上周热点回顾(3.3-3.9)

· winform 绘制太阳,地球,月球 运作规律