本文导读: ——JStorm之Nimbus简介

1、简介 2、系统框架与原理 3、实现逻辑和代码剖析 1)Nimbus启动 2)Topology提交 3)任务调度 4)任务监控 4、结束语 5、参考文献

附:JStorm之NimbusServer启动流程

一、简介

JStorm集群包含两类节点:主控节点(Nimbus)和工作节点(Supervisor)。其分别对应的角色如下:

1. 主控节点(Nimbus)上运行Nimbus Daemon。Nimbus负责接收Client提交的Topology,分发代码,分配任务给工作节点,监控集群中运行任务的状态等工作。Nimbus作用类似于Hadoop中JobTracker。

2. 工作节点(Supervisor)上运行Supervisor Daemon。Supervisor通过subscribe Zookeeper相关数据监听Nimbus分配过来任务,据此启动或停止Worker工作进程。每个Worker工作进程执行一个Topology任务的子集;单个Topology的任务由分布在多个工作节点上的Worker工作进程协同处理。

Nimbus和Supervisor节点之间的协调工作通过Zookeeper实现。此外,Nimbus和Supervisor本身均为无状态进程,支持Fail Fast;JStorm集群节点的状态信息或存储在Zookeeper,或持久化到本地,这意味着即使Nimbus/Supervisor宕机,重启后即可继续工作。这个设计使得JStorm集群具有非常好的稳定性。

前面介绍了JStorm中节点状态信息保存在Zookeeper里面,Nimbus通过向Zookeeper写状态信息分配任务,Supervisor通过从Zookeeper订阅相关数据领取任务,同时Supervisor也定期发送心跳信息到Zookeeper,使得Nimbus可以掌握整个JStorm集群的状态,从而可以进行任务调度或负载均衡。ZooKeeper使得整个JStorm集群十分健壮,任何节点宕机都不影响集群任务,只要重启节点即可。

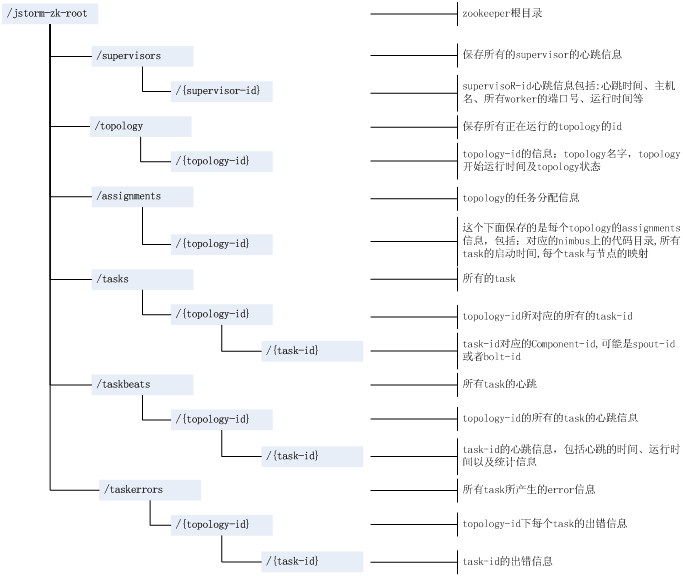

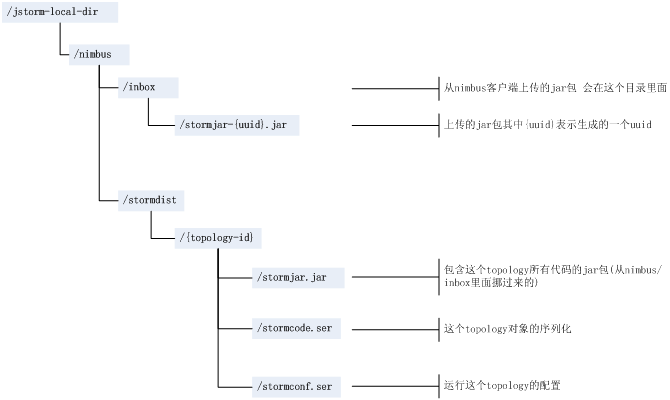

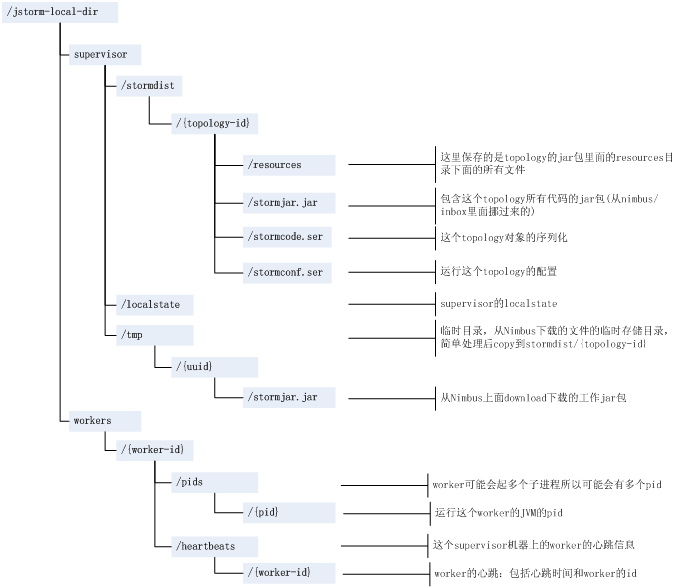

Zookeeper上存储的状态数据及Nimbus/Supervisor本地持久化数据涉及到的地方较多,详细介绍Nimbus之前就上述数据的存储结构简要说明如下(注:引用自[5]http://xumingming.sinaapp.com/)。

图1 JStorm存储在Zookeeper中数据说明

图2 Nimbus本地数据说明

图3 Supervisor本地数据说明

二、系统架构与原理

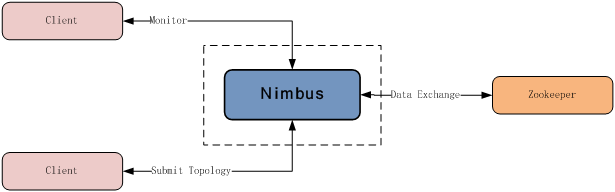

Nimbus做三件事情:

1、接收Client提交Topology任务;

2、任务调度;

3、监控集群任务运行状况。

前面已经提到,Nimbus通过向Zookeeper写数据完成任务分配,通过读Zookeeper上相关状态信息监控集群中任务的运行状态,所以与Nimbus直接发生交互仅Client和Zookeeper。如下图示。

三、实现逻辑与代码剖析

以jstorm-0.7.1为例,Nimbus相关实现在jstorm-server/src/main/java目录的com.alipay.dw.jstorm.daemon.nimbus包里。Nimbus Daemon的启动入口在NimbusServer.java。

1.Nimbus启动

Nimbus Daemon进程启动流程如下:

1、根据配置文件初始化Context数据;

2、与Zookeeper数据同步;

3、初始化RPC服务处理类ServiceHandler;

4、启动任务分配策略线程;

5、启动Task的Heartbeat监控线程;

6、启动RPC服务;

7、其他初始化工作。

Nimbus的详细启动逻辑如下:

1 @SuppressWarnings("rawtypes") 2 private void launchServer(Map conf) throws Exception { 3 LOG.info("Begin to start nimbus with conf " + conf); 4 //1.检查配置文件中是否配置为分布式模式 5 StormConfig.validate_distributed_mode(conf); 6 //2.注册主线程退出Hook现场清理(关闭线程+清理数据) 7 initShutdownHook(); 8 //3.新建NimbusData数据,记录30s超时上传下载通道Channel/BufferFileInputStream 9 data = createNimbusData(conf); 10 //4.nimbus本地不存在的stormids数据如果在ZK上存在则删除,其中删除操作包括/zk/{assignments,tasks,storms}相关数据 11 NimbusUtils.cleanupCorruptTopologies(data); 12 //5.启动Topology分配策略 13 initTopologyAssign(); 14 //6.初始化所有topology的状态为startup 15 initTopologyStatus(); 16 //7.监控所有task的heartbeat,一旦发现taskid失去心跳将其置为needreassign 1次/10s 17 initMonitor(conf); 18 //8.启动cleaner线程,默认600s扫描一次,默认删除3600s没有读写过的jar文件 19 initCleaner(conf); 20 //9.初始化ServiceHandler 21 serviceHandler = new ServiceHandler(data); 22 //10.启动rpc server 23 initThrift(conf); 24 }

2.Topology提交

JStorm集群启动完成后,Client可向其提交Topology。jstorm-0.7.1源码目录jstorm-client/src/main/java下包backtype.storm为用户提供向集群提交Topology的StormSubmitter.submitTopology方法。提交Topology在Client/Nimbus两端都会做相关的处理。

Client端提交Topology分两步完成:

1)打包Topology计算逻辑代码jar提交给Nimbus,上传到Nimbus目录$jstorm_local_dir/nimbus/inbox/stormjar-{$randomid}.jar;其中randomid是Nimbus生成的随机UUID;

2)Client通过RPC向Nimbus提交Topology DAG及配置信息;

1 public static void submitTopology( 2 String name, 3 Map stormConf, 4 StormTopology topology) 5 throws AlreadyAliveException, InvalidTopologyException { 6 if(!Utils.isValidConf(stormConf)) { 7 throw new IllegalArgumentException("Storm conf is not valid."); 8 } 9 stormConf = new HashMap(stormConf); 10 stormConf.putAll(Utils.readCommandLineOpts()); 11 Map conf = Utils.readStormConfig(); 12 conf.putAll(stormConf); 13 try { 14 String serConf = JSONValue.toJSONString(stormConf); 15 if(localNimbus!=null) { 16 LOG.info("Submitting topology " + name + " in local mode"); 17 localNimbus.submitTopology(name, null, serConf, topology); 18 } else { 19 //1.向Nimbus提交jar包 20 submitJar(conf); 21 NimbusClient client = NimbusClient.getConfiguredClient(conf); 22 try { 23 LOG.info("Submitting topology " + name + " in distributed mode with conf " + serConf); 24 //2.提交topology DAG及序列化后的配置信息serconf(json) 25 client.getClient().submitTopology(name, submittedJar, serConf, topology); 26 } finally { 27 client.close(); 28 } 29 } 30 LOG.info("Finished submitting topology: " + name); 31 } catch(TException e) { 32 throw new RuntimeException(e); 33 } 34 }

其中RPC和数据序列化通过跨语言服务框架Thrift(http://wiki.apache.org/thrift/)实现。JStorm的服务定义在other/storm.thrift里。

Nimbus端接收到Client提交上来的Topology计算逻辑代码jar包后如前面所述将jar包暂存在目录$jstorm_local_dir/nimbus/inbox/stormjar-{$randomid}.jar;

Nimbus端接收到Client提交上来的Topology DAG和配置信息后:

1)简单合法性检查;主要检查是否存在相同TopologyName的Topology,如果存在,拒绝Topology提交。

2)生成topologyid;生成规则:TopologyName-counter-currenttime;

3)序列化配置文件和Topology代码;

4)Nimbus本地准备运行时所需数据;

5)向Zookeeper注册Topology和Task;

6)将Tasks压入分配队列等待TopologyAssign分配;

1 @SuppressWarnings("unchecked") 2 @Override 3 public void submitTopology(String topologyname, String uploadedJarLocation, String jsonConf, StormTopology topology) 4 throws AlreadyAliveException, InvalidTopologyException, TException { 5 …… 6 try { 7 //1.检测topologyName是否已经存在,如果存在相同名称的topology则拒绝提交 8 checkTopologyActive(data, topologyname, false); 9 } 10 …… 11 //2.根据topologyname构造topologyid(=topologyname-$counter-$ctime) 12 int counter = data.getSubmittedCount().incrementAndGet(); 13 String topologyId = topologyname + "-" + counter + "-" 14 + TimeUtils.current_time_secs(); 15 //3.根据输入参数jsonConf重组配置数据 16 Map serializedConf = (Map) JStormUtils.from_json(jsonConf); 17 if (serializedConf == null) { 18 throw new InvalidTopologyException(""); 19 } 20 serializedConf.put(Config.STORM_ID, topologyId); 21 Map stormConf; 22 try { 23 stormConf = NimbusUtils.normalizeConf(conf, serializedConf, topology); 24 } catch (Exception e1) { 25 throw new TException(errMsg); 26 } 27 Map totalStormConf = new HashMap(conf); 28 totalStormConf.putAll(stormConf); 29 StormTopology newtopology = new StormTopology(topology); 30 //4.检查topology的合法性,包括componentid检查和spout/bolt不能为空检查 31 // this validates the structure of the topology 32 Common.validate_basic(newtopology, totalStormConf, topologyId); 33 try { 34 StormClusterState stormClusterState = data.getStormClusterState(); 35 //5.在nimbus的本地准备所有topology相关数据 36 //包括$storm-local-dir/nimbus/stormdist/topologyid/{tormjar.jar,stormcode.ser,stormconf.ser} 37 // create $storm-local-dir/nimbus/topologyId/xxxx files 38 setupStormCode(conf, topologyId, uploadedJarLocation, stormConf, 39 newtopology); 40 //6.向zk写入task信息 41 //6.1新建目录$zkroot/taskbeats/topologyid 42 //6.2写文件$zkroot/tasks/topologyid/taskid 内容为对应task的taskinfo[内容:componentid] 43 // generate TaskInfo for every bolt or spout in ZK 44 // $zkroot /tasks/topoologyId/xxx 45 setupZkTaskInfo(conf, topologyId, stormClusterState); 46 //7.任务分配事件压入待分配队列 47 // make assignments for a topology 48 TopologyAssignEvent assignEvent = new TopologyAssignEvent(); 49 assignEvent.setTopologyId(topologyId); 50 assignEvent.setScratch(false); 51 assignEvent.setTopologyName(topologyname); 52 TopologyAssign.push(assignEvent); 53 } 54 …… 55 }

3.任务调度

Topology被成功提交后会压入Nimbus中TopologyAssign的FIFO队列,后台任务调度线程对队列中的Topology逐个进行任务调度。

从0.9.0开始,JStorm提供非常强大的调度功能,基本上可以满足大部分的需求,同时支持自定义任务调度策略。JStorm的资源不再仅是Worker的端口,而从CPU/Memory/Disk/Net等四个维度综合考虑。

jstorm-0.7.1的任务调度策略仍主要以Worker端口/Net单一维度调度。

任务调度需要解决的问题是:如何将Topology DAG中各个计算节点和集群资源匹配,才能发挥高效的逻辑处理。0.7.1的策略是:

1、将集群中的资源排序:按照空闲worker数从小到大的顺序重排节点,节点内部按照端口大小顺序排列;

2、Topology中需要分配的任务(重新分配的Topology时大多任务不再需要分配)逐个映射到上述排好序的资源里。

任务调度核心逻辑如下:

1 public static List sortSlots( 2 Set allSlots, int needSlotNum) { 3 Map> nodeMap = new HashMap>(); 4 // group by first 5 // 按照节点进行组织Map> : nodeid -> ports 6 for (NodePort np : allSlots) { 7 String node = np.getNode(); 8 List list = nodeMap.get(node); 9 if (list == null) { 10 list = new ArrayList(); 11 nodeMap.put(node, list); 12 } 13 list.add(np); 14 } 15 16 //每一个nodeid按照端口的大小进行排序 17 for (Entry> entry : nodeMap.entrySet()) { 18 List ports = entry.getValue(); 19 Collections.sort(ports); 20 } 21 22 //收集所有的workers 23 List> splitup = new ArrayList>(nodeMap.values()); 24 25 //按照节点可用worker数从小到大排序 26 //1.assignTasks-Map supInfos 27 //2.availSlots : splitup/List> 28 Collections.sort(splitup, new Comparator> () { 29 public int compare(List o1, List o2) { 30 return o1.size() - o2.size(); 31 } 32 }); 33 34 /* 35 * splitup目前的状态(A-F表示节点,1-h表示端口) 36 * |A| |B| |C| |D| |E| |F| 37 *--|---|---|---|---|---|-- 38 * |1| |2| |3| |4| |5| |6| 39 * |7| |8| |9| |0| |a| 40 * |b| |c| |d| |e| 41 * |f| |g| 42 * |h| 43 * 经过interleave_all收集到的sortedFreeSlots为: 44 * 1-2-3-4-5-6-7-8-9-0-a-b-c-d-e-f-g-h 45 */ 46 List sortedFreeSlots = JStormUtils.interleave_all(splitup); 47 48 //比较sortedFreeSlots.size和needSlotNum的大小分配workers 49 if (sortedFreeSlots.size() needSlotNum 50 return sortedFreeSlots.subList(0, needSlotNum); 51 }

4.任务监控

初始化Nimbus时后台会随之启动一个称为MonitorRunnable的线程,该线程的作用是定期检查所有运行Topology的任务Tasks是否存在Dead的状态。一旦发现Topology中存在Dead的任务Task,MonitorRunnable将该Topology置为StatusType.monitor,等待任务分配线程对该Topology中的Dead任务进行重新分配。

MonitorRunnable线程默认10s执行一次检查,主要逻辑如下:

1 @Override 2 public void run() { 3 //1.获取jstorm对zk的操作接口 4 StormClusterState clusterState = data.getStormClusterState(); 5 try { 6 // Attetion, here don't check /ZK-dir/taskbeats to 7 // get active topology list 8 //2.通过$zkroot/assignments/获取所有需要检查active topology 9 List active_topologys = clusterState.assignments(null); 10 11 if (active_topologys == null) { 12 LOG.info("Failed to get active topologies"); 13 return; 14 } 15 16 for (String topologyid : active_topologys) { 17 LOG.debug("Check tasks " + topologyid); 18 // Attention, here don't check /ZK-dir/taskbeats/topologyid to 19 // get task ids 20 //3.通过$zkroot/tasks/topologyid获取组成topology的所有tasks 21 List taskIds = clusterState.task_ids(topologyid); 22 if (taskIds == null) { 23 LOG.info("Failed to get task ids of " + topologyid); 24 continue; 25 } 26 27 boolean needReassign = false; 28 for (Integer task : taskIds) { 29 //4.检查task是否为Dead状态,主要是task心跳是否超时 30 boolean isTaskDead = NimbusUtils.isTaskDead(data, topologyid, task); 31 if (isTaskDead == true) { 32 needReassign = true; 33 break; 34 } 35 } 36 if (needReassign == true) { 37 //5.如果Topology里有Dead状态的Task则topology状态置为monitor等待任务分配线程重新分配 38 NimbusUtils.transition(data, topologyid, false, StatusType.monitor); 39 } 40 } 41 } catch (Exception e) { 42 // TODO Auto-generated catch block 43 LOG.error(e.getCause(), e); 44 } 45 }

四、结语

本文简单介绍了Nimbus在整个JStorm系统中扮演的角色,及其实现逻辑和关键流程的源码剖析,希望能够对刚接触JStorm的同学有所帮助。文中难免存在不足和错误,欢迎交流指导。

五、参考文献

[1]Storm社区. http://Storm.incubator.apache.org/

[2]JStorm源码. https://github.com/alibaba/jStorm/

[3]Storm源码. https://github.com/nathanmarz/Storm/

[4]Jonathan Leibiusky, Gabriel Eisbruch, etc. Getting Started with Storm.http://shop.oreilly.com/product/0636920024835.do. O’Reilly Media, Inc.

[5]Xumingming Blog. http://xumingming.sinaapp.com/

[6]量子恒道官方博客. http://blog.linezing.com/

浙公网安备 33010602011771号

浙公网安备 33010602011771号