推荐系统中回归任务常用损失函数

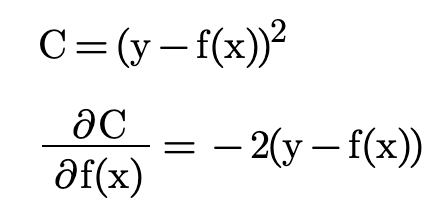

1. MSE(均方误差损失)

优点:

1. 收敛快

缺点:

1. 假设了样本服从正态分布,如果训练样本label不服从正态分布,则MSE并非最大似然估计

2. 对异常点很敏感

2. MAE(平均绝对误差损失)

优点:不容易受异常值影响

缺点:收敛速度慢,拟合能力弱

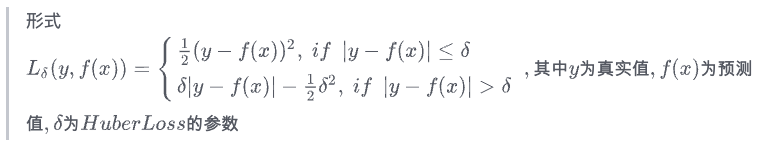

3. Huber Loss

结合了MSE和MAE的优点

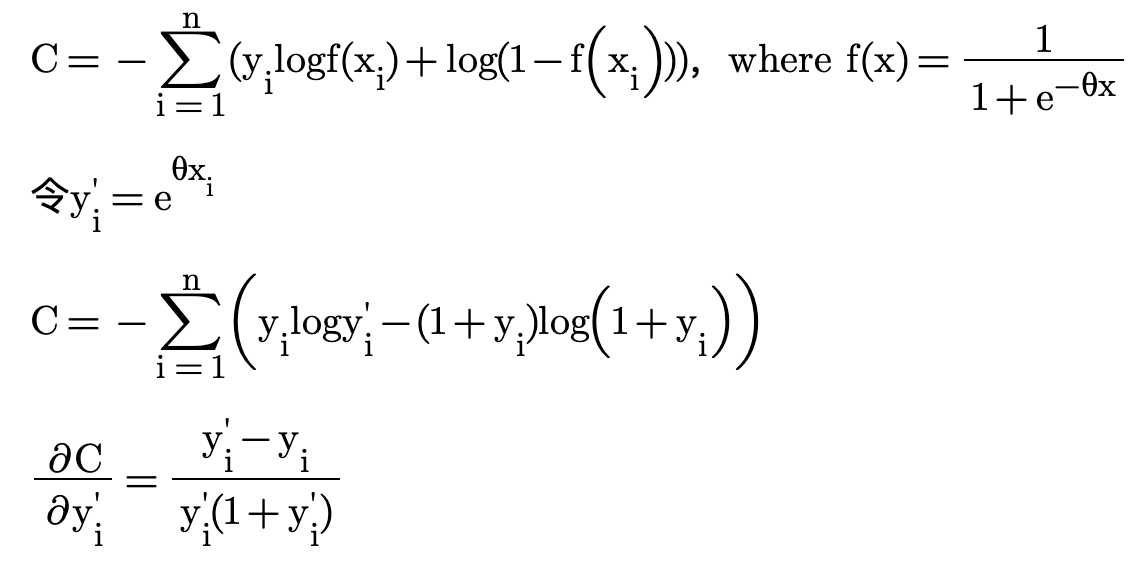

4. WCE

优点:把回归任务转化成了更容易学习的二分类任务

缺点:

1. wce loss在低估(y'<y)和高估(y'>y)时梯度不是对称的,低估时梯度很大,高估时梯度很小,很容易导致模型高估

2. 假设了样本分布服从几何分布,如果样本分布不是几何分布,可能导致效果不好

5. softmax+logloss

训练阶段:对label分桶,把回归问题转为多分类问题

serving阶段:落在每个桶的概率*桶均值(中位数)

优点:避免了原始回归问题对样本概率分布的先验假设,可以拟合任意概率分布

缺点:

1. 需要合理的对label分桶

2. 分桶方式太hard,连续桶交接处的loss变化过大

6. Ordinal Regression

参考论文《Deep Ordinal Regression Network for Monocular Depth Estimation》