机器学习第二次作业

(1)概率论与贝叶斯先验

视频地址:https://www.bilibili.com/video/BV1Tb411H7uC?p=2

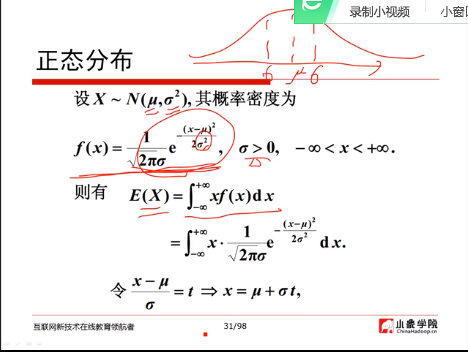

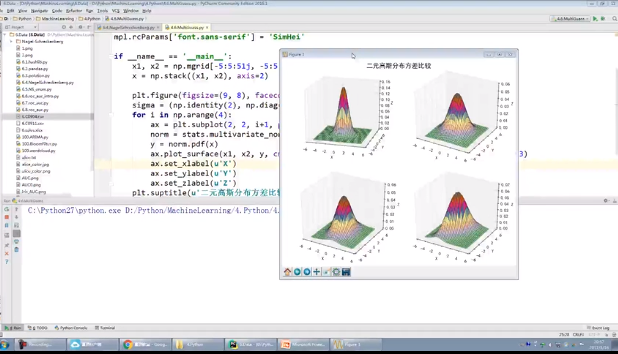

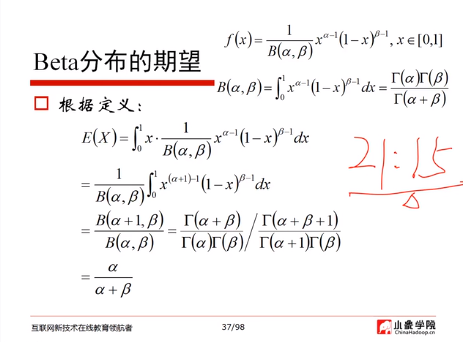

概率论基础

2、用自己的话总结“梯度”,“梯度下降”和“贝叶斯定理”。

(1)梯度:梯度与方向导数相关,但是方向导数的本质是一个数值,而梯度的本质是一个向量,一个函数u在P点的梯度是一个向量,它的

方向是函数u在P点方向导数取得最大值时的方向,梯度的模等于方向导数的最大值,即函数沿梯度方向函数有最大的变化率。

(2)梯度下降:梯度下降法的算法可以有代数法和矩阵法(也称向量法)两种表示,如果对矩阵分析不熟悉,则代数法更加容易理解。不过矩阵法更加的简洁,且由于使用了矩阵,实现逻辑更加的一目了然。这里先介绍代数法,后介绍矩阵法。在机器学习算法中,在最小化损失函数时,可以通过梯度下降法来一步步的迭代求解,得到最小化的损失函数,和模型参数值。

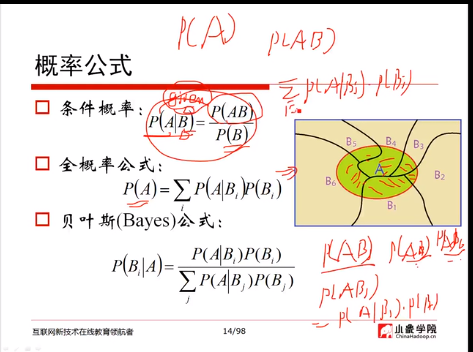

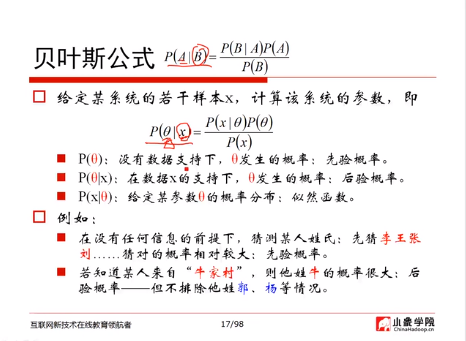

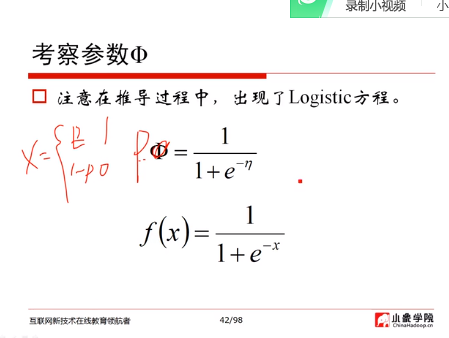

(3)贝叶斯定理:与其他统计学推断方法截然不同,它建立在主观判断的基础上,在不完全情报下,也就是说,你可以不需要客观证据,先估计一个主观概率对部分未知的状态进行描述,然后根据实际结果不断修正,最后再利用期望值和修正概率做出最优决策。