人脸识别中对比学习的损失函数(演化进程)

参考文献:https://zhuanlan.zhihu.com/p/40775212

https://blog.csdn.net/yiran103/article/details/83684613

Facenet demo:https://www.cnblogs.com/muyisun/p/13338098.html

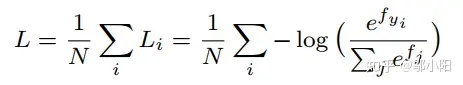

1.softmax

在初期,人脸识别模型通常使用softmax损失函数,其实就是在超平面上进行分类划分。这样的分类其实是乱七八糟的。

注意,由此式不难得到:

可以改写成下式这样,带有余弦角,但结果仍然不会变。

在二维平面上的,分类结果就像上面这样。

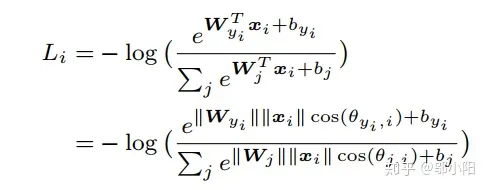

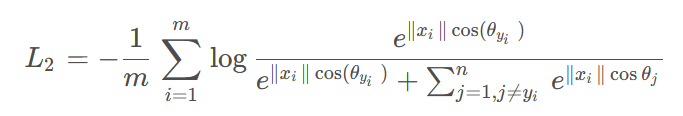

2.改进softmax

为了加大类间距离,缩小类内差距。对softmax进行了改进。

使网络权重W为1,bias=0。这样就只与特征向量、角度有关。更进一步,把x的模固定为s,就有:

这样,所有的特征向量就全部在一个超球面上了。此时角度仍然代表着特征向量和各分类平面的夹角。

但类间距离、类内差距仍然没有发生变化,只是都规范了一些。

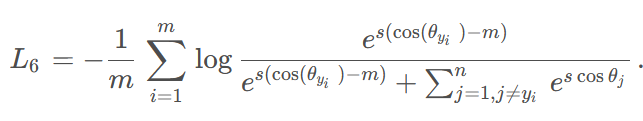

3.附加余弦余量

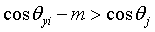

简单来说该式给出了一个隐含约束:

其实也就是:

m就是边界!

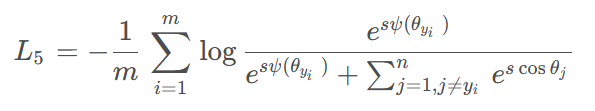

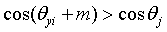

4.arcface

可以很简单地推出:

同样隐式地规定了一个约束,以在余弦函数递减区间为例子:

浙公网安备 33010602011771号

浙公网安备 33010602011771号