spark 1.6 完全分布式平台搭建

软件环境:

scala-2.11.4.tgz

spark-1.6.2-bin-hadoop2.6.tgz

操作步骤:

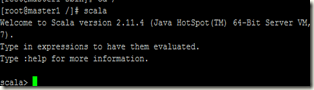

一. 安装scala

1. 解压scala (tar –zxvf filename)

2. 配置scala环境变量(.bashrc中添加SCALA_HOME, 在path中添加:$SCALA_HOME$/bin)

3. souce .bashrc

4. 检查一下是否配置正确,可以输入scala命令。

5. 将配置信息同步到集群slave节点

二、 安装spark

前提:需要安装Hadoop【故需要相应Hadoop版本的spark软件】

1. 解压spark (tar –zxvf filename)

2. 配置spark环境变量(.bashrc中添加SPARK_HOME, 在path中添加:$SPARK_HOME$/bin)

3. souce .bashrc

4. 修改配置文件【/conf/spark-env.sh】

cp spark-env.sh.template spark-env.sh在spark-env.sh文件中,添加Java, scala, hadooop, spark 环境变量5. 修改配置文件【/conf/slaves】

6. 将配置好的scala,spakr文件分发给slave

7. 配置slave主机的scala和spark变量

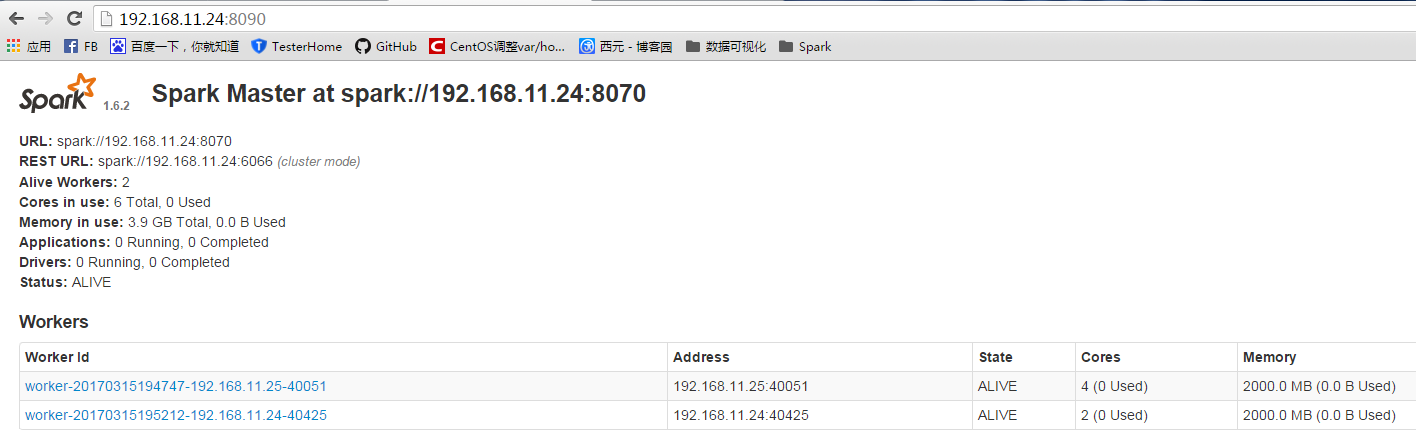

三、测试Spark

1. cd /spark/sbin目录下

2. ./start-all.sh 【启动之前需要启动Hadoop】

如果除hadoop的其他进程之外在hadoop-master1上面出现了Master进程,slave1,slave2,上出现了Worker进程。那么可以说明Spark安装配置成功。

日行一善, 日写一撰