深度学习中权重参数是如何被训练的?

PyTorch深度学习快速入门教程(绝对通俗易懂!)【小土堆】_哔哩哔哩_bilibili

快速入门的前提是,对python基础和深度学习的知识有一定的了解。否则很难全身心 的投入到学习torch中。

这是我在观阅p24时的一些疑惑。

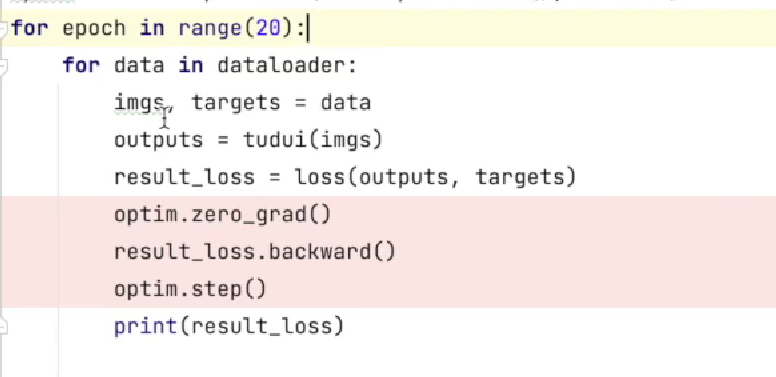

for data in dataloader

在文首的代码中,使用的上一句for循环代码这里,我一开始以为,针对每一次的data(视频中这里取每一个批次为64),都会有新的参数来针对的进行训练。

但是后来才发现不是这样的:一直都是一个参数,在不同的图像上进行参数的训练

对每一个64的batch里的每一张图片, 都会计算loss然后反向传播更新参数。

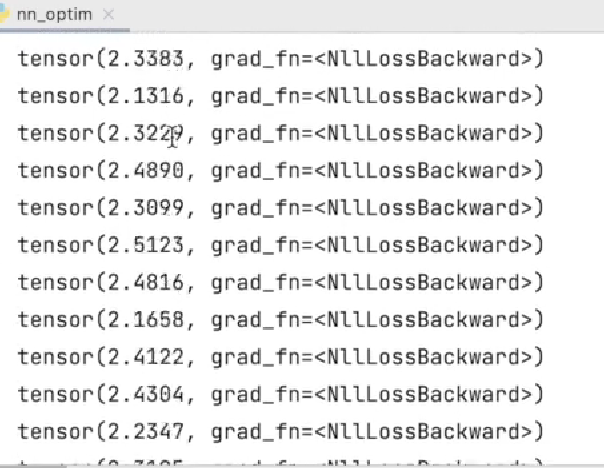

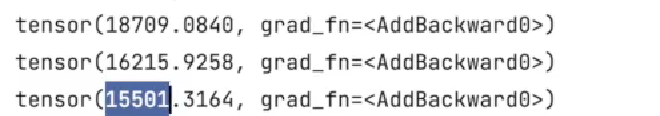

但是我在查看loss的时候,发现loss相差不大,所以才以为针对每一个的batch=64都会有新的参数进行训练。但实际不是这样。

一直都是一个参数在被训练。

只是因为第一次查看所有的图片,所以前面的经验对后面的指导很少。

倘若把epoch的次数增大,就可以发现loss确实在降低。

本文作者:小澳子

本文链接:https://www.cnblogs.com/xiaoaozi/p/15814124.html

版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 2.5 中国大陆许可协议进行许可。

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步