卷积神经网络中的卷积核是如何进行运算的

本笔记为自用总结。

倘若想学习,请参考一下两个链接即可。

卷积运算和运算后特征图大小计算1_胡侃有料的博客-CSDN博客_卷积特征图大小计算

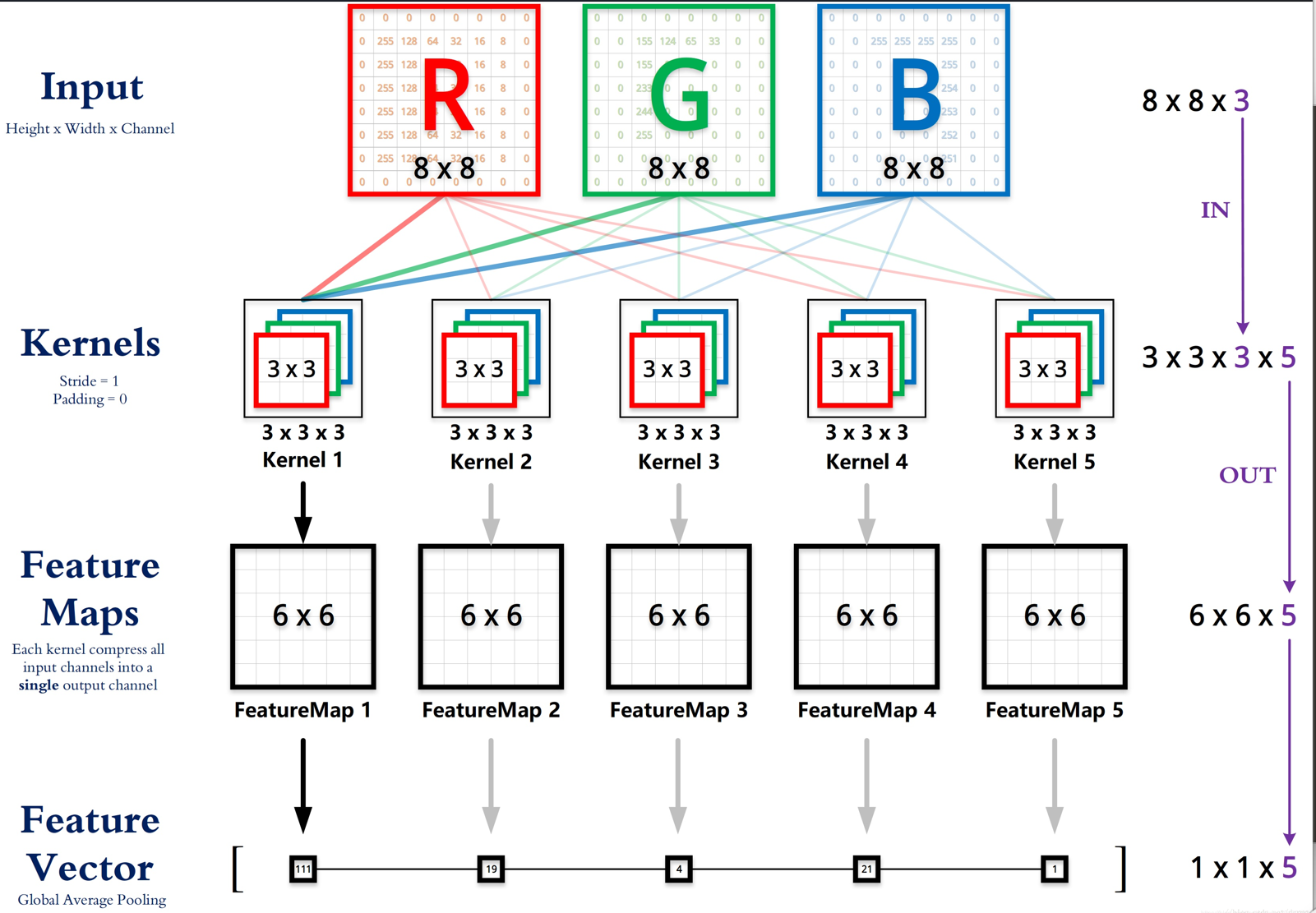

一张RGB的三通道彩色影像,被numpy或其他模块里的函数读取到网络里后,是三通道的影像。

卷积神经网络中的卷积部分,在模型运行的过程中,不仅会改变影像的长宽,也会改变其深度(也就是通道的数量)。

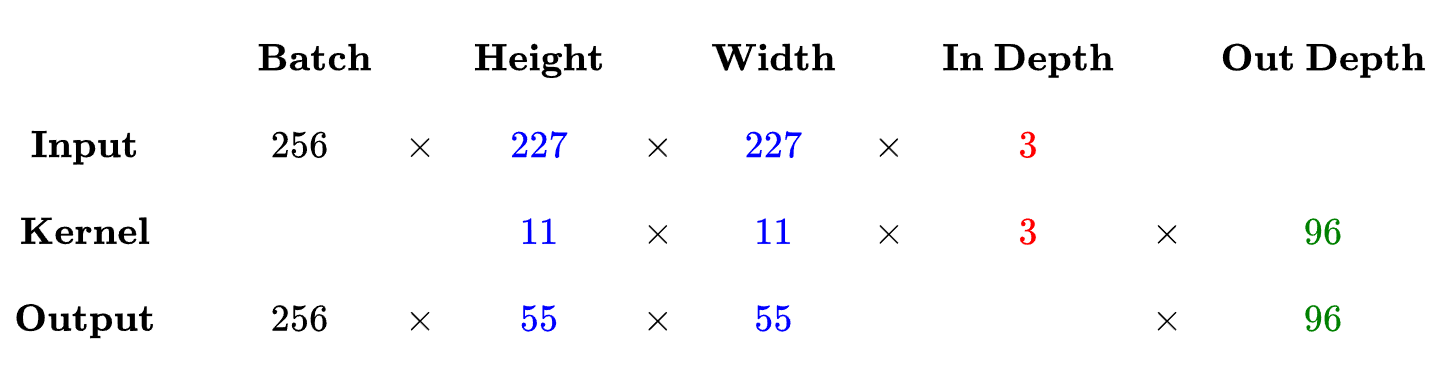

一张227 x 227 x 3的图像

96个卷积核,每个卷积核的尺寸是11 x 11 x 3,步长为4,padding=0

输出为55 x 55 x 96

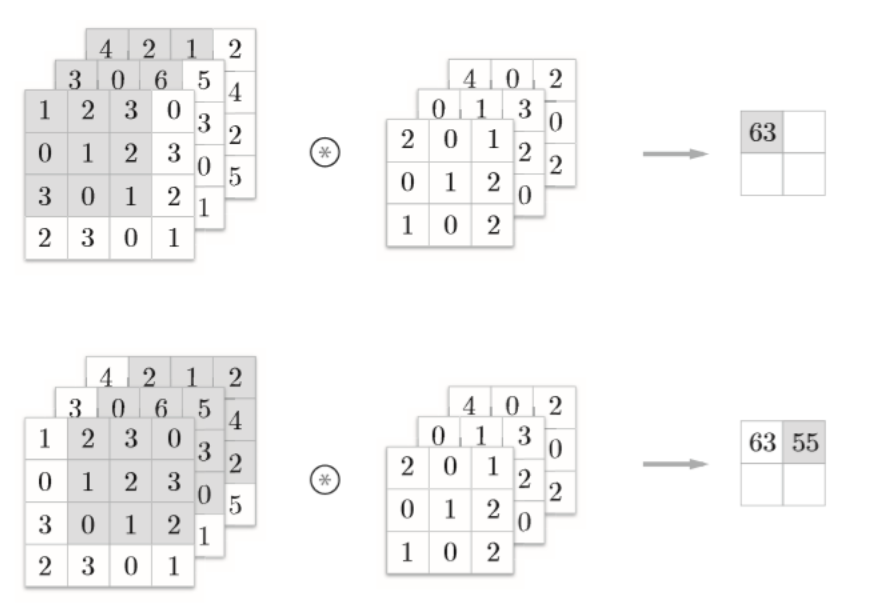

不论卷积核的数量,首先应当了解的是利用卷积核进行计算的思想:输入图像和卷积核的对应通道进行相乘再相加。且一个卷积核(其通道数和要相乘的图片的通道数是一致的)对应的输出数据只有一个通道!!!

倘若在代码中或文章中,没有注明卷积核本身的通道数,那么默认和输入通道数相同。

上两句一直是我学习过程中的疑惑重点。尤其是卷积核的通道数到底有多少个?为什么相乘了以后的输出就恰好等于卷积核的个数?

以上面的96个11 x 11 x 3卷积核为例,每一个卷积核的通道数都与输入图像的相同,那就是三个通道。然后每个通道与对应的输入图像的通道相乘,得到一个结果,三个通道就是三个结果,这三个结果相加得到一个最终的结果。那么一共96个通道,就会是96个输出。

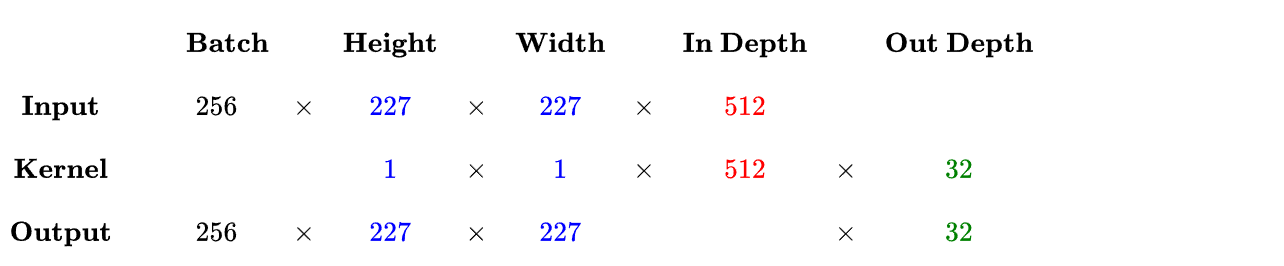

1 x 1 的卷积核

这种卷积核的作用是将输入矩阵的通道数量缩减后输出。

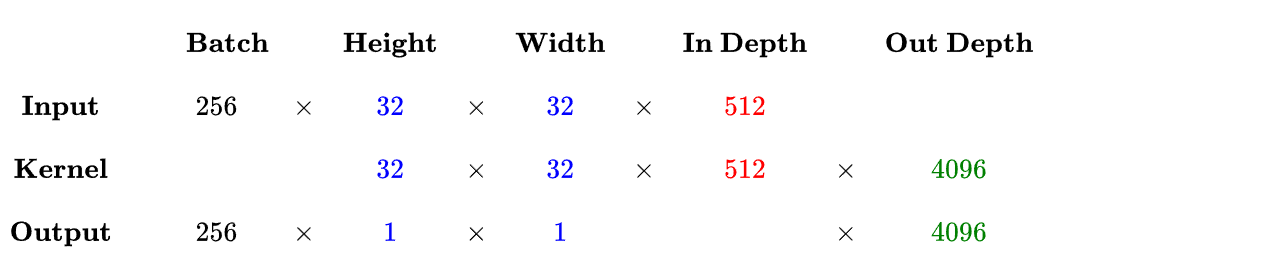

全连接层也可以视作是特殊的卷积

卷积核做的,就是与感受野范围内的像素点进行点积(非矩阵乘法)。