顶配版SAM!由分割一切迈向感知一切

前言 智源研究院视觉团队推出以视觉感知为中心的基础模型 TAP (Tokenize Anything via Prompting), 利用视觉提示同时完成任意区域的分割、识别与描述任务。将基于提示的分割一切基础模型 (SAM) 升级为标记一切基础模型 (TAP) ,高效地在单一视觉模型中实现对任意区域的空间理解和语义理解。

本文转载自PaperWeekly

仅用于学术分享,若侵权请联系删除

欢迎关注公众号CV技术指南,专注于计算机视觉的技术总结、最新技术跟踪、经典论文解读、CV招聘信息。

【CV技术指南】CV全栈指导班、基础入门班、论文指导班 全面上线!!

在计算机视觉领域,分割被视为感知的基础要素。通过分割,系统得以准确地定位和区分图像中的各个对象,为更深层次的感知提供了必要基础。全面的视觉感知不仅包括对图像进行分割,更涵盖对图像中对象与场景的语义理解、关系推断等高层次认知。

现有的视觉分割基础模型,如 SAM 及其变体,集中优势在形状、边缘等初级定位感知,或依赖外部模型完成更高级的语义理解任务。然而,迈向更高效的视觉感知则需要在单个模型中实现全面的视觉理解,以助力于更广泛的应用场景,如自动驾驶、安防监控、遥感以及医学图像分析等。

近日,智源研究院视觉团队推出以视觉感知为中心的基础模型 TAP (Tokenize Anything via Prompting), 利用视觉提示同时完成任意区域的分割、识别与描述任务。将基于提示的分割一切基础模型 (SAM) 升级为标记一切基础模型 (TAP) ,高效地在单一视觉模型中实现对任意区域的空间理解和语义理解。相关的模型、代码均已开源,并提供了 Demo 试用,更多技术细节请参考 TAP 论文。

论文地址:

https://arxiv.org/abs/2312.09128

项目&代码:

https://github.com/baaivision/tokenize-anything

模型地址:

https://huggingface.co/BAAI/tokenize-anything

Demo:

https://huggingface.co/spaces/BAAI/tokenize-anything

模型介绍

1.1 亮点

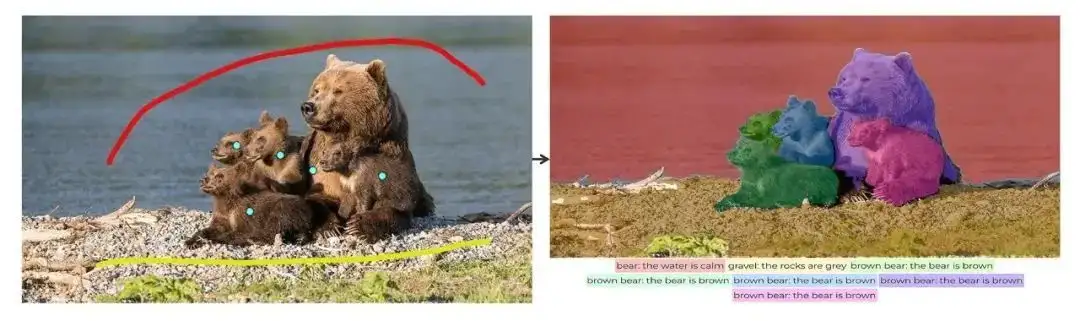

通用能力:TAP 是一个统一的可提示视觉基础模型,根据视觉提示(点、框、涂鸦)对任意区域内的目标同时进行分割、识别以及描述,最终汇聚成一组可用于综合评估区域内容的输出结果。

通用表征:TAP 将任意区域中的内容表示为紧凑的掩码标记和语义标记,掩码标记负责空间理解,语义标记则负责语义理解。因此,TAP 模型可以替代 SAM,CLIP 作为下游应用的新基础模型。

通用预训练:TAP 利用大量无语义的分割掩码,直接从通用 CLIP 模型中汲取开放世界知识。这种预训练新范式避免了使用与任意数据集相关的有偏差人工标注,缓解了物体在开放语义下的定义冲突与不完备问题。

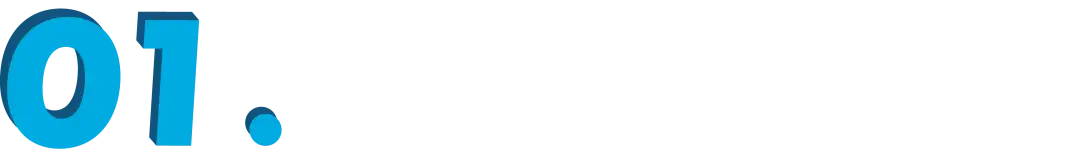

1.2 方法

视觉感知中的一个关键研究目标是如何高效地定位与识别任意感兴趣区域。这要求单一的可提示视觉模型同时具备分割、识别、与描述能力来充分地理解任意区域中的内容。同时,通过观察模型的多角度输出(分割、识别、文本生成),可以更加充分地评估和解释模型的理解能力(图a)。

现有的视觉基础模型因其预训练目标的不同,通常集中优势在单一的任务。例如 SAM 专注于空间理解能力,可以定位出与语义类别无关的分割掩码。另一方面,CLIP 及其各种变体则在视觉语义理解方面表现出色。因此,在 SAM 的架构中学习 CLIP 模型的语义先验,为全面的视觉感知提供了一个有效的途径。TAP 沿这一途径提出了如下的核心设计:

模型架构:为了实现一个统一的模型,TAP 在 SAM 架构的基础上,将掩码解码器升级为通用的图像解码器,同时输出掩码标记与语义标记(图b)。掩码标记负责预测分割掩码,语义标记则用于预测对应的语义标签和文本描述。

数据获取:训练一个多能力的视觉基础模型需要多样化标注的大规模数据集。然而,目前尚无公开的可同时用于分割与区域识别的大规模数据源。SA-1B 构建了 11 亿高质量掩码标注,用于训练分割基础模型,如 SAM。LAION-2B 收集了 20 亿图像-文本对,用于训练图文对齐模型,如 CLIP。

为了解决分割-文本对齐数据缺乏的问题,TAP 引入了 SemanticSA-1B 数据集(图c)。该数据集将来自 LAION-2B 的语义隐式地集成到 SA-1B 的分割数据中。具体而言,TAP 利用在 LAION-2B 数据集上训练的具有 50 亿参数的 EVA-CLIP 模型,预测 SA-1B 中的每一个分割区域在一个概念词汇上的分布。该分布提供信息最大化的语义监督, 避免模型在偏差过大的伪标签上训练。

模型训练:TAP 模型在 256 块寒武纪 MLU370 加速器上进行预训练,并行优化可提示分割与概念预测两个任务。给定一张图片及一个视觉提示,TAP 模型将感兴趣区域表示为一个掩码标记和一个语义标记。基于语义标记,扩展一个 MLP 预测器可实现开放词汇分类任务。同时,扩展一个轻量化的自回归文本解码器即可实现文本生成任务。

量化结果、可视化展示

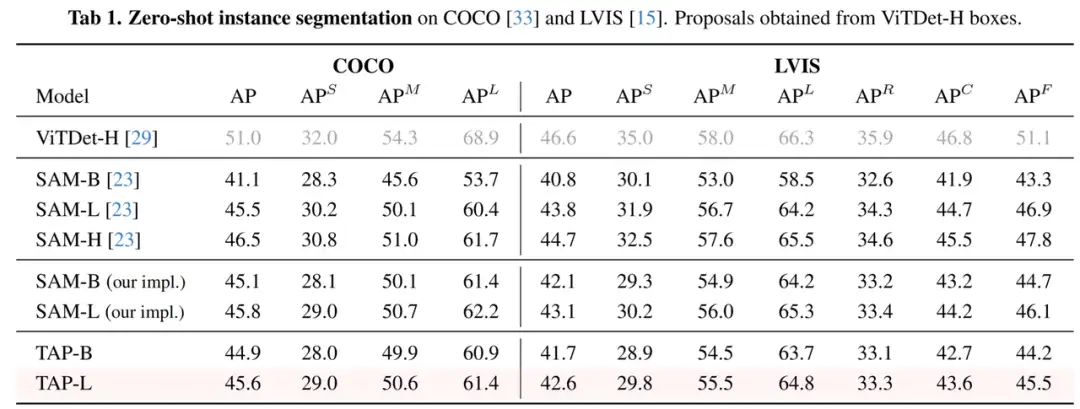

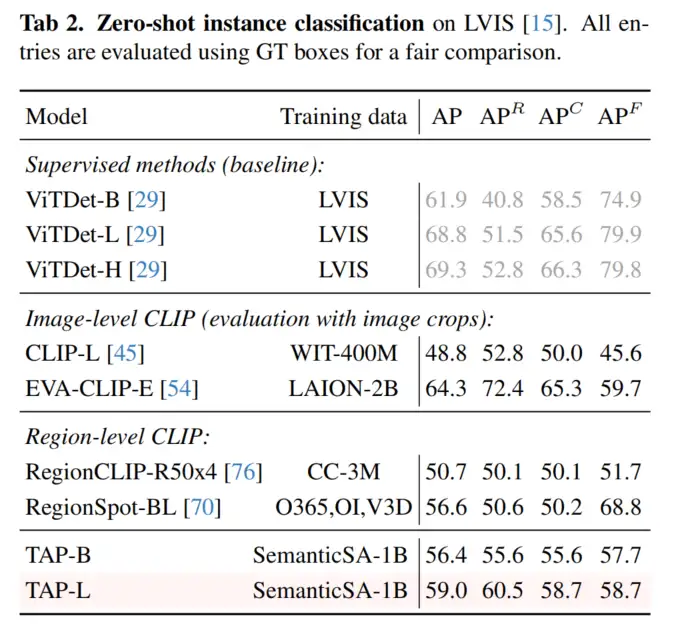

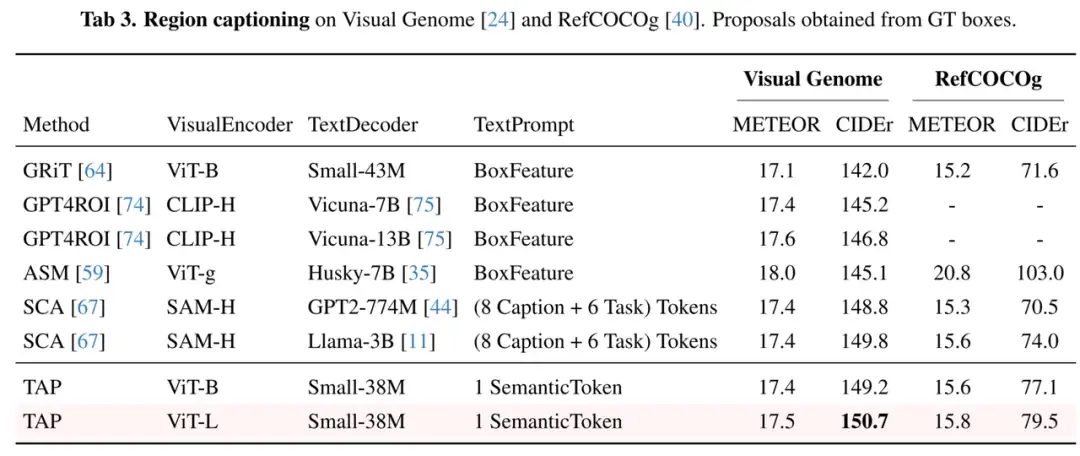

TAP 模型在零样本实例分割任务中取得了与 SAM 接近的分割精度(表1)。在零样本LVIS实例识别任务中,TAP 性能趋近于有监督检测模型的基线(表2)。基于 TAP 扩展的 38M 参数“小语言模型”在 Visual Genome 区域描述任务中取得了当前最优的 CIDEr 基准(表3),且参数量仅为此前最优方案 LLAMA-3B 的 1%。

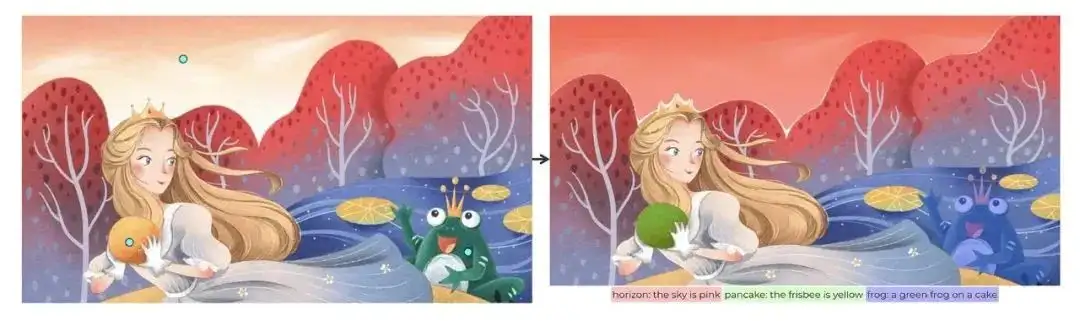

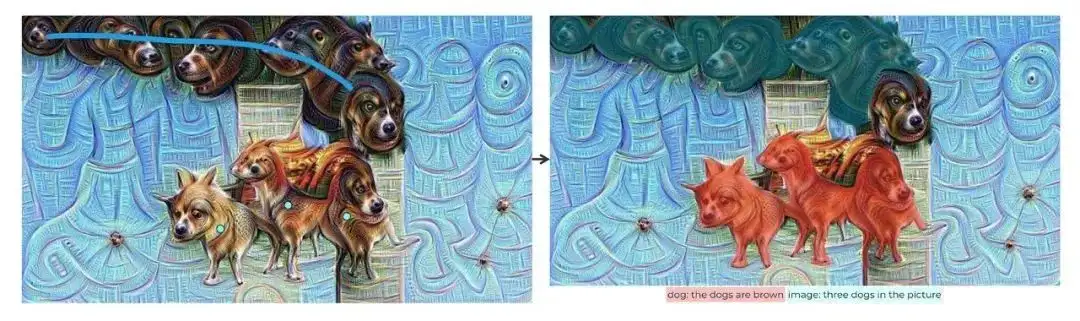

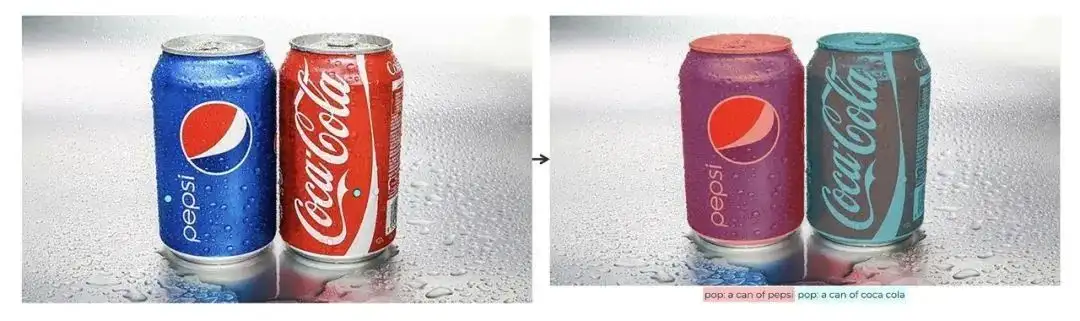

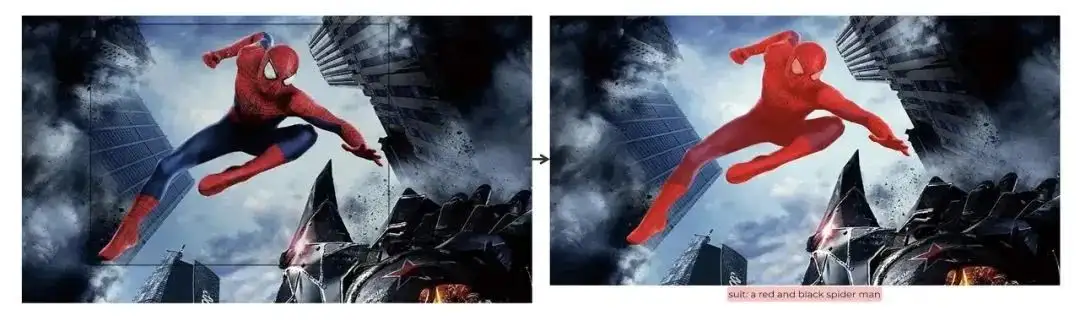

简单点击或涂鸦图片中感兴趣的目标,TAP 即可自动生成目标区域的分割掩码、类别标签、以及对应的文本描述,实现了一个模型同时完成任意的分割、分类和图像描述。

对于需要全景理解的场景,采用密集网格点作为提示,模型即可对场景内所有的目标进行分割、识别以及描述。

参考文献

[1] Alexander Kirillov, et al. Segment anything. ICCV, 2023.

[2] Alec Radford, et al. Learning Transferable Visual Models from Natural Language Supervision. ICML, 2021.

[3] Sun, et al. EVA-CLIP: Improved Training Techniques for CLIP at Scale. arXiv:2303.15389, 2023.

[4] Schuhmann, et al. LAION-5B: An Open Large-scale Dataset for Training Next Generation Image-Text Models. arXiv:2210.08402, 2023.

欢迎关注公众号CV技术指南,专注于计算机视觉的技术总结、最新技术跟踪、经典论文解读、CV招聘信息。

【技术文档】《从零搭建pytorch模型教程》122页PDF下载

QQ交流群:470899183。群内有大佬负责解答大家的日常学习、科研、代码问题。

其它文章

LSKA注意力 | 重新思考和设计大卷积核注意力,性能优于ConvNeXt、SWin、RepLKNet以及VAN

CVPR 2023 | TinyMIM:微软亚洲研究院用知识蒸馏改进小型ViT

ICCV2023|涨点神器!目标检测蒸馏学习新方法,浙大、海康威视等提出

ICCV 2023 Oral | 突破性图像融合与分割研究:全时多模态基准与多交互特征学习

HDRUNet | 深圳先进院董超团队提出带降噪与反量化功能的单帧HDR重建算法

南科大提出ORCTrack | 解决DeepSORT等跟踪方法的遮挡问题,即插即用真的很香

1800亿参数,世界顶级开源大模型Falcon官宣!碾压LLaMA 2,性能直逼GPT-4

SAM-Med2D:打破自然图像与医学图像的领域鸿沟,医疗版 SAM 开源了!

GhostSR|针对图像超分的特征冗余,华为诺亚&北大联合提出GhostSR

Meta推出像素级动作追踪模型,简易版在线可玩 | GitHub 1.4K星

CSUNet | 完美缝合Transformer和CNN,性能达到UNet家族的巅峰!

浙公网安备 33010602011771号

浙公网安备 33010602011771号