对残差神经网络,resnet的理解

参考资料

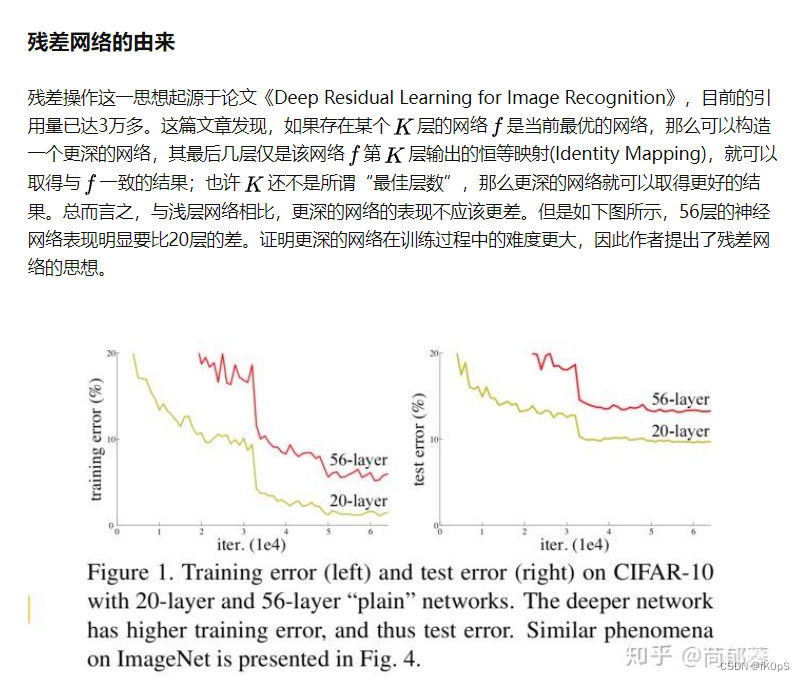

背景:遇到了挑战,随着网络深度的增加,模型的预测结果并没有编号。按道理,如果深度为20的网络已经达到不错的效果的话,深度增加到30层,后10层什么都不做,也能达到和20层一样的效果才对。但是实际上,随着深度的增加,效果反而变差了。

1、原因在于, 随着网络深度的增加,通过链式求导法则得到的梯度,容易产生梯度消失或者梯度爆炸。

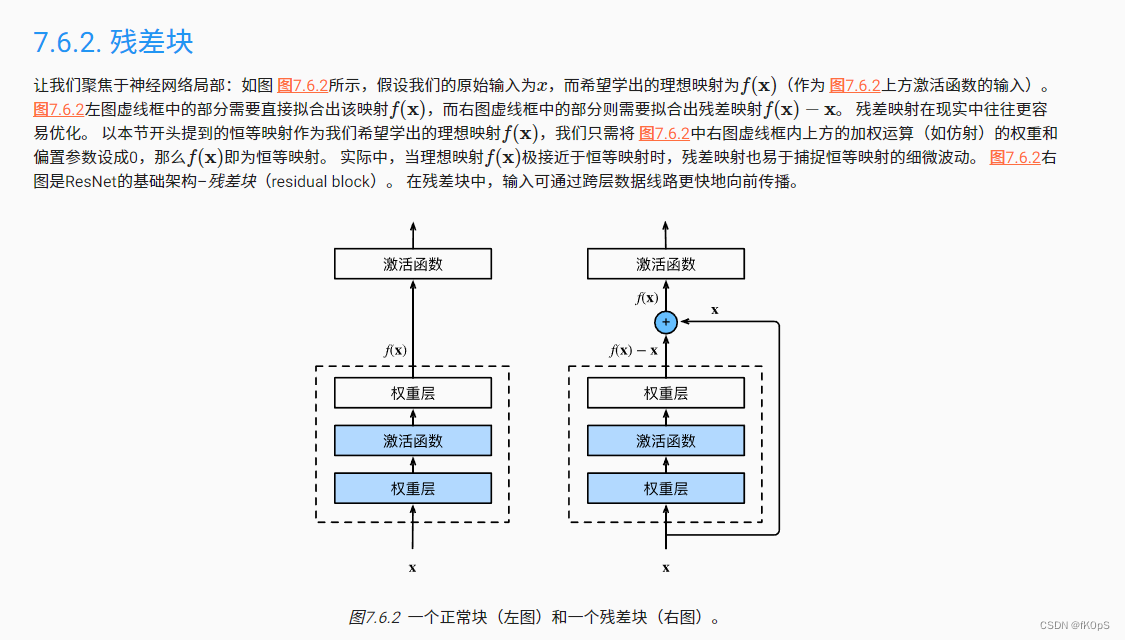

2、为了解决这个问题,残差网络的基本思路是 不忘初心。就每一层的卷积层除了接收上一层的输出外,还要叠加上原始数据,从而有效地避免了梯度消失问题。

3、通过短连接的方式,使得深层网络既具备了浅层网络的优势(网络不容易退化),又提升了模型整体的表达能力。

浙公网安备 33010602011771号

浙公网安备 33010602011771号