视频恶劣天气消除的扩散测试时间适应性

实践中的真知灼见:视频恶劣天气消除的扩散测试时间适应性

现实世界中的视觉任务经常受到意外恶劣天气条件的影响,包括雨、霾、雪和雨滴。在过去的十年里,卷积神经网络和视觉变换器在单天气视频去除方面取得了突出成果。然而,由于缺乏适当的适应,它们中的大多数无法推广到其他天气条件。尽管ViWS-Net被建议使用一组预训练权重来消除视频中的不利天气条件,但它在训练时受到可见天气的严重影响,在测试时遇到不可见天气时会退化。在这项工作中,将测试时间自适应引入到视频中的恶劣天气去除中,并提出了将测试时间适应集成到迭代扩散逆过程中的第一个框架。具体来说,设计了一种基于扩散的网络,该网络具有一种新的时间噪声模型,可以在训练阶段有效地探索退化视频片段中的帧相关信息。在推理阶段,引入了一个名为扩散管自校准的代理任务来学习测试视频流的引物分布,并通过近似时间噪声模型进行在线自适应来优化模型。

在基准数据集上的实验结果表明,基于扩散网络的测试时间自适应方法(Diff-TTA),在恢复因可见天气条件而退化的视频方面优于最先进的方法。它的泛化能力也在合成和现实世界视频中的看不见的天气条件下得到了验证。

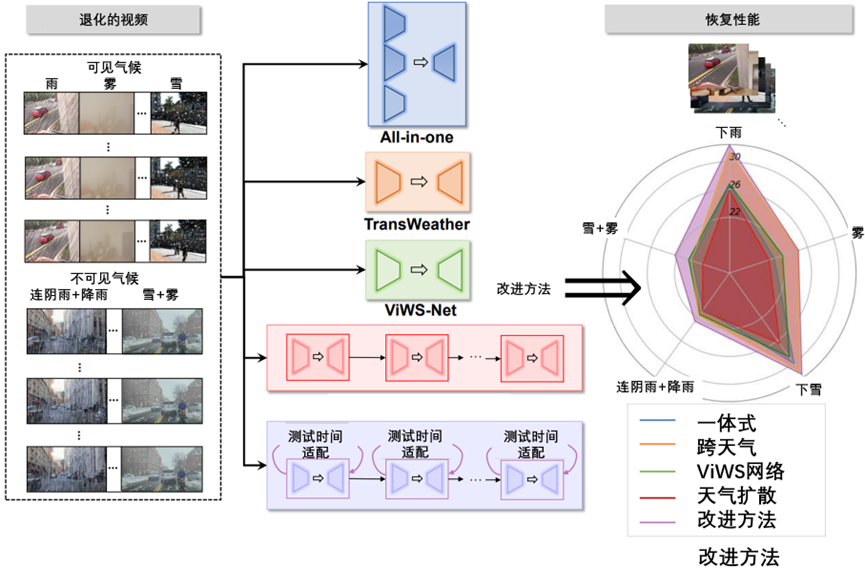

现有多功能恶劣天气清除方法概述,如图3-31所示。

添加图片注释,不超过 140 字(可选)

图3-31 现有多功能恶劣天气清除方法概述

在图3-31中,通过扩散测试时间自适应,方法不仅可以在可见的天气条件下,而且可以在不可见的天气情况下,通过一组预先训练的权重来实现卓越的性能。特别是,Diff-TTA比WeatherDiffusion的效率高90倍。

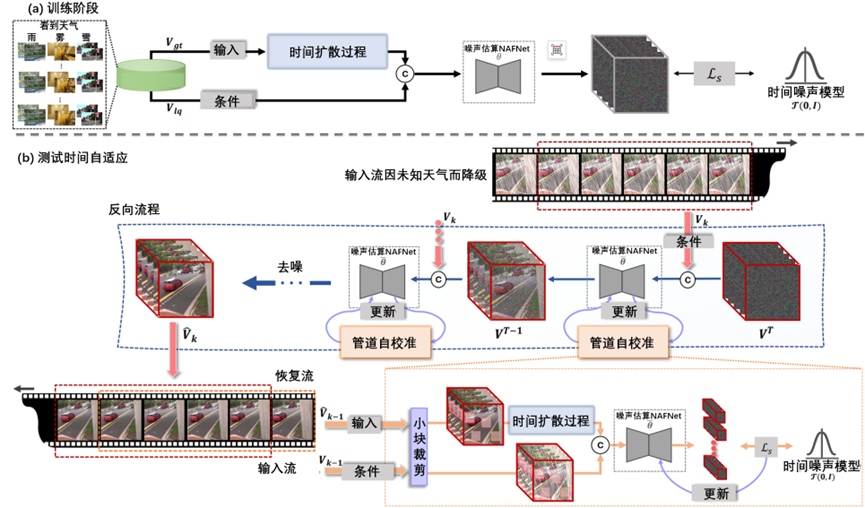

用于视频恶劣天气去除的Diff-TTA框架概述,如图3-32所示。

添加图片注释,不超过 140 字(可选)

图3-32 用于视频恶劣天气去除的Diff-TTA框架概述

在图3-32中,在训练阶段,通过时间扩散过程,在混合训练集中的清洁视频片段

添加图片注释,不超过 140 字(可选)

添加图片注释,不超过 140 字(可选)上随机添加时间噪声。然后,通过估计应用的噪声来训练去噪

添加图片注释,不超过 140 字(可选),该噪声由所见天气类型的退化对应

添加图片注释,不超过 140 字(可选),该噪声由所见天气类型的退化对应 来调节。在测试阶段,代理任务Diff TSC被合并到对随机采样的时间噪声

来调节。在测试阶段,代理任务Diff TSC被合并到对随机采样的时间噪声

添加图片注释,不超过 140 字(可选)

添加图片注释,不超过 140 字(可选)进行去噪的每个时间步长中,用于迭代在线自适应,其中利用最后一个恢复对

添加图片注释,不超过 140 字(可选)

添加图片注释,不超过 140 字(可选)的裁剪小管来学习引物分布。

人工智能芯片与自动驾驶

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 全程不用写代码,我用AI程序员写了一个飞机大战

· DeepSeek 开源周回顾「GitHub 热点速览」

· 记一次.NET内存居高不下排查解决与启示

· MongoDB 8.0这个新功能碉堡了,比商业数据库还牛

· .NET10 - 预览版1新功能体验(一)

2023-10-31 LLVM代码生成分析杂谈

2022-10-31 半导体-汽车电子电气-汇编语言-图像分析

2021-10-31 TVM量化代码解析