双目立体视觉技术杂谈

双目立体视觉技术杂谈

应用光学---双目立体视觉

双目视觉特征

当观察外界物体时,除了能够知道物体的大小、形状、亮暗以及表面颜色以外,还能够产生远近的感觉以及分辨不同的物体在空间的相对位置。这种远近的感觉称为空间深度感觉,对物体的空间位置的分布以及对物体体积的感觉,就是立体视觉。立体视觉无论是用单眼或者双眼观察时都能产生,但是双眼的深度感觉比单眼观察时强得多 ,也正确得多。单眼深度感觉的来源有以下几种:第一,当物体的高度已知时,根据它所对应的视角大小来判断它的远近。视角大则近,视角小则远;第二,根据物体之间的遮蔽关系和日光的阴影也能判断物体之间的相对位置;第三,根据对物体细节的鉴别程度和空气的透明度也能产生一定的深度感觉;第四,根据眼睛调节的程度 (即眼肌肉收缩的紧张程度)也能判定物体的远近。但是,只是对在2~3m以内的物体才能感觉出远近的差别。

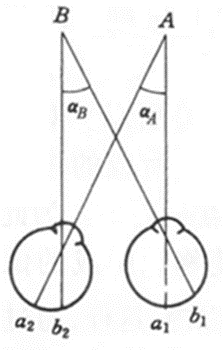

图1:双眼视物成像

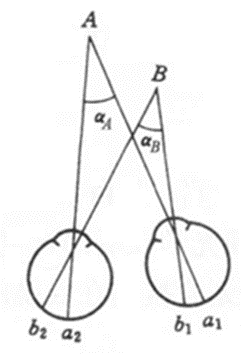

当用双眼观察时,除了上面这些因素以外还有两个因素:第一,当我们注视某一物体时,两眼的视轴就自动地对向该物体,如图1所示。物体的距离越近,视轴之间的夹角越大,由于视轴的夹角不同,使眼球发生转动的肌肉紧张程度也就不同。根据这种不同的感觉,即能辨别物体的远近。经验证明,这种感觉只是在16m以内才能产生,实际上能够精确判断的距离也只有几米;第二,双眼立体视觉,当用双眼观察物点A时,则双眼的视轴对向A点,二视轴之间的夹角α称为“视差角”,如图2所示。它在两眼中的像a1和a2均落在黄斑上。和A点距离相等有一点B,假定它在二视网膜上的像为b1和b2。显然A点和B点对两眼所张的角度相等,即αA=αB。视网膜上二像点之间的距离a1 b1=a2b2,并且b1和b2位在黄斑的同一侧。

图2:视差角

如果A、B两点的距离不等,则αA≠αB,B点的像b1和b2将位于黄斑的不同侧,如图3所示;

图3

或者,虽然位于黄斑同侧,但a1 b1≠a2 b2,如图4所示。

图4

B点在二视网膜上的像b1和b2不对应,因此视觉中枢就产生了远近的感觉称之为双眼立体视觉,它能够精确地判定二物点的相对位置。显然,这种不对应的程度取决于αA和αB之间的差Δα。人眼有可能感觉到的Δα的极限值 Δαmin称为“体视锐度”,Δαmin大约为 10″,甚至可能达到5″至 3″。无限远物点对应的视差角α∞=0。当物点对应的视差角α等于Δαmin时,人眼刚刚能分辨出它和无限远物点之间的距离差别,换句话说,它反映了眼睛有可能分辨出远近的最大距离。人眼二瞳孔之间的平均距离 b=62mm,Δαmin= 10″,则

lmax称为立体视觉半径。立体视觉半径以外的物体,人眼就不能分辨出它们之间的远近了。由图3可以看出

上式中l为物距,b为人眼的瞳间距。将上式两边微分,取绝对值得

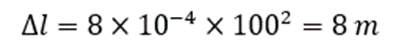

当Δα=Δαmin时,对应的Δl即为双眼立体视觉误差。由此可见,误差和物体距离的平方成正比,距离越远,立体视觉误差越大。将b=0.062m,Δα=0.00005(10″)代入上式得

例如在100m距离上,人眼的立体视觉误差为

双目立体视觉的春天

主要从投资角度和产业科普去看:

- 双目立体视觉是什么?

- 在汽车产业上有什么应用?

- 国内有哪些玩家?

- 未来发展与思考?

一、双目立体视觉是什么?我们生活在三维空间中,如何智能地感知和探索外部环境一直是个热点难题,汽车应用中不管智能驾驶还是人机交互,AR/VR中都是非常重视3D视觉感知。而双目立体视觉是3D视觉感知路径的一种,3D视觉的技术路径还包括结构光、ToF(Lidar就是Time of Flight的一种)以及工业三维测量等。双目立体视觉是左右眼固定基线(两个摄像头间距),通过三角测量的方式,推算出目标距离。

二、单目视觉与双目立体视觉的区别?2.1 技术原理双目更多的是基于物理测量,而单目视觉则是基于逻辑推理,通过大量的数据训练,先识别出目标,再根据目标的大小和高度估算距离。因此,单目视觉的漏检率高于双目立体视觉,因为客观上存在corner case。

2.2 输出信息单目视觉输出的是一个二维信息,而双目立体视觉输出的是三维信息,较之,多了一个深度信息。因此,双目立体视觉在后续与同样也具备深度信息的传感器比如激光雷达、4D毫米波雷达在深度信息的融合上会更加适配,也可以形成冗余。

2.3 产业链上下游情况双目立体视觉与单目视觉的产业链情况大致相同,主要包括上游是零部件供应商(光学镜头、图像传感器、壳体、连接器等)、中游是系统集成商、下游是主机厂。产业链的不同之处主要在于软件算法。单目视觉的软件算法主要是深度学习,而双目立体视觉的软件算法则更为复杂,还包括双目对齐、图像矫正、立体匹配等。

三、车载领域双目立体视觉适用的场景?

汽车的感知无外乎对外的环境感知,对内的乘客感知交互,如上文讲到的我们人类生活的空间是三维空间,要实现环境以及人类的准确感知,必须实现三维感知。在车载领域双目视觉主要用于以下场景:

- 车外:智能驾驶的一些特定场景(如“鬼探头”、“加塞”、“限高”等)以及底盘预瞄用于车辆动态控制。

- 车内:驾驶员监控系统(DMS),目前主流的DMS是单个红外线ToF摄像头。未来内车内座位是否有人和物体进行识别等等。

四、目前市场上双目立体视觉的玩家?

双目摄像头在手机上的应用开始于2007年左右的三星手机,主要是用于3D图片和视频拍摄,此后开启了手机摄像头的浴霸模式;汽车上首次应用是2013年的奔驰S,主要是用于紧急制动的安全功能的冗余。

在汽车上由于双目的视觉算法和硬件一致性的难度问题,主要是被价格相对高的一众豪车采用,供应链也主要是来自于欧美日的维宁尔,大陆,博世,电装。

在国内玩家:目前跑得比较快的玩家包括大疆、华为、元橡科技、中科慧眼、鉴智科技等。

大疆:

2016年3月,大疆发布全球首款具备机器视觉能力的消费级无人机-大疆精灵4,通过安装在机身支架位置的一对前向双目摄像头,以及惯导、超声波等传感器,首次实现了“障碍感知”、“智能跟随”等智能功能。同年,公司开始探索智能驾驶领域。有了应用在无人机产品上的双目技术的经验积累,在车载领域公司于2022年9月出货上汽通用五菱旗下宝骏KIWI,实现ADAS功能,目前底盘预瞄功能还未量产上车。

华为:

公司早期在手机领域如P9和P10就采用了双目立体视觉来实现测距、景深控制和背景虚化等功能,随后在车载领域的研究也是基于手机领域的积累。已出货极狐阿尔法S和阿维塔11,实现ADAS功能,目前底盘预瞄功能还未量产上车。

元橡科技:

成立于2017年,核心团队来自日本理光。公司于2018年与保隆科技在双目立体视觉领域展开合作,并设有合资公司。已定点多家乘用车,预计今年量产交付。元橡的优势更多在于有自研芯片以及对立体视觉图像的处理能力深刻。

注:(理光Ricoh,1936年成立于日本东京,以生产精密光学设备起家,拥有先进的光学技术和图像处理技术,与丰田在双目立体视觉领域有深入合作。)

中科慧眼:

成立于2014年,核心团队来自中科院。老股东包括百度、中鼎股份等。有自己工厂,专利储备丰富,目前主要营收还是来自于后装ADAS,前装双目ADAS乘用车有定点,还未量产上车。

鉴智科技:

成立于2021年,核心团队来自深鉴科技。公司提供通过AI驱动的双目立体视觉系统,并于2023年4月与孔辉科技在双目视觉领域展开合作。相比于另外两家创业公司,鉴智成立时间更短,但它的优势在于团队简历亮眼,以及对AI深刻的理解。

值得一提的是目前国内乘用车市场上空气悬架的头部公司就是保隆科技、孔辉科技以及中鼎股份这三家,而这三家又分别与三家创业公司开展了合作,也侧面说明了大家对底盘预瞄市场的看好。

底盘预瞄是指双目立体视觉传感器预先识别道路类型等路面信息,通过立体匹配得到点云图,实时发送给底盘悬架系统来实现主动调节。也就是比亚迪于2023年4月10日发布的“云辇”-X系统采用的技术方案。

目前来看,双目立体视觉是实现底盘预瞄功能的最佳选择。虽然其它传感器,比如激光雷达也可以,但是要达到生成高程图的激光雷达,他必须要达到测绘级,精度极高,价格也极高,而当前智能驾驶用的激光雷达例如所谓192线,百位数甚至更高显然达不到对路面3D细致的扫描,而摄像头动辄百万像素更容易。

五、上车需求?

ADAS功能目前L2及以下,主流方案还是1R1V(单目),所以这里具体对比一下1R1V(单目)和1R1V(双目)方案。1R1V(单目)里Mobileye的芯片方案在2019年以前市场一直处于垄断地位,但由于它黑盒交付、很难迭代等问题,逐渐在市场上被T1的TDA4和地平线J3蚕食部分份额,到目前,差不多三家方案的市场竞争格局为五三二的局面。而1R1V(双目)还未形成比较明显的市场格局,各家方案也有所不同,有的选用专用ASIC芯片,放在边缘侧,有的选用通用芯片,放在域控制器里。整体来看,商用车更偏向ASIC方案,这样数据处理可以直接在边缘侧完成,商用车对装域控制器的需求不大。乘用车性价比方案偏向ASIC,而越高阶越会倾向选择大算力SOC。1R1V(单目)方案一套单车价值量约900元,其中前向毫米波雷达350元,单目镜头50元,图像传感器50元,其它硬件(PCBA、横梁、壳体等)100元,Mobileye“芯片+视觉算法”350元。而1R1V(双目)方案中前向毫米波雷达350元,双目镜头100元,图像传感器100元,其它硬件(PCBA、横梁、壳体等)100元,如果用通用SOC芯片比如TDA4,一颗40美元,要用2颗,约560元,一共1210元;如果用ASIC芯片,和一颗小SOC,芯片成本会下降,整体成本比单目略贵一点。双目立体视觉、4D毫米波雷达以及激光雷达,各式各样的传感器五花八门,但最终主机厂会选择用哪类传感器,最关键的因素还是在于成本。双目其实是一个很早就在汽车产业中应用存在的技术路径,市场一直渗透率不高的原因一方面在于它的技术门槛较高(算法、制造工艺,质量一致性等),被欧美少数几个玩家闭环把控,另一方面也可能是因为技术上的缺陷(基线在一定程度上限制了双目的测量范围)而导致实际需求没有起来。而国产手机互联网智能供应链的到来,从手机互联网端成熟的技术和应用将会极大的拉低双目的应用生态。总体来看,双目立体视觉的春天有以下三个机遇与挑战,第一,就单实现ADAS功能而言,双目厂商想要杀进来分一杯羹有点难,目前国内ADAS玩家很多,竞争激烈,各家毛利都不高,想要杀出来很要挑战。另外,现在无论是低阶还是高阶自动驾驶,主机厂越来越注重性价比和实际使用效果,而不是单纯堆硬件了;第二,底盘预瞄存在机会,底盘预瞄市场参考空气悬架市场,主机厂主打差异化、舒适化,目标车型在30W以上的车;第三,如果“ADAS+底盘预瞄”可以实现传感器复用的话,性价比倒是不错,可以持续跟踪,但是传感器复用很难由供应商发起,必须要主机厂有想法。

六、最后提个小思考

早期自动驾驶方案采用“激光雷达+高精地图”为主,然而,高昂贵的单车成本成为自动驾驶大规模推广的瓶颈。2021年特斯拉推出“BEV+transformer”,开启了自动驾驶行业新的篇章。到今年,很多主机厂积极跟进。“BEV+transformer”做到了空间和时间维度的统一,BEV(bird’s eye view)鸟瞰图中,物体天然就带了位置信息,把它丢到神经网络当中,从而输出三维的向量信息,而把组合导航丢到神经网络当中,又实现了时序的统一。该方案可以减少对毫米波雷达和激光雷达的依赖。之所以要用多传感器融合,是因为需要利用不同传感器的优点。比如激光雷达的优点在于它可以准确判断周围障碍物的位置信息和三维信息,毫米波雷达的优点在于它可以判断物体的速度信息,而这些在BEV里都得到了解决。在马斯克第一性原理的指导下“BEV+transformer”方案使得整体对硬件要求变低了,这又是个值得思考的事情。

参考文献链接

https://mp.weixin.qq.com/s/9-VT4tHeUbeQGpYLJQc6Bg

https://mp.weixin.qq.com/s/OwV64Acp8P6Z8uLuYmIT4w