神经网络与深度学习[邱锡鹏] 第六章习题解析

6-1

三者都是典型的神经网络模型。

卷积神经网络是对前馈神经网络增加卷积层和池化层。

延时神经网络是对前馈神经网络增加延时器。

循环神经网络是对前馈神经网络增加自反馈的神经元。

延时神经网络和循环神经网络是给网络增加短期记忆能力的两种重要方法。

卷积神经网络和循环神经网络的区别在循环层上。

卷积神经网络没有时序性的概念,输入直接和输出挂钩;循环神经网络具有时序性,当前决策跟前一次决策有关。

举个例子,进行手写数字识别的时候,我们并不在意前一个决策结果是什么,需要用卷积神经网络;(图像识别)

而自然语言生成时,上一个词很大程度影响了下一个词,需要用循环神经网络。(自然语言处理)

6-2

推导公式(6.40)和公式(6.41)中的梯度。

基本和(6.39)的公式一致。

主要差别在于Zk对于Uij和Zk对于Wij、Bij的偏导上。

6-3

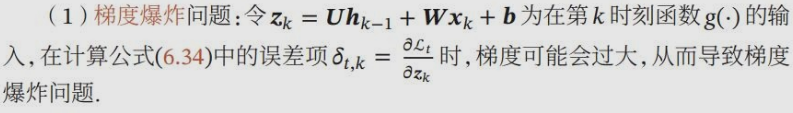

原因:

其中6.34的误差项为6-2中的德尔塔t,k

解决方法:

增加门控机制,例如:长短期记忆神经网络(LSTM)。

6-4

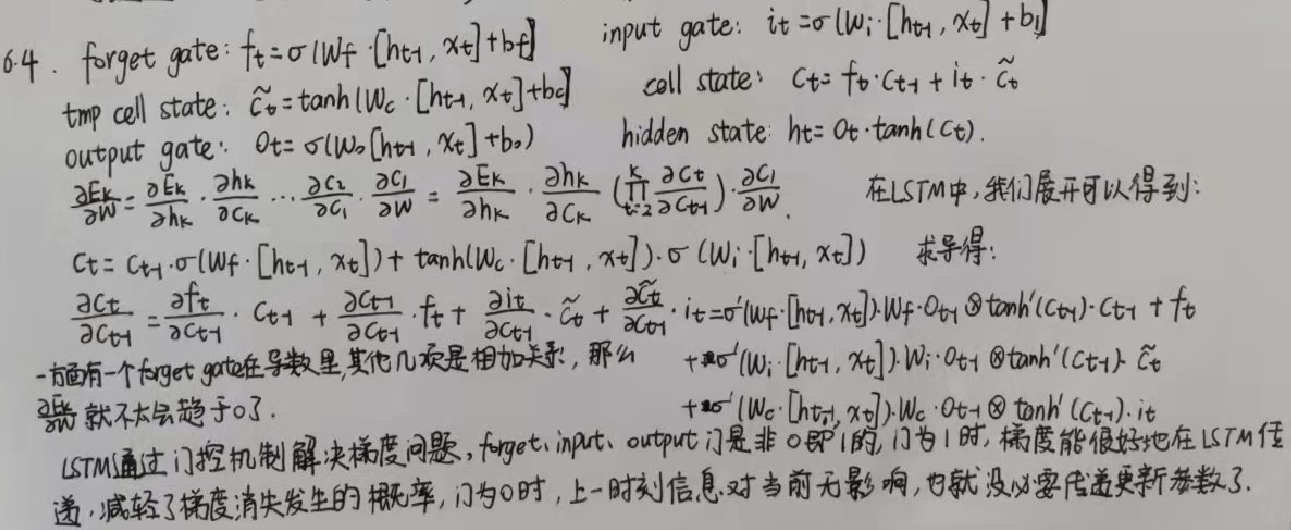

推导LSTM网络中参数的梯度,并分析其避免梯度消失的效果。

其中,E是损失函数。

6-5(我透)

推导GRU网络中参数的梯度,并分析其避免梯度消失的效果。

6-6

增加深度的方法是:增加同一时刻网络输入到输出之间的路径Xt->Yt(Xt->Ht或者Ht->Yt)

常见结构除了堆叠循环神经网络,还有双向循环神经网络、递归神经网络、图神经网络等。

6-7[..]

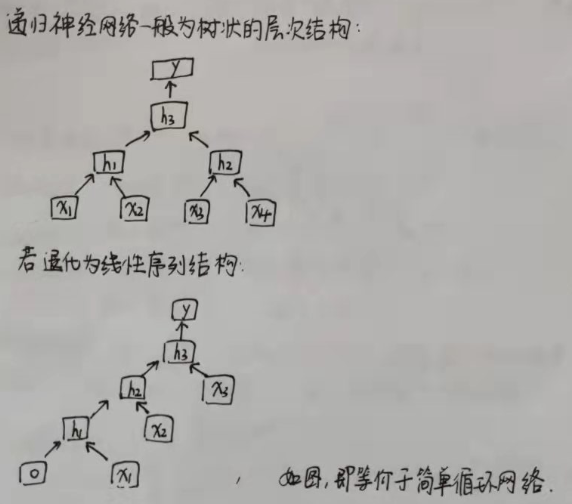

证明当递归神经网络的结构退化为线性序列结构时,递归神经网络就等价于简单循环网络