GRU网络

1.GRU(Gated Recurrent Unit)

为了克服RNN无法远距离依赖而提出了LSTM,而GRU是LSTM的一个变体,GRU保持LSTM效果的同时,又使结构变得简单。

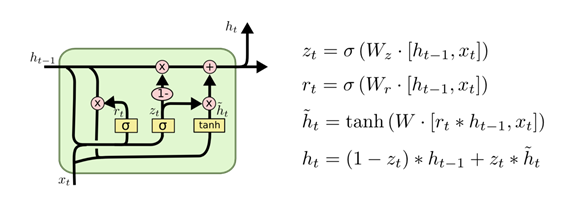

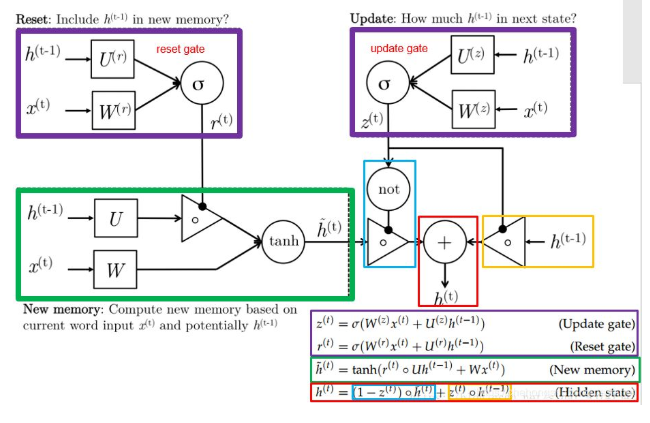

2.GRU结构

GRU只有两个gate,一个是reset gate,一个是update gate,update gate类似于input gate 和forget gate,

重置门用于控制忽略前一时刻的状态信息程度,重置门的值越小,说明忽略的越多

更新门用于控制前一时刻的状态信息被带入到当前状态中的程度,,更新门越大,说明前一时刻的状态信息带入越多。

输入两个值,输出为一个值,输入为此使时刻x和上一时刻ht-1,输出这个时刻的ht

3.LSTM和GRU的不同

3.1结构上

LSTM 3个输入Xt Ht-1 Ct-1,两个输出Ht Ct。GRU两个输入,Xt,Ht-1,一个输出Ht。

LSTM有3个门,而GRU只有两个门

3.2功能上

GRU参数更少,训练更快,相比之下需要的数据量更少

3.3记忆方式不同

LSTM是Xt和Ht-1分别权重相乘相加,经过tanh函数,此时得到新memory

GRU为Ht-1权重乘积之后和reset gate相乘,再经过tanh函数,最终得到new memory,reset gate作用是让这个new memory包括之前ht-1的信息的多少。

浙公网安备 33010602011771号

浙公网安备 33010602011771号