Hive 文件存储格式

Hive支持的存储数据的格式主要有:TEXTFILE、SEQUENCEFILE、ORC、PARQUET。

1、列式存储和行式存储

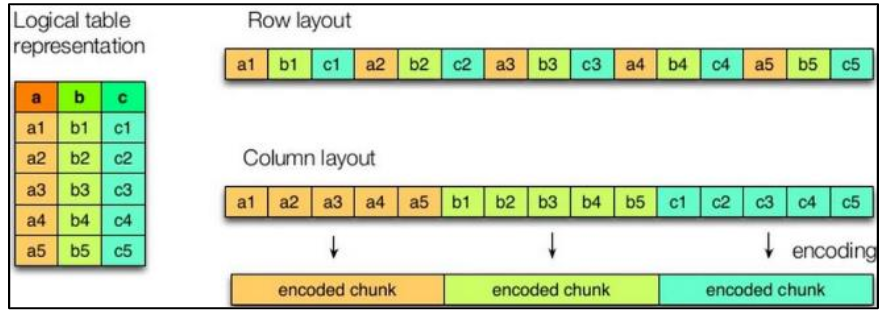

如图所示左边为逻辑表,右边第一个为行式存储,第二个为列式存储。

行存储的特点:查询满足条件的一整行数据的时候,列存储则需要去每个聚集的字段找到对应的每个列的值,行存储只需要找到其中一个值,其余的值都在相邻地方,所以此时行存储查询的速度更快。

列存储的特点:因为每个字段的数据聚集存储,在查询只需要少数几个字段的时候,能大大减少读取的数据量;每个字段的数据类型一定是相同的,列式存储可以针对性的设计更好的设计压缩算法。

TEXTFILE和SEQUENCEFILE的存储格式都是基于行存储的;

ORC和PARQUET是基于列式存储的。

2 TextFile格式

默认格式,数据不做压缩,磁盘开销大,数据解析开销大。可结合Gzip、Bzip2使用,但使用Gzip这种方式,hive不会对数据进行切分,从而无法对数据进行并行操作。

3 Orc格式

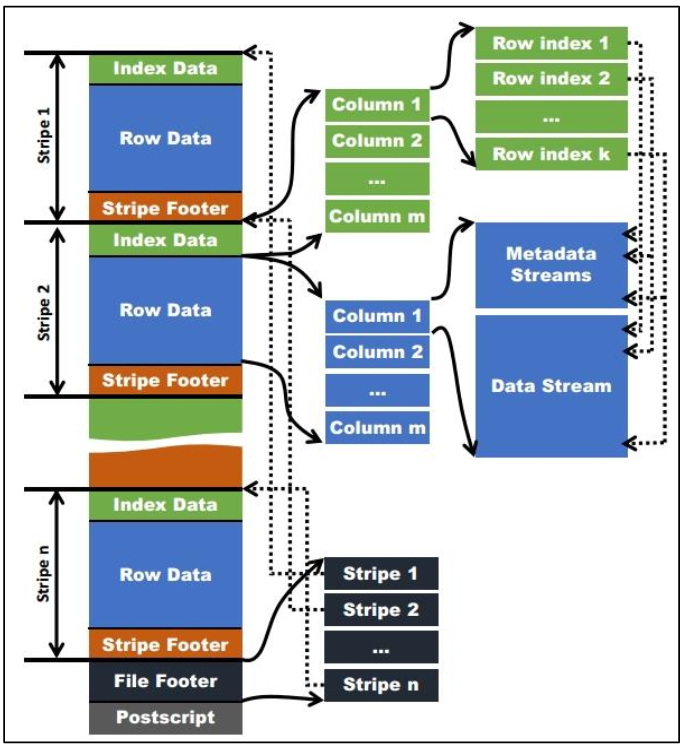

Orc (Optimized Row Columnar)是Hive 0.11版里引入的新的存储格式。如下图所示可以看到每个Orc文件由1个或多个stripe组成,每个stripe一般为HDFS的块大小,每一个stripe包含多条记录,这些记录按照列进行独立存储,对应到Parquet中的row group的概念。每个Stripe里有三部分组成,分别是Index Data,Row Data,Stripe Footer:

- Index Data:一个轻量级的index,默认是每隔1W行做一个索引。这里做的索引应该只是记录某行的各字段在Row Data中的offset;

- Row Data:存的是具体的数据,先取部分行,然后对这些行按列进行存储。对每个列进行了编码,分成多个Stream来存储;

- Stripe Footer:存的是各个Stream的类型,长度等信息;

4、Parquet格式

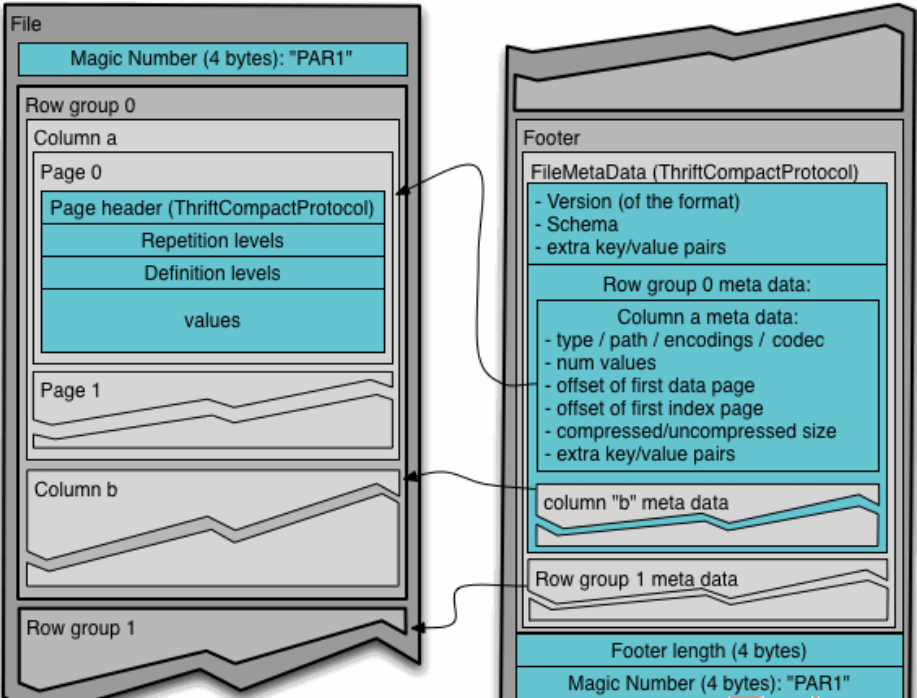

- 行组(Row Group):每一个行组包含一定的行数,在一个HDFS文件中至少存储一个行组,类似于orc的stripe的概念。

- 列块(Column Chunk):在一个行组中每一列保存在一个列块中,行组中的所有列连续的存储在这个行组文件中。一个列块中的值都是相同类型的,不同的列块可能使用不同的算法进行压缩。

- 页(Page):每一个列块划分为多个页,一个页是最小的编码的单位,在同一个列块的不同页可能使用不同的编码方式。

上图展示了一个Parquet文件的内容,一个文件中可以存储多个行组,文件的首位都是该文件的Magic Code,用于校验它是否是一个Parquet文件,Footer length记录了文件元数据的大小,通过该值和文件长度可以计算出元数据的偏移量,文件的元数据中包括每一个行组的元数据信息和该文件存储数据的Schema信息。除了文件中每一个行组的元数据,每一页的开始都会存储该页的元数据,在Parquet中,有三种类型的页:数据页、字典页和索引页。数据页用于存储当前行组中该列的值,字典页存储该列值的编码字典,每一个列块中最多包含一个字典页,索引页用来存储当前行组下该列的索引,目前Parquet中还不支持索引页。

5、主流文件存储格式对比实验

select mysplit("hello,world,hadoop,hive", ","); //建表 create table log_text ( track_time string, url string, session_id string, referer string, ip string, end_user_id string, city_id string ) row format delimited fields terminated by '\t' stored as textfile; //加载数据 load data local inpath '/opt/module/hive/datas/log.data' into table log_text ; //查看表中数据大小 dfs -du -h /user/hive/warehouse/log_text;

18.13M /user/hive/warehouse/log_text/log.data

create table log_orc ( track_time string, url string, session_id string, referer string, ip string, end_user_id string, city_id string ) row format delimited fields terminated by '\t' stored as orc tblproperties ("orc.compress" = "NONE");--设置orc存储不使用压缩 //加载 insert into table log_orc select * from log_text; //查看文件大小 dfs -du -h /user/hive/warehouse/log_orc/ ;

7.7M /user/hive/warehouse/log_orc/000000_0

Parquet

create table log_parquet ( track_time string, url string, session_id string, referer string, ip string, end_user_id string, city_id string ) row format delimited fields terminated by '\t' stored as parquet; //加载数据 insert into table log_parquet select * from log_text; //查看大小 dfs -du -h /user/hive/warehouse/log_parquet/;

13.1 M /user/hive/warehouse/log_parquet/000000_

存储文件的对比总结:ORC > Parquet > textFile

存储文件的查询速度测试:

insert overwrite local directory '/opt/module/data/log_text' select substring(url,1,4) from log_text; insert overwrite local directory '/opt/module/data/log_orc' select substring(url,1,4) from log_orc; insert overwrite local directory '/opt/module/data/log_parquet' select substring(url,1,4) from log_parquet;

存储文件的查询速度总结:查询速度相近。

浙公网安备 33010602011771号

浙公网安备 33010602011771号