基于本地知识库和LLM的知识库问答难点及解决方案

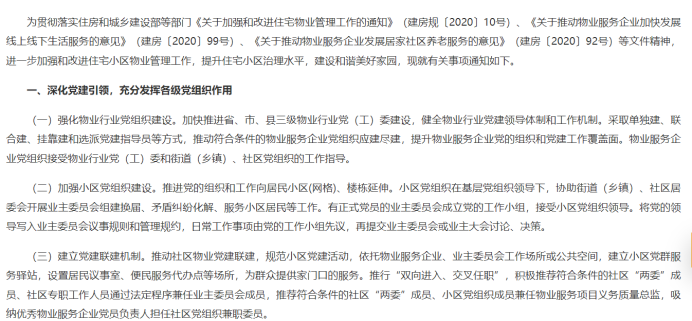

难点:由于langchain采用的是硬切分文档的方式,导致文档分割不够准确,例如:在文档中若有分点描述的情况,对文档硬性分割后,会把各个重点分隔开,导致后续向量召回时,片段是残缺的。如:

如果硬性分割文档,则在召回阶段拿不到所有的通知信息。

解决方案:考虑使用语义分析的方式来分割文档,BERT模型训练时有个NSP的任务,即预测句子是否为上一句的下一句,所以bert是具有预测两句子之前是否有语义衔接的能力的。在对文档分割时,我们既可以对段落进行分割也可以对句子进行分隔,设置一个阈值,将文档从前往后根据两句子(两段落)的衔接度跟阈值比较即可。代码实现如下:

1 def is_nextsent(sent, next_sent): 2 encoding = tokenizer(sent, next_sent, return_tensors="pt",truncation=True, padding=False) 3 with torch.no_grad(): 4 outputs = model(**encoding, labels=torch.LongTensor([1])) 5 6 logits = outputs.logits 7 probs = torch.softmax(logits, dim=1) 8 next_sentence_prob = probs[:, 0].item() 9 if next_sentence_prob <= FLAG_RATIO: 10 return False 11 else: 12 return True

附:可以根据业务的具体情况对段落、句子进行分隔并加入向量库

浙公网安备 33010602011771号

浙公网安备 33010602011771号