StructBERT模型记录

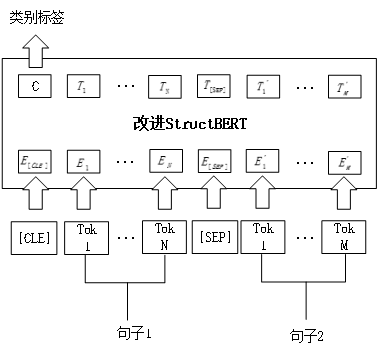

StructBERT模型是达摩院提出的Bert系列模型,相比BERT模型而言,主要增加了两个预训练任务来提升模型性能:

1、Word Structural Objective

Word Structural Objective是从未被遮掩的序列中以5%的几率选择部分长度为3子序列,将子序列中的词序打乱,让模型重建原来的词序,从而使模型学习到句子中的词序关系。

2、Sentence Structural Objective

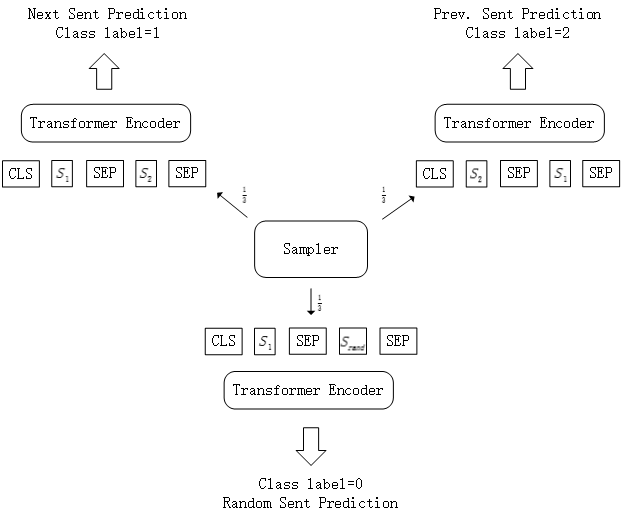

Sentence Structural Objective如上图所示,

给定句子对(S1,S2),判断S2是否是S1的下一个句子,或上一个句子,或毫无关联的句子。在采样时,对于一个句子S,1/3的概率采样S的下一句组成句对,1/3的概率采样S的上一句组成句对,1/3的概率随机采样一个其他文档的句子组成句对。

浙公网安备 33010602011771号

浙公网安备 33010602011771号