AEGNN: Asynchronous Event-based Graph Neural Networks

AEGNN: Asynchronous Event-based Graph Neural Networks

2022-06-07 17:01:45

1. Background and Motivation:

2. Approach

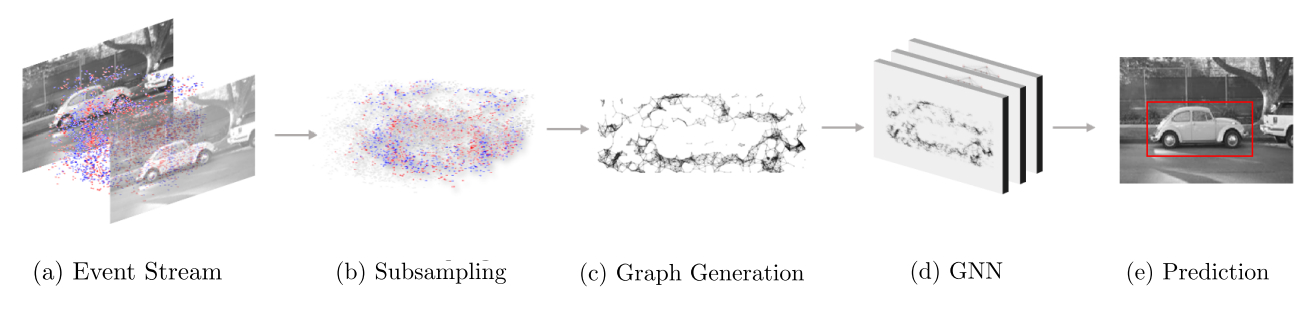

2.1. Graph Construction

作者提到因为 event 过于稠密,因此需要进行稀疏采样。与其他 event 数据的表示形式,如 event histograms 或者 event volumes,event stream 的完整时间分辨率被保存下来。这种高时间分辨率的特性在机器人应用中是非常关键的,如机器人避障。

作者借鉴了 iccv-2019 的一个工作,对 event 的时间信息进行了归一化处理。

对节点 i 和 j, 如果其两个节点特征 Xi 和 Xj 之间的距离在某一个范围 R 内,则认为这两点之间存在一个 edge eij。为了降低计算复杂度和对于进行正则化,作者限制了近邻节点的个数为 Dmax。

2.2. Asynchronous Processing:

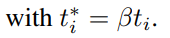

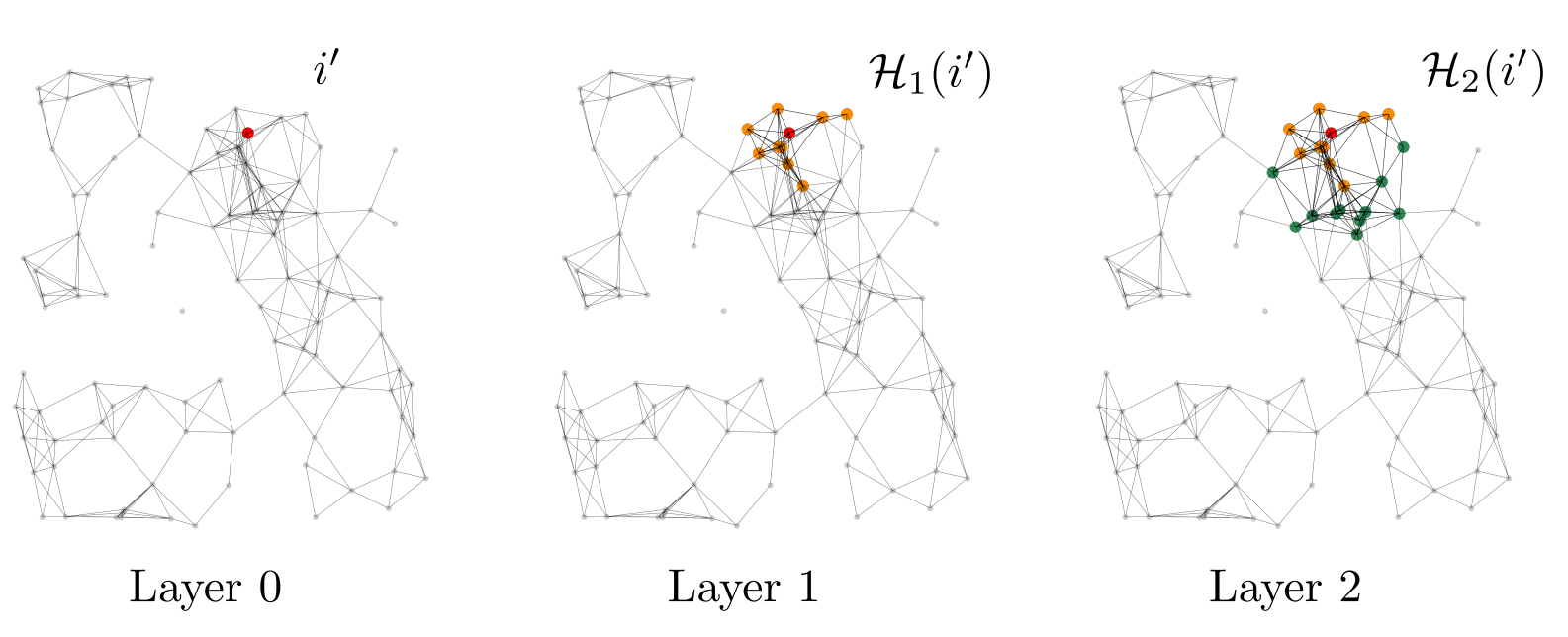

随着时间窗口的移动,新的事件会进入该窗口,而旧的事件将会离开。传统方法一般需要重新计算所有的激活,此处,作者提出了一种递归的形式可以将新进来的事件以最小的代价进行结合。因为新的事件到来后,一个新的节点将会进入 graph,然后其与附近的 node 会有一个连接。这种新的链接是 sparse 的,仅仅影响其局部的近邻事件。事实上,在第一层,新的事件仅仅影响到 1-hop sub-graph,对应的是新节点 i' 的近邻。所以,下一层的激活需要仅仅需要在该子图上进行计算:

随着达到更深的层,该子图进行拓展,在每一层步骤后 hopping 一个节点,直到第 N 层的(这里写的还真让人难以理解)。不同于传统方法处理整个 graph,这里仅仅进行子图级别的处理,以得到相同的处理结果。通过迭代的将这种概念应用到每一个 GCN 层之上,其前向传播可以稀疏的进行表达,从而显著的降低了计算代价。

==

Stay Hungry,Stay Foolish ...

浙公网安备 33010602011771号

浙公网安备 33010602011771号