人脸识别和检测中loss学习 - 1 -softmax loss

参考:https://www.jianshu.com/p/7e200a487916

1.什么是softmax

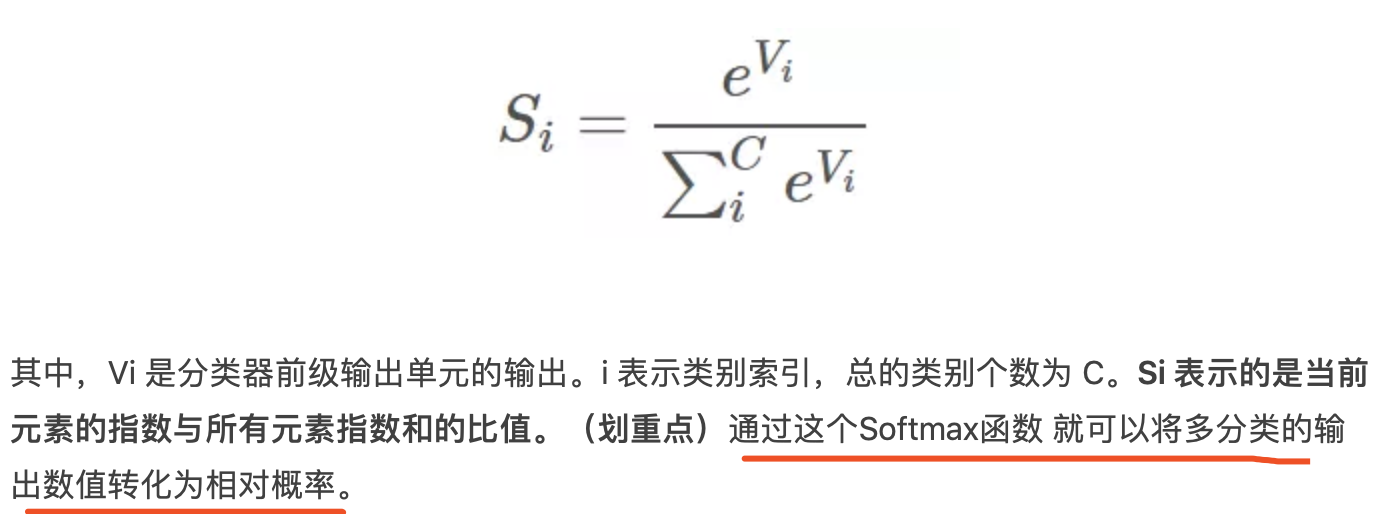

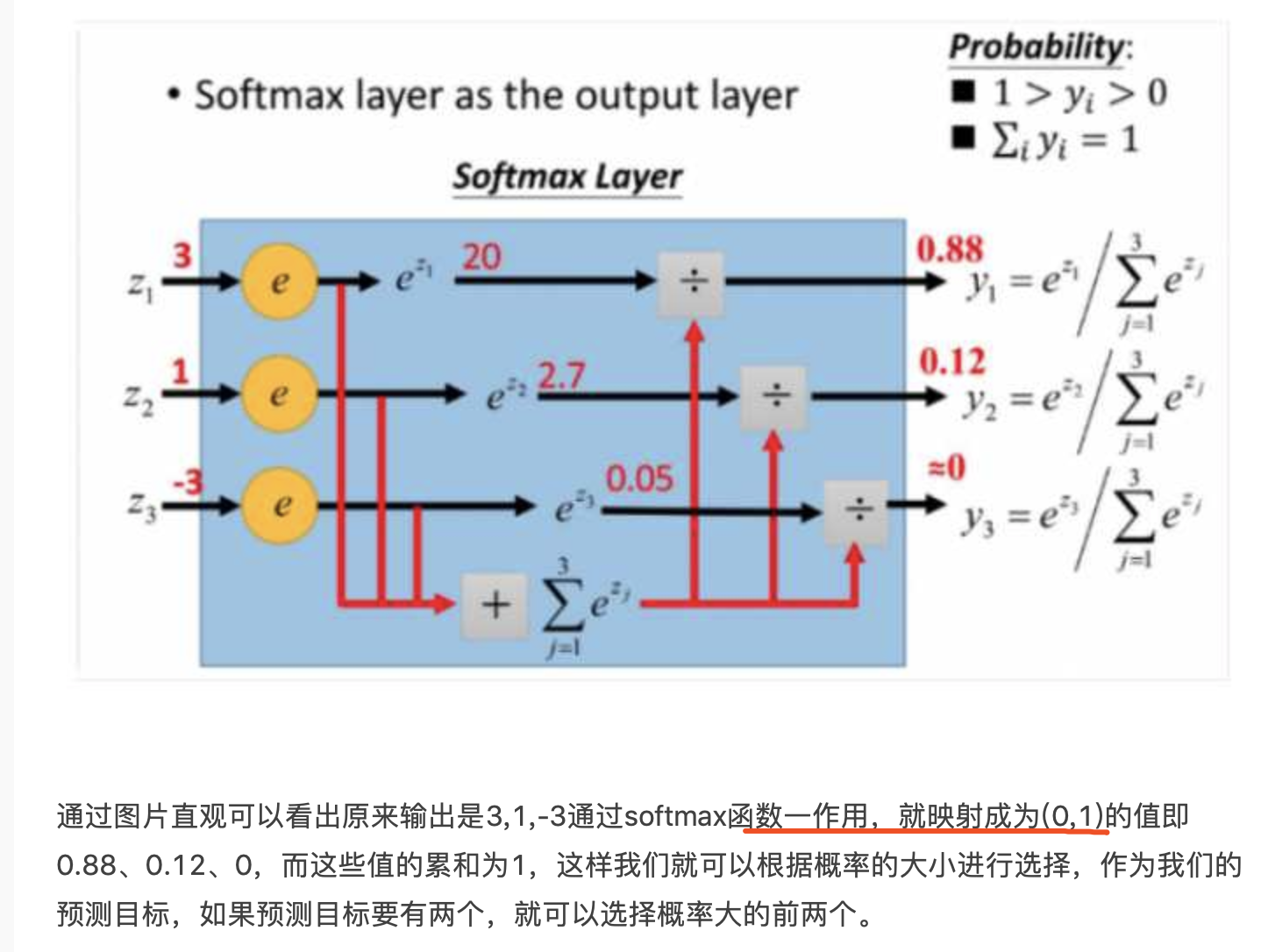

softmax是用于分类任务的,其实就是希望最后输出的结果值能在[0,1)之间,且归一化保证所有值的和为1

公式为:

下面的例子明白了为什么使用e次幂做除法了,因为分类其的输出Vi很可能是负值,e次幂操作得到的结果就都是正值(或接近0),这样才好求比例:

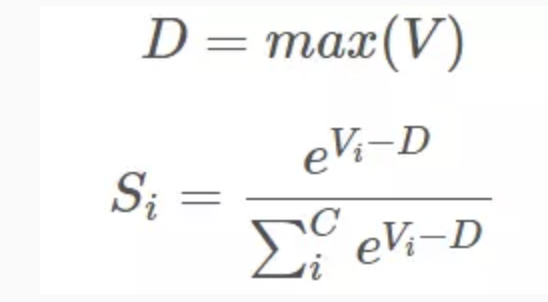

当然,因为是指数运算,往往也会因为网络输出值过大造成指数溢出的情况,所以需要进行一个数值处理:

即V中的每个元素减去V中最大值:

2.softmax损失函数求导

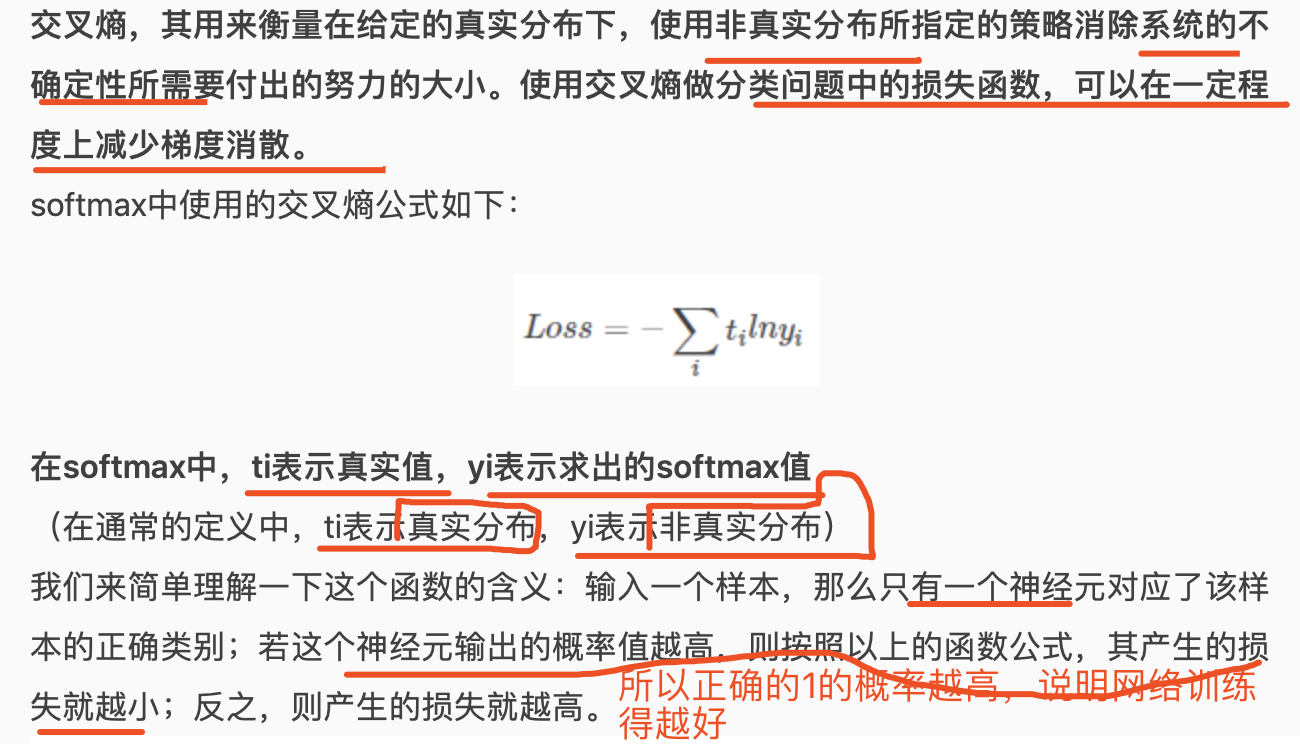

在多分类任务中,我们经常使用交叉熵作为损失函数

1)什么是交叉熵

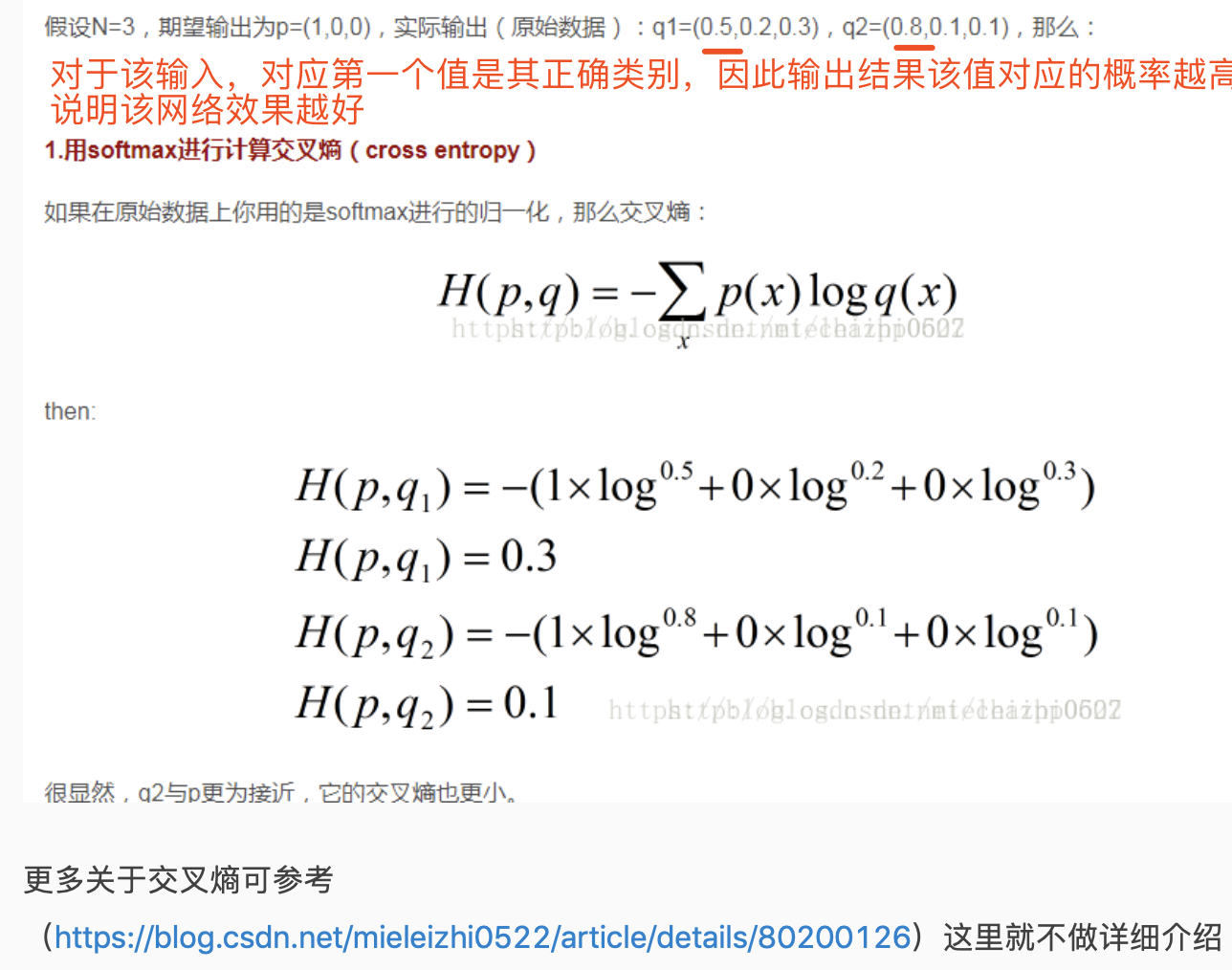

举例说明:

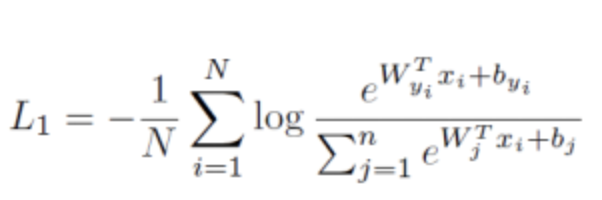

传统的softmax loss损失函数也可写为:

2)求导

具体求导过程: