F1 - Score\Precision\Recall The Single number evaluation metric(单一评估标准)

以下指标可以作为衡量分类问题的准确度的标准

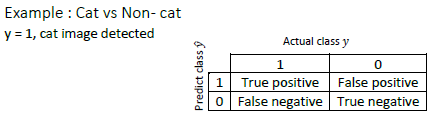

Precision

Precision(%)= T r u e p o s i t i v e n u m b e r o f p r e d i c t e d p o s i t i v e ∗ 100 = T r u e p o s i t i v e T r u e p o s i t i v e + F a l s e P o s i t i v e ∗ 100 \frac{True \ positive}{number\ of \ predicted \ positive}*100=\frac{True \ positive}{True \ positive + False \ Positive}*100 number of predicted positiveTrue positive∗100=True positive+False PositiveTrue positive∗100

Recall

Recall(%)= T r u e p o s i t i v e n u m b e r o f a c t u a l l y p o s i t i v e ∗ 100 = T r u e p o s i t i v e T r u e p o s i t i v e + F a l s e N e g a t i v e ∗ 100 \frac{True \ positive}{number\ of \ actually \ positive}*100=\frac{True \ positive}{True \ positive + False \ Negative}*100 number of actually positiveTrue positive∗100=True positive+False NegativeTrue positive∗100

说明

当你有多个Classifiers时,每一个Classifier的Precision和Recall可能都不一样,而且Precision和Recall之间是存在取舍关系的。因此以Precision和Recall作为衡量指标是不太可行的,你无法一眼看出哪个Classifier表现得更好。

直观而言,你会想到以 ( P r e c i s i o n + R e c a l l ) / 2 (Precision+Recall)/2 (Precision+Recall)/2作为一个单一的度量指标,但直接求平均数并不太科学,我们有更好的求平均的方法F1 Score,称作调和平均(Harmonic)。

F1 Score

F 1 S c o r e = 2 1 P + 1 R F_1Score=\frac{2}{\frac{1}{P}+\frac{1}{R}} F1Score=P1+R12

你可以简单理解F1 Score为P和R的“平均”。

百度百科里有全面的解释:

使用Dev Set和单一的评估标准能够加速你学习的迭代过程。