softmax - numpy实现

def softmax(x):

x -= np.max(x, axis= 1, keepdims=True)

f_x = np.exp(x) / np.sum(np.exp(x), axis=1, keepdims=True)

return f_x

第一步:减去最大值。

因为在求exp时,可能因为指数过大,出现溢出的情况。

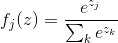

而在softmax中,重要的是两个数字之间的差值,只要差值相同,softmax的结果就相同:

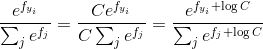

上下同乘一个常量C,结果不变。这个\(logC\)通常取\(max(f_j)\)

第二步:计算softmax

浙公网安备 33010602011771号

浙公网安备 33010602011771号