吴恩达机器学习_55过拟合问题/56代价函数

目前所学的学习算法:线性回归和逻辑回归

一、过度拟合

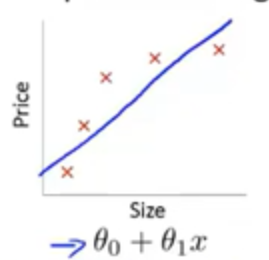

例子:线性拟合(房价)

(1)、 :欠拟合,具有高偏差

:欠拟合,具有高偏差

(2)、 :拟合的很好

:拟合的很好

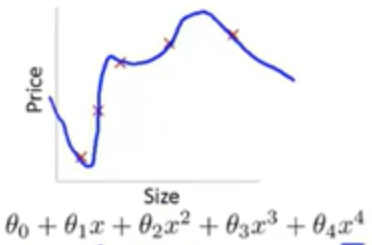

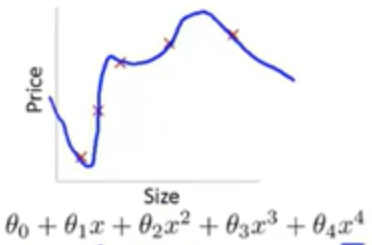

(3)、 :过拟合,具有高方差 (通常是变量太多,拟合出来的图像看起来很符合数据集,而且代价函数接近0,但是它无法泛化到新的数据集中)

:过拟合,具有高方差 (通常是变量太多,拟合出来的图像看起来很符合数据集,而且代价函数接近0,但是它无法泛化到新的数据集中)

二、解决过度拟合

(1)、减少变量的数量

(2)、正则化

保留所有的特征变量,但是减少量级或参数θ的大小

三、正则化

思路:

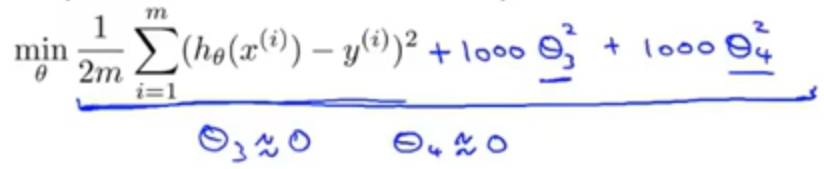

以上图为例,给代价函数加上惩罚项![]() ,

,

代价函数变为

惩罚项前的系数为1000,为了使代价函数最小,θ_3和θ_4要接近0,这就使得假设函数![]() 后两项几乎为零(相当于还是一个二次函数),从而在不减少变量的同时达到更好的拟合效果,这就是正则化的思路。

后两项几乎为零(相当于还是一个二次函数),从而在不减少变量的同时达到更好的拟合效果,这就是正则化的思路。

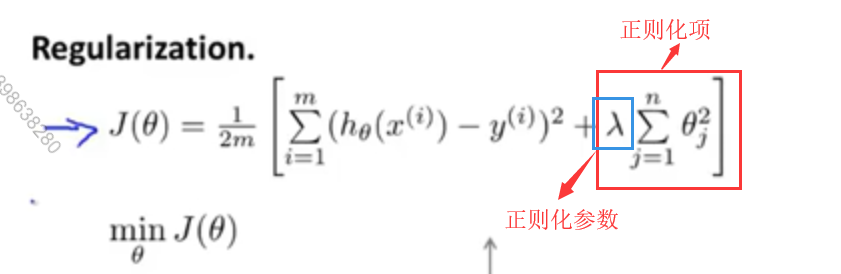

三、正则化代价函数

很多时候,我们不知道哪些变量是相关度比较低的,也就无法准确的缩小它们的值,因此我们考虑给代价函数添加额外的正则化项来缩小所有的参数,

通常θ_0这项不需要进行正则化,这是约定俗成的

通常θ_0这项不需要进行正则化,这是约定俗成的

如果正则化参数太大,那么对参数的惩罚程度太大,使得参数都接近为0

浙公网安备 33010602011771号

浙公网安备 33010602011771号