python 图片爬虫抓取图片系列一——爬取指定网页中的图片

来自 《Python项目案例开发从入门到实战》(清华大学出版社 郑秋生 夏敏捷主编)中爬虫应用——抓取百度图片

想要爬取指定网页中的图片主要需要以下三个步骤:

(1)指定网站链接,抓取该网站的源代码(如果使用google浏览器就是按下鼠标右键 -> Inspect-> Elements 中的 html 内容)

(2)根据你要抓取的内容设置正则表达式以匹配要抓取的内容

(3)设置循环列表,重复抓取和保存内容

以下介绍了两种方法实现抓取指定网页中图片

(1)方法一:使用正则表达式过滤抓到的 html 内容字符串

1 # 第一个简单的爬取图片的程序

2 import urllib.request # python自带的爬操作url的库

3 import re # 正则表达式

4

5

6 # 该方法传入url,返回url的html的源代码

7 def getHtmlCode(url):

8 # 以下几行注释的代码在本程序中有加没加效果一样,但是为了隐藏自己避免被反爬虫可以假如这个伪装的头部请求

9 headers = {

10 'User-Agent': 'Mozilla/5.0(Linux; Android 6.0; Nexus 5 Build/MRA58N) \

11 AppleWebKit/537.36(KHTML, like Gecko) Chrome/56.0.2924.87 Mobile Safari/537.36'

12 }

13 # 将headers头部添加到url,模拟浏览器访问

14 url = urllib.request.Request(url, headers=headers)

15

16 # 将url页面的源代码保存成字符串

17 page = urllib.request.urlopen(url).read()

18 # 字符串转码

19 page = page.decode('UTF-8')

20 return page

21

22

23 # 该方法传入html的源代码,通过截取其中的img标签,将图片保存到本机

24 def getImage(page):

25 # [^\s]*? 表示最小匹配, 两个括号表示列表中有两个元组

26 # imageList = re.findall(r'(https:[^\s]*?(png))"', page)

27 imageList = re.findall(r'(https:[^\s]*?(jpg|png|gif))"', page)

28 x = 0

29 # 循环列表

30 for imageUrl in imageList:

31 try:

32 print('正在下载: %s' % imageUrl[0])

33 # 这个image文件夹需要先创建好才能看到结果

34 image_save_path = './image/%d.png' % x

35 # 下载图片并且保存到指定文件夹中

36 urllib.request.urlretrieve(imageUrl[0], image_save_path)

37 x = x + 1

38 except:

39 continue

40

41 pass

42

43

44 if __name__ == '__main__':

45 # 指定要爬取的网站

46 url = "https://www.cnblogs.com/ttweixiao-IT-program/p/13324826.html"

47 # 得到该网站的源代码

48 page = getHtmlCode(url)

49 # 爬取该网站的图片并且保存

50 getImage(page)

51 # print(page)

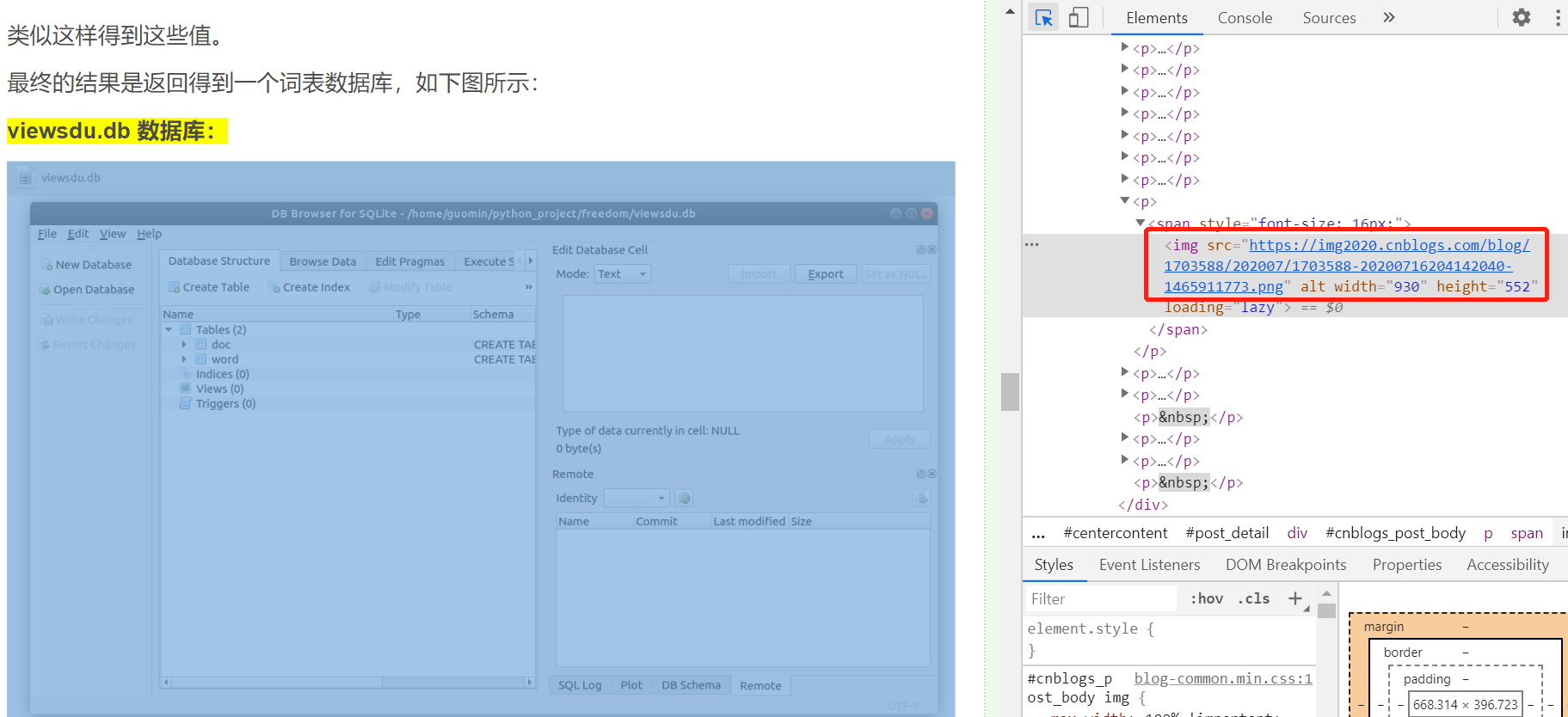

注意,代码中需要修改的就是 imageList = re.findall(r'(https:[^\s]*?(jpg|png|gif))"', page) 这一块内容,如何设计正则表达式需要根据你想要抓取的内容设置。我的设计来源如下:

可以看到,因为这个网页上的图片都是 png 格式,所以写成 imageList = re.findall(r'(https:[^\s]*?(png))"', page) 也是可以的。

(2)方法二:使用 BeautifulSoup 库解析 html 网页

1 from bs4 import BeautifulSoup # BeautifulSoup是python处理HTML/XML的函数库,是Python内置的网页分析工具

2 import urllib # python自带的爬操作url的库

3

4

5 # 该方法传入url,返回url的html的源代码

6 def getHtmlCode(url):

7 # 以下几行注释的代码在本程序中有加没加效果一样,但是为了隐藏自己避免被反爬虫可以假如这个伪装的头部请求

8 headers = {

9 'User-Agent': 'Mozilla/5.0(Linux; Android 6.0; Nexus 5 Build/MRA58N) \

10 AppleWebKit/537.36(KHTML, like Gecko) Chrome/56.0.2924.87 Mobile Safari/537.36'

11 }

12 # 将headers头部添加到url,模拟浏览器访问

13 url = urllib.request.Request(url, headers=headers)

14

15 # 将url页面的源代码保存成字符串

16 page = urllib.request.urlopen(url).read()

17 # 字符串转码

18 page = page.decode('UTF-8')

19 return page

20

21

22 # 该方法传入html的源代码,通过截取其中的img标签,将图片保存到本机

23 def getImage(page):

24 # 按照html格式解析页面

25 soup = BeautifulSoup(page, 'html.parser')

26 # 格式化输出DOM树的内容

27 print(soup.prettify())

28 # 返回所有包含img标签的列表,因为在Html文件中图片的插入呈现形式是<img src="..." alt=".." />

29 imgList = soup.find_all('img')

30 x = 0

31 # 循环找到的图片列表,注意,这里手动设置从第2张图片开始,是因为我debug看到了第一张图片不是我想要的图片

32 for imgUrl in imgList[1:]:

33 print('正在下载: %s ' % imgUrl.get('src'))

34 # 得到scr的内容,这里返回的就是Url字符串链接,如'https://img2020.cnblogs.com/blog/1703588/202007/1703588-20200716203143042-623499171.png'

35 image_url = imgUrl.get('src')

36 # 这个image文件夹需要先创建好才能看到结果

37 image_save_path = './image/%d.png' % x

38 # 下载图片并且保存到指定文件夹中

39 urllib.request.urlretrieve(image_url, image_save_path)

40 x = x + 1

41

42

43 if __name__ == '__main__':

44 # 指定要爬取的网站

45 url = 'https://www.cnblogs.com/ttweixiao-IT-program/p/13324826.html'

46 # 得到该网站的源代码

47 page = getHtmlCode(url)

48 # 爬取该网站的图片并且保存

49 getImage(page)

这两种方法各有利弊,我觉得可以灵活结合使用这两种方法,比如先使用方法2中指定标签的方法缩小要寻找的内容范围,然后再使用正则表达式匹配想要的内容,这样做起来更加简洁明了。

浙公网安备 33010602011771号

浙公网安备 33010602011771号