神经网络优化:Adam(Adaptive Moment Estimation)

Adam算法其实就是结合了动量梯度下降法和RMSprop算法,是最广为使用的算法,在大多数情况下都有效果。

动量梯度算法和RMSprop算法的复习:

动量:https://www.cnblogs.com/toriyung/p/16467289.html

RMS:https://www.cnblogs.com/toriyung/p/16537212.html

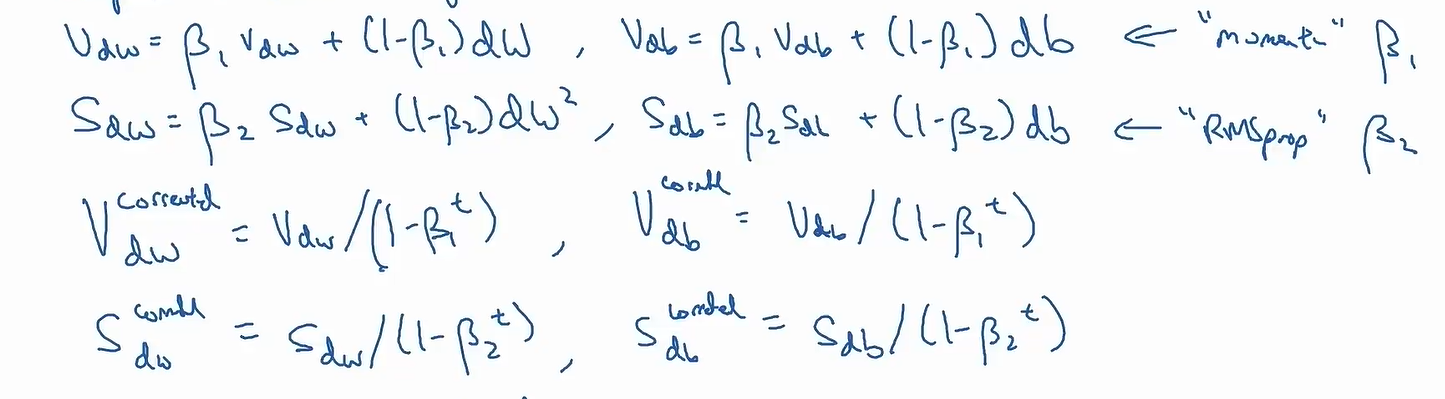

先和以往一样,计算V和S(记得修正)

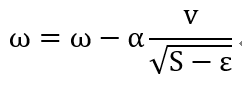

然后更新

参数

Adam算法涉及到四个参数

α:需要进行调试和选择

β1:动量算法滑动均值的权重,默认为0.9

β2:RMSprop算法的权重,默认为0.999

ε:RMSprop算法的除数规避常数,默认为1e-8

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 无需6万激活码!GitHub神秘组织3小时极速复刻Manus,手把手教你使用OpenManus搭建本

· Manus爆火,是硬核还是营销?

· 终于写完轮子一部分:tcp代理 了,记录一下

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通