Python自然语言处理学习——jieba分词

jieba——“结巴”中文分词是sunjunyi开发的一款Python中文分词组件,可以在Github上查看jieba项目。

要使用jieba中文分词,首先需要安装jieba中文分词,作者给出了如下的安装方法:

1.全自动安装:easy_install jieba 或者 pip install jieba / pip3 install jieba

2.半自动安装:先下载 http://pypi.python.org/pypi/jieba/ ,解压后运行 python setup.py install

3.手动安装:将 jieba 目录放置于当前目录或者 site-packages 目录

作者介绍其采用的算法:

1.基于前缀词典实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图 (DAG)

2.采用了动态规划查找最大概率路径, 找出基于词频的最大切分组合

3.对于未登录词,采用了基于汉字成词能力的 HMM 模型,使用了 Viterbi 算法

主要功能:

1.分词

分词功能主要有两个方法 jieba.cut 和 jieba.cut_for_search,

其中 jieba.cut方法 接受三个输入参数:

1.需要分词的字符串;

2.cut_all 参数用来控制是否采用全模式;

3.HMM 参数用来控制是否使用 HMM 模型

jieba.cut("我来到北京清华大学", cut_all=True)

其中 jieba.cut_for_search方法 接受两个输入参数:

1.需要分词的字符串;

2.是否使用 HMM 模型。

该方法适合用于搜索引擎构建倒排索引的分词,粒度比较细

jieba.cut_for_search("小明硕士毕业于中国科学院计算所,后在日本京都大学深造")

jieba.cut方法 和 jieba.cut_for_search方法 返回的结构都是一个可迭代的 generator,可以使用 for 循环来获得分词后得到的每一个词语(unicode)

也可以使用 jieba.lcut方法 和 jieba.lcut_for_search方法 直接返回 list

作者的说明:待分词的字符串可以是 unicode 或 UTF-8 字符串、GBK 字符串。

注意:不建议直接输入 GBK 字符串,可能无法预料地错误解码成 UTF-8

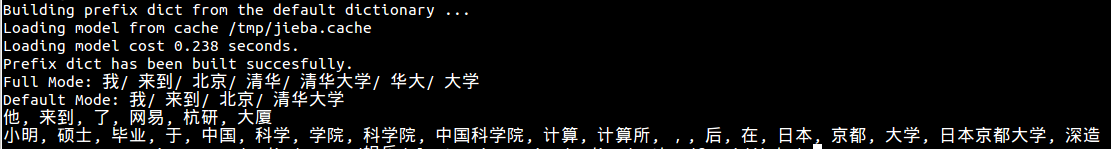

以下是作者给出的demo和运行结果:

# coding:utf-8

# !/usr/bin/env python

import jieba

if __name__ == '__main__':

seg_list = jieba.cut("我来到北京清华大学", cut_all=True)

print("Full Mode: " + "/ ".join(seg_list)) #全模式

seg_list = jieba.cut("我来到北京清华大学", cut_all=False)

print("Default Mode: " + "/ ".join(seg_list)) #精确模式

seg_list = jieba.cut("他来到了网易杭研大厦") #默认是精确模式

print(", ".join(seg_list))

seg_list = jieba.cut_for_search("小明硕士毕业于中国科学院计算所,后在日本京都大学深造") #搜索引擎模式

print(", ".join(seg_list))

输出的结果

可以看到:

全模式:试图将句子最精确地切开,适合文本分析,输出的是所有可能的分词组合,比如清华大学,会被分成:清华,清华大学,华大,大学

默认模型(精确模型):把句子中所有的可以成词的词语都扫描出来, 速度非常快,但是不能解决歧义,比如清华大学,只会输出清华大学

搜索引擎模式:在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词

还有另外一个方法 jieba.Tokenizer(dictionary=DEFAULT_DICT),用于新建自定义分词器,可用于同时使用不同词典。

jieba.dt 为默认分词器,所有全局分词相关函数都是该分词器的映射。

本文只发表于博客园和tonglin0325的博客,作者:tonglin0325,转载请注明原文链接:https://www.cnblogs.com/tonglin0325/p/6298456.html