拓端数据tecdat|用TensorFlow代写实现MNIST

原文链接:http://tecdat.cn/?p=5681

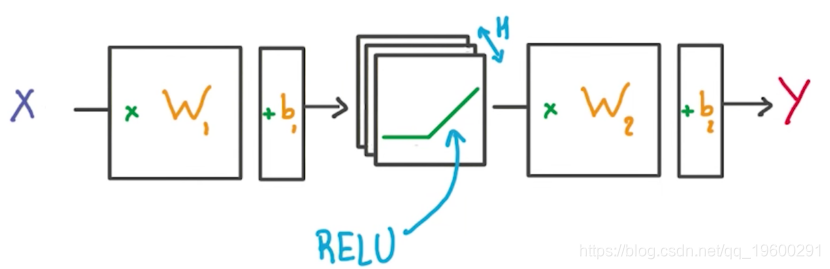

这里,我们用TensorFlow实现一个3层,即输入层、隐藏层、输出层的神经网络。

引入相关模块 # tensorflow 自带mnist模块

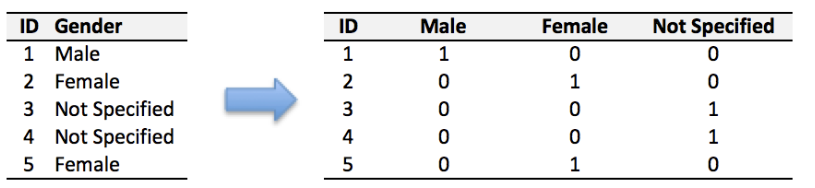

这里有个one_hot=True,one_hot表示独热编码,可以看下面的图片理解意思:

one hot encoding

参数设置

learning rate是学习的速度,每次更新参数时的步长(速度),太小会造成学习速度太慢,太大会造成无法拟合的结果。

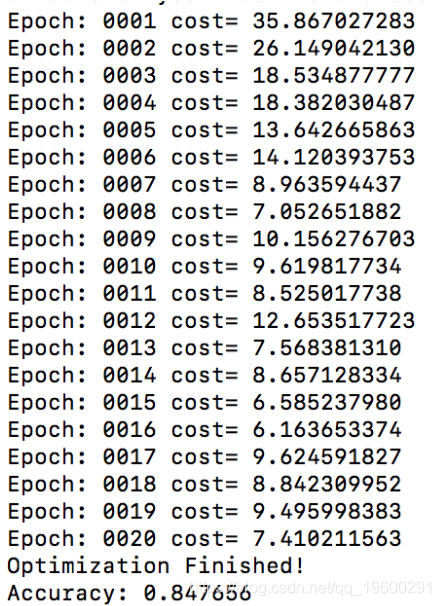

一个 epoch是指整个数据集正向反向训练一次。

batch size 是一次拿多少数据去训练,具体可以参考What is a batch in TensorFlow? - Stack Overflow。

定义模型

训练结果

如果您有任何疑问,请在下面发表评论。

▍关注我们

【大数据部落】第三方数据服务提供商,提供全面的统计分析与数据挖掘咨询服务,为客户定制个性化的数据解决方案与行业报告等。

▍咨询链接:http://y0.cn/teradat

▍联系邮箱:3025393450@qq.com