数据结构化与保存

1. 将新闻的正文内容保存到文本文件。

2. 将新闻数据结构化为字典的列表:

- 单条新闻的详情-->字典news

- 一个列表页所有单条新闻汇总-->列表newsls.append(news)

- 所有列表页的所有新闻汇总列表newstotal.extend(newsls)

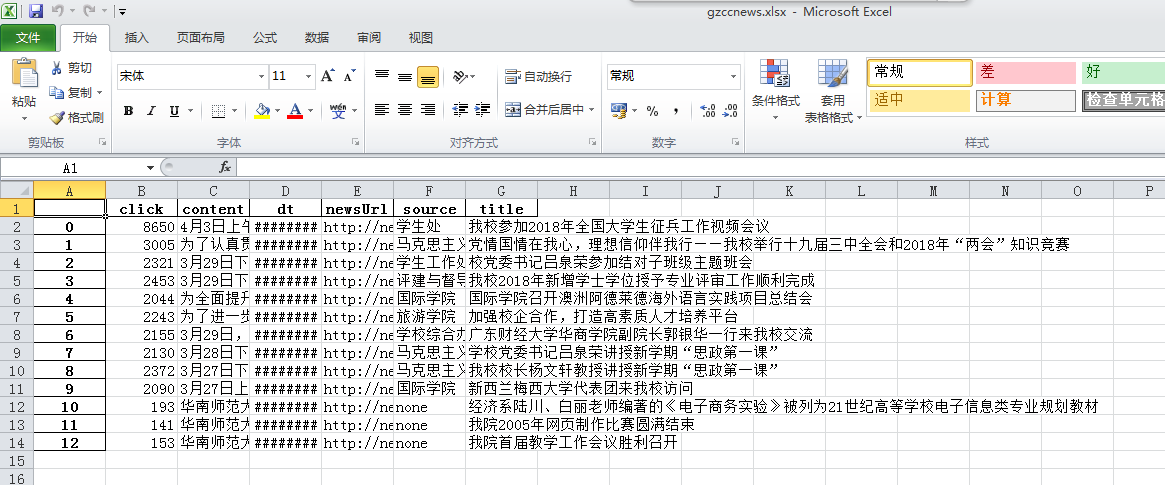

3. 安装pandas,用pandas.DataFrame(newstotal),创建一个DataFrame对象df.

4. 通过df将提取的数据保存到csv或excel 文件。

5. 用pandas提供的函数和方法进行数据分析:

- 提取包含点击次数、标题、来源的前6行数据

- 提取‘学校综合办’发布的,‘点击次数’超过3000的新闻。

- 提取'国际学院'和'学生工作处'发布的全部新闻。

import requests import string import re from datetime import datetime newsurl='http://news.gzcc.cn/html/xiaoyuanxinwen/' res = requests.get(newsurl) #返回response对象 res.encoding='utf-8' from bs4 import BeautifulSoup soup = BeautifulSoup(res.text,'html.parser') def getClickCount(newsUrl): newId=re.search('\_(.*).html',newsUrl).group(1).split('/')[1] clickUrl='http://oa.gzcc.cn/api.php?op=count&id={}&modelid=80'.format(newId) return(int(requests.get(clickUrl).text.split('.html')[-1].lstrip("('").rstrip("');"))) def writeNewsDetail(content): f=open('gzccNews.txt','a',encoding='utf-8') f.write(content) f.close() # def getNewsDetail(newsurl): # resd=requests.get(newsurl) # resd.encoding='utf-8' # soupd=BeautifulSoup(resd.text,'html.parser') # title=soupd.select('.show-title')[0].text # info=soupd.select('show-info')[0].text # dt=datetime.strptime(info.lstrip('发布时间:')[0:19],'%Y-%m-%d %H:%M:%S') # if info.find('来源')>0: # source=info[info.find('来源:'):].split()[0].lstrip('来源:') # else: # source='none' # content=soupd.select('.show-content')[0].text.strip() # click=getClickCount(newsurl) # print(click,title,newsurl,source,dt) def getNewsDetail(newsUrl): resd=requests.get(newsUrl) resd.encoding='utf-8' soupd=BeautifulSoup(resd.text,'html.parser') news={} news['title']=soupd.select('.show-title')[0].text info = soupd.select('.show-info')[0].text news['dt']=datetime.strptime(info.lstrip('发布时间:')[0:19],'%Y-%m-%d %H:%M:%S') if info.find('来源')>0: news['source']=info[info.find('来源:'):].split()[0].lstrip('来源:') else: news['source']='none' news['content']=soupd.select('.show-content')[0].text.strip() news['click']=getClickCount(newsUrl) news['newsUrl']=newsUrl return (news) def getListPage(listPageUrl): res=requests.get(listPageUrl) res.encoding='utf-8' soup=BeautifulSoup(res.text,'html.parser') newsList=[] for news in soup.select('li'): if len(news.select('.news-list-title'))>0: a=news.select('a')[0].attrs['href'] newsList.append(getNewsDetail(a)) return (newsList) def getPageN(): res=requests.get('http://news.gzcc.cn/html/xiaoyuanxinwen/') res.encoding='utf-8' soupn=BeautifulSoup(res.text,'html.parser') n=int(soupn.select('.a1')[0].text.rstrip('条')) return(n//10+1) newsTotal=[] firstPage='http://news.gzcc.cn/html/xiaoyuanxinwen/' newsTotal.extend(getListPage(firstPage)) n=getPageN() for i in range(n,n+1): listpageUrl='http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html'.format(i) newsTotal.extend(getListPage(listpageUrl)) for news in newsTotal: print(news) import pandas df=pandas.DataFrame(newsTotal) df.to_excel('gzccnews.xlsx')

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】凌霞软件回馈社区,博客园 & 1Panel & Halo 联合会员上线

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】博客园社区专享云产品让利特惠,阿里云新客6.5折上折

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步